Sequential Modeling

- 기존 :

- 시간 개념 또는 순서 정보를 사용하여 입력을 학습하는 것

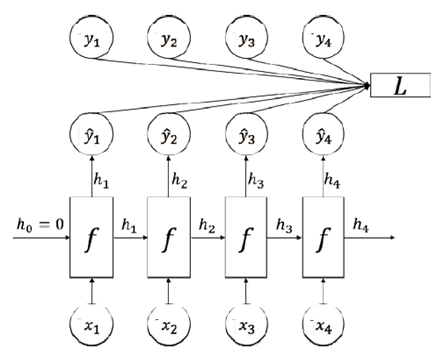

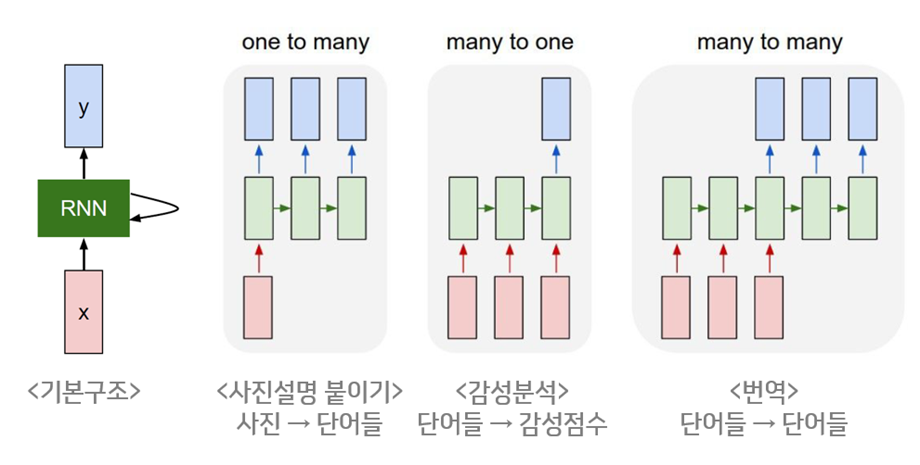

RNN(Recurrent Neural Network)

-

순환 신경망(RNN)은 입력 xt와, 직전의 은닉 상태hidden state인 ht-1를 참조하여 현재의 상태인 ht를 결정하는 작업을 여러 time-step에 걸쳐 수행한다

-

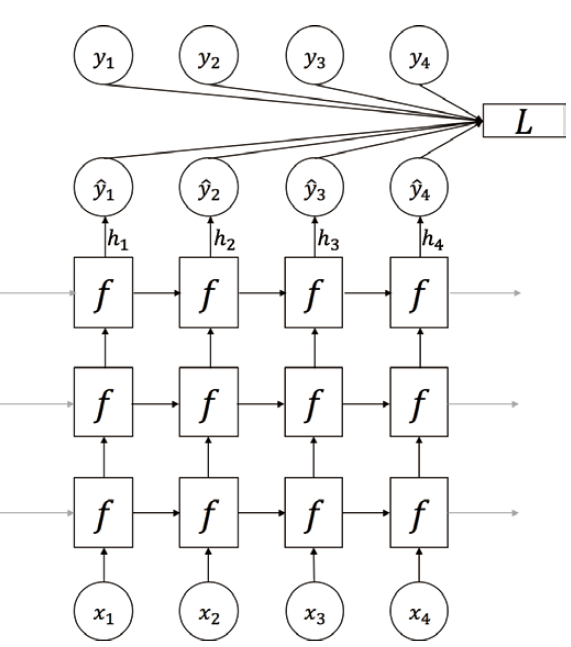

여러 계층을 갖는 RNN

-

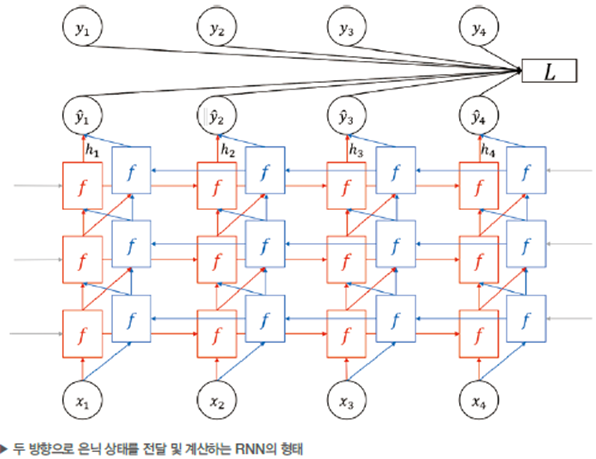

양 방향 RNN

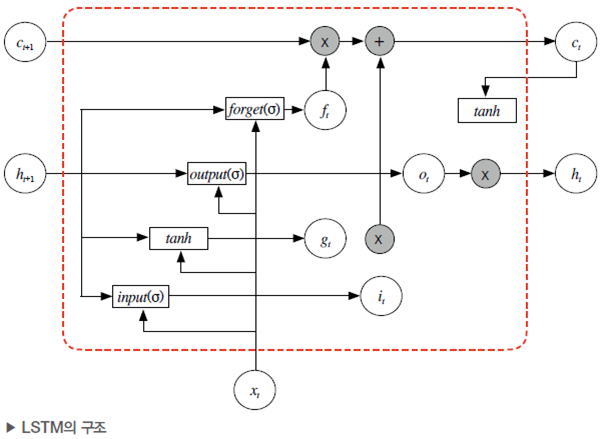

LSTM(Long short term memory)

- Rnn의 단점 보완

- time-step이 길어질수록 앞의 데이터를 기억하지 못함 - Rnn의 은닉 상태 이외에도 별도의 Cell state 변수를 두어 기억력 증가

- 여러 게이트를 두어 기억하거나 잊어버리거나, 출력하고자 하는 데이터의 양을 상황에 맞게 제어-> 긴 길이의 데이터를 효율적으로 대처

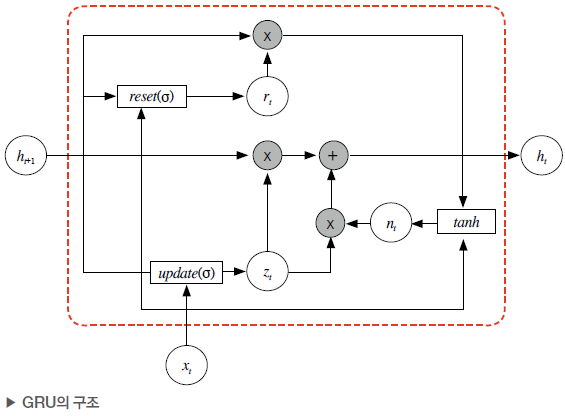

GRU(Gated Recurrent Unit)

- LSTM의 간소화 버전(연산량을 줄였지만 비슷한 성능 기록)