Machine Learning by professor Andrew Ng in Coursera

'Data Compression를 왜 하는지에 대해 '

1) Motivation I: Data Compression

Data Comprehension

데이터를 에서 로 줄인다.

- redundancy를 줄일 수 있다.

- 서로 연관성있는 특성들은 1개로 줄일 수 있다.

예를 들어 비행기 조종사에 관한 data가 있을 때.

& 라면

이 두 특성을 라는 특성 1개로

축소할 수 있다.

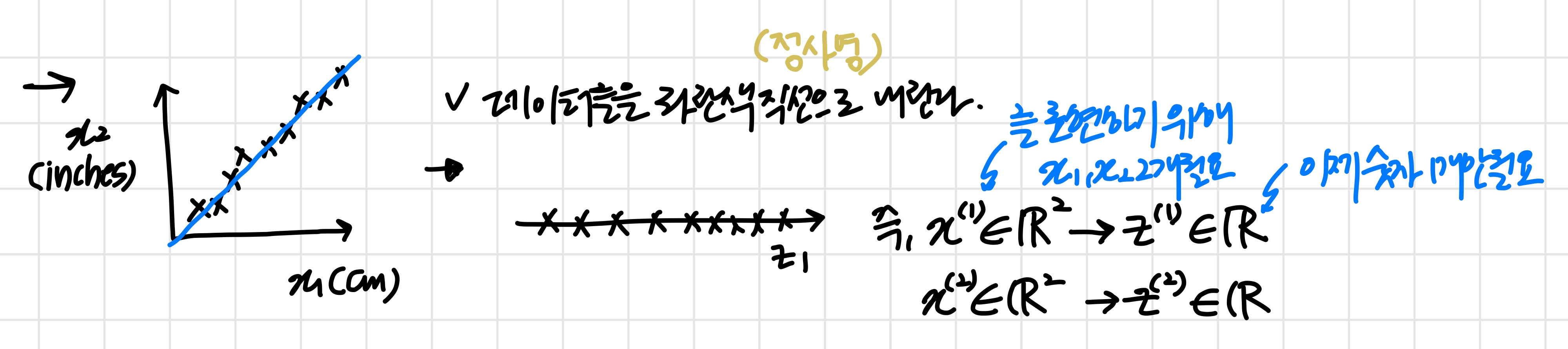

- 모든 원본 데이터들을 어떤 직선으로 내린다.

'정사영, projection'

'approximation of original training set' - 이제 데이터를 표현할 때 숫자 2개가 아닌 1개만 필요.

- memory&space requirement 가 전부 줄어든다.

- learning algorithm을 더 빨리 실행할 수 있다.

데이터를 에서 로 줄인다.

'실전에서는 10000D에서 100D로 줄이는 상황도 생긴다.'

- 두 개의 벡터로 이루어진 임의의 평면에 원본 데이터들을 projection한다.

1) Motivation II: Visualization

예를 들어 feature가 50개 라면, plot해 볼 수 없다.

'그래프로 나타내기 위해 혹은 로 변환하는 것'

Q : 데이터를 시각화할 때

우선 (이때 은 원본 데이터의 차원 수)이고, (2D 또는 3D까지만 시각화 할 수 있기 때문)