[Paper Review]LAYER-WISE UPDATE AGGREGATION WITH RECYCLING FOR COMMUNICATION-EFFICIENT FEDERATED LEARNING

Paper Review

https://arxiv.org/pdf/2503.11146

LAYER-WISE UPDATE AGGREGATION WITH RECYCLING FOR COMMUNICATION-EFFICIENT FEDERATED LEARNING

NeurIPS, 2025

본 논문에서는 FL에서 발생하는 통신 비용을 줄이기 위해 가중치 노름에 대한 그래디언트 노름의 비율을 사용하여 네트워크 레이어의 우선순위를 정한다.

레이어별로 쪼개서 FL을 적용한다.

이때, 가중치 노름에 대한 그래디언트 노름의 비율이 작은, 즉, 업데이트 영향이 적을 레이어의 그래디언트는 서버로 전송되지 않고, 서버에서는 그 전 스텝의 그래디언트를 재사용한다.(이때, 확률적 샘플링을 하여 과도하게 재사용되는 것을 방지한다.)

Introduction

Federated Learning (FL)에서 발생하는 통신 비용은 실제 어플리케이션 적용의 주된 방해요인이다.

이를 해결하기 위해 기존 방식들은 주로 gradient magnitude에 기반하여 모델 업데이트의 일부를 버리는(Dropping) 데 집중해 왔다.

기존 방식들

양자화: 전송되는 파라미터의 비트 정밀도를 낮추어 비용을 줄인다.

Pruning: 파라미터의 일부를 직접 제거하여 통신 오버헤드를 피한다.

Reparameterization: 행렬 분해 기술 등을 사용하여 파라미터 총량을 줄인다.

이 논문은 업데이트를 버리는 대신 이전의 업데이트를 재활용(Recycling)하는 것이 성능을 유지하며, 통신 비용을 줄이는 것을 발견했다.

본 연구의 주요 통찰

-

노이즈 최소화: 업데이트 크기가 파라미터 크기에 비해 상대적으로 작은 계층에 노이즈를 도입함으로써 성능 저하를 최소화한다.

-

빠른 수렴: 단순히 업데이트를 버리는 것보다 재활용하는 방식이 동일 계층 대비 더 빠른 손실 수렴을 달성함을 실증으로 보여준다.

-

이론적 보장: 업데이트가 재활용되는 계층 수가 충분히 적을 때 FedLUAR가 최솟값 근처로 수렴함을 이론적으로 분석한다.

Method

Motivation

기존의 많은 통신 효율적인 FL 방법은 그래디언트 크기를 최대한 유사하게 유지하면서 통신 비용을 줄이는 방법에 집중한다.

update sparsification methods는 그레디언트가 작은 파라미터의 Subset을 선택하고 해당 업데이트를 생략한다.

Layer-wise model aggregation methods는 레이어별로 그래디언트 노름이 작은 레이어의 로컬 업데이트를 선택적으로 집계한다.

이러한 방법들은 결국 그래디언트가 클 수록 더 중요하다고 가정한다.

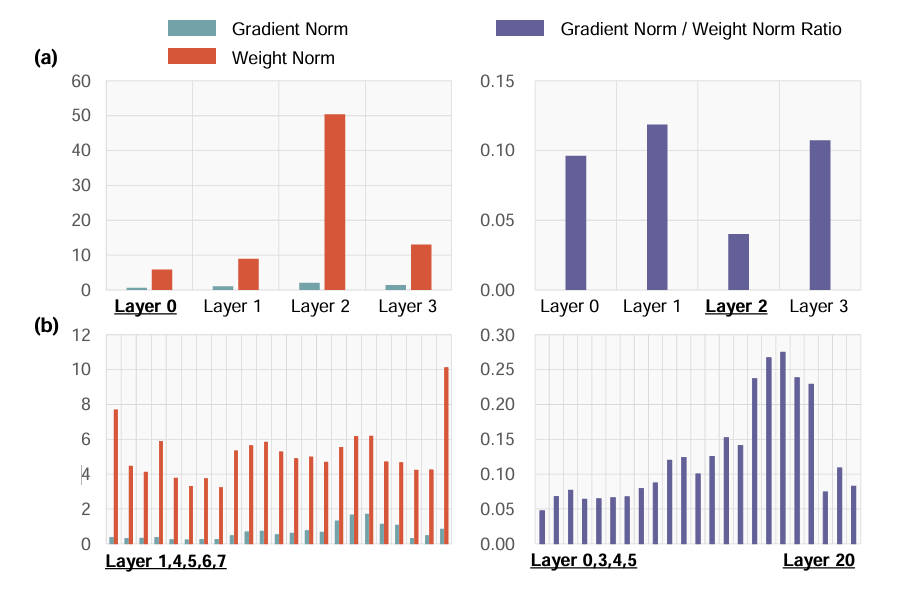

하지만 본 논문에서는 본 차트를 통해 그것을 반박한다.

(a) FEMNIST (CNN), (b) CIFAR-10 (ResNet20)에 대해서

왼편: 그래디언트 노름 및 가중치 노름

오른편: 가중치 노름 대비 그래디언트 노름의 비율

위 차트가 나타내는 의미는 다음과 같다.

그래디언트 노름이 크더라도 가중치 노름도 원래 컸다면 그 변화가 크지 않을 수 있다는 것을 의미한다.

결국 가중치 노름 대비 그래디언트 노름의 비율이 클 수록 출력에 미치는 영향이 클 것이다.

Layer-wise Update Recycling

Gradient-Weight Ratio Analysis

본 논문에서는 가중치 크기에 대한 그래디언트 크기의 비율을 사용하여 네트워크 레이어의 우선순위를 정한다.

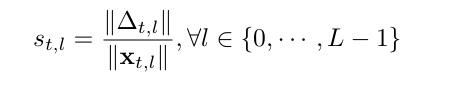

신경망의 개 레이어가 주어졌을 때, 우선순위 지표 은 다음과 같이 정의된다.

: 라운드 에서 레이어 에 대해 모든 클라이언트에서 평균화되어 누적된 로컬 업데이트

: 라운드 에서 레이어 의 초기 모델 파라미터

직관적으로 이 지표는 파라미터 크기에 따른 상대적인 그래디언트 크기를 정량화한다.

만약 이 크게 측정되면, 해당 레이어의 파라미터가 파라미터 공간에서 빠르게 이동할 것으로 예상되고, 업데이트의 정확성에 민감해진다.

반대로 이 작으면, 각 업데이트 후에 레이어의 파라미터가 급격하게 변하지 않을 것이다.

이 작으면 레이어 에 낮은 우선순위를 부여하고, 크면 높은 우선순위를 부여한다.

이 지표는 서버 측에서 효율적으로 측정될 수 있다.

은 이미 모든 통신 라운드 전에 서버에 저장되어 있다.

모든 FL 방법은 매 라운드 후 로컬 업데이트를 집계하므로, 또한 이미 서버에서 사용할 준비가 되어 있다.

따라서 은 추가적인 통신 없이 쉽게 측정될 수 있다.

Layer-wise Stochastic Update Recycling Method

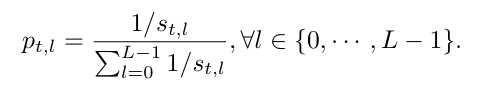

로 우선순위를 정할 수 있으니, 우선순위가 낮은걸 재활용하면 된다.

하지만, 이때 단순히 우선순위가 낮은걸 선택한다면 우선순위가 낮은 레이어는 과도하게 재사용될 것이다.

그렇기 때문에 이 논문에서는 재사용할 레이어를 확률적으로 샘플링하여 선택하게끔 하였다.

확률 분포 를 사용하여 개의 레이어를 무작위로 샘플링한다.

(는 하이퍼파라미터)

라운드 에서 샘플링된 레이어들을 로 정의한다.

샘플링된 레이어들은 최신 업데이트 대신 이전 라운드의 업데이트를 사용하여 업데이트된다.

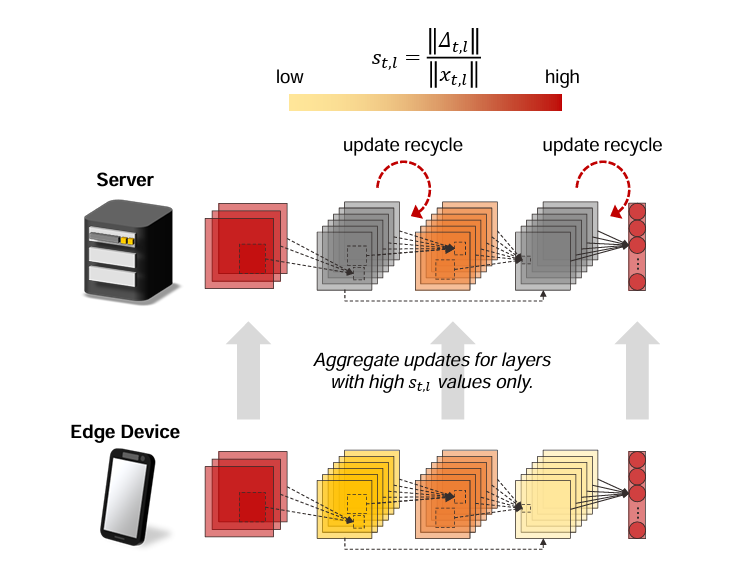

schematic illustration of FedLUAR

전체 도식은 다음과 같다.

각 클라이언트는 값이 큰 레이어에 대해서만 업데이트를 전송한다

그 외의 레이어에 대해 서버는 이전 업데이트를 '리사이클링' 한다.

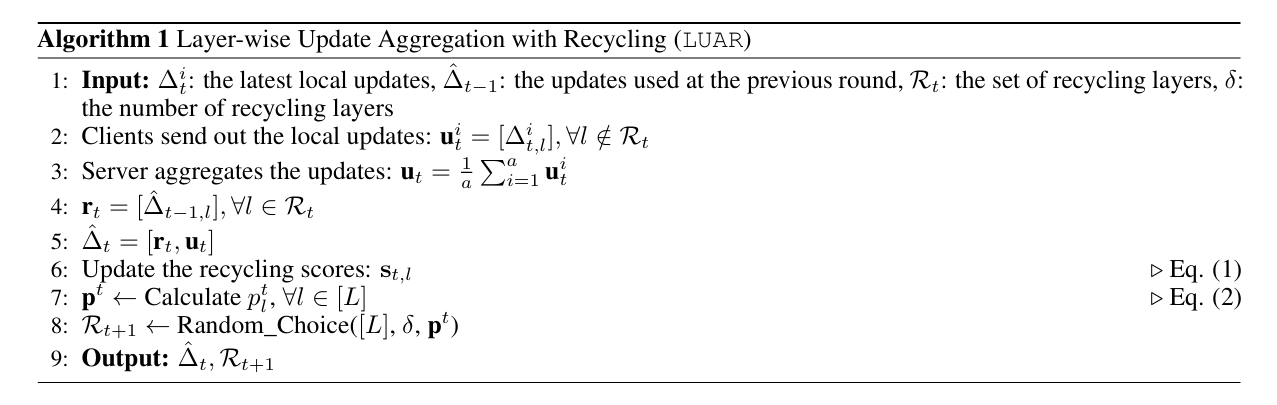

Algorithm

알고리즘1에서는 서버에서 를 업데이트하고 에 따라 을 정의하는 과정을 보여준다.

알고리즘2에서는 알고리즘1을 사용하여 학습이 진행되는 과정을 보여준다.

Theoretical Analysis

이 알고리즘이 동작함을 3가지 가정에서 설명한다.

Assumption

1. Lipschitz Continuity (립시츠 연속성)

이 가정은 손실 함수 의 Gradient가 급격하게 변하지 않음을 보장한다.

: 지점 와 에서의 기울기 벡터

: Lipschitz constant, 기울기가 변하는 최대 속도를 제한

이 조건이 있어야 Learning rate을 적절히 잡았을 때 알고리즘이 발산하지 않고 안정적으로 수렴할 수 있다.

2. Unbiased Local Gradients (편향되지 않은 로컬 기울기)

이 가정은 무작위로 뽑은 데이터 샘플(Mini-batch)로 계산한 기울기가 평균적으로는 진짜 기울기와 같다는 것을 의미한다.

: 클라이언트 의 데이터 분포 에서 무작위로 추출한 샘플(또는 미니배치) 를 의미

: 특정 샘플 에 대해 계산한 확률적 기울기(Stochastic Gradient)

: 클라이언트 가 가진 전체 데이터에 대한 진짜 기울기(Full-batch Gradient)

매 순간 계산하는 기울기는 샘플링 때문에 노이즈가 섞여 있어도, 이를 무한히 반복해서 평균을 내면 결국 진짜 방향을 가리킨다는 뜻

Bounded Local and Global Variance (제한된 로컬 및 글로벌 분산)

이 가정은 노이즈의 크기를 제한한다. 학습 중에 발생하는 오차가 무한히 커지지 않음을 보장하기 위함이다.

(1) Local Variance (로컬 분산)

각 클라이언트 내부에서 샘플링으로 인해 발생하는 노이즈의 크기가 라는 상수로 제한된다는 뜻

데이터 샘플 간의 이질성이 너무 크지 않음을 의미한다.

(2) Global Variability (글로벌 변동성)

: 모든 클라이언트의 손실 함수를 평균 낸 전체 목적 함수의 기울기

개별 클라이언트의 데이터 분포()가 전체 평균()과 얼마나 다른지를 나타낸다.

연합 학습에서 흔히 말하는 데이터 이질성(Non-IID)의 정도를 수치화한 것이며, 가 클수록 클라이언트 간 데이터가 서로 매우 다르다는 뜻이다.

Main Theoretical Results

앞서 정의한 가정들을 바탕으로, 업데이트 재활용이 학습에 미치는 영향과 알고리즘의 수렴 가능성을 수학적으로 증명한다.

1. Lemma 3.1 (Noise Bound)

업데이트 재활용으로 인해 발생하는 노이즈 가 일정 수준 이하로 관리됨을 보장한다.

여기서 는 실제 최신 업데이트와 재활용된 업데이트 사이의 차이를 의미한다.

노이즈 상한선: 학습률 를 만족할 때, 누적된 노이즈의 크기는 로컬 분산()과 글로벌 변동성() 등에 의해 결정되는 특정 값보다 작다.

업데이트를 여러 번 재활용하거나 많은 레이어에서 재활용하더라도, 재활용 비중()이 충분히 작다면 노이즈가 무한히 커지지 않고 통제 가능함을 시사한다.

그리고 는 1/16보다 작음이 논문에서 증명된다.

2. Theorem 3.2 (Convergence Guarantee)

FedLUAR 알고리즘이 최종적으로 최솟값 근처로 수렴함을 증명하는 정리다.

수렴 조건: 학습률 와 재활용 비중 가 특정 조건( 등)을 만족해야 한다.

Neighborhood Convergence: 알고리즘은 완전한 최솟값이 아닌, 그 Neighbor region으로 수렴한다.

이는 데이터 이질성()과 로컬 분산()이 존재하는 현실적인 연합 학습 환경의 특징을 반영한다.

Remarks

안전한 재활용: Lemma 3.1을 통해 사용자가 레이어별로 업데이트를 재활용하더라도 학습의 안정성을 해치지 않음을 이론적으로 확인할 수 있다.

데이터 이질성의 영향: 데이터가 클라이언트마다 High Non-IID에서는 모델이 최솟값에 도달하는 정밀도가 떨어질 수 있다. 이를 완화하기 위해 로컬 훈련 시 배치 사이즈를 크게 가져가는 등의 전략이 도움이 될 수 있다.

실질적 수렴: 비록 Neighborhood 수렴이지만, 학습률 가 작아짐에 따라 오차 항들이 점차 줄어들므로 실제 응용 분야에서 충분히 실용적인 수렴 성능을 보장한다.

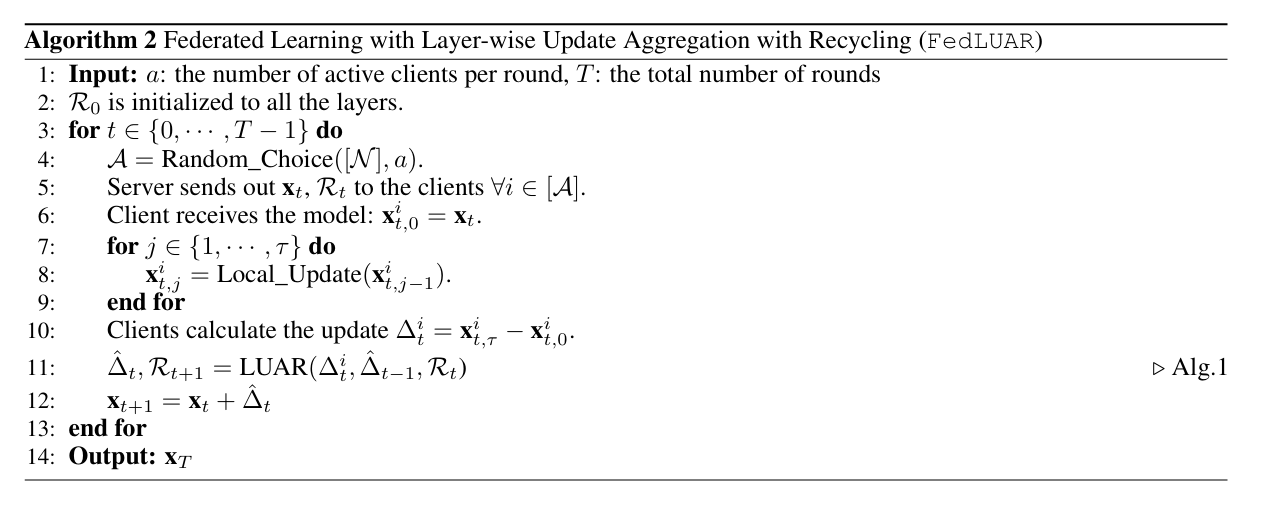

Experiments

기존의 통신 효율화 기법들(Quantization, Pruning 등)과 비교했을 때, FedLUAR는 모든 데이터셋에서 압도적인 성능을 보였다.

AG News (DistillBERT): FedAvg와 거의 동일한 정확도를 유지하면서 통신 비용을 17% 수준으로 대폭 절감하였다.

FEMNIST: 통신 비용을 18%까지 줄이면서도 정확도는 오히려 FedAvg보다 소폭 상승하거나 대등한 수준을 기록하였다.

단순히 파라미터를 버리는 Pruning이나 정확도 손실이 큰 Quantization 기법보다 FedLUAR의 '업데이트 재활용' 방식이 훨씬 효율적임을 입증하였다.

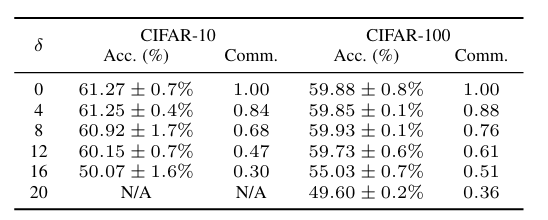

재활용할 레이어의 개수()를 늘릴수록 통신 비용은 줄어들지만, 임계치를 넘으면 정확도가 하락한다

실험 결과, 가 12가 될 때까지는 정확도 저하가 거의 발생하지 않았다.

=> 이는 많은 네트워크 레이어들이 상당히 안정적인 기울기 동역학을 가지고 있으며, 이전 업데이트를 재사용해도 학습에 큰 지장이 없음을 의미한다.

Limits

논문에 언급된 내용도 있고 아닌 내용도 있다.

FedLUAR는 통신 절감 효과를 보여주지만, 실제 시스템 적용 시 고려해야 할 몇 가지 한계점들이 존재한다.

1. 시스템 및 자원 관점의 한계

- 서버 측 메모리 오버헤드: 서버는 업데이트 재활용을 위해 이전 라운드의 업데이트()를 모든 레이어에 대해 보관해야 한다.

- 통신 제어 오버헤드: 서버는 매 라운드 클라이언트에게 어떤 레이어의 전송을 생략할지( 리스트) 알려주어야 한다. (저자는 이 비용이 무시할 수 있는 수준이라고 언급했다.)

2. 업데이트 노후화(Staleness)의 상한 부재

- 논문에서는 업데이트가 몇 라운드 동안 재활용될 수 있는지( 값)에 대한 명시적인 Upper bound를 두지 않는다.

- 오직 지표()에만 의존하여 레이어를 선택하기 때문에 , 특정 레이어가 운이 나쁘게 계속 재활용 대상으로 선택된다면 너무 오래된 기울기가 현재 모델 상태와 맞지 않아 학습을 방해할 위험이 있다.

3. 확률적 선택의 불안정성

- 레이어 선택이 가중치 기반의 확률적 선택으로 이루어진다. 이로 인해 특정 라운드에서 매우 중요한 레이어가 우연히 재활용 대상으로 선택될 경우, 일시적인 성능 하락이나 학습 곡선의 Spike가 발생할 수 있는 불안정성을 내포하고 있다.

4. 일반화 및 실용성 문제

- 수동적인 하이퍼파라미터 설정: 재활용할 레이어의 개수()를 사용자가 직접 튜닝해야 하는 하이퍼파라미터로 남겨두었다. Table 2에서 보이듯 값에 따라 성능이 민감하게 변하므로 , 새로운 모델이나 데이터셋에 적용할 때마다 최적의 를 찾기 위한 추가 실험 비용이 발생한다.

- 고정된 값의 경직성: 가 학습 전체 과정에서 고정되어 있어 학습 단계별 동적인 변화를 반영하지 못한다. 학습 초기에는 모델이 급격히 변하므로 더 많은 최신 업데이트가 필요하고, 수렴 단계에서는 더 많은 레이어를 재활용할 수 있음에도 불구하고 이를 유연하게 조절하지 못해 이론적인 최대 효율에 도달하는 데 한계가 있다.

5. 우선순위 지표()의 단순성

- 업데이트 노름()과 가중치 노름()의 비율만으로 레이어의 중요도를 판단한다.

- 하지만 특정 레이어(예: BatchNorm 파라미터 등)는 노름의 크기와 상관없이 수렴에 결정적인 역할을 할 수 있는데, 단순한 노름 비율이 이러한 복잡한 중요도를 완벽히 대변하기에는 부족할 수 있다.

6. 레이어 간 의존성 무시

- 딥러닝 모델의 레이어들은 서로 밀접하게 연결되어 작용한다.

- 특정 레이어는 최신 업데이트를 반영하는데 바로 다음 레이어는 이전 라운드 값을 재활용한다면, 레이어 간 Inconsistency가 발생하여 학습 효율이나 최종 성능이 떨어질 가능성이 존재한다.

7. 보안 및 프라이버시

- 연합 학습의 보안 공격 중에는 기울기를 역추적하여 데이터를 복원하는 Inversion Attack이 존재한다.

- 서버가 특정 레이어의 업데이트를 여러 라운드에 걸쳐 재사용하거나 비교할 수 있는 구조는, 잠재적으로 클라이언트의 데이터 정보가 유출될 수 있는 통로가 될 위험이 없는지 심도 있는 검토가 필요하다.