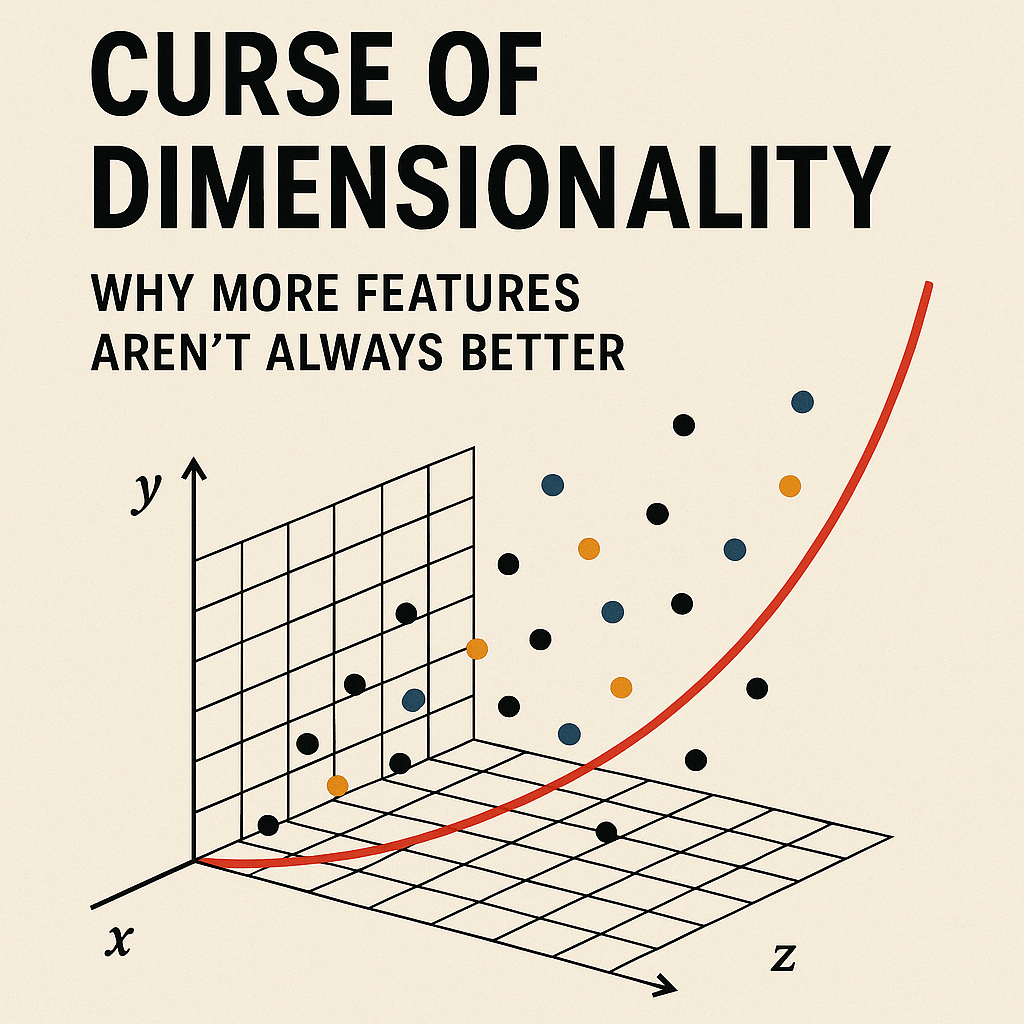

Curse of Dimensionality: Why More Features Aren’t Always Better, 출처: https://ai.plainenglish.io

1. 차원의 저주란?

특성 수(차원)가 증가할수록 데이터가 희박(sparse) 해지고 거리·밀도·통계 추정이 신뢰를 잃는 현상을 말한다. 필요한 표본 수가 차원에 지수적으로 늘어나 모델링이 어려워지는 문제가 핵심이다.

1-1. 차원의 저주가 발생하는 원인

- 부피 폭증: d차원 초입방체의 부피가 지수적으로 커져 같은 밀도를 유지하려면 표본이 기하급수적으로 필요해진다.

- 거리 집중: 최근접 거리와 최원 거리의 차이가 작아져(k-NN, 클러스터링 등) 유의미한 이웃 개념이 약화된다.

- 경계 비중 증가: 대부분의 점이 영역의 바깥/경계 근처로 밀려 밀도 추정·경계 추정이 불안정해진다.

- 특성 잡음 축적: 유용하지 않은 특성이 많아질수록 신호 대비 잡음 비가 나빠진다.

1-2. 차원의 저주가 미치는 영향

- 표본 복잡도↑: 같은 일반화 오차를 얻으려면 데이터가 폭증한다.

- 거리 기반 알고리즘 성능↓: k-NN, DBSCAN, RBF 커널, 최근접 검색 등이 약화된다.

- 과적합↑ / 해석성↓: 파라미터가 많아 분산 증가, 불안정한 결정경계가 생긴다.

- 시간·메모리 비용↑: 고차원 벡터 연산·탐색이 비싸진다(지수적 성능 저하).

1-3. 해결 방법

- 차원 축소: PCA, LDA, LLE, Isomap, t-SNE/UMAP(시각화), 오토인코더, 랜덤 프로젝션 등.

- 특성 선택: 필터(상관/MI/χ²), 래퍼(RFE), 임베디드(L1/Lasso, 트리 중요도).

- 정규화·규제: L1/L2, 드롭아웃(딥러닝), 조기 종료로 분산을 억제한다.

- 적절한 거리/스케일링: 표준화/로버스트 스케일, 코사인 거리 등 문제에 맞는 유사도 사용.

- 도메인 피처링 & 더 많은 데이터: 정보 밀도를 높여 신호 대비 잡음을 키운다.

2. 차원 축소

차원 축소는 일반화 향상(잡음 제거)과 학습·탐색 속도 개선, 시각화(2D/3D), 다중공선성 완화를 위해 필요하다.

2-1. 차원 축소 기법

- 선형·전역: PCA, Sparse PCA, LDA(지도), 랜덤 프로젝션(JL 보장), ICA.

- 비선형·매니폴드 학습: LLE, Isomap, Laplacian Eigenmaps, t-SNE/UMAP(주로 시각화).

- 신경망 기반: 오토인코더(비선형 압축).

- 지도/준지도: LDA, Supervised/Neighborhood Components Analysis 등.

3. 주성분 분석(PCA)란?

데이터 분산을 가장 잘 설명하는 직교 축(주성분) 을 찾아 선형 투영하는 비지도·선형 차원 축소 기법이다.

3-1. 주요 과정

1) 데이터 정규화: 모든 특성을 동일한 스케일로 조정한다.

2) 공분산 행렬 계산: 데이터의 분산과 상관관계를 계산한다.

3) 고유벡터와 고유값 계산: 공분산 행렬의 고유벡터와 고유값을 계산하여 주성분을 구한다.

4) 주성분 선택 및 변환: 가장 큰 고유값에 해당하는 고유벡터를 선택하여 데이터를 저차원으로 투영한다.

장점: 빠르고 잡음 제거에 효과적이다.

주의: 스케일·이상치에 민감, 선형 구조만 포착한다.

4. LLE(Local Linear Embedding)란?

데이터가 저차원 매니폴드 위에 놓여 있다는 가정하에, 각 점을 이웃의 선형 결합으로 재구성하는 가중치가 저차원 공간에서도 유지되게 만드는 비선형 차원 축소 기법이다.

4-1. 작동 원리

1) 각 데이터 포인트의 가까운 이웃(k-nearest neighbors)을 찾는다.

2) 각 데이터 포인트를 이웃 데이터 포인트의 선형 결합으로 표현한다.

3. 저차원 공간에서 같은 선형 관계를 유지하도록 데이터를 매핑한다.

국소 구조 보존에 강하지만, 노이즈/k 선택/연결성에 민감하고 스케일에 주의가 필요하다.

5. LDA(Linear Discriminant Analysis)란?

클래스 간 분리를 최대화하는 지도 학습용 선형 차원 축소 기법이다(분류 전처리로 자주 사용한다).

- LDA(Linear Discriminant Analysis)는 차원 축소 기법이면서 동시에 지도학습으로도 사용된다.

- LDA는 클래스 간의 분산을 최대화하고, 클래스 내 분산을 최소화하는 축을 찾아 데이터를 변환하는 방법이다.

- 분류 문제에서 효과적인 차원 축소 방법으로, 데이터가 선형적으로 구분될 수 있을 때 유용하다.

- 결과: 클래스 수가 CCC 일 때 최대 C−1C-1C−1 차원까지 유의미한 축을 얻는다.

장점: 분리도 향상·저차원화 동시 달성, 계산 효율적.

주의: 정규성/공분산 동질성 가정과 선형 분리 한계.

한 줄 요약

차원의 저주는 고차원에서 표본과 거리가 신뢰를 잃는 현상이며, 차원 축소·특성 선택·규제·스케일링 등으로 완화한다. PCA는 분산 최대의 선형 축으로 압축하고, LLE는 국소 선형성 보존으로 비선형 임베딩을 구하며, LDA는 클래스 분리를 극대화하는 지도형 선형 투영을 제공한다.