고윳값과 고유 벡터

선형대수학에서 선형 변환의 고유 벡터는 변환이 일어난 후에도 방향에 변화가 없는 벡터입니다. 변환이 일어난 후 벡터의 길이가 변하는 배수를 바로 그 고유 벡터에 대응하는 고윳값이라고 합니다.

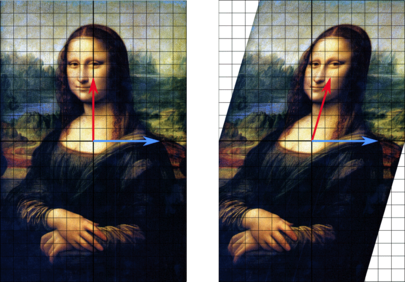

위의 그림의 경우 왼쪽의 원래 이미지가 선형 변환 후 오른쪽으로 변한 모습입니다. 여기서 수평축인 푸른 벡터는 그 방향이 변하지 않았기에 이 변환의 고유 벡터가 되는 것이고 크기는 변하지 않았으므로 고윳값은 1이 됩니다.

Av = λv 라는 아주 간단한 수식이 있을 때 v는 선형 변환 A의 고유 벡터가 되는 것이고 람다는 고유 벡터 v의 고윳값이 되는 것입니다.

Eigen 시리즈가 중요한 이유

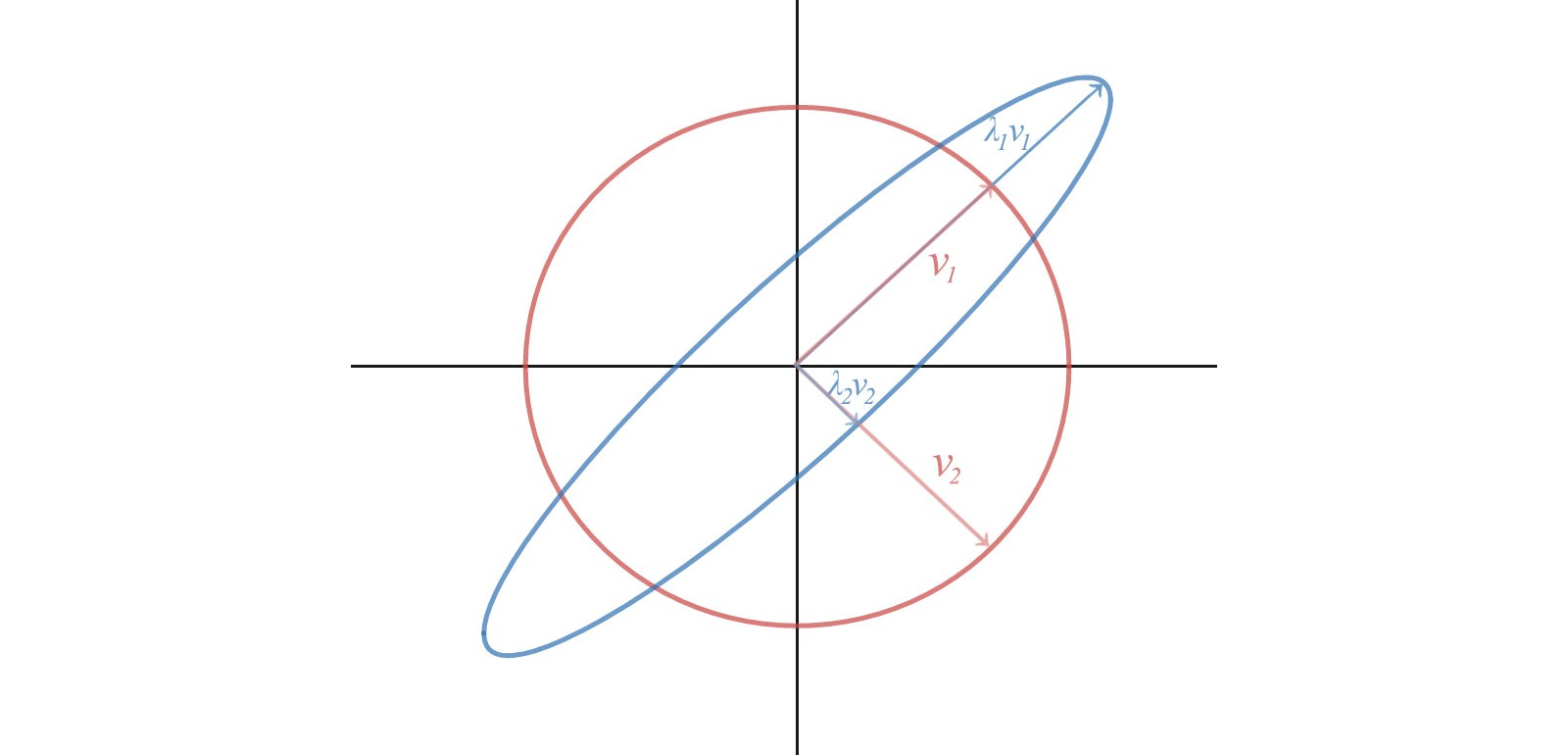

위 그림에서 빨간 원이 원본 원이고 파란 원이 변환된 원이라고 하자.

머신러닝에서 우리가 다루는 데이터는 파란 원이라고 할 수 있다.

만약 우리가 고양이를 인식하는 인공지능 모델을 만들고 싶다고 할 때 고양이 데이터가 많이 필요할 것이다. 하지만 데이터를 구하는데 공을 많이 들인다 해도 데이터는 필연적으로 어느정도 불완전하기 마련이다.

인공지능에서 지능이란 이러한 악조건 속에서도 정보의 주요 구성요소를 추출하는 능력을 기반으로 한다.

바로 여기서 고유 벡터와 교윳값이 중요한 역할을 할 수 있는데 고유 벡터는 데이터의 components를 식별하고 고윳값은 그 중요도를 정량화함으로써이런 데이터들을 수학적으로 식별하는 방법을 제공한다.

Reference

https://jonathan-hui.medium.com/machine-learning-linear-algebra-eigenvalue-and-eigenvector-f8d0493564c9

https://ko.wikipedia.org/wiki/%EA%B3%A0%EC%9C%B3%EA%B0%92%EA%B3%BC_%EA%B3%A0%EC%9C%A0_%EB%B2%A1%ED%84%B0