요소

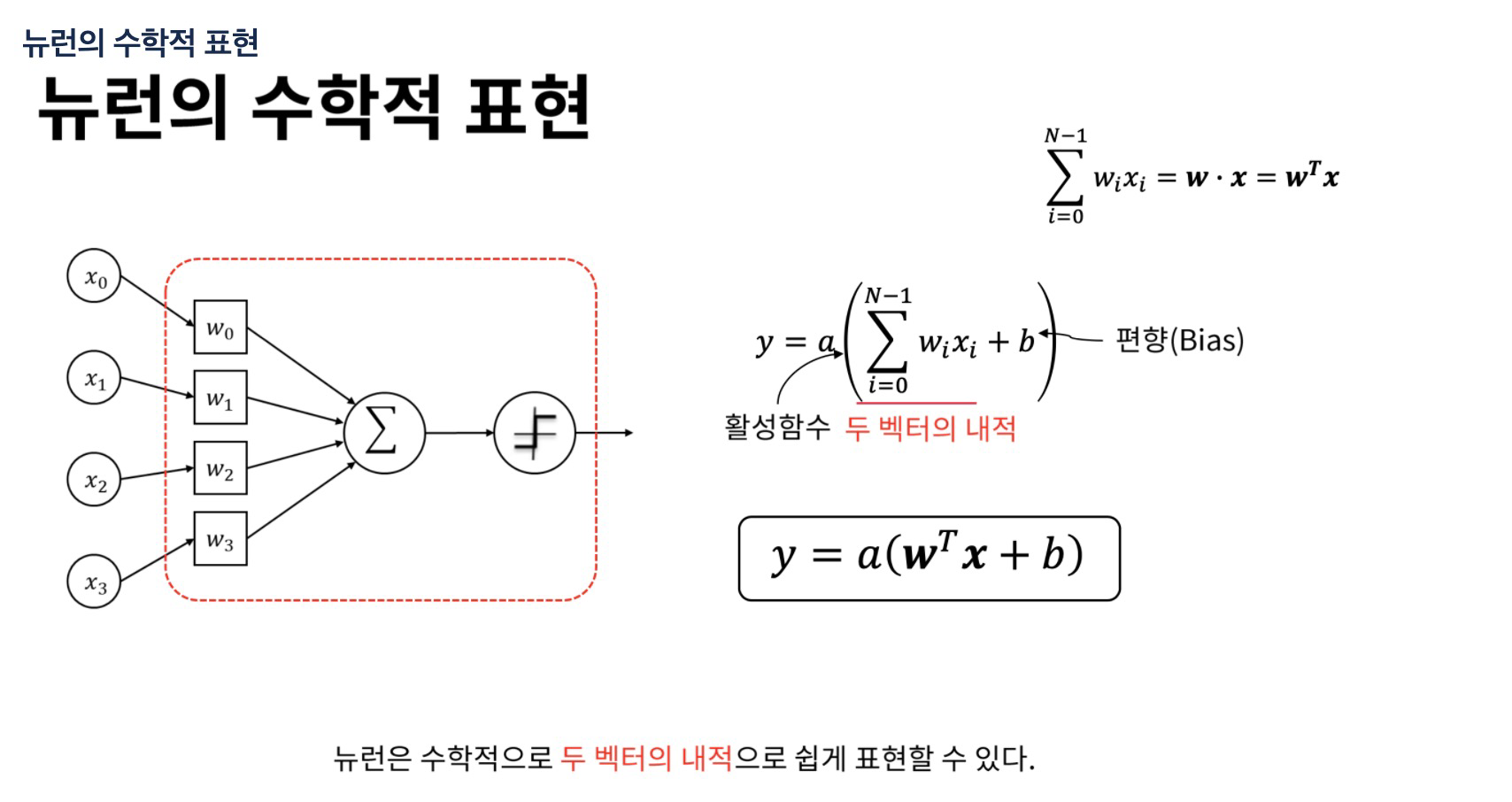

1. 뉴런의 수학적 표현

- 내적: 같은 위치에 있는 요소끼리 곱한 값들의 합

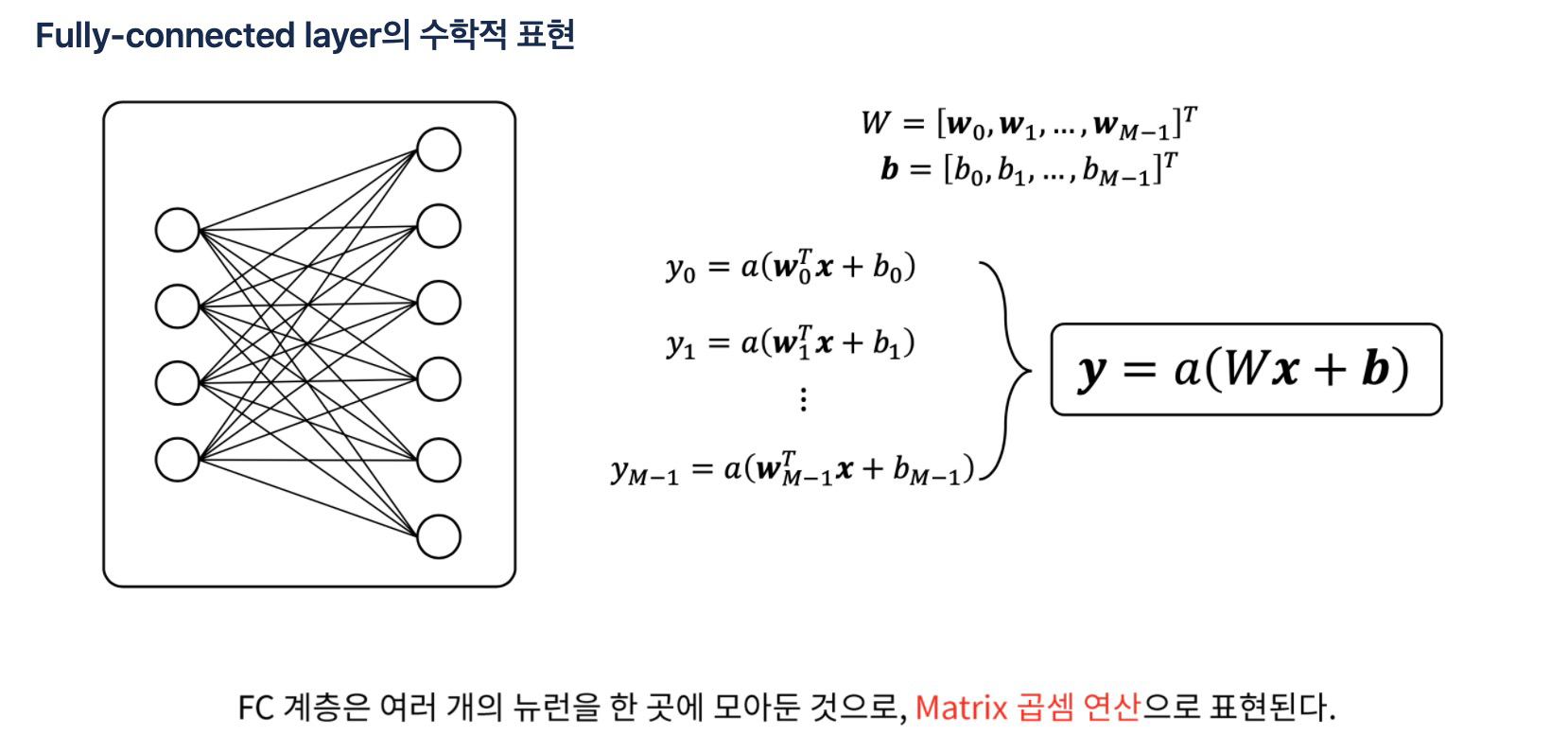

2. Fully-connected layer 수학적 표현

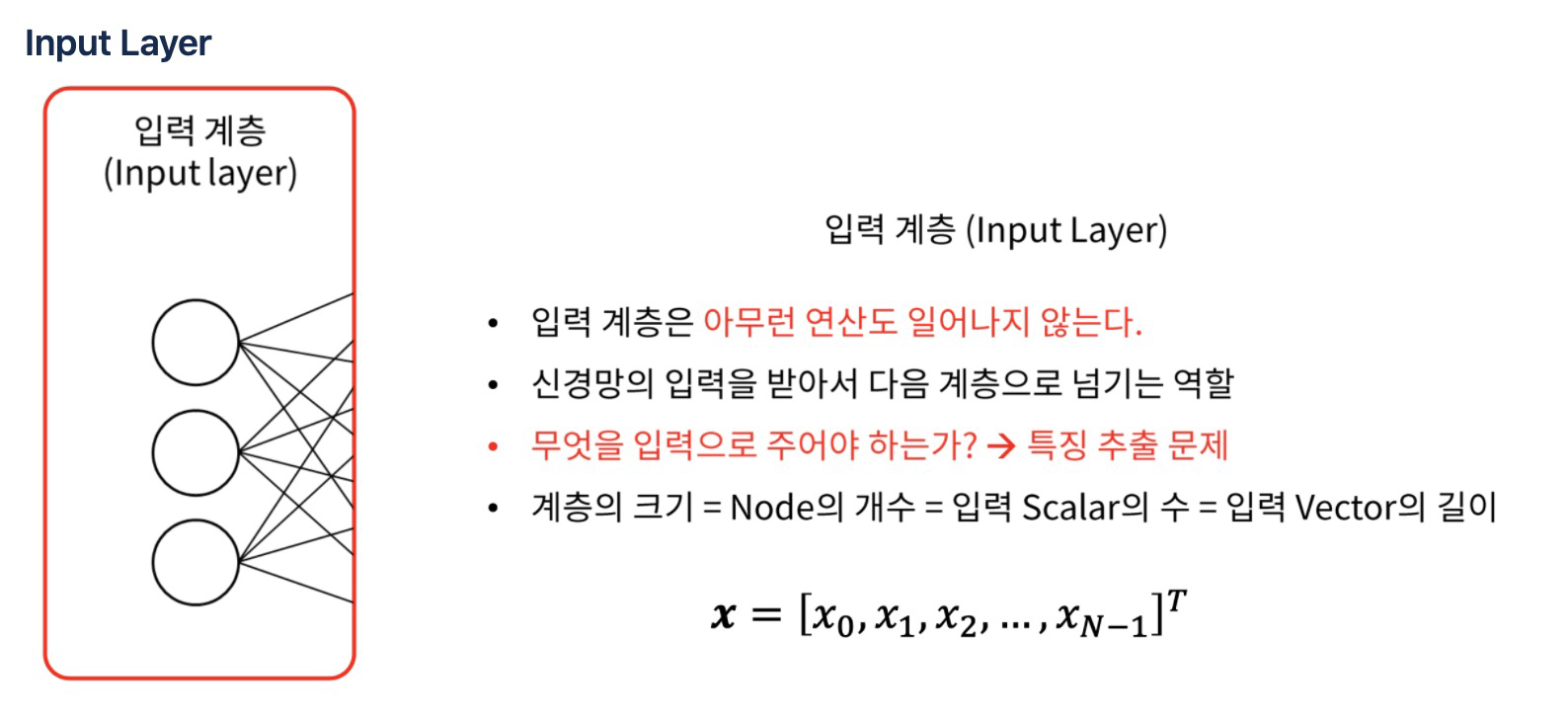

3. Input Layer 수학적 표현

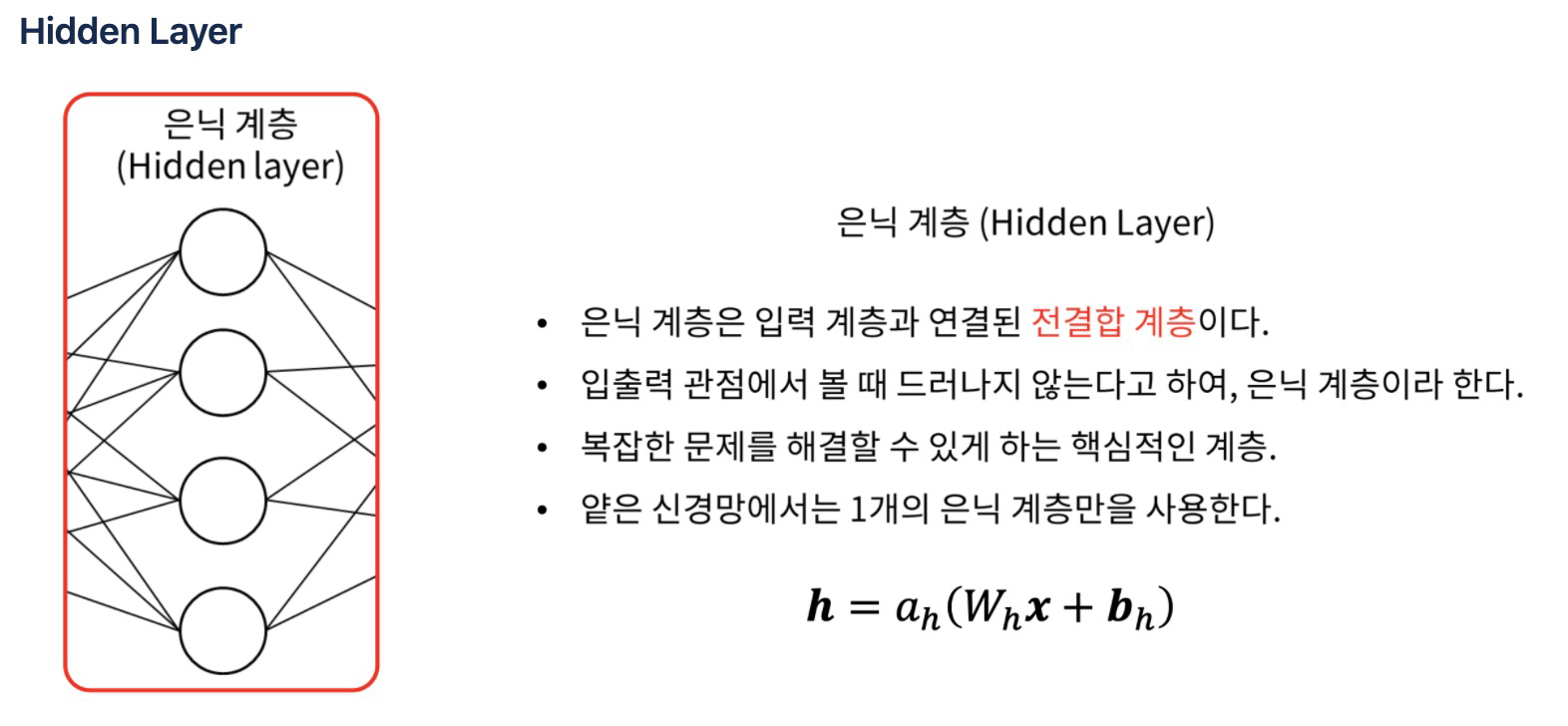

4. Hidden Layer 수학적 표현

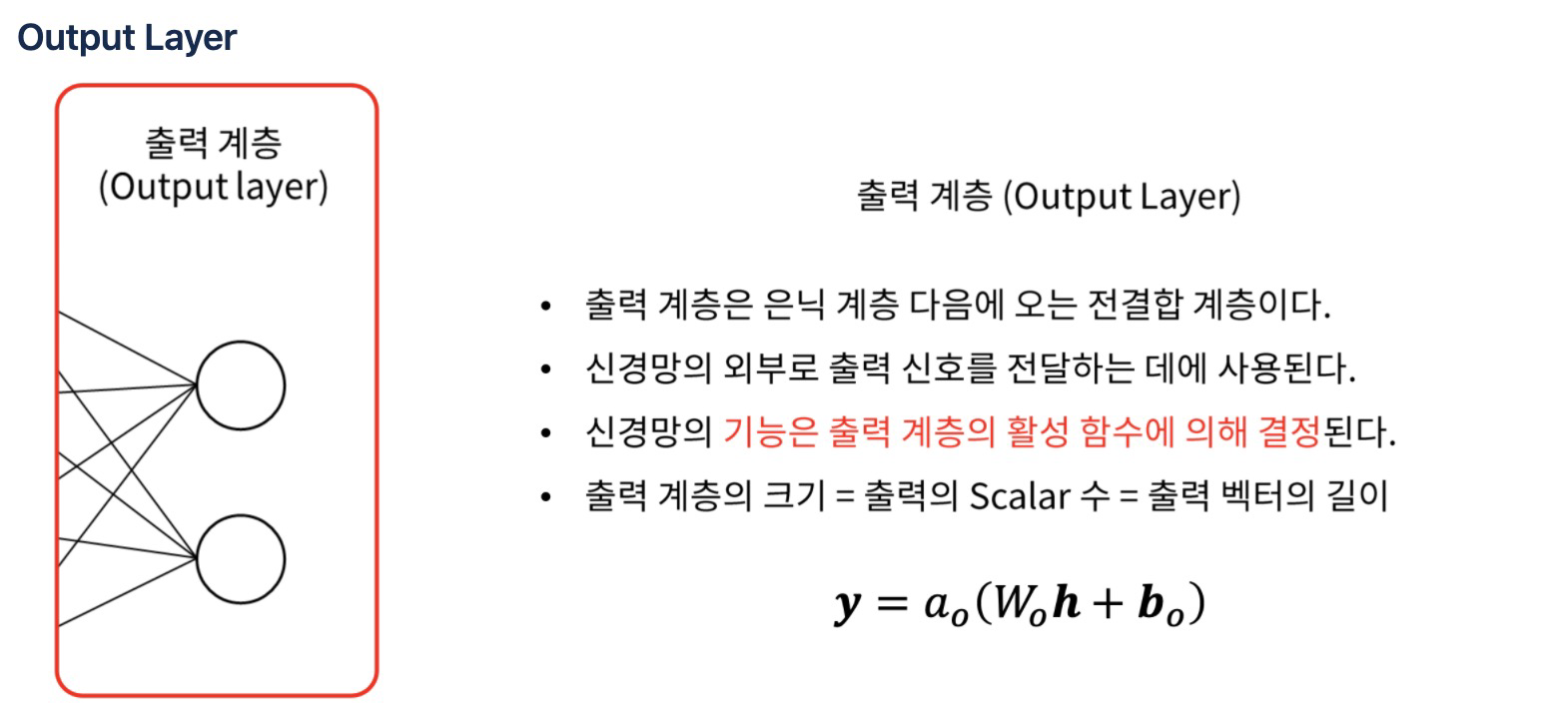

5. Output Layer 수학적 표현

회귀

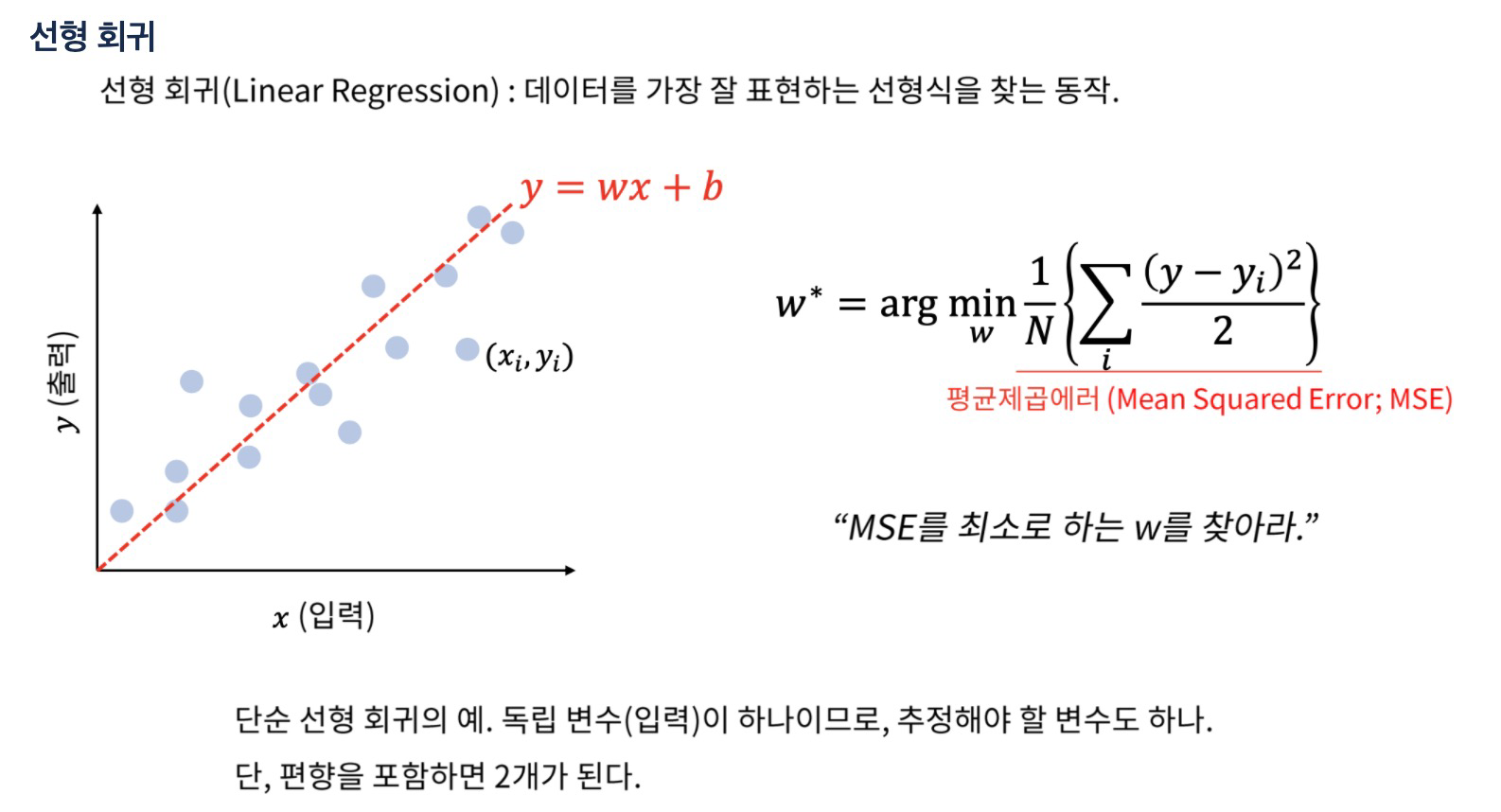

1. 선형 회귀

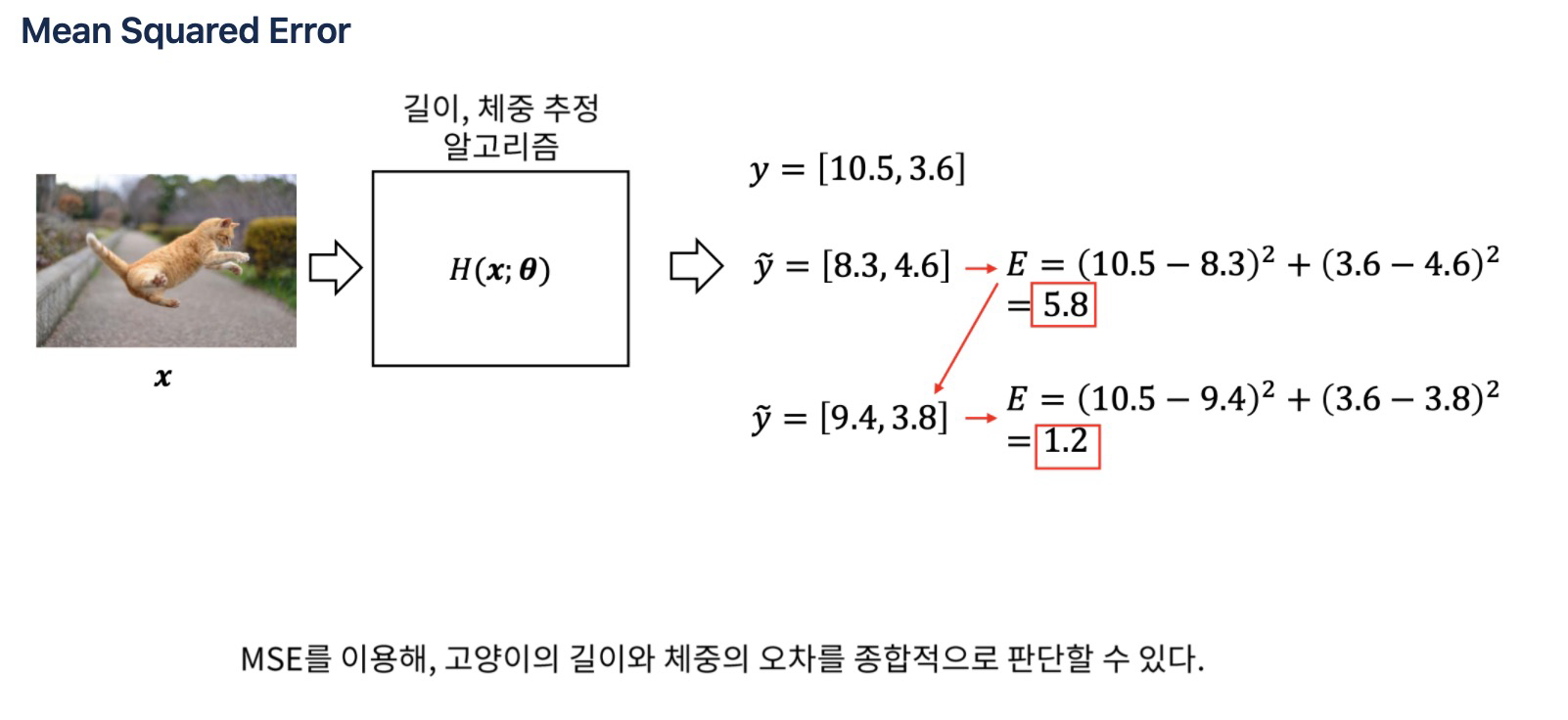

Mean Squared Error

- 모델별로 상대적으로 작아지는 것을 선택하는 것이 중요

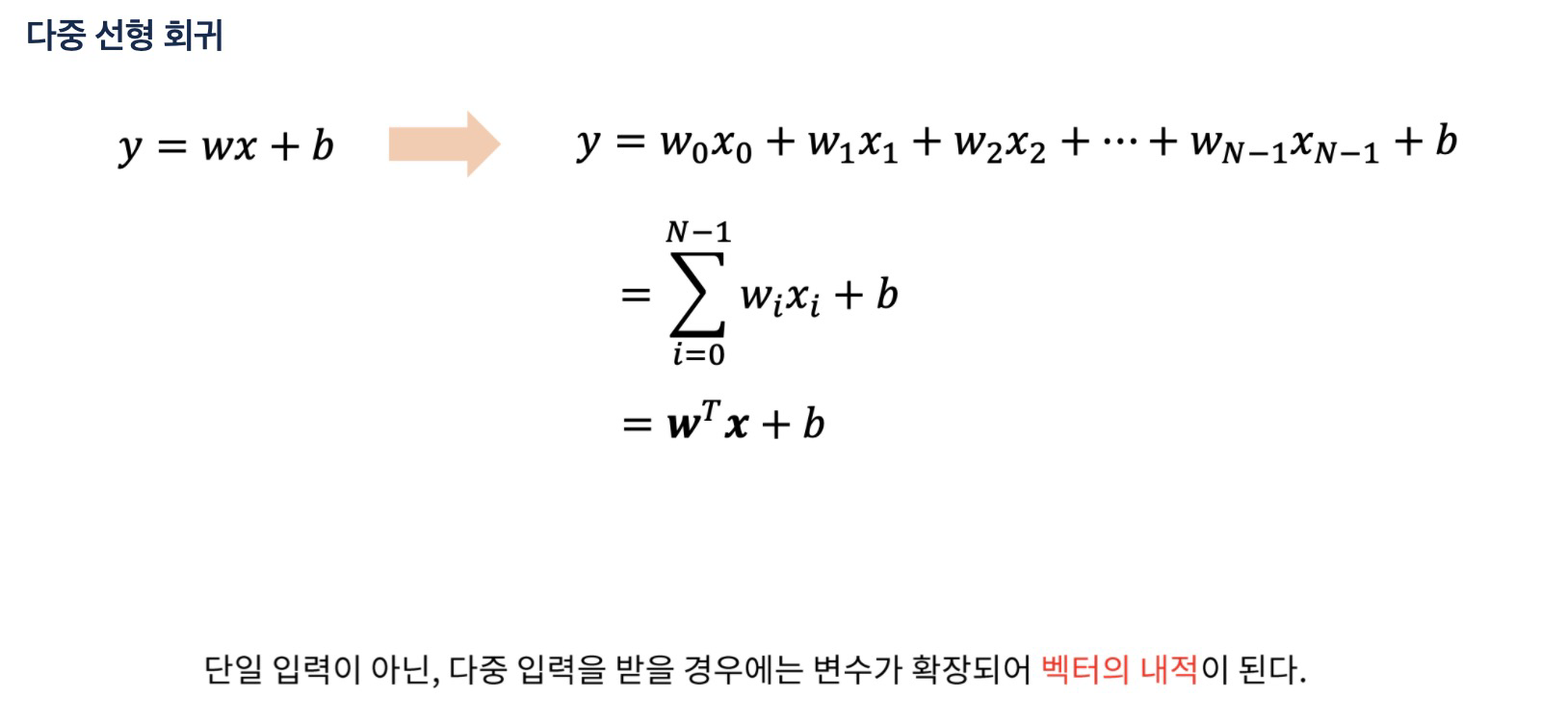

2. 다중 선형 회귀

- 변수가 하나 추가될 때마다 차원이 하나씩 추가 (직선 → 평면 → 초평면)

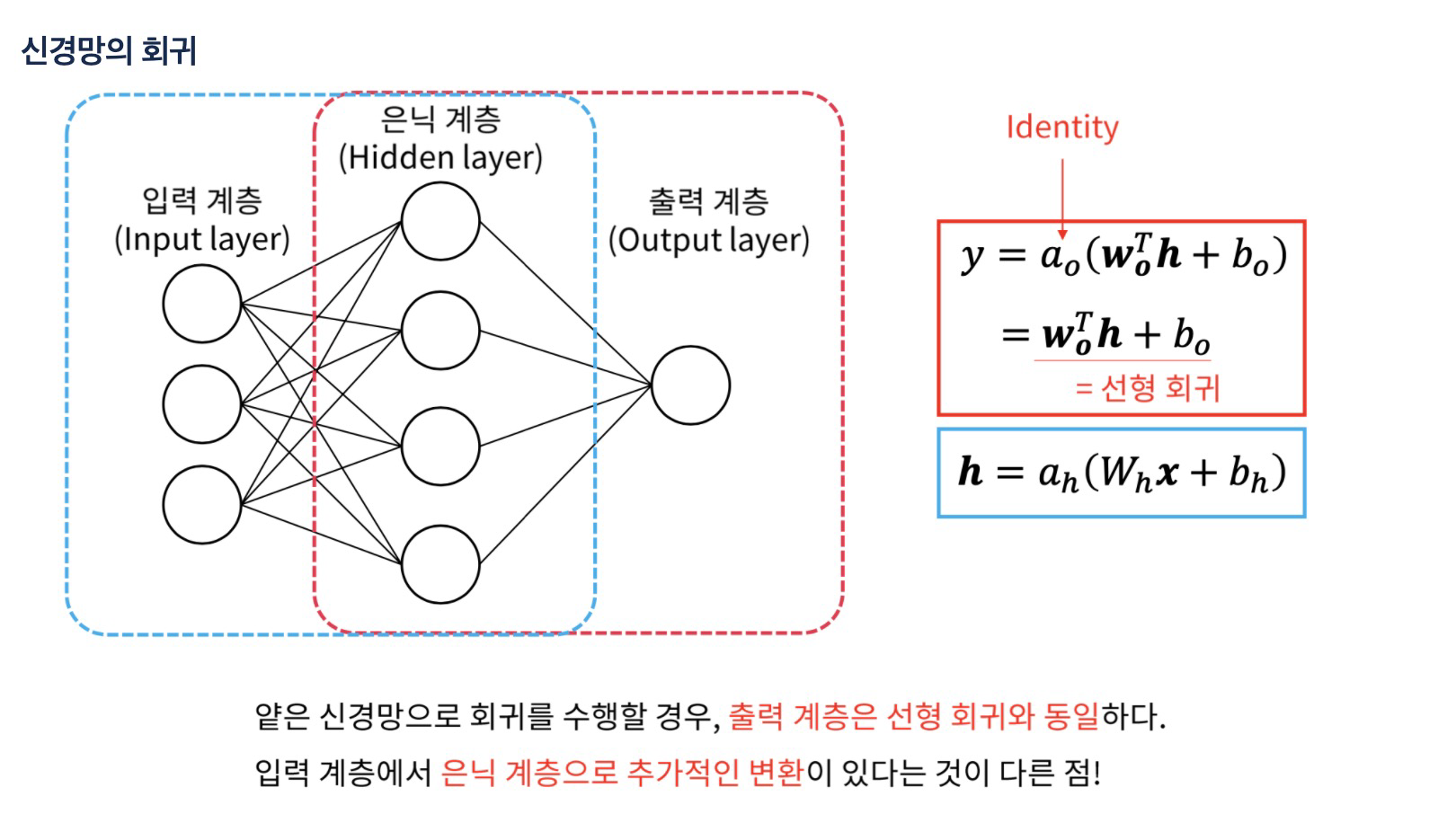

3. 신경망 회귀

- 은닉층의 효과: 선형적으로 분포되지 않는 입력이 선형적으로 분포하는 은닉계층(특징)을 만나면 선형 회귀 입력 Space를 기준으로 보면 회귀 곡선이 된다.

분류

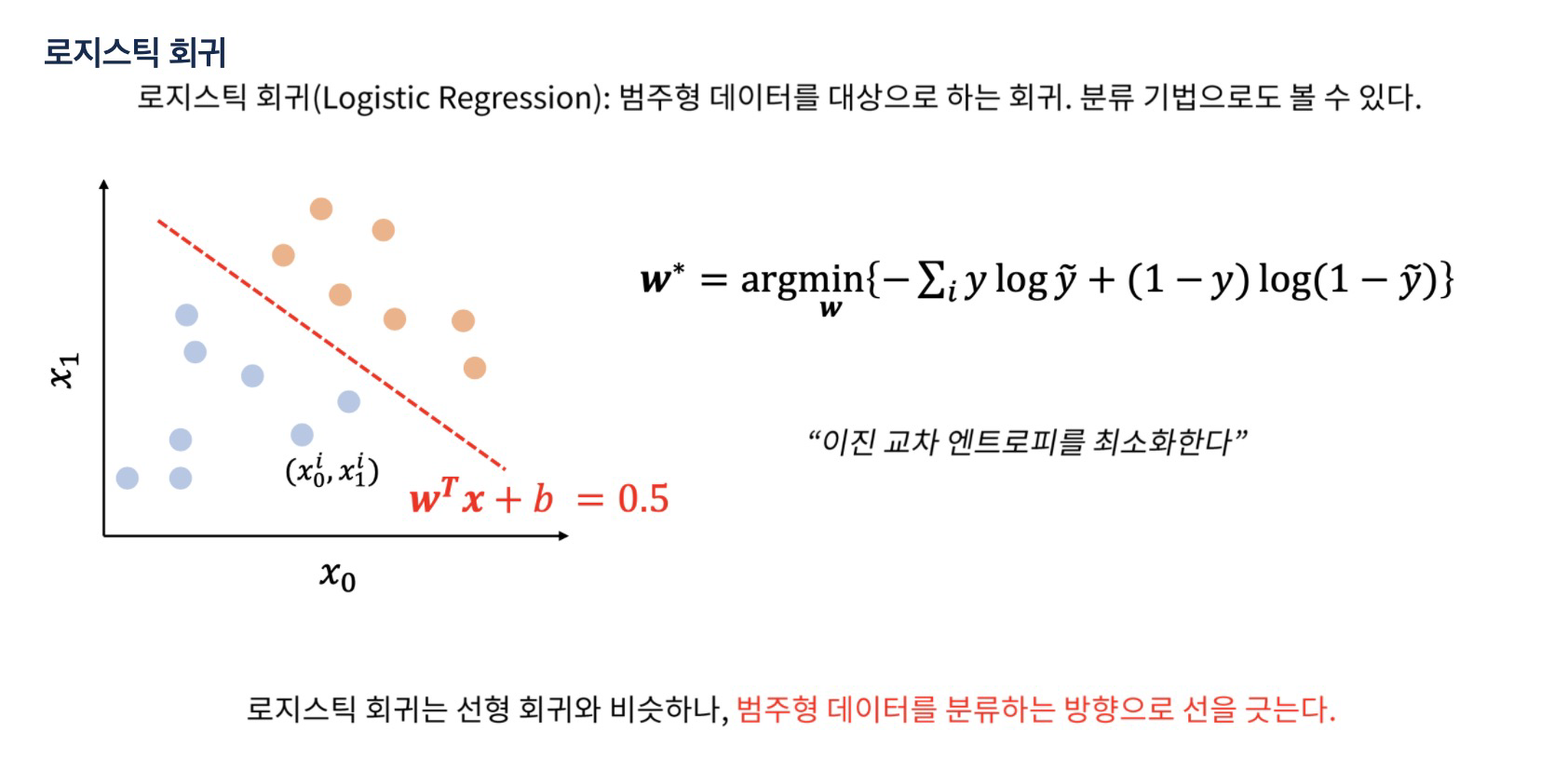

1. 로지스틱 회귀

- 변수가 하나 추가될 때마다 차원이 하나씩 추가 (직선 → 평면 → 초평면)

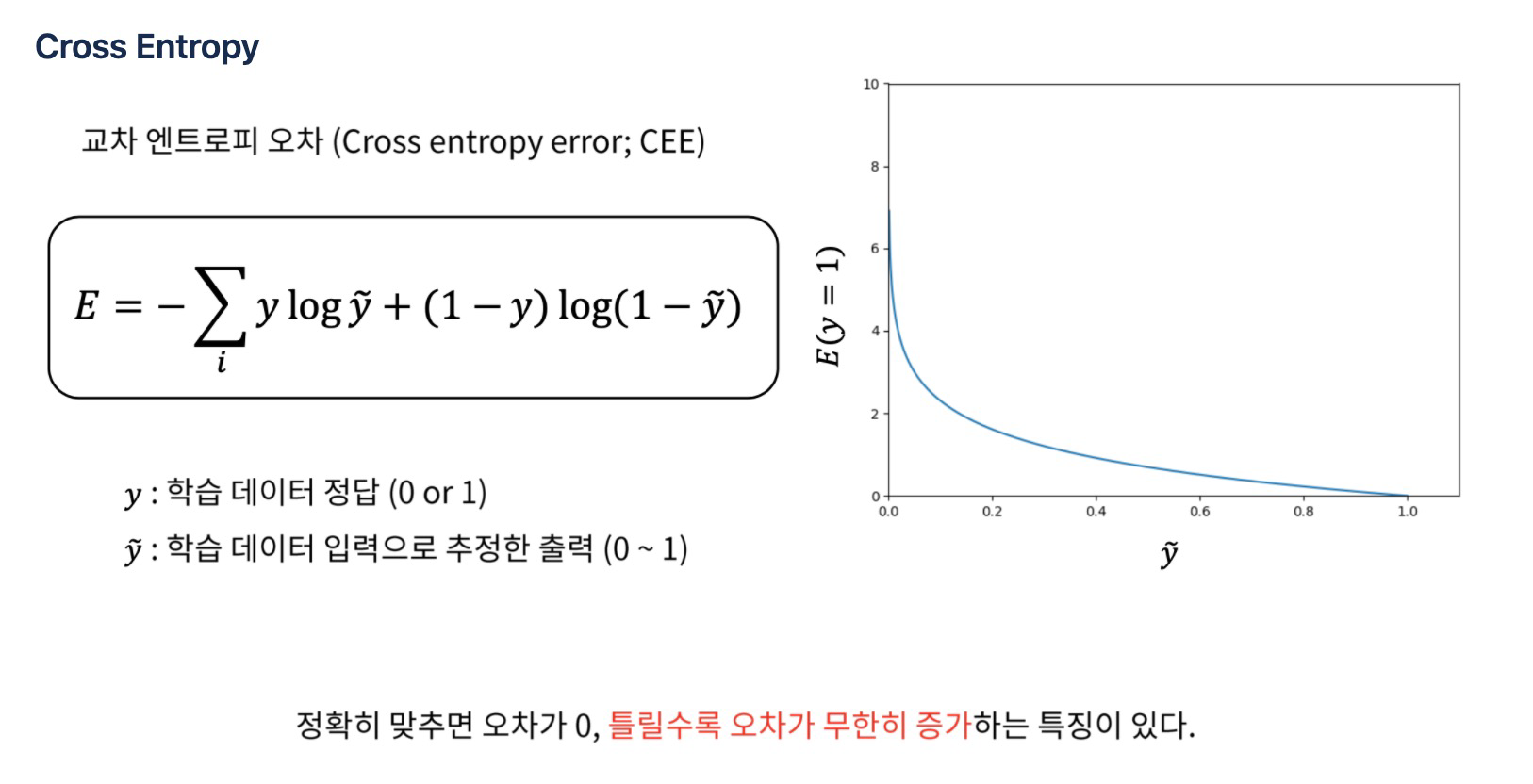

cross entropy

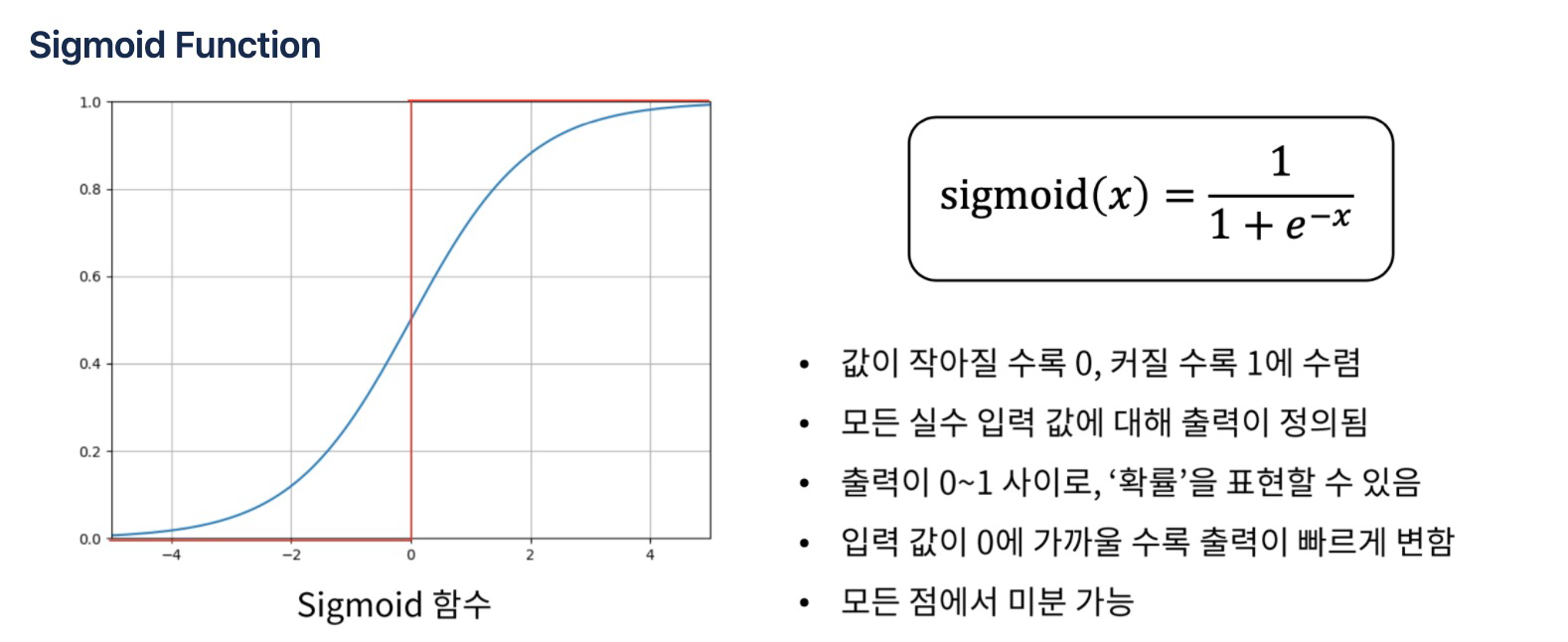

2. sigmoid function

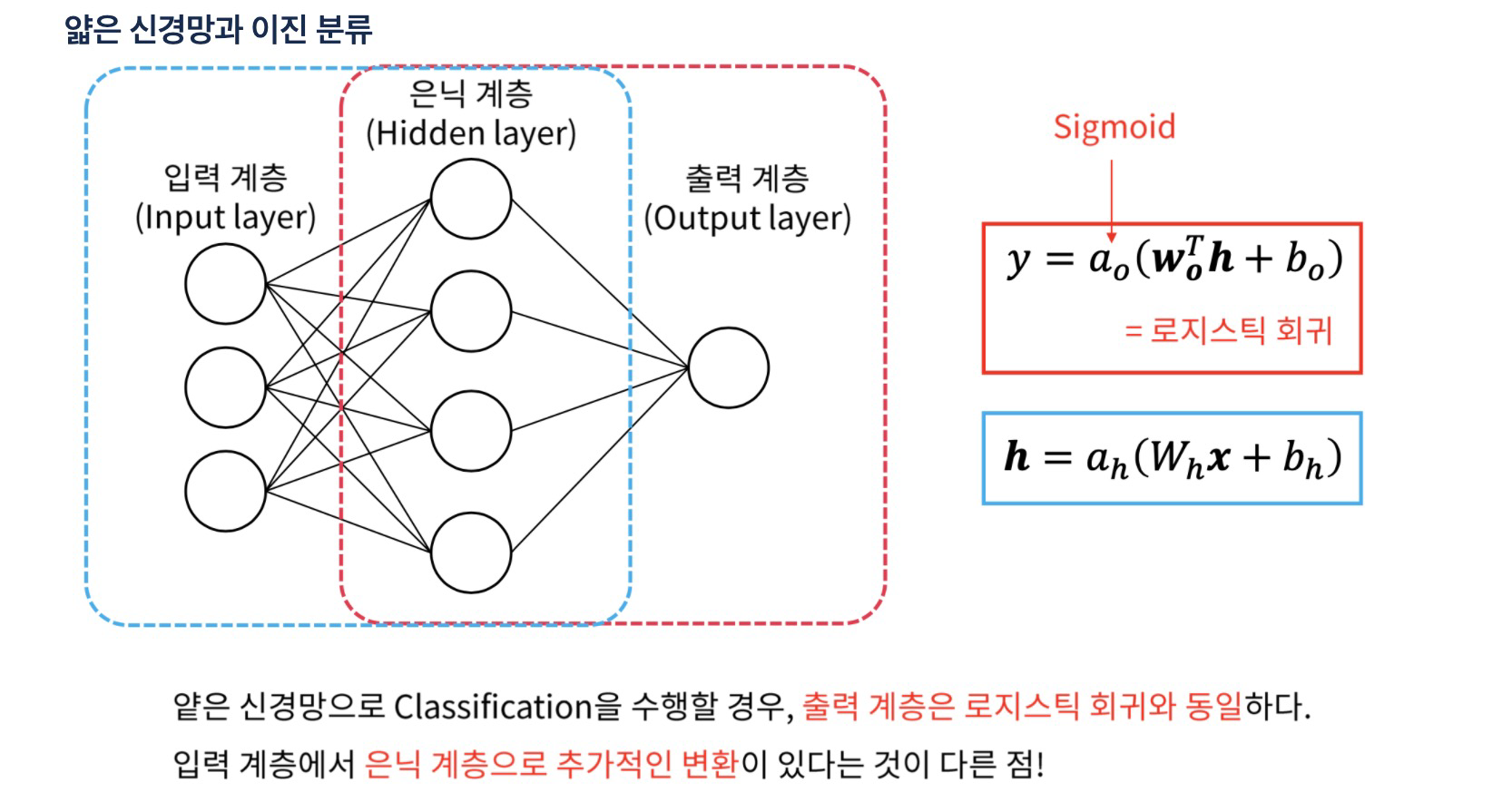

3. 얇은 신경망과 분류

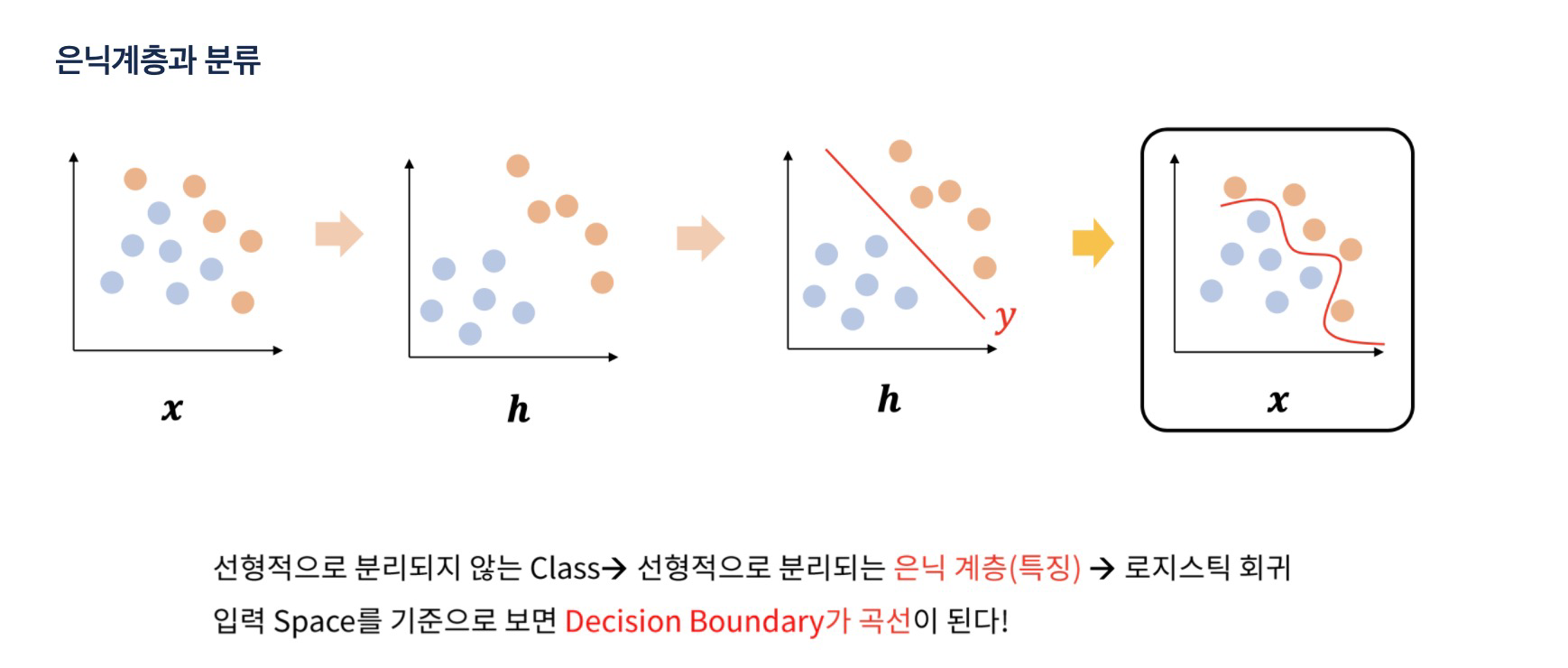

은닉계층과 분류

Reference

1) 제로베이스 데이터스쿨 강의자료