앙상블 기법이란?

여러개의 약한 분류기를 결합하여 강한 분류기를 만들어서 예측하는 방법

앙상블 기법의 종류

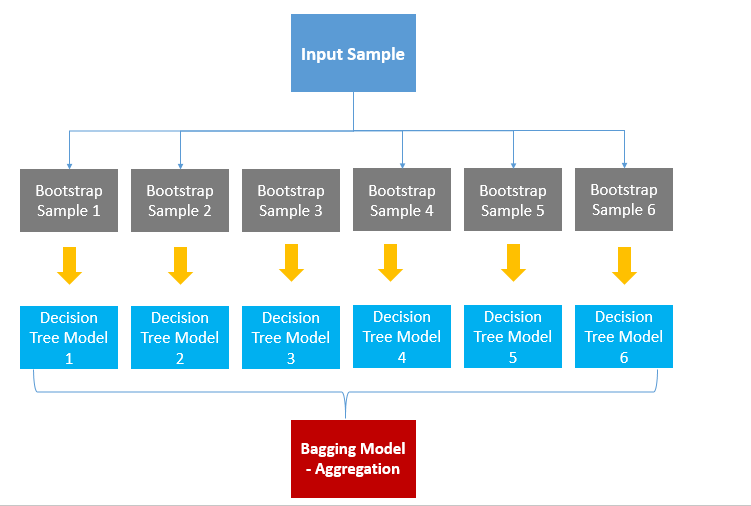

배깅 (bagging)

Bootstrap Aggregation의 약자로 샘플을 여러번 뽑아(비복원 추출) 각 모델을 학습시켜 결과물을 집계하는 방법

범주형 데이터는 투표 방식(Voting)으로 결과를 집계하고, 수치형 데이터는 평균으로 집계

배깅을 사용한 예로는 랜덤 포레스트가 있다.

랜덤 포레스트의 각 트리는 서로 독립적인 결과를 예측

예측한 결과값을 집계하여 최종결과를 예측하는 방식

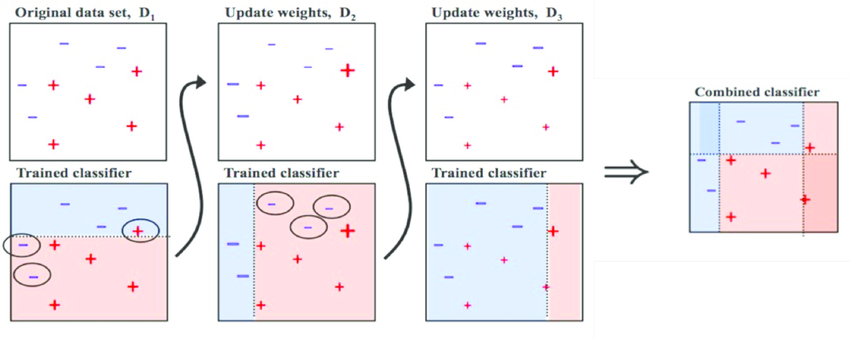

부스팅 (boosting)

가중치를 활용하여 약한 분류기를 강한 분류기로 만드는 방법

부스팅의 순서

첫 모델 예측 -> 예측결과에 따른 가중치 부여 -> 부여된 가중치로 모델 생성

잘못 분류된 데이터에 집중하여 새로운 분류규칙을 만드는 단계를 반복

배깅과 부스팅의 차이점

-

배깅

1) 병렬 학습

2) 부스팅에 비해 속도가 빠름

3) 부스팅에 비해 성능은 떨어짐 -

부스팅

1) 순차적 학습

2) 배깅에 비해 성능이 뛰어남

3) 배깅에 비해 속도가 느림

4) 오버피팅 가능성이 있음

참고 : 귀퉁이 서재님의 tistory