[MicrosoftDataSchool] 57일차 - AzureDatabricks 추천 시스템(ALS), DeltaLake Table System, Pipeline

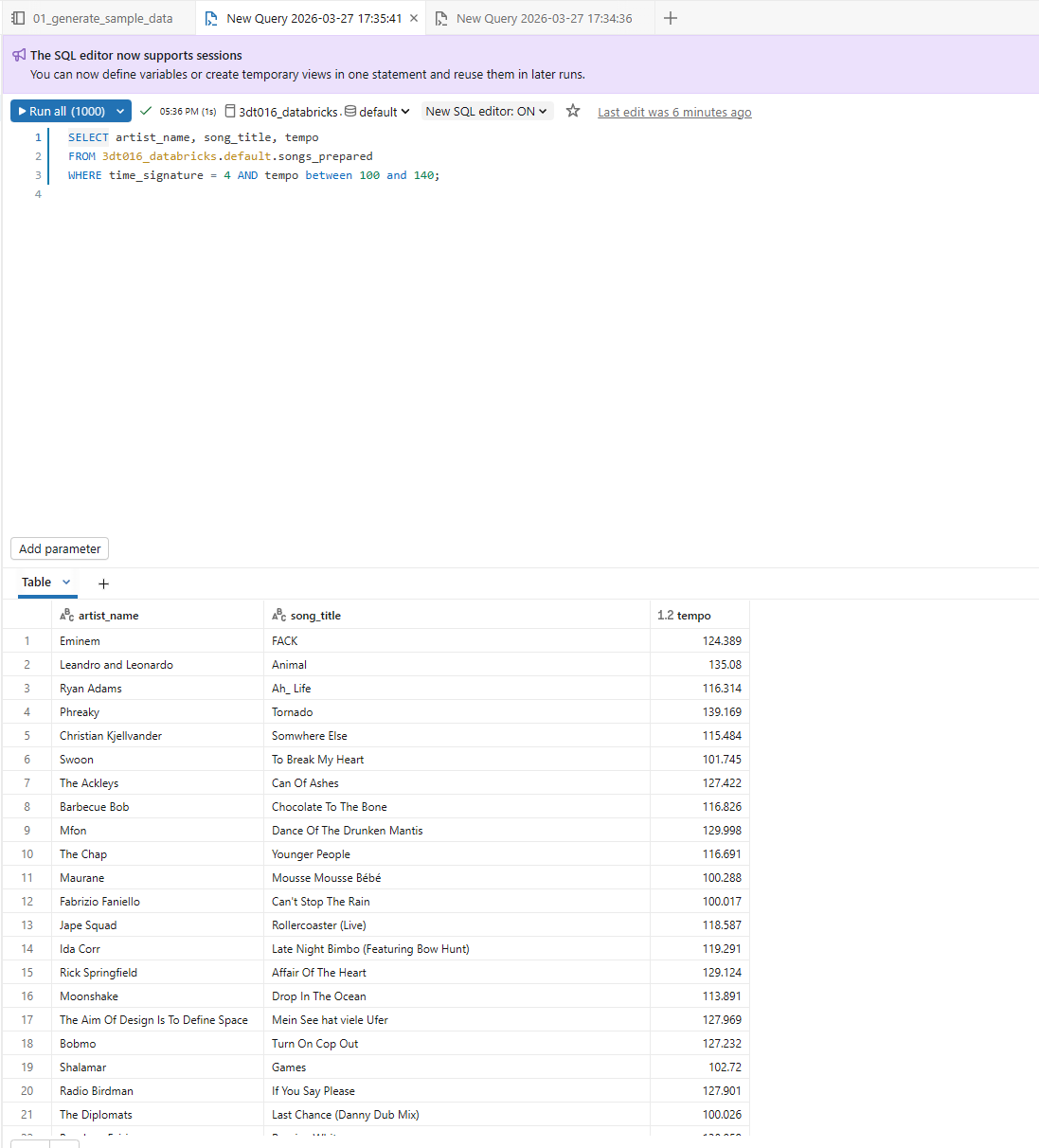

Microsoft Data School 3기

추천 시스템

사용자의 행동 패턴과 아이템의 특성을 분석하여 개인 맞춤형 컨텐츠를 제공하는 인공지능 기술

| 협업 필터링 | 콘텐츠 기반 필터링 |

|---|---|

| 비슷한 취향을 가진 사용자들의 집단 행동 패턴을 분석합니다 | 아이템 자체의 특성과 메타데이터를 분석합니다 |

| 사용자 간 유사도 계산 | 장르, 키워드 매칭 |

| 평점 기반 예측 | 아이템 속성 분석 |

| 집단 지성 활용 | 프로필 기반 추천 |

유저 기반 협업 필터링 (User-based CF)

01. 유사 사용자 탐색

코사인 유사도, 피어슨 상관계수 등을 통해 비슷한 평점 패턴을 가진 사용자 그룹을 탐색

02. 이웃 선정

유사도가 높은 상위 K명의 사용자(이웃)를 선택하여 추천 기반을 구성

03. 평점 예측

이웃 사용자들의 평점을 가중 평균하여 대상 아이템에 대한 예측 점수를 계산

주의

대규모 유저 대상에서는 실시간 계산 비용이 증가하며,

희소 데이터(sparsity) 문제로 인해 정확도가 낮아질 수 있음

아이템 기반 협업 필터링 (Item-based CF)

작동 원리

사용자가 좋아한 아이템과 유사한 다른 아이템을 찾아 추천

아이템 간 유사도는 코사인 유사도 등을 활용해 측정

아마존의 “이 상품을 구매한 고객이 함께 본 상품” 기능의 기반이 되는 방식

핵심 장점

- 아이템 유사도는 시간에 따라 상대적으로 안정적

- 오프라인에서 미리 계산 가능

- 확장성이 뛰어남

중요: 유사도를 0~1 사이의 값으로 만들기

콜드스타트: 협업 필터링의 한계

- 신규 유저나 신규 아이템에 대한 충분한 상호작용 데이터가 부족하여 정확한 추천이 어려운 상황을 의미

- 초기 사용자 이탈률과 직결됨

원인

- 서비스 초기 단계에서 유저 수와 인터랙션 데이터가 절대적으로 부족한 상황

- 신상품 출시 직후 사용자들의 평가나 구매 기록이 전혀 없는 상태

- 신규 가입자의 과거 행동 기록이 없어 취향을 파악할 수 없는 문제

해결법

1. 하이브리드 추천 시스템

콘텐츠 기반의 신규 유저/아이템 메타데이터 활용

+

협업 필터링의 기존 유저/아이템에 집단 지성 활용2. 프로필 완성

- 명시적 데이터 수집: 가입 시 선호 장르, 관심사에 대한 질문지 제공

- 소셜 연동: 페이스북, 구글 계정 연동으로 기본 정보 획득

- 암묵적 피드백: 초기 클릭, 체류시간 등 행동 데이터 실시간 수집

모델 기반 협업 필터링

행렬 분해(Matrix Factorization)

희소한 사용자-아이템 평점 행렬을 저차원의 잠재 공간(latent space)로 분해나는 기법

사용자와 아이템을 각각 K차원의 벡터로 표현하여, 내적으로 평점을 예측

잠재 요인(latent factors)을 통해 명시적으로 드러나지 않는 사용자 취향과 아이템 특성을 학습

분포가 적절한 면을 따서 잘 펼쳐서 사용(차원 줄이고 계산량 줄이고)

| 구분 | 내용 |

|---|---|

| 장점 | - 희소 데이터 처리 능력 우수 - 확장성이 뛰어나 대규모 서비스에 적합 - 과적합 방지 가능 - 오프라인 학습 후 빠른 추론 |

| 단점 | - 모델 학습이 복잡하고 시간 소요 - 결과 해석이 어려움 - 하이퍼파라미터 튜닝 필요 - 신규 데이터 반영에 시간 지연 |

강화학습과 밴딧 알고리즘으로 추천 혁신

추천 문제와 밴딧 알고리즘

- 탐색: 새로운 아이템을 시도하여 더 나은 선택지를 발견하는 과정

- 활용: 현재까지 알려진 최선의 선택을 반복하여 즉각적인 보상 극대화

다중 슬롯머신 문제(Multi-Armed Bandit)

여러 선택지 중에서 시행착오를 통해 최적의 보상을 찾아가는 강화학습 프레임워크

추천 시스템은 본질적으로 탐색과 활용의 균형을 맞춰야 하는 밴딧 문제로 모델링 가능

적용 사례

- 실시간 추천 조정: 사용자 즉각적인 반응(클릭, 시청시간)을 학습하여 다음 추천을 동적으로 최적화

- 광고 클릭률 최적화: 광고 소재 중 클릭률이 높은 것을 빠르게 찾아내 노출 비중을 조절

- 뉴스 기사 추천: 빠르게 변하는 트렌드에 맞춰 인기 기사를 실시간으로 발굴하고 추천

밴딧 알고리즘 종류

| 방법 | 설명 |

|---|---|

| ε-그리디 | ε 확률로 무작위 탐색, 1-ε 확률로 최선 선택 |

| UCB | 불확실성이 큰 선택지에 보너스를 부여하여 탐색 |

| Thompson Sampling | 베이지안 확률 분포에서 샘플링하여 선택 |

성공적인 추천 시스템을 위한 핵심 포인트

데이터 품질과 양 확보

- 충분한 양의 고품질 인터랙션 데이터 확보해야 함

- 노이즈 제거 및 데이터 정제 필수

- 데이터 편향 최소화 고려해야 함

콜드스타트 대비 설계

- 신규 사용자/아이템 대응 전략 필요

- 하이브리드 추천 방식 적용 고려해야 함

- 인기 기반 + 프로필 기반 추천 병행해야 함

사용자 피드백 루프

- 클릭, 체류시간, 구매 등 암묵적 피드백 활용해야 함

- A/B 테스트 기반으로 지속적 개선 필요

- 사용자 행동 데이터 계속 축적해야 함

확장성과 실시간 처리

- 대규모 트래픽 대응 위한 분산 처리 필요

- 캐싱 전략으로 응답 속도 최적화해야 함

- 실시간 업데이트와 배치 학습 간 균형 맞춰야 함

프라이버시 보호와 추천 시스템

- 연합 학습(Federated Learning)

사용자 기기에서 로컬로 모델을 학습하고, 중앙 서버는 모델 파라미터만 수집하여 개인 데이터를 보호 - 차등 프라이버시

통계적 노이즈를 추가하여 개별 사용자 정보를 보호하면서도 전체 패턴은 학습 가능 - 익명화 기술

개인 식별 정보를 제거하거나 암호화하여 프라이버시를 지키면서 추천 품질을 유지

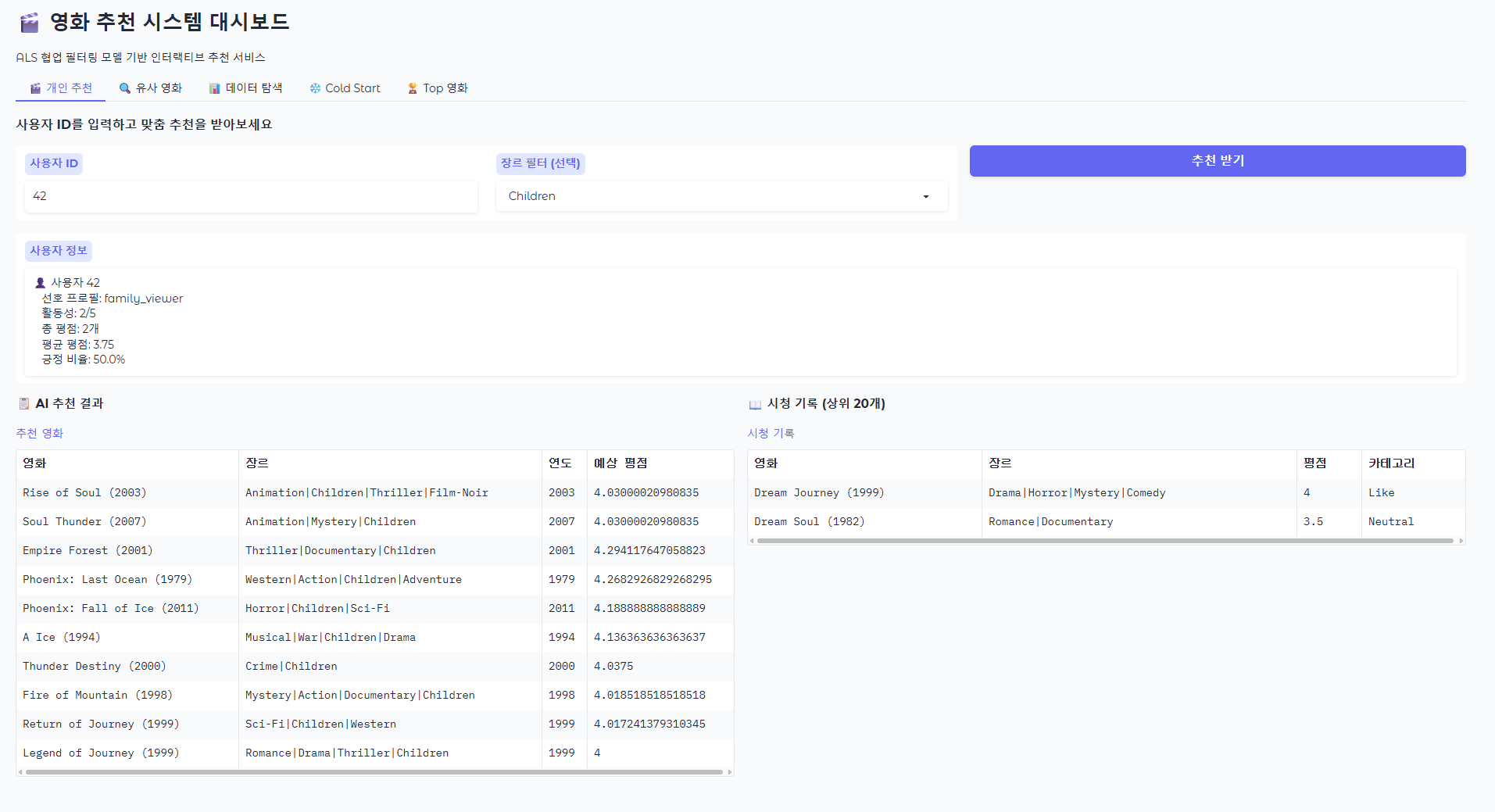

ALS 영화 추천 시스템 실습

Databricks 메달리온 아키텍처 + Spark MLlib + MLflow

협업 필터링 기반 영화 추천 시스템 구축 실습

Velog에 업로드하기 좋게 Databricks와 Spark MLlib을 활용한 ALS 영화 추천 시스템 구축 실습 내용을 마크다운 형식으로 정리해 드립니다.

[실습] Databricks & Spark MLlib을 활용한 ALS 영화 추천 시스템 구축

1. 실습 개요

- 기술 스택: Databricks, Spark MLlib, MLflow, Gradio

- 아키텍처: 메달리온 아키텍처 (Bronze → Silver → Gold)

- 핵심 알고리즘: ALS (Alternating Least Squares) 협업 필터링

- 데이터 규모: 영화 500개, 사용자 1,000명, 평점 약 10,000건 (희소성 약 98%)

2. 데이터 파이프라인 및 단계별 실습 내용

Step 1: 샘플 데이터 생성 (Bronze Layer)

실제 추천 시스템과 유사한 희소성(Sparsity)을 가진 가상의 영화, 사용자, 평점 데이터를 생성하여 Delta 테이블에 저장합니다.

- 주요 작업: 현실적인 평점 패턴(영화 품질 + 사용자 성향 + 노이즈)을 반영한 데이터 생성.

- 결과: 원시 데이터 형태의

bronze_movies,bronze_users,bronze_ratings테이블 생성.

Step 2: 데이터 정제 및 피처 엔지니어링 (Silver Layer)

Bronze 데이터를 ML 모델 훈련에 적합한 형태로 변환합니다.

- 주요 변환: 장르 배열화, 연령대 인코딩, 태그 정규화 등.

- 핵심 개념 - 베이지안 평균(Bayesian Average): 평점 수가 적은 영화의 평점이 왜곡되는 것을 방지하기 위해 전체 평균과 최소 신뢰 샘플 수를 활용해 보정합니다.

- 공식:

Step 3: 모델 훈련 및 실험 추적 (Gold Layer & ML)

비즈니스 집계 데이터를 생성하고 ALS 모델을 최적화합니다.

- ALS 알고리즘: 사용자-영화 행렬을 잠재 요인(Latent Factor)으로 분해하여 누락된 평점을 예측합니다.

- MLflow 연동: 그리드 서치를 통해

rank,regParam등의 하이퍼파라미터 조합을 실험하고, 모든 결과는 MLflow UI에 자동으로 기록 및 추적됩니다.

Step 4: 추천 서비스 구현

훈련된 모델을 활용하여 실제 추천 시나리오를 구성합니다.

- 추천 시나리오: 기존 사용자 추천, 장르 기반 추천, 유사 영화 탐색.

- Cold Start 문제 해결: 평점 기록이 없는 신규 사용자를 위해 베이지안 평균 기반의 인기 영화를 추천하는 폴백(Fallback) 전략을 사용합니다.

Step 5: Gradio 인터랙티브 대시보드

사용자가 직접 추천 결과를 확인할 수 있는 웹 UI를 구축합니다.

- 주요 기능: 개인화 추천 ID 입력, 영화 제목 검색을 통한 유사 영화 탐색, 데이터 시각화 차트 등.

3. 핵심 개념 요약

| 용어 | 설명 |

|---|---|

| 메달리온 아키텍처 | Bronze(원시) → Silver(정제) → Gold(집계) 순의 데이터 구조 |

| ALS | 협업 필터링을 위한 행렬 분해 알고리즘 |

| Cold Start | 신규 사용자/영화의 데이터 부족으로 인한 추천의 어려움 |

| RMSE | 예측 오차를 평가하는 지표 (낮을수록 정확함) |

| MLflow | 머신러닝 실험 추적 및 모델 버전 관리 도구 |

4. 실습 후기 및 확장 과제

이번 실습을 통해 데이터 엔지니어링(메달리온 아키텍처)부터 모델 서빙(Gradio)까지의 전체 파이프라인을 경험할 수 있었습니다. 향후에는 다음과 같은 주제로 확장이 가능합니다.

- Model Serving: REST API로 모델 배포

- Feature Store: Databricks Feature Store 연동

- Real-time: 실시간 스트리밍 데이터를 활용한 추천 반영

**콘텐츠 기반 필터링 결합**: 영화 메타데이터 기반 추천과 ALS 결합

샘플 영화 데이터 생성

영화 추천 시스템 실습을 위한 현실적인 샘플 데이터를 생성합니다.

생성할 데이터

| 테이블 | 설명 | 건수 |

|---|---|---|

| movies | 영화 메타데이터 | 500개 |

| users | 사용자 프로필 | 1,000명 |

| ratings | 사용자-영화 평점 | ~10,000건 |

| tags | 사용자 태그 | 1,000건 |

데이터 규모 설계 근거

- 실제 MovieLens Small 데이터셋 (ml-latest-small)은 약 600명 사용자, 9,000편 영화, 100,000건 평점 규모

- 본 실습에서는 학습·실행 시간을 고려하여 소규모로 설정

- 사용자당 평균 ~10개 평점 → 희소성(sparsity) 약 98% 수준 (현실적인 추천 시스템 환경)

- 사용자별 평점 수가 1~100개로 다양하게 분포 (실제 서비스와 유사한 롱테일 분포)

메달리온 아키텍처에서의 위치

이 노트북은 Bronze Layer (원시 데이터) 를 생성합니다.

[데이터 생성] → Bronze (원시) → Silver (정제) → Gold (집계/ML)

↑ 현재 위치1. 환경 설정

Unity Catalog의 카탈로그와 스키마를 설정합니다.

- CATALOG: 각자의 카탈로그 이름으로 변경하세요

- SCHEMA: 이 실습에서 사용할 스키마 이름입니다

import pandas as pd

import numpy as np

from datetime import datetime, timedelta

import random

import json

# 재현성을 위한 시드 설정 (동일한 데이터를 반복 생성하기 위함)

np.random.seed(42)

random.seed(42)

# ============================================================

# ⚠️ 카탈로그 이름을 본인의 카탈로그로 변경하세요!

# ============================================================

CATALOG = "3dt016_databricks"

SCHEMA = "movie_recommender"2. 스키마 생성

Unity Catalog 환경에서 데이터를 저장할 스키마(데이터베이스)를 생성합니다.

카탈로그는 이미 존재한다고 가정합니다. 없으면 CREATE CATALOG 주석을 해제하세요.

# 카탈로그가 없는 경우 아래 주석을 해제하세요

# spark.sql(f"CREATE CATALOG IF NOT EXISTS {CATALOG}")

# 스키마 생성 및 사용 설정

spark.sql(f"CREATE SCHEMA IF NOT EXISTS {CATALOG}.{SCHEMA}")

spark.sql(f"USE {CATALOG}.{SCHEMA}")

print(f"✅ 카탈로그/스키마 설정 완료: {CATALOG}.{SCHEMA}")output

✅ 카탈로그/스키마 설정 완료: 3dt016_databricks.movie_recommender3. 영화 데이터 생성

500개의 가상 영화 데이터를 생성합니다. 각 영화는 다음 속성을 가집니다:

- movie_id: 고유 식별자 (1~500)

- title: 영화 제목 (연도 포함)

- year: 개봉 연도 (1970~2024, 최근 연도에 가중치)

- genres: 장르 (1~4개,

|로 구분) - director: 감독

- runtime_minutes: 러닝타임

- budget_millions: 예산 (백만 달러)

- base_quality: 영화 품질 지표 (평점 생성 시 사용, 이후 제거됨)

# === 영화 메타데이터 정의 ===

# 18개 장르 (MovieLens 기준 표준 장르 분류)

GENRES = [

"Action", "Adventure", "Animation", "Children", "Comedy", "Crime",

"Documentary", "Drama", "Fantasy", "Film-Noir", "Horror", "Musical",

"Mystery", "Romance", "Sci-Fi", "Thriller", "War", "Western"

]

# 유명 감독 목록 (다양한 국적 포함)

DIRECTORS = [

"Christopher Nolan", "Steven Spielberg", "Martin Scorsese", "Quentin Tarantino",

"Denis Villeneuve", "Ridley Scott", "James Cameron", "David Fincher",

"Guillermo del Toro", "Peter Jackson", "Wes Anderson", "Coen Brothers",

"Alfonso Cuarón", "Bong Joon-ho", "Park Chan-wook", "Wong Kar-wai",

"Francis Ford Coppola", "Stanley Kubrick", "Alfred Hitchcock", "Akira Kurosawa"

]

# 영화 제목 생성을 위한 단어 사전

TITLE_PREFIXES = ["The", "A", "Return of", "Rise of", "Fall of", "Legend of", "Secret", "Last", "Dark", "Lost"]

TITLE_WORDS = [

"Knight", "Dawn", "Storm", "Shadow", "Dragon", "Phoenix", "Empire", "Kingdom",

"Warrior", "Journey", "Dream", "Destiny", "Heart", "Soul", "Fire", "Ice",

"Thunder", "Ocean", "Mountain", "Forest", "City", "World", "Galaxy", "Universe"

]

def generate_movie_title():

"""

랜덤 패턴을 사용하여 현실적인 영화 제목을 생성합니다.

4가지 패턴: "The Knight", "Dawn of Storm", "Shadow: The Dragon", "Fire Ice"

"""

pattern = random.choice([1, 2, 3, 4])

if pattern == 1:

return f"{random.choice(TITLE_PREFIXES)} {random.choice(TITLE_WORDS)}"

elif pattern == 2:

return f"{random.choice(TITLE_WORDS)} of {random.choice(TITLE_WORDS)}"

elif pattern == 3:

return f"{random.choice(TITLE_WORDS)}: {random.choice(TITLE_PREFIXES)} {random.choice(TITLE_WORDS)}"

else:

return f"{random.choice(TITLE_WORDS)} {random.choice(TITLE_WORDS)}"

def generate_movies(n_movies=500):

"""

영화 데이터를 생성합니다.

Args:

n_movies: 생성할 영화 수 (기본값: 500)

Returns:

pd.DataFrame: 영화 메타데이터 DataFrame

"""

movies = []

used_titles = set() # 제목 중복 방지

for movie_id in range(1, n_movies + 1):

# 고유한 제목 생성 (중복 시 재생성)

while True:

title = generate_movie_title()

if title not in used_titles:

used_titles.add(title)

break

# 연도: 삼각분포 사용 → 최근 연도에 더 많은 영화가 분포

year = int(np.random.triangular(1970, 2010, 2024))

# 장르: 1~4개 랜덤 할당

n_genres = random.randint(1, 4)

movie_genres = random.sample(GENRES, n_genres)

director = random.choice(DIRECTORS)

# 러닝타임: 정규분포 (평균 120분, 표준편차 25분), 75~210분 범위

runtime = int(np.random.normal(120, 25))

runtime = max(75, min(runtime, 210))

# 예산: 지수분포 (대부분 저예산, 소수 블록버스터), 1~300M 범위

budget = round(np.random.exponential(50), 1)

budget = max(1, min(budget, 300))

# 영화 품질 지표: Beta 분포 → 대부분 중간, 일부 고품질

# Beta(5,3) * 3 + 2 = 2.0 ~ 5.0 분포

base_rating = np.random.beta(5, 3) * 3 + 2

movies.append({

"movie_id": movie_id,

"title": f"{title} ({year})",

"year": year,

"genres": "|".join(movie_genres),

"director": director,

"runtime_minutes": runtime,

"budget_millions": budget,

"base_quality": round(base_rating, 2)

})

return pd.DataFrame(movies)

# 영화 데이터 생성 실행

movies_df = generate_movies(500)

print(f"✅ 영화 데이터 생성 완료: {len(movies_df)}개")

movies_df.head(10)output

✅ 영화 데이터 생성 완료: 500개 movie_id title ... budget_millions base_quality

0 1 The Universe (1998) ... 8.5 3.89

1 2 Lost Soul (1976) ... 175.2 3.51

2 3 Kingdom of Thunder (1995) ... 17.2 4.33

3 4 Kingdom Fire (2001) ... 76.9 4.51

4 5 Dragon: Rise of Dream (2006) ... 5.1 4.52

5 6 Legend of Destiny (1978) ... 120.0 4.57

6 7 Dark Journey (2004) ... 127.5 4.51

7 8 Storm: Rise of Shadow (2012) ... 22.1 4.66

8 9 Empire: Fall of Galaxy (1982) ... 65.3 4.24

9 10 Phoenix of Fire (2013) ... 48.8 3.83

[10 rows x 8 columns]4. 사용자 데이터 생성

500명의 가상 사용자를 생성합니다. 각 사용자는 다음 속성을 가집니다:

- preference_profile: 장르 선호도 프로필 (7가지 유형) — 평점 생성 시 장르 매칭에 사용

- activity_level: 활동성 (1~5) — 평점 개수 결정에 사용

- rating_tendency: 평점 성향 (strict/neutral/lenient) — 평점 편향에 사용

이 속성들은 현실적인 평점 패턴을 만들기 위한 시뮬레이션 파라미터입니다.

# === 사용자 속성 정의 ===

COUNTRIES = ["USA", "UK", "Canada", "Germany", "France", "Japan", "Korea", "Australia", "Brazil", "India"]

AGE_GROUPS = ["18-24", "25-34", "35-44", "45-54", "55-64", "65+"]

# 장르 선호도 프로필: 사용자의 시청 취향을 모델링

# 각 프로필은 특정 장르에 대한 선호도 가중치(0~1)를 정의

GENRE_PREFERENCE_PROFILES = {

"action_lover": {"Action": 0.9, "Adventure": 0.8, "Sci-Fi": 0.7, "Thriller": 0.6},

"drama_enthusiast": {"Drama": 0.9, "Romance": 0.7, "Mystery": 0.6, "Film-Noir": 0.5},

"comedy_fan": {"Comedy": 0.9, "Animation": 0.7, "Musical": 0.6, "Children": 0.5},

"horror_seeker": {"Horror": 0.9, "Thriller": 0.8, "Mystery": 0.7, "Sci-Fi": 0.5},

"family_viewer": {"Animation": 0.9, "Children": 0.8, "Comedy": 0.7, "Adventure": 0.6},

"cinephile": {"Drama": 0.8, "Film-Noir": 0.8, "Documentary": 0.7, "War": 0.6},

"balanced": {} # 균형잡힌 취향 (특별한 선호 없음)

}

def generate_users(n_users=1000):

"""

사용자 데이터를 생성합니다.

Args:

n_users: 생성할 사용자 수 (기본값: 1,000)

Returns:

pd.DataFrame: 사용자 프로필 DataFrame

"""

users = []

for user_id in range(1, n_users + 1):

# 가입일: 2015~2024년 사이 랜덤

days_since_start = random.randint(0, 365 * 9)

signup_date = datetime(2015, 1, 1) + timedelta(days=days_since_start)

country = random.choice(COUNTRIES)

# 연령대: 25-34가 가장 많은 분포 (실제 스트리밍 서비스 인구통계 반영)

age_weights = [0.15, 0.30, 0.25, 0.15, 0.10, 0.05]

age_group = random.choices(AGE_GROUPS, weights=age_weights)[0]

# 장르 선호도 프로필 랜덤 할당

profile_type = random.choice(list(GENRE_PREFERENCE_PROFILES.keys()))

# 활동성 레벨: 롱테일 분포 (다수 라이트 + 소수 헤비)

activity_level = random.choices([1, 2, 3, 4, 5], weights=[0.20, 0.30, 0.30, 0.15, 0.05])[0]

# 평점 성향: 대부분 neutral, 일부 strict(낮게 줌) 또는 lenient(높게 줌)

rating_tendency = random.choice(["strict", "neutral", "neutral", "neutral", "lenient"])

users.append({

"user_id": user_id,

"signup_date": signup_date.strftime("%Y-%m-%d"),

"country": country,

"age_group": age_group,

"preference_profile": profile_type,

"activity_level": activity_level,

"rating_tendency": rating_tendency

})

return pd.DataFrame(users)

# 사용자 데이터 생성 실행

users_df = generate_users(1000)

print(f"✅ 사용자 데이터 생성 완료: {len(users_df)}명")

users_df.head(10)output

✅ 사용자 데이터 생성 완료: 1000명 user_id signup_date ... activity_level rating_tendency

0 1 2020-02-05 ... 3 neutral

1 2 2023-01-11 ... 3 strict

2 3 2018-10-30 ... 2 lenient

3 4 2019-03-12 ... 2 neutral

4 5 2016-03-14 ... 1 neutral

5 6 2017-06-02 ... 3 strict

6 7 2023-06-29 ... 4 lenient

7 8 2016-05-19 ... 5 neutral

8 9 2020-08-05 ... 3 neutral

9 10 2021-07-24 ... 4 neutral

[10 rows x 7 columns]5. 평점 데이터 생성 (핵심!)

평점 데이터는 추천 시스템의 핵심 입력입니다.

평점 계산 로직

각 평점은 다음 요소를 종합하여 현실적으로 생성됩니다:

1. 영화 품질 (base_quality): 기본 점수 (2.0~5.0)

2. 장르 매칭 보너스: 사용자 선호 장르와 일치하면 최대 +0.8점

3. 랜덤 노이즈: 정규분포 N(0, 0.5) — 개인차 반영

4. 평점 성향 보정: strict(-0.5), neutral(0), lenient(+0.5)

5. 최종 반올림: 0.5 단위, 0.5~5.0 범위

사용자별 평점 수 (롱테일 분포)

실제 서비스처럼 소수의 헤비 유저와 다수의 라이트 유저로 구성됩니다:

| 활동성 | 기본 평점 수 | 사용자 비율 |

|--------|-------------|-----------|

| 1 (낮음) | 1~3개 | 20% |

| 2 | 3~8개 | 30% |

| 3 (보통) | 8~15개 | 30% |

| 4 | 15~40개 | 15% |

| 5 (높음) | 40~100개 | 5% |

사용자당 평균 약 10개 평점 (총 ~10,000건 / 1,000명)

def calculate_rating(user, movie, genre_prefs):

"""

사용자-영화 조합에 대한 현실적인 평점을 계산합니다.

Args:

user: 사용자 정보 딕셔너리

movie: 영화 정보 딕셔너리

genre_prefs: 사용자의 장르 선호도 딕셔너리

Returns:

float: 0.5 단위의 평점 (0.5 ~ 5.0)

"""

# 1단계: 영화 자체의 품질이 기본 점수

base = movie["base_quality"]

# 2단계: 사용자 선호 장르와 영화 장르가 일치하면 보너스 부여

movie_genres = set(movie["genres"].split("|"))

genre_bonus = 0

if genre_prefs:

matching_prefs = [genre_prefs.get(g, 0) for g in movie_genres if g in genre_prefs]

if matching_prefs:

genre_bonus = np.mean(matching_prefs) * 0.8 # 최대 0.8점 보너스

# 3단계: 랜덤 노이즈 (같은 영화라도 사용자마다 다르게 느낌)

noise = np.random.normal(0, 0.5)

# 4단계: 사용자 평점 성향 반영

tendency_offset = {"strict": -0.5, "neutral": 0, "lenient": 0.5}

tendency = tendency_offset.get(user["rating_tendency"], 0)

# 최종 평점 계산 및 반올림

rating = base + genre_bonus + noise + tendency

rating = round(rating * 2) / 2 # 0.5 단위로 반올림

rating = max(0.5, min(rating, 5.0)) # 범위 제한

return rating

def generate_ratings(users_df, movies_df, target_ratings=10000):

"""

평점 데이터를 생성합니다.

각 사용자의 활동성 레벨에 비례하여 평점 수를 할당하고,

영화 인기도(파레토 분포)에 따라 시청할 영화를 선택합니다.

사용자별 평점 수는 롱테일 분포를 따릅니다 (소수 헤비유저 + 다수 라이트유저).

Args:

users_df: 사용자 DataFrame

movies_df: 영화 DataFrame

target_ratings: 목표 총 평점 수 (기본값: 10,000)

Returns:

pd.DataFrame: 평점 DataFrame

"""

ratings = []

users_list = users_df.to_dict("records")

movies_list = movies_df.to_dict("records")

# 영화 인기도: 파레토 분포 → 소수의 영화가 대부분의 평점을 받음 (롱테일 효과)

movie_popularity = np.random.pareto(1.5, len(movies_list)) + 1

movie_popularity = movie_popularity / movie_popularity.sum()

# 사용자별 평점 수 결정 (활동성 기반, 롱테일 분포)

# 실제 서비스와 유사하게: 대부분 적은 수, 소수가 많은 수

user_rating_counts = []

for user in users_list:

activity = user["activity_level"]

if activity == 1:

# 라이트 유저: 1~3개

count = random.randint(1, 3)

elif activity == 2:

# 가벼운 사용자: 3~8개

count = random.randint(3, 8)

elif activity == 3:

# 보통 사용자: 8~15개

count = random.randint(8, 15)

elif activity == 4:

# 활발한 사용자: 15~40개

count = random.randint(15, 40)

else:

# 헤비 유저: 40~100개

count = random.randint(40, 100)

user_rating_counts.append(count)

# 총 평점 수를 목표치에 맞게 스케일링

total_planned = sum(user_rating_counts)

scale_factor = target_ratings / total_planned

user_rating_counts = [max(1, int(c * scale_factor)) for c in user_rating_counts]

# 평점 생성

for user, n_ratings in zip(users_list, user_rating_counts):

# 사용자의 장르 선호도 가져오기

genre_prefs = GENRE_PREFERENCE_PROFILES.get(user["preference_profile"], {})

# 인기도 기반으로 시청할 영화 선택 (중복 없이, 영화 수 초과 방지)

n_to_sample = min(n_ratings, len(movies_list))

watched_indices = np.random.choice(

len(movies_list),

size=n_to_sample,

replace=False,

p=movie_popularity

)

# 평점 시간: 가입일 이후 랜덤 시점

signup = datetime.strptime(user["signup_date"], "%Y-%m-%d")

days_active = (datetime(2024, 12, 1) - signup).days

for idx in watched_indices:

movie = movies_list[idx]

rating = calculate_rating(user, movie, genre_prefs)

# 가입일 ~ 2024-12-01 사이의 랜덤 시점

rating_days = random.randint(0, max(1, days_active))

rating_time = signup + timedelta(

days=rating_days,

hours=random.randint(0, 23),

minutes=random.randint(0, 59)

)

ratings.append({

"user_id": user["user_id"],

"movie_id": movie["movie_id"],

"rating": rating,

"timestamp": int(rating_time.timestamp())

})

return pd.DataFrame(ratings)

# 평점 데이터 생성 실행

print("⏳ 평점 데이터 생성 중...")

ratings_df = generate_ratings(users_df, movies_df, target_ratings=10000)

print(f"✅ 평점 데이터 생성 완료: {len(ratings_df):,}건")

# 평점 분포 확인

print("\n📊 평점 분포:")

print(ratings_df["rating"].value_counts().sort_index())output

⏳ 평점 데이터 생성 중...

✅ 평점 데이터 생성 완료: 9,533건

📊 평점 분포:

1.5 21

2.0 82

2.5 317

3.0 852

3.5 1694

4.0 2210

4.5 2122

5.0 2235

Name: rating, dtype: int646. 태그 데이터 생성

사용자가 영화에 붙인 자유 태그 데이터를 생성합니다.

- 활발한 사용자(activity_level ≥ 3)만 태그를 작성한다고 가정

- 태그는 감성(긍정/부정/중립)을 포함하여 이후 분석에 활용 가능

# 영화 관련 태그 목록 (감성별 분류)

TAGS = [

# 긍정적 태그

"masterpiece", "must-watch", "amazing-visuals", "great-acting",

"emotional", "inspiring", "beautiful", "rewatchable", "feel-good",

# 부정적 태그

"overrated", "boring", "predictable", "slow-paced",

# 중립적/설명적 태그

"underrated", "exciting", "thought-provoking", "mind-bending",

"funny", "scary", "good-soundtrack", "twist-ending",

"fast-paced", "complex-plot", "original", "classic", "cult-film",

"dark", "violent", "family-friendly", "romantic", "disturbing", "nostalgic"

]

def generate_tags(users_df, movies_df, n_tags=1000):

"""

태그 데이터를 생성합니다.

Args:

users_df: 사용자 DataFrame

movies_df: 영화 DataFrame

n_tags: 생성할 태그 수 (기본값: 1,000)

Returns:

pd.DataFrame: 태그 DataFrame

"""

tags = []

# 활발한 사용자만 태그 작성 (activity_level 3 이상)

active_users = users_df[users_df["activity_level"] >= 3]["user_id"].tolist()

for _ in range(n_tags):

user_id = random.choice(active_users)

movie_id = random.randint(1, len(movies_df))

tag = random.choice(TAGS)

# 태그 시간: 2020~2024년 사이 랜덤

timestamp = int(datetime(2020, 1, 1).timestamp()) + random.randint(0, 157680000)

tags.append({

"user_id": user_id,

"movie_id": movie_id,

"tag": tag,

"timestamp": timestamp

})

return pd.DataFrame(tags)

# 태그 데이터 생성 실행

tags_df = generate_tags(users_df, movies_df, n_tags=1000)

print(f"✅ 태그 데이터 생성 완료: {len(tags_df):,}건")output

✅ 태그 데이터 생성 완료: 1,000건7. Delta 테이블로 저장 (Bronze Layer)

생성된 데이터를 Delta Lake 형식의 Bronze 테이블로 저장합니다.

Bronze Layer는 원시 데이터를 그대로 보존하는 계층입니다:

- 데이터 변환 없이 원본 그대로 저장

overwrite모드로 저장하여 재실행 시 기존 데이터를 덮어씁니다- Pandas DataFrame → Spark DataFrame → Delta Table 순으로 변환

from pyspark.sql.types import *

# Movies → Bronze 테이블

movies_spark = spark.createDataFrame(movies_df)

movies_spark.write.format("delta").mode("overwrite").saveAsTable(f"{CATALOG}.{SCHEMA}.bronze_movies")

print(f"✅ bronze_movies 테이블 저장 완료")

# Users → Bronze 테이블

users_spark = spark.createDataFrame(users_df)

users_spark.write.format("delta").mode("overwrite").saveAsTable(f"{CATALOG}.{SCHEMA}.bronze_users")

print(f"✅ bronze_users 테이블 저장 완료")

# Ratings → Bronze 테이블

ratings_spark = spark.createDataFrame(ratings_df)

ratings_spark.write.format("delta").mode("overwrite").saveAsTable(f"{CATALOG}.{SCHEMA}.bronze_ratings")

print(f"✅ bronze_ratings 테이블 저장 완료")

# Tags → Bronze 테이블

tags_spark = spark.createDataFrame(tags_df)

tags_spark.write.format("delta").mode("overwrite").saveAsTable(f"{CATALOG}.{SCHEMA}.bronze_tags")

print(f"✅ bronze_tags 테이블 저장 완료")output

✅ bronze_movies 테이블 저장 완료

✅ bronze_users 테이블 저장 완료

✅ bronze_ratings 테이블 저장 완료

✅ bronze_tags 테이블 저장 완료8. 데이터 요약

생성된 데이터의 통계를 확인합니다.

희소성(Sparsity) 은 전체 가능한 (사용자 × 영화) 조합 대비 실제 평점 비율의 여집합입니다.

희소성이 낮을수록(= 밀도가 높을수록) 협업 필터링 모델의 학습이 유리합니다.

print("=" * 60)

print("📊 생성된 데이터 요약")

print("=" * 60)

print(f"🎬 영화 수: {len(movies_df):,}개")

print(f"👤 사용자 수: {len(users_df):,}명")

print(f"⭐ 평점 수: {len(ratings_df):,}건")

print(f"🏷️ 태그 수: {len(tags_df):,}건")

print(f"\n📍 저장 위치: {CATALOG}.{SCHEMA}")

print("=" * 60)

# 희소성(Sparsity) 계산

total_possible = len(movies_df) * len(users_df) # 전체 가능한 조합

sparsity = 1 - (len(ratings_df) / total_possible)

print(f"\n🔢 평점 매트릭스 희소성: {sparsity:.4%}")

print(f" (사용자당 평균 {len(ratings_df)/len(users_df):.1f}개 영화 평가)")

print(f" (영화당 평균 {len(ratings_df)/len(movies_df):.1f}개 평점)")output

============================================================

📊 생성된 데이터 요약

============================================================

🎬 영화 수: 500개

👤 사용자 수: 1,000명

⭐ 평점 수: 9,533건

🏷️ 태그 수: 1,000건

📍 저장 위치: 3dt016_databricks.movie_recommender

============================================================

🔢 평점 매트릭스 희소성: 98.0934%

(사용자당 평균 9.5개 영화 평가)

(영화당 평균 19.1개 평점)| 테이블 | 건수 | 설명 |

|---|---|---|

bronze_movies | 500 | 영화 메타데이터 |

bronze_users | 1,000 | 사용자 프로필 |

bronze_ratings | ~10,000 | 사용자-영화 평점 |

bronze_tags | 1,000 | 사용자 태그 |

Silver Layer: 데이터 정제 및 피처 엔지니어링

Bronze 데이터를 정제하고 ML에 활용할 수 있는 형태로 변환합니다.

변환 작업 요약

| 테이블 | 주요 변환 |

|---|---|

| silver_movies | 장르 배열화, 연대/예산/러닝타임 카테고리 생성, 정보 누출 컬럼 제거 |

| silver_users | 날짜 변환, 연령대 인코딩, 지역 그룹화, 평점 성향 수치화 |

| silver_ratings | 타임스탬프 변환, 시간대 카테고리, 평점 이진 레이블, 이상치 제거 |

| silver_tags | 태그 정규화, 감성 분류 |

| silver_user_stats | 사용자별 평점 통계 집계 |

| silver_movie_stats | 영화별 평점 통계 집계 + 베이지안 평균 |

메달리온 아키텍처에서의 위치

Bronze (원시) → Silver (정제/피처) → Gold (집계/ML)

↑ 현재 위치1. 환경 설정

from pyspark.sql import functions as F

from pyspark.sql.types import *

from pyspark.sql.window import Window

from datetime import datetime

# ============================================================

# ⚠️ 카탈로그 이름을 본인의 카탈로그로 변경하세요!

# ============================================================

CATALOG = "3dt016_databricks"

SCHEMA = "movie_recommender"

spark.sql(f"USE {CATALOG}.{SCHEMA}")

print(f"✅ 카탈로그 설정: {CATALOG}.{SCHEMA}")output

✅ 카탈로그 설정: 3dt016_databricks.movie_recommender2. Bronze 데이터 로드 및 탐색

이전 노트북에서 생성한 Bronze 테이블을 로드하고 기본 현황을 확인합니다.

# Bronze 테이블 로드

bronze_movies = spark.table("bronze_movies")

bronze_users = spark.table("bronze_users")

bronze_ratings = spark.table("bronze_ratings")

bronze_tags = spark.table("bronze_tags")

print("📊 Bronze 테이블 현황:")

print(f" - movies: {bronze_movies.count():,} rows")

print(f" - users: {bronze_users.count():,} rows")

print(f" - ratings: {bronze_ratings.count():,} rows")

print(f" - tags: {bronze_tags.count():,} rows")output

📊 Bronze 테이블 현황:

- movies: 500 rows

- users: 1,000 rows

- ratings: 9,533 rows

- tags: 1,000 rows# 각 테이블의 샘플 데이터 확인

display(bronze_movies.limit(5))

display(bronze_users.limit(5))

display(bronze_ratings.limit(5))

display(bronze_tags.limit(5))output

| movie_id | title | year | genres | director | runtime_minutes | budget_millions | base_quality |

|---|---|---|---|---|---|---|---|

| 1 | The Universe (1998) | 1998 | Drama|Western|Comedy | Quentin Tarantino | 92 | 8.5 | 3.89 |

| 2 | Lost Soul (1976) | 1976 | Action | Martin Scorsese | 145 | 175.2 | 3.51 |

| 3 | Kingdom of Thunder (1995) | 1995 | Western | James Cameron | 75 | 17.2 | 4.33 |

| 4 | Kingdom Fire (2001) | 2001 | Action|Crime|Romance | Wes Anderson | 101 | 76.9 | 4.51 |

| 5 | Dragon: Rise of Dream (2006) | 2006 | Animation | Alfonso Cuarón | 104 | 5.1 | 4.52 |

| user_id | signup_date | country | age_group | preference_profile | activity_level | rating_tendency |

|---|---|---|---|---|---|---|

| 1 | 2020-02-05 | Japan | 35-44 | family_viewer | 3 | neutral |

| 2 | 2023-01-11 | Australia | 18-24 | balanced | 3 | strict |

| 3 | 2018-10-30 | Japan | 45-54 | balanced | 2 | lenient |

| 4 | 2019-03-12 | UK | 18-24 | drama_enthusiast | 2 | neutral |

| 5 | 2016-03-14 | France | 35-44 | drama_enthusiast | 1 | neutral |

| user_id | movie_id | rating | timestamp |

|---|---|---|---|

| 1 | 479 | 4.0 | 1715870460 |

| 1 | 302 | 4.0 | 1605670560 |

| 1 | 351 | 4.0 | 1667179380 |

| 1 | 147 | 4.0 | 1732872300 |

| 1 | 195 | 5.0 | 1653249480 |

| user_id | movie_id | tag | timestamp |

|---|---|---|---|

| 426 | 425 | must-watch | 1619589428 |

| 374 | 212 | mind-bending | 1609074223 |

| 843 | 312 | thought-provoking | 1691535473 |

| 978 | 97 | twist-ending | 1595585111 |

| 796 | 434 | romantic | 1694484196 |

3. Silver Movies 변환

영화 데이터에 다음 피처를 추가합니다:

- genres_array: 장르 문자열을 배열로 변환 (Explode 등 후속 분석에 필요)

- num_genres: 장르 개수

- decade: 연대 (1970, 1980, ...)

- is_recent: 2015년 이후 영화 여부

- budget_category: 예산 규모 카테고리 (Low/Medium/High/Blockbuster)

- runtime_category: 러닝타임 카테고리 (Short/Standard/Long/Epic)

️

base_quality컬럼 제거: 이 컬럼은 평점 생성용 시뮬레이션 파라미터이므로,

ML 모델 훈련 시 정보 누출(Data Leakage) 을 방지하기 위해 Silver 단계에서 삭제합니다.

silver_movies = (

bronze_movies

# 장르 문자열을 배열로 분리 (예: "Action|Comedy" → ["Action", "Comedy"])

.withColumn("genres_array", F.split(F.col("genres"), "\\|"))

.withColumn("num_genres", F.size("genres_array"))

# 연도 기반 피처

.withColumn("decade", (F.floor(F.col("year") / 10) * 10).cast("integer"))

.withColumn("is_recent", F.when(F.col("year") >= 2015, True).otherwise(False))

# 예산 카테고리 (백만 달러 기준)

.withColumn("budget_category",

F.when(F.col("budget_millions") < 20, "Low") # 2천만 미만

.when(F.col("budget_millions") < 80, "Medium") # 2천만~8천만

.when(F.col("budget_millions") < 150, "High") # 8천만~1.5억

.otherwise("Blockbuster") # 1.5억 이상

)

# 러닝타임 카테고리 (분 기준)

.withColumn("runtime_category",

F.when(F.col("runtime_minutes") < 90, "Short") # 90분 미만

.when(F.col("runtime_minutes") < 120, "Standard") # 90~120분

.when(F.col("runtime_minutes") < 150, "Long") # 120~150분

.otherwise("Epic") # 150분 이상

)

# 처리 메타데이터

.withColumn("processed_at", F.current_timestamp())

.withColumn("data_quality_score", F.lit(1.0))

# base_quality 제거 (정보 누출 방지)

.drop("base_quality")

)

# 데이터 품질 검사: Null 값 확인

null_counts = silver_movies.select([

F.sum(F.when(F.col(c).isNull(), 1).otherwise(0)).alias(c)

for c in silver_movies.columns

])

print("🔍 Null 값 검사:")

null_counts.show()

# Silver 테이블 저장

silver_movies.write.format("delta").mode("overwrite").saveAsTable("silver_movies")

print(f"✅ silver_movies 저장 완료: {silver_movies.count():,} rows")output

🔍 Null 값 검사:

+--------+-----+----+------+--------+---------------+---------------+------------+----------+------+---------+---------------+----------------+------------+------------------+

|movie_id|title|year|genres|director|runtime_minutes|budget_millions|genres_array|num_genres|decade|is_recent|budget_category|runtime_category|processed_at|data_quality_score|

+--------+-----+----+------+--------+---------------+---------------+------------+----------+------+---------+---------------+----------------+------------+------------------+

| 0| 0| 0| 0| 0| 0| 0| 0| 0| 0| 0| 0| 0| 0| 0|

+--------+-----+----+------+--------+---------------+---------------+------------+----------+------+---------+---------------+----------------+------------+------------------+

✅ silver_movies 저장 완료: 500 rows# 변환 결과 샘플 확인

display(silver_movies.limit(5))output

| movie_id | title | year | genres | director | runtime_minutes | budget_millions | genres_array | num_genres | decade | is_recent | budget_category | runtime_category | processed_at | data_quality_score |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 1 | The Universe (1998) | 1998 | Drama|Western|Comedy | Quentin Tarantino | 92 | 8.5 | ['Drama', 'Western', 'Comedy'] | 3 | 1990 | False | Low | Standard | 2026-03-27T01:35:12.904Z | 1.0 |

| 2 | Lost Soul (1976) | 1976 | Action | Martin Scorsese | 145 | 175.2 | ['Action'] | 1 | 1970 | False | Blockbuster | Long | 2026-03-27T01:35:12.904Z | 1.0 |

| 3 | Kingdom of Thunder (1995) | 1995 | Western | James Cameron | 75 | 17.2 | ['Western'] | 1 | 1990 | False | Low | Short | 2026-03-27T01:35:12.904Z | 1.0 |

| 4 | Kingdom Fire (2001) | 2001 | Action|Crime|Romance | Wes Anderson | 101 | 76.9 | ['Action', 'Crime', 'Romance'] | 3 | 2000 | False | Medium | Standard | 2026-03-27T01:35:12.904Z | 1.0 |

| 5 | Dragon: Rise of Dream (2006) | 2006 | Animation | Alfonso Cuarón | 104 | 5.1 | ['Animation'] | 1 | 2000 | False | Low | Standard | 2026-03-27T01:35:12.904Z | 1.0 |

4. Silver Users 변환

사용자 데이터에 ML과 분석에 유용한 피처를 추가합니다:

- 날짜 관련: signup_date 타입 변환, 가입 연도/월, 계정 나이 (일수)

- 인코딩: 연령대 숫자 인코딩 (ML 입력용)

- 지역 그룹: 국가를 대륙/지역으로 그룹화

- 성향 수치화: 평점 성향을 -1/0/+1 수치로 변환

silver_users = (

bronze_users

# 날짜 타입 변환 (문자열 → Date)

.withColumn("signup_date", F.to_date("signup_date"))

.withColumn("signup_year", F.year("signup_date"))

.withColumn("signup_month", F.month("signup_date"))

# 가입 기간 계산 (오늘 기준)

.withColumn("account_age_days",

F.datediff(F.current_date(), F.col("signup_date"))

)

# 연령대 → 숫자 인코딩 (ML 모델 입력용)

.withColumn("age_group_encoded",

F.when(F.col("age_group") == "18-24", 1)

.when(F.col("age_group") == "25-34", 2)

.when(F.col("age_group") == "35-44", 3)

.when(F.col("age_group") == "45-54", 4)

.when(F.col("age_group") == "55-64", 5)

.otherwise(6) # 65+

)

# 국가 → 지역 그룹

.withColumn("region",

F.when(F.col("country").isin("USA", "Canada"), "North America")

.when(F.col("country").isin("UK", "Germany", "France"), "Europe")

.when(F.col("country").isin("Japan", "Korea"), "East Asia")

.when(F.col("country") == "Australia", "Oceania")

.otherwise("Other")

)

# 평점 성향 수치화 (strict=-1, neutral=0, lenient=+1)

.withColumn("rating_tendency_score",

F.when(F.col("rating_tendency") == "strict", -1)

.when(F.col("rating_tendency") == "lenient", 1)

.otherwise(0)

)

# 처리 메타데이터

.withColumn("processed_at", F.current_timestamp())

)

# Silver 테이블 저장

silver_users.write.format("delta").mode("overwrite").saveAsTable("silver_users")

print(f"✅ silver_users 저장 완료: {silver_users.count():,} rows")output

✅ silver_users 저장 완료: 1,000 rowsdisplay(silver_users.limit(5))output

| user_id | signup_date | country | age_group | preference_profile | activity_level | rating_tendency | signup_year | signup_month | account_age_days | age_group_encoded | region | rating_tendency_score | processed_at |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 1 | 2020-02-05 | Japan | 35-44 | family_viewer | 3 | neutral | 2020 | 2 | 2242 | 3 | East Asia | 0 | 2026-03-27T01:35:17.908Z |

| 2 | 2023-01-11 | Australia | 18-24 | balanced | 3 | strict | 2023 | 1 | 1171 | 1 | Oceania | -1 | 2026-03-27T01:35:17.908Z |

| 3 | 2018-10-30 | Japan | 45-54 | balanced | 2 | lenient | 2018 | 10 | 2705 | 4 | East Asia | 1 | 2026-03-27T01:35:17.908Z |

| 4 | 2019-03-12 | UK | 18-24 | drama_enthusiast | 2 | neutral | 2019 | 3 | 2572 | 1 | Europe | 0 | 2026-03-27T01:35:17.908Z |

| 5 | 2016-03-14 | France | 35-44 | drama_enthusiast | 1 | neutral | 2016 | 3 | 3665 | 3 | Europe | 0 | 2026-03-27T01:35:17.908Z |

5. Silver Ratings 변환 (핵심 데이터!)

평점 데이터는 ALS 모델의 직접적인 입력이므로 가장 중요한 테이블입니다.

추가 피처

- 시간 관련: Unix timestamp → 날짜/시간/연도/월/시간 변환

- 시간대 카테고리: Morning/Afternoon/Evening/Night

- 평점 카테고리: Dislike(≤2.0) / Neutral(≤3.5) / Like(>3.5)

- 이진 레이블: 4.0 이상을 긍정(1), 미만을 부정(0)으로 분류 → 분류 모델에도 활용 가능

데이터 품질 검증

- 평점 범위 (0.5~5.0) 밖의 이상치를 탐지하고 제거합니다

silver_ratings = (

bronze_ratings

# Unix 타임스탬프를 날짜/시간으로 변환

.withColumn("rating_datetime", F.from_unixtime("timestamp"))

.withColumn("rating_date", F.to_date("rating_datetime"))

.withColumn("rating_year", F.year("rating_datetime"))

.withColumn("rating_month", F.month("rating_datetime"))

.withColumn("rating_hour", F.hour("rating_datetime"))

# 시간대 카테고리 (시청 패턴 분석용)

.withColumn("time_of_day",

F.when(F.col("rating_hour").between(6, 11), "Morning")

.when(F.col("rating_hour").between(12, 17), "Afternoon")

.when(F.col("rating_hour").between(18, 22), "Evening")

.otherwise("Night")

)

# 평점 카테고리화 (3단계)

.withColumn("rating_category",

F.when(F.col("rating") <= 2.0, "Dislike")

.when(F.col("rating") <= 3.5, "Neutral")

.otherwise("Like")

)

# 이진 레이블: 4.0 이상 = 긍정적 (추천 알고리즘의 implicit feedback 변환에 활용)

.withColumn("is_positive", F.when(F.col("rating") >= 4.0, 1).otherwise(0))

# 처리 메타데이터

.withColumn("processed_at", F.current_timestamp())

)

# 이상치 탐지: 0.5~5.0 범위 밖의 평점 확인

invalid_ratings = silver_ratings.filter(

(F.col("rating") < 0.5) | (F.col("rating") > 5.0)

)

print(f"⚠️ 유효하지 않은 평점 수: {invalid_ratings.count()}")

# 유효한 평점만 유지

silver_ratings = silver_ratings.filter(

(F.col("rating") >= 0.5) & (F.col("rating") <= 5.0)

)

# Silver 테이블 저장

silver_ratings.write.format("delta").mode("overwrite").saveAsTable("silver_ratings")

print(f"✅ silver_ratings 저장 완료: {silver_ratings.count():,} rows")output

⚠️ 유효하지 않은 평점 수: 0

✅ silver_ratings 저장 완료: 9,533 rows# 평점 분포 확인 (히스토그램 형태)

display(

silver_ratings

.groupBy("rating")

.count()

.orderBy("rating")

)output

| rating | count |

|---|---|

| 1.5 | 21 |

| 2.0 | 82 |

| 2.5 | 317 |

| 3.0 | 852 |

| 3.5 | 1694 |

| 4.0 | 2210 |

| 4.5 | 2122 |

| 5.0 | 2235 |

6. Silver Tags 변환

태그 데이터를 정규화하고 감성(Sentiment) 분류를 추가합니다.

- tag_normalized: 소문자 변환 + 공백 제거

- tag_sentiment: 미리 정의한 키워드 기반 감성 분류 (Positive/Negative/Neutral)

silver_tags = (

bronze_tags

# 타임스탬프 변환

.withColumn("tag_datetime", F.from_unixtime("timestamp"))

.withColumn("tag_date", F.to_date("tag_datetime"))

# 태그 정규화 (소문자, 공백 제거)

.withColumn("tag_normalized", F.lower(F.trim("tag")))

# 태그 감성 분류 (키워드 기반 규칙)

.withColumn("tag_sentiment",

F.when(F.col("tag_normalized").isin(

"masterpiece", "must-watch", "amazing-visuals", "great-acting",

"emotional", "inspiring", "beautiful", "rewatchable", "feel-good"

), "Positive")

.when(F.col("tag_normalized").isin(

"overrated", "boring", "predictable", "slow-paced"

), "Negative")

.otherwise("Neutral")

)

# 처리 메타데이터

.withColumn("processed_at", F.current_timestamp())

)

# Silver 테이블 저장

silver_tags.write.format("delta").mode("overwrite").saveAsTable("silver_tags")

print(f"✅ silver_tags 저장 완료: {silver_tags.count():,} rows")output

✅ silver_tags 저장 완료: 1,000 rows7. 사용자-영화 통계 피처 테이블 생성

사용자별, 영화별 집계 통계를 미리 계산하여 저장합니다.

이 테이블들은 Gold Layer 및 추천 서비스에서 빈번하게 조회되므로,

미리 집계해두면 성능이 크게 향상됩니다.

7.1 사용자별 통계 (silver_user_stats)

- 총 평점 수, 평균/표준편차/최소/최대 평점

- 고유 영화 수, 긍정 평점 비율

- 활동 기간 (첫 평점 ~ 마지막 평점)

- 일 평균 평점 수

# 사용자별 통계 집계

user_stats = (

silver_ratings

.groupBy("user_id")

.agg(

F.count("*").alias("total_ratings"),

F.avg("rating").alias("avg_rating"),

F.stddev("rating").alias("rating_stddev"),

F.min("rating").alias("min_rating"),

F.max("rating").alias("max_rating"),

F.countDistinct("movie_id").alias("unique_movies"),

F.min("rating_date").alias("first_rating_date"),

F.max("rating_date").alias("last_rating_date"),

F.sum("is_positive").alias("positive_ratings")

)

# 파생 지표 계산

.withColumn("positive_ratio", F.col("positive_ratings") / F.col("total_ratings"))

.withColumn("rating_days_span",

F.datediff(F.col("last_rating_date"), F.col("first_rating_date"))

)

.withColumn("ratings_per_day",

F.when(F.col("rating_days_span") > 0,

F.col("total_ratings") / F.col("rating_days_span")

).otherwise(F.col("total_ratings"))

)

)

user_stats.write.format("delta").mode("overwrite").saveAsTable("silver_user_stats")

print(f"✅ silver_user_stats 저장 완료: {user_stats.count():,} rows")output

✅ silver_user_stats 저장 완료: 1,000 rows7.2 영화별 통계 (silver_movie_stats)

영화별 평점 통계와 함께 베이지안 평균 (Bayesian Average) 을 계산합니다.

베이지안 평균이란?

평점 수가 적은 영화의 과대/과소 평가를 보정하는 기법입니다.

공식: bayesian_avg = (v × R + m × C) / (v + m)

| 변수 | 설명 | 본 실습 값 |

|---|---|---|

| R | 영화의 실제 평균 평점 | avg_rating |

| v | 영화의 평점 개수 | total_ratings |

| C | 전체 평균 (사전 확률) | 3.0 |

| m | 최소 신뢰 샘플 수 | 10 |

예시:

- 영화 A (평점 5.0, 1개): bayesian_avg = (5×1 + 3×10) / (1+10) = 3.18 → 신뢰도 낮아 평균 쪽으로 보정

- 영화 B (평점 4.0, 200개): bayesian_avg = (4×200 + 3×10) / (200+10) = 3.95 → 충분한 데이터이므로 원래 값에 가까움

# 영화별 통계 집계

movie_stats = (

silver_ratings

.groupBy("movie_id")

.agg(

F.count("*").alias("total_ratings"),

F.avg("rating").alias("avg_rating"),

F.stddev("rating").alias("rating_stddev"),

F.countDistinct("user_id").alias("unique_raters"),

F.sum("is_positive").alias("positive_ratings"),

F.min("rating_date").alias("first_rating_date"),

F.max("rating_date").alias("last_rating_date")

)

.withColumn("positive_ratio", F.col("positive_ratings") / F.col("total_ratings"))

# 베이지안 평균: 평점 수가 적은 영화의 과대/과소 평가 보정

# C=3.0 (전체 평균 추정), m=10 (최소 신뢰 샘플 수)

.withColumn("bayesian_avg",

(F.col("avg_rating") * F.col("total_ratings") + 3.0 * 10) /

(F.col("total_ratings") + 10)

)

)

movie_stats.write.format("delta").mode("overwrite").saveAsTable("silver_movie_stats")

print(f"✅ silver_movie_stats 저장 완료: {movie_stats.count():,} rows")output

✅ silver_movie_stats 저장 완료: 500 rows8. 데이터 품질 리포트

Silver Layer 전체의 데이터 품질과 통계를 요약합니다.

# Silver Layer 데이터 품질 요약

print("=" * 70)

print("📊 Silver Layer 데이터 품질 리포트")

print("=" * 70)

# 각 테이블 요약

tables = [

("silver_movies", spark.table("silver_movies")),

("silver_users", spark.table("silver_users")),

("silver_ratings", spark.table("silver_ratings")),

("silver_tags", spark.table("silver_tags")),

("silver_user_stats", spark.table("silver_user_stats")),

("silver_movie_stats", spark.table("silver_movie_stats"))

]

for name, df in tables:

print(f"\n📌 {name}:")

print(f" Rows: {df.count():,}")

print(f" Columns: {len(df.columns)}")

# 핵심 통계

ratings_df = spark.table("silver_ratings")

print(f"\n📈 평점 통계:")

print(f" 총 평점 수: {ratings_df.count():,}")

print(f" 평균 평점: {ratings_df.agg(F.avg('rating')).collect()[0][0]:.3f}")

print(f" 평점 표준편차: {ratings_df.agg(F.stddev('rating')).collect()[0][0]:.3f}")

user_stats_df = spark.table("silver_user_stats")

print(f"\n👤 사용자 통계:")

print(f" 사용자당 평균 평점 수: {user_stats_df.agg(F.avg('total_ratings')).collect()[0][0]:.1f}")

print(f" 사용자당 평균 평점: {user_stats_df.agg(F.avg('avg_rating')).collect()[0][0]:.3f}")

movie_stats_df = spark.table("silver_movie_stats")

print(f"\n🎬 영화 통계:")

print(f" 영화당 평균 평점 수: {movie_stats_df.agg(F.avg('total_ratings')).collect()[0][0]:.1f}")

print(f" 영화 평균 평점: {movie_stats_df.agg(F.avg('avg_rating')).collect()[0][0]:.3f}")

print("\n" + "=" * 70)

print("✅ Silver Layer 변환 완료!")

print("=" * 70)output

======================================================================

📊 Silver Layer 데이터 품질 리포트

======================================================================

📌 silver_movies:

Rows: 500

Columns: 15

📌 silver_users:

Rows: 1,000

Columns: 14

📌 silver_ratings:

Rows: 9,533

Columns: 13

📌 silver_tags:

Rows: 1,000

Columns: 9

📌 silver_user_stats:

Rows: 1,000

Columns: 13

📌 silver_movie_stats:

Rows: 500

Columns: 10

📈 평점 통계:

총 평점 수: 9,533

평균 평점: 4.095

평점 표준편차: 0.733

👤 사용자 통계:

사용자당 평균 평점 수: 9.5

사용자당 평균 평점: 4.087

🎬 영화 통계:

영화당 평균 평점 수: 19.1

영화 평균 평점: 4.124

======================================================================

✅ Silver Layer 변환 완료!

======================================================================생성된 Silver 테이블

| 테이블 | 설명 |

|---|---|

silver_movies | 영화 메타데이터 + 피처 |

silver_users | 사용자 프로필 + 피처 |

silver_ratings | 평점 + 시간/카테고리 피처 |

silver_tags | 태그 + 감성 분류 |

silver_user_stats | 사용자별 집계 통계 |

silver_movie_stats | 영화별 집계 통계 + 베이지안 평균 |

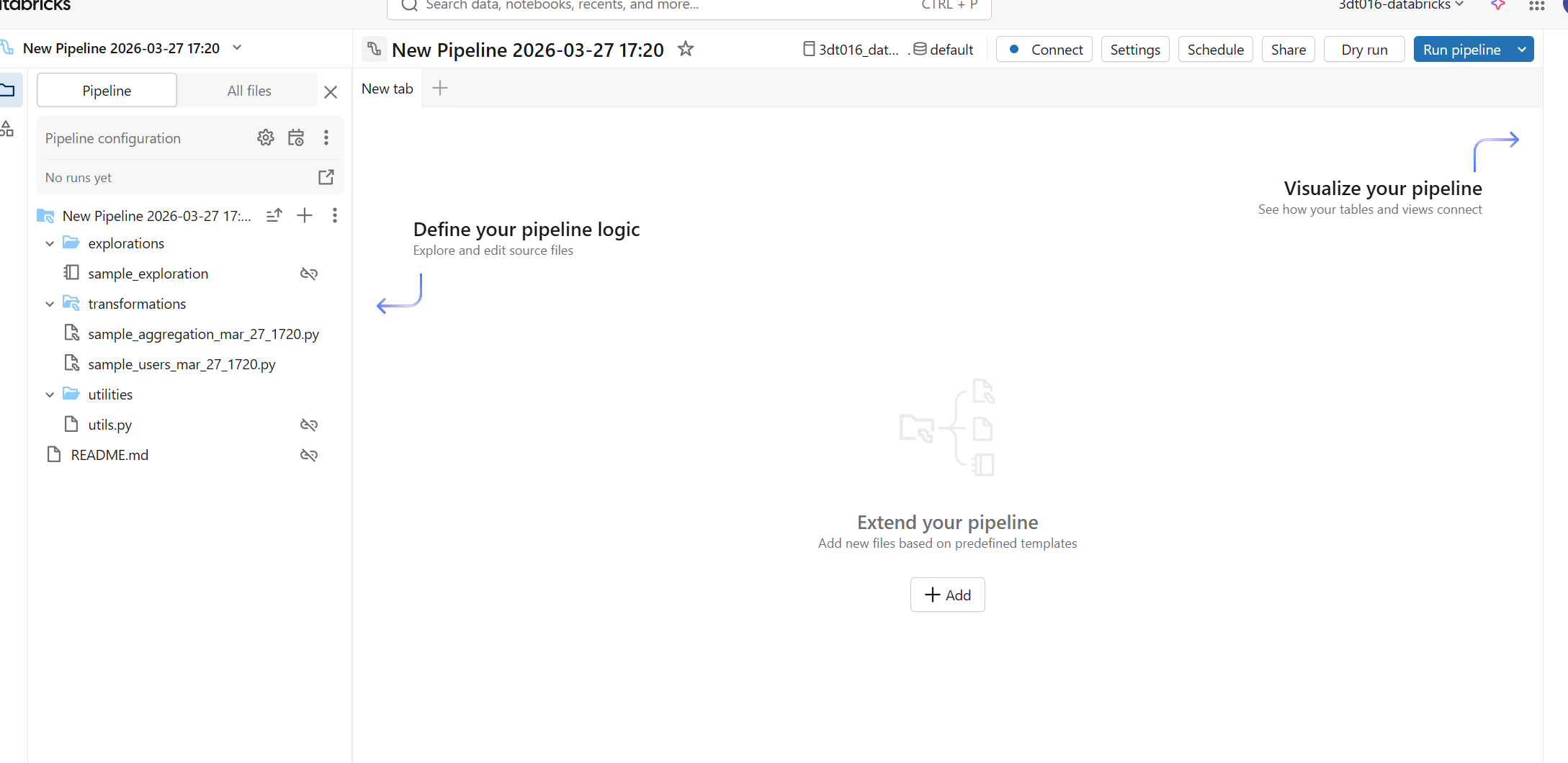

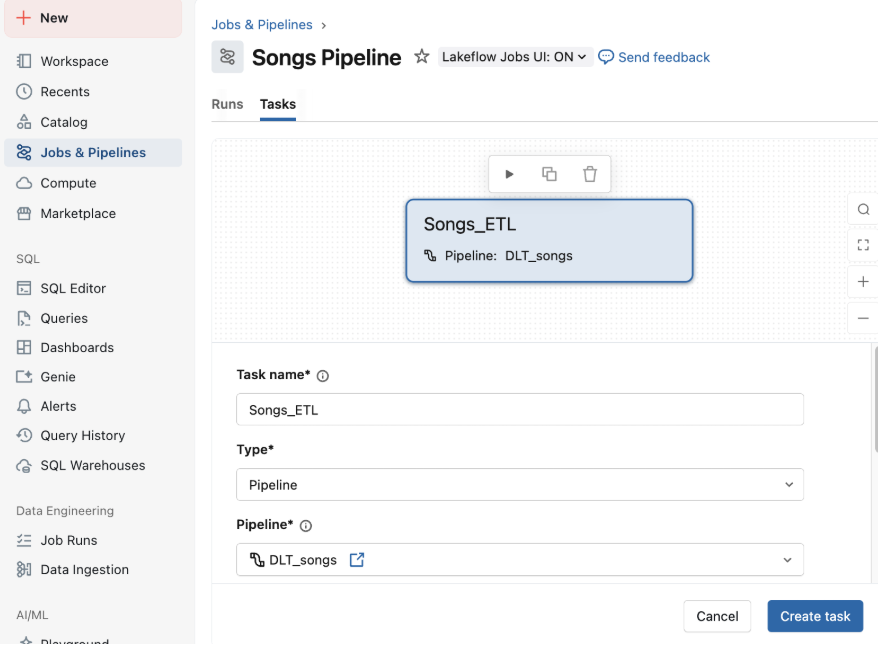

Gold Layer & ALS 추천 모델 훈련

비즈니스 집계 테이블을 생성하고 ALS (Alternating Least Squares) 협업 필터링 모델을 훈련합니다.

주요 내용

- Gold Layer 집계 테이블 — 장르별 인기도, 연도별 트렌드, Top 영화 리더보드

- ALS 모델 훈련 — Spark MLlib의 ALS 알고리즘

- 하이퍼파라미터 튜닝 — MLflow 실험 추적 기반 그리드 서치

- 모델 평가 및 등록 — RMSE/MAE 평가, MLflow Model Registry 등록

- 추천 결과 생성 — 모든 사용자에 대한 Top-N 추천

ALS (Alternating Least Squares) 알고리즘이란?

협업 필터링의 대표적 행렬 분해(Matrix Factorization) 기법입니다.

- 사용자-영화 평점 행렬을 사용자 잠재 요인 × 영화 잠재 요인으로 분해

- 누락된 평점을 예측하여 추천에 활용

- Spark MLlib에서 대규모 분산 처리를 지원

메달리온 아키텍처에서의 위치

Bronze (원시) → Silver (정제) → Gold (집계/ML)

↑ 현재 위치1. 환경 설정

from pyspark.sql import functions as F

from pyspark.sql.window import Window

from pyspark.ml.recommendation import ALS

from pyspark.ml.evaluation import RegressionEvaluator

from pyspark.ml.tuning import ParamGridBuilder, CrossValidator

import mlflow

import mlflow.spark

from datetime import datetime

# ============================================================

# ⚠️ 카탈로그 이름과 USERNAME을 본인 정보로 변경하세요!

# ============================================================

CATALOG = "3dt016_databricks"

SCHEMA = "movie_recommender"

spark.sql(f"USE {CATALOG}.{SCHEMA}")

# MLflow 실험 설정

# USERNAME: Databricks 워크스페이스 이메일 주소

USERNAME = spark.sql("SELECT current_user()").collect()[0][0]

EXPERIMENT_NAME = f"/Users/{USERNAME}/movie-recommender-als"

mlflow.set_experiment(EXPERIMENT_NAME)

print(f"✅ 환경 설정 완료")

print(f" 카탈로그: {CATALOG}.{SCHEMA}")

print(f" 사용자: {USERNAME}")

print(f" MLflow 실험: {EXPERIMENT_NAME}")output

2026/03/27 02:06:06 INFO mlflow.tracking.fluent: Experiment with name '/Users/3dt016@msacademy.msai.kr/movie-recommender-als' does not exist. Creating a new experiment.✅ 환경 설정 완료

카탈로그: 3dt016_databricks.movie_recommender

사용자: 3dt016@msacademy.msai.kr

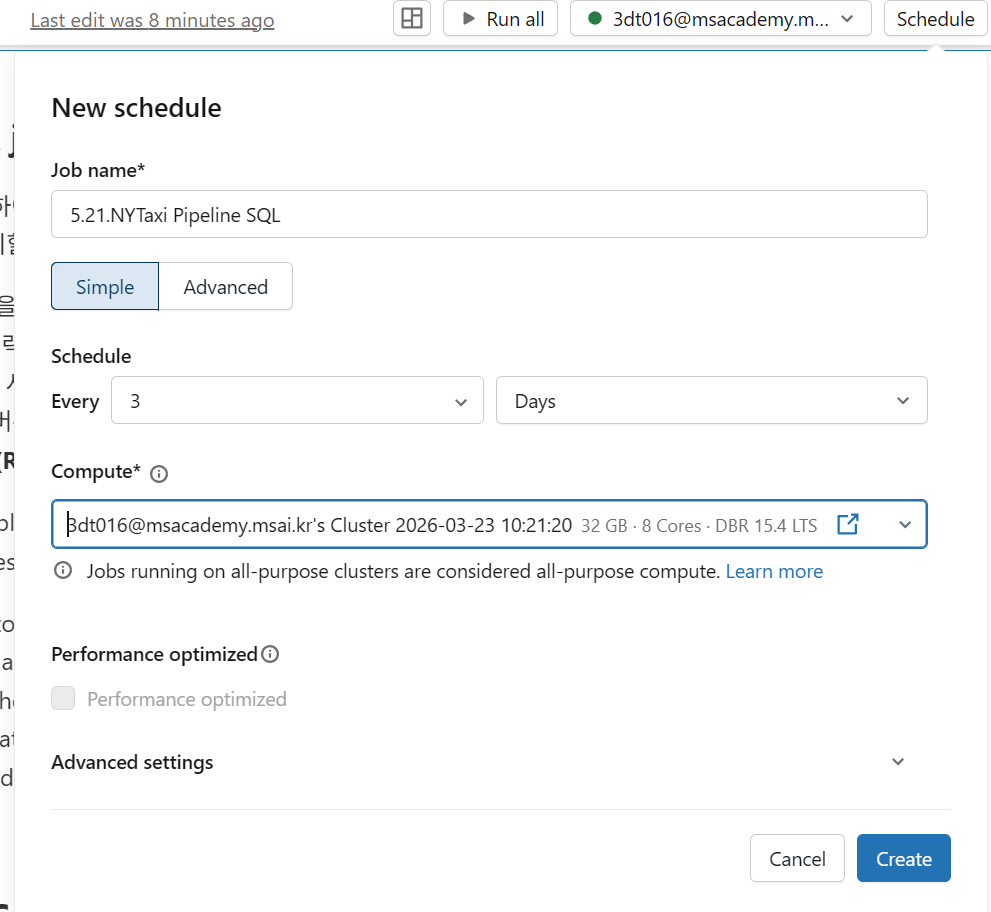

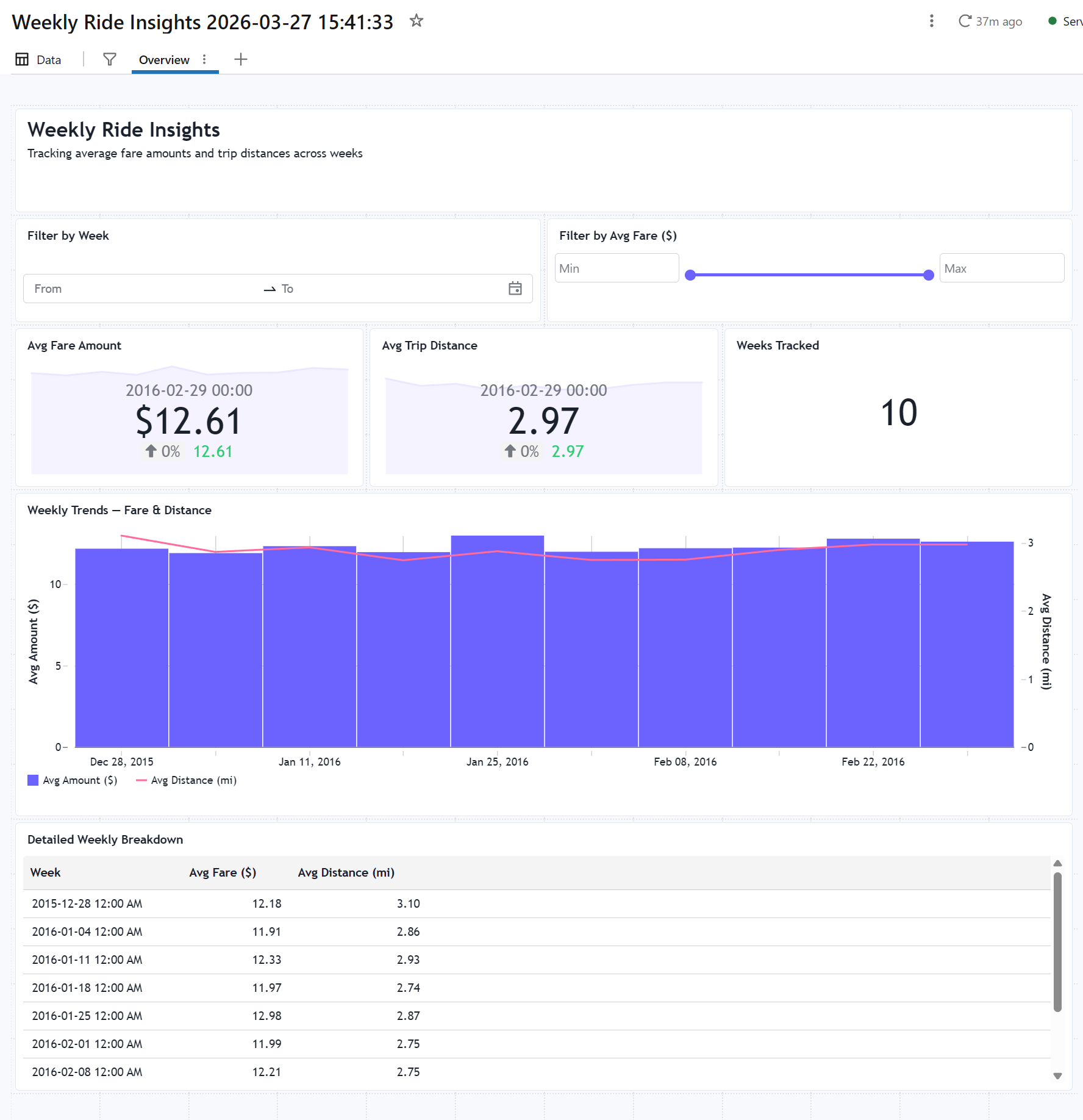

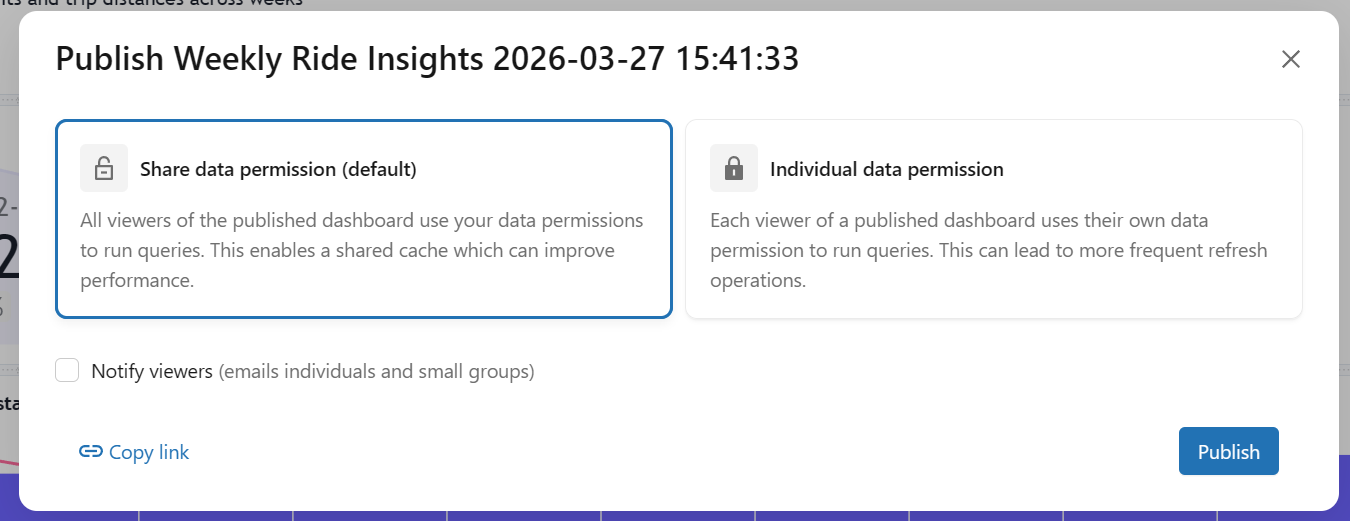

MLflow 실험: /Users/3dt016@msacademy.msai.kr/movie-recommender-als2. Gold Layer: 비즈니스 집계 테이블

Gold Layer는 비즈니스 분석과 대시보드를 위한 집계 테이블입니다.

Silver 데이터를 기반으로 다양한 관점의 분석 결과를 사전 계산합니다.

2.1 장르별 인기도 분석

각 장르의 총 평점 수, 평균 평점, 영화 수, 도달 사용자 수 등을 집계합니다.

popularity_score는 총 평점 수 × 평균 평점 / 5.0으로 계산한 종합 인기 지표입니다.

# Silver 데이터 로드

silver_movies = spark.table("silver_movies")

silver_ratings = spark.table("silver_ratings")

silver_movie_stats = spark.table("silver_movie_stats")

# 영화-평점 조인 (장르 분석을 위해)

movie_ratings = (

silver_ratings

.join(silver_movies.select("movie_id", "genres_array", "year", "decade"), "movie_id")

)

# 장르 Explode: 한 영화가 여러 장르에 속할 수 있으므로 행을 펼침

# 예: ["Action", "Comedy"] → Action 행 1개 + Comedy 행 1개

gold_genre_popularity = (

movie_ratings

.withColumn("genre", F.explode("genres_array"))

.groupBy("genre")

.agg(

F.count("*").alias("total_ratings"),

F.avg("rating").alias("avg_rating"),

F.countDistinct("movie_id").alias("movie_count"),

F.countDistinct("user_id").alias("user_reach"),

F.sum("is_positive").alias("positive_ratings")

)

.withColumn("positive_ratio", F.col("positive_ratings") / F.col("total_ratings"))

.withColumn("popularity_score",

F.round((F.col("total_ratings") * F.col("avg_rating") / 5.0), 2)

)

.orderBy(F.desc("popularity_score"))

)

gold_genre_popularity.write.format("delta").mode("overwrite").saveAsTable("gold_genre_popularity")

print("✅ gold_genre_popularity 저장 완료")

display(gold_genre_popularity)output

✅ gold_genre_popularity 저장 완료| genre | total_ratings | avg_rating | movie_count | user_reach | positive_ratings | positive_ratio | popularity_score |

|---|---|---|---|---|---|---|---|

| Film-Noir | 1707 | 4.12888107791447 | 79 | 613 | 1223 | 0.7164616285881664 | 1409.6 |

| Crime | 1681 | 3.988399762046401 | 73 | 628 | 1069 | 0.635930993456276 | 1340.9 |

| Western | 1541 | 4.2193380921479555 | 76 | 590 | 1174 | 0.7618429591174561 | 1300.4 |

| Drama | 1500 | 4.101666666666667 | 72 | 582 | 1046 | 0.6973333333333334 | 1230.5 |

| Comedy | 1435 | 4.242508710801394 | 76 | 568 | 1092 | 0.7609756097560976 | 1217.6 |

| Romance | 1417 | 4.172194777699365 | 79 | 587 | 1035 | 0.7304163726182075 | 1182.4 |

| Animation | 1342 | 4.254843517138599 | 78 | 560 | 1029 | 0.7667660208643815 | 1142.0 |

| Mystery | 1377 | 4.122730573710966 | 67 | 575 | 948 | 0.6884531590413944 | 1135.4 |

| Horror | 1329 | 4.165537998495109 | 81 | 549 | 964 | 0.7253574115876599 | 1107.2 |

| Documentary | 1292 | 4.251547987616099 | 57 | 547 | 988 | 0.7647058823529411 | 1098.6 |

| Sci-Fi | 1371 | 3.9956236323851204 | 58 | 587 | 865 | 0.6309263311451495 | 1095.6 |

| Action | 1348 | 4.048961424332345 | 68 | 571 | 892 | 0.6617210682492581 | 1091.6 |

| Fantasy | 1334 | 4.049100449775112 | 74 | 564 | 905 | 0.6784107946026986 | 1080.3 |

| Adventure | 1305 | 4.054022988505747 | 74 | 546 | 868 | 0.6651340996168582 | 1058.1 |

| Thriller | 1218 | 4.211001642036125 | 71 | 507 | 907 | 0.7446633825944171 | 1025.8 |

| Musical | 1232 | 3.9326298701298703 | 58 | 558 | 730 | 0.5925324675324676 | 969.0 |

| Children | 1147 | 4.195727986050566 | 74 | 487 | 844 | 0.7358326068003488 | 962.5 |

| War | 1082 | 4.203789279112754 | 69 | 500 | 807 | 0.7458410351201479 | 909.7 |

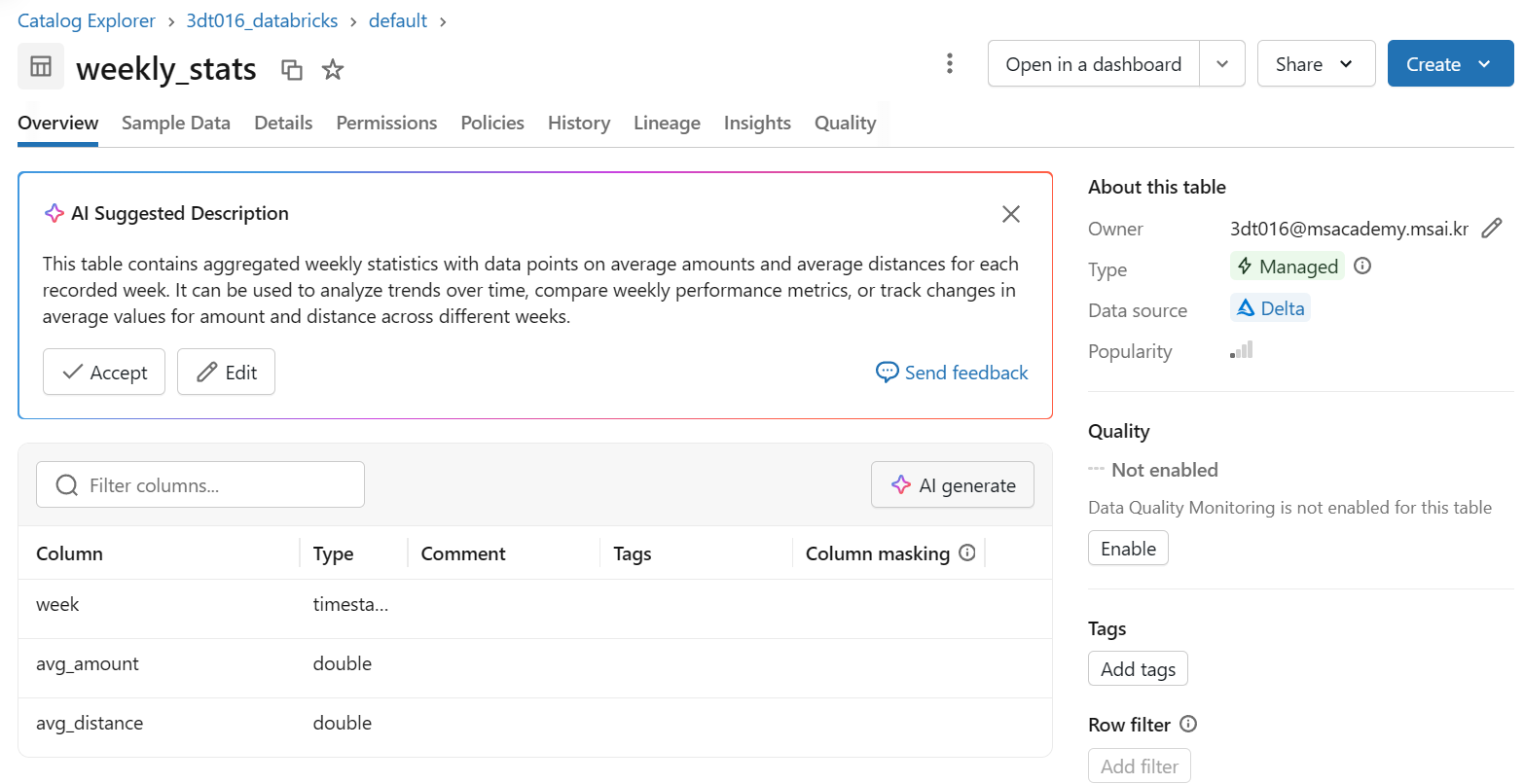

2.2 연도별 트렌드 분석

영화 개봉 연도별 평점 패턴을 분석합니다.

gold_yearly_trends = (

movie_ratings

.groupBy("year")

.agg(

F.count("*").alias("total_ratings"),

F.avg("rating").alias("avg_rating"),

F.countDistinct("movie_id").alias("movies_rated"),

F.countDistinct("user_id").alias("active_users")

)

.withColumn("ratings_per_movie", F.col("total_ratings") / F.col("movies_rated"))

.orderBy("year")

)

gold_yearly_trends.write.format("delta").mode("overwrite").saveAsTable("gold_yearly_trends")

print("✅ gold_yearly_trends 저장 완료")output

✅ gold_yearly_trends 저장 완료2.3 Top 영화 리더보드

베이지안 평균 기준 Top 100 영화 리더보드를 생성합니다.

- MIN_RATINGS = 5: 최소 5개 이상의 평점을 받은 영화만 포함 (신뢰성 확보)

- 베이지안 평균을 사용하므로 평점 수가 적은 영화의 과대평가를 방지

# 최소 평가 수 필터 (신뢰성 확보)

MIN_RATINGS = 5

gold_top_movies = (

silver_movie_stats

.filter(F.col("total_ratings") >= MIN_RATINGS)

.join(silver_movies.select("movie_id", "title", "year", "genres", "director"), "movie_id")

.withColumn("rank", F.row_number().over(

Window.orderBy(F.desc("bayesian_avg"))

))

.filter(F.col("rank") <= 100) # Top 100

.select(

"rank", "movie_id", "title", "year", "genres", "director",

"total_ratings",

F.round("avg_rating", 2).alias("avg_rating"),

F.round("bayesian_avg", 2).alias("bayesian_avg"),

F.round("positive_ratio", 2).alias("positive_ratio")

)

)

gold_top_movies.write.format("delta").mode("overwrite").saveAsTable("gold_top_movies")

print("✅ gold_top_movies 저장 완료")

display(gold_top_movies.limit(20))output

✅ gold_top_movies 저장 완료| rank | movie_id | title | year | genres | director | total_ratings | avg_rating | bayesian_avg | positive_ratio |

|---|---|---|---|---|---|---|---|---|---|

| 1 | 407 | Shadow of Knight (2012) | 2012 | Drama | Denis Villeneuve | 98 | 4.6 | 4.45 | 0.93 |

| 2 | 394 | Fire of Destiny (1999) | 1999 | Documentary|Drama|Comedy|Action | Bong Joon-ho | 64 | 4.66 | 4.44 | 0.95 |

| 3 | 4 | Kingdom Fire (2001) | 2001 | Action|Crime|Romance | Wes Anderson | 143 | 4.52 | 4.42 | 0.9 |

| 4 | 207 | Storm: Dark Ocean (2001) | 2001 | Mystery | Wong Kar-wai | 49 | 4.69 | 4.41 | 0.96 |

| 5 | 120 | Destiny Dream (2012) | 2012 | Sci-Fi|Horror|Documentary|Musical | David Fincher | 30 | 4.82 | 4.36 | 1.0 |

| 6 | 81 | Lost Knight (2003) | 2003 | Mystery|Western|Documentary | Martin Scorsese | 30 | 4.8 | 4.35 | 1.0 |

| 7 | 204 | Rise of Soul (2003) | 2003 | Animation|Children|Thriller|Film-Noir | Stanley Kubrick | 25 | 4.86 | 4.33 | 1.0 |

| 8 | 199 | Storm: Return of Warrior (1984) | 1984 | War|Comedy|Romance|Adventure | David Fincher | 24 | 4.88 | 4.32 | 1.0 |

| 9 | 224 | Empire Forest (2001) | 2001 | Thriller|Documentary|Children | Denis Villeneuve | 41 | 4.61 | 4.29 | 0.88 |

| 10 | 464 | Soul: Secret Heart (1993) | 1993 | Documentary | Wes Anderson | 33 | 4.67 | 4.28 | 0.94 |

| 11 | 45 | Phoenix: Last Ocean (1979) | 1979 | Western|Action|Children|Adventure | Denis Villeneuve | 31 | 4.68 | 4.27 | 1.0 |

| 12 | 238 | Fire of Soul (1979) | 1979 | Sci-Fi|Documentary|Horror|Film-Noir | Denis Villeneuve | 73 | 4.42 | 4.25 | 0.92 |

| 13 | 113 | Dawn Empire (1991) | 1991 | Western|Comedy|Film-Noir | Park Chan-wook | 163 | 4.33 | 4.25 | 0.83 |

| 14 | 69 | Return of Dragon (2017) | 2017 | Mystery|Comedy | James Cameron | 37 | 4.58 | 4.24 | 0.89 |

| 15 | 351 | Dragon Empire (1981) | 1981 | Western|War|Thriller|Documentary | Wong Kar-wai | 49 | 4.49 | 4.24 | 0.96 |

| 16 | 116 | Shadow City (1997) | 1997 | Thriller|Film-Noir | Francis Ford Coppola | 94 | 4.36 | 4.23 | 0.81 |

| 17 | 160 | Destiny: Return of World (2002) | 2002 | Animation|Western|War|Adventure | Bong Joon-ho | 22 | 4.77 | 4.22 | 1.0 |

| 18 | 123 | Shadow: Last Shadow (2017) | 2017 | Action|Comedy|Romance|Thriller | Denis Villeneuve | 20 | 4.8 | 4.2 | 1.0 |

| 19 | 139 | Kingdom of World (2012) | 2012 | Western|Musical|Animation|Mystery | Alfonso Cuarón | 168 | 4.27 | 4.2 | 0.79 |

| 20 | 333 | Storm Fire (2004) | 2004 | Mystery|War|Romance|Fantasy | Steven Spielberg | 21 | 4.76 | 4.19 | 1.0 |

2.4 확장 분석: 장르별/최근/감성 기반 Top-N

추가 Gold 테이블을 생성합니다:

1. 장르별 Top 10: 각 장르 내에서 bayesian_avg 기준 최고 영화

2. 최근 인기 Top 10: 최근 12개월 내 평가된 영화 중 최고

3. 감성 기반 Top 10: positive_ratio (긍정 평점 비율) 기준 최고

from pyspark.sql.functions import current_date, date_sub

TOP_N = 10

RECENT_MONTHS = 12

# ============================

# 1. 장르별 Top-N

# ============================

# 영화의 장르를 펼쳐서 장르별 랭킹 생성

genre_exploded = (

silver_movies

.withColumn("genre", F.explode("genres_array"))

.select("movie_id", "title", "year", "director", "genre")

)

genre_join = (

silver_movie_stats

.filter(F.col("total_ratings") >= MIN_RATINGS)

.join(genre_exploded, "movie_id")

)

# 장르 내에서 bayesian_avg 기준 순위 부여

genre_window = Window.partitionBy("genre").orderBy(F.desc("bayesian_avg"))

gold_genre_top = (

genre_join

.withColumn("rank", F.row_number().over(genre_window))

.filter(F.col("rank") <= TOP_N)

.select(

"rank", "genre", "movie_id", "title", "year", "director",

"total_ratings", F.round("avg_rating", 2).alias("avg_rating"),

F.round("bayesian_avg", 2).alias("bayesian_avg"),

F.round("positive_ratio", 2).alias("positive_ratio")

)

)

gold_genre_top.write.format("delta").mode("overwrite").saveAsTable("gold_genre_top_movies")

print("✅ gold_genre_top_movies 저장 완료")

# ============================

# 2. 최근 인기 Top-N

# ============================

recent_cutoff = date_sub(current_date(), RECENT_MONTHS * 30)

recent_ratings = silver_ratings.filter(F.col("rating_date") >= recent_cutoff)

recent_movie_stats = (

recent_ratings

.groupBy("movie_id")

.agg(

F.count("*").alias("recent_ratings_count"),

F.avg("rating").alias("recent_avg_rating"),

F.sum("is_positive").alias("recent_positive_ratings")

)

.filter(F.col("recent_ratings_count") >= MIN_RATINGS)

.join(silver_movies.select("movie_id", "title", "year", "director"), "movie_id")

)

recent_window = Window.orderBy(F.desc("recent_avg_rating"))

gold_recent_top = (

recent_movie_stats

.withColumn("rank", F.row_number().over(recent_window))

.filter(F.col("rank") <= TOP_N)

.select(

"rank", "movie_id", "title", "year", "director",

"recent_ratings_count",

F.round("recent_avg_rating", 2).alias("recent_avg_rating"),

F.round(F.col("recent_positive_ratings") / F.col("recent_ratings_count"), 2).alias("recent_positive_ratio")

)

)

gold_recent_top.write.format("delta").mode("overwrite").saveAsTable("gold_recent_top_movies")

print("✅ gold_recent_top_movies 저장 완료")

# ============================

# 3. 감성 기반 Top-N (positive_ratio 기준)

# ============================

sentiment_window = Window.orderBy(F.desc("positive_ratio"))

gold_sentiment_top = (

silver_movie_stats

.filter(F.col("total_ratings") >= MIN_RATINGS)

.join(silver_movies.select("movie_id", "title", "year", "director"), "movie_id")

.withColumn("rank", F.row_number().over(sentiment_window))

.filter(F.col("rank") <= TOP_N)

.select(

"rank", "movie_id", "title", "year", "director",

"total_ratings", F.round("avg_rating", 2).alias("avg_rating"),

F.round("bayesian_avg", 2).alias("bayesian_avg"),

F.round("positive_ratio", 2).alias("positive_ratio")

)

)

gold_sentiment_top.write.format("delta").mode("overwrite").saveAsTable("gold_sentiment_top_movies")

print("✅ gold_sentiment_top_movies 저장 완료")output

✅ gold_genre_top_movies 저장 완료

✅ gold_recent_top_movies 저장 완료

✅ gold_sentiment_top_movies 저장 완료3. 추천 모델 데이터 준비

ALS 모델 훈련을 위해 평점 데이터를 Train/Test 세트로 분할합니다.

- 80/20 분할: 80%는 훈련, 20%는 평가

- seed=42: 재현 가능한 분할

- 캐싱: 반복 사용되는 데이터를 메모리에 캐싱하여 성능 향상

# 평점 데이터 로드 (ML에 필요한 3개 컬럼만 선택)

ratings = (

spark.table("silver_ratings")

.select("user_id", "movie_id", "rating")

)

print(f"📊 전체 평점 수: {ratings.count():,}")

# Train/Test 분할 (80/20)

train_data, test_data = ratings.randomSplit([0.8, 0.2], seed=42)

print(f" 훈련 데이터: {train_data.count():,}")

print(f" 테스트 데이터: {test_data.count():,}")

# 메모리 캐싱 (반복 접근 시 성능 향상)

train_data.cache()

test_data.cache()output

📊 전체 평점 수: 9,533

훈련 데이터: 7,711

테스트 데이터: 1,822DataFrame[user_id: bigint, movie_id: bigint, rating: double]4. ALS 모델 훈련

ALS 주요 파라미터

| 파라미터 | 설명 | 기본값 |

|---|---|---|

| rank | 잠재 요인의 차원 수 (높을수록 표현력 ↑, 과적합 위험 ↑) | 10 |

| regParam | L2 정규화 강도 (높을수록 과적합 방지, 편향 ↑) | 0.1 |

| maxIter | 최대 반복 횟수 | 10 |

| coldStartStrategy | 새 사용자/영화 처리 방법 ("drop": NaN 예측 제거) | "nan" |

| nonnegative | 비음수 제약 (평점은 양수이므로 True 권장) | False |

4.1 기본 ALS 모델 정의

# ALS 모델 정의

als = ALS(

userCol="user_id",

itemCol="movie_id",

ratingCol="rating",

coldStartStrategy="drop", # Cold start 시 NaN 예측을 제거 (평가 시 오류 방지)

nonnegative=True # 비음수 제약 (평점은 항상 양수)

)

# 평가 메트릭: RMSE (Root Mean Square Error)

evaluator = RegressionEvaluator(

metricName="rmse",

labelCol="rating",

predictionCol="prediction"

)4.2 하이퍼파라미터 튜닝 with MLflow

그리드 서치(Grid Search) 를 통해 최적의 하이퍼파라미터 조합을 찾습니다.

각 조합의 결과는 MLflow에 자동으로 기록됩니다.

테스트할 파라미터 조합:

- rank: [10, 20, 50] — 잠재 요인 차원 수

- regParam: [0.01, 0.1, 0.5] — 정규화 강도

- maxIter: [10, 20] — 반복 횟수

총 3 × 3 × 2 = 18개 조합을 테스트합니다.

# 파라미터 그리드 정의

param_grid = (

ParamGridBuilder()

.addGrid(als.rank, [10, 20, 50])

.addGrid(als.regParam, [0.01, 0.1, 0.5])

.addGrid(als.maxIter, [10, 20])

.build()

)

print(f"🔍 총 {len(param_grid)}개 파라미터 조합 테스트")output

🔍 총 18개 파라미터 조합 테스트4.3 수동 그리드 서치 실행

MLflow의 중첩 실행(Nested Runs) 을 활용하여 모든 조합을 추적합니다.

- Parent Run: 전체 그리드 서치 실험

- Child Run: 각 파라미터 조합의 개별 실험

실행 완료 후 MLflow UI (Experiments 탭)에서 결과를 시각적으로 비교할 수 있습니다.

# 수동 그리드 서치 with MLflow 추적

best_rmse = float("inf")

best_model = None

best_params = {}

with mlflow.start_run(run_name="ALS_GridSearch") as parent_run:

# 데이터셋 정보를 Parent Run에 기록

mlflow.log_param("dataset_size", train_data.count())

mlflow.log_param("n_users", train_data.select("user_id").distinct().count())

mlflow.log_param("n_movies", train_data.select("movie_id").distinct().count())

for i, params in enumerate(param_grid):

rank = params[als.rank]

reg_param = params[als.regParam]

max_iter = params[als.maxIter]

run_name = f"rank{rank}_reg{reg_param}_iter{max_iter}"

with mlflow.start_run(run_name=run_name, nested=True):

# 파라미터 로깅

mlflow.log_params({

"rank": rank,

"regParam": reg_param,

"maxIter": max_iter

})

# 모델 훈련

als_model = als.setParams(

rank=rank,

regParam=reg_param,

maxIter=max_iter

)

model = als_model.fit(train_data)

# 테스트 데이터로 평가

predictions = model.transform(test_data)

rmse = evaluator.evaluate(predictions)

# 메트릭 로깅

mlflow.log_metric("rmse", rmse)

print(f"[{i+1}/{len(param_grid)}] {run_name}: RMSE = {rmse:.4f}")

# Best 모델 업데이트

if rmse < best_rmse:

best_rmse = rmse

best_model = model

best_params = {"rank": rank, "regParam": reg_param, "maxIter": max_iter}

# Parent Run에 최종 결과 기록

mlflow.log_metric("best_rmse", best_rmse)

mlflow.log_params({f"best_{k}": v for k, v in best_params.items()})

print(f"\n🏆 Best 모델:")

print(f" 파라미터: {best_params}")

print(f" RMSE: {best_rmse:.4f}")output

[1/18] rank10_reg0.01_iter10: RMSE = 0.8403

[2/18] rank10_reg0.01_iter20: RMSE = 0.7987

[3/18] rank10_reg0.1_iter10: RMSE = 0.6702

[4/18] rank10_reg0.1_iter20: RMSE = 0.6686

[5/18] rank10_reg0.5_iter10: RMSE = 0.7810

[6/18] rank10_reg0.5_iter20: RMSE = 0.7801

[7/18] rank20_reg0.01_iter10: RMSE = 0.7968

[8/18] rank20_reg0.01_iter20: RMSE = 0.7885

[9/18] rank20_reg0.1_iter10: RMSE = 0.6612

[10/18] rank20_reg0.1_iter20: RMSE = 0.6646

[11/18] rank20_reg0.5_iter10: RMSE = 0.7814

[12/18] rank20_reg0.5_iter20: RMSE = 0.7801

[13/18] rank50_reg0.01_iter10: RMSE = 0.8259

[14/18] rank50_reg0.01_iter20: RMSE = 0.8039

[15/18] rank50_reg0.1_iter10: RMSE = 0.6535

[16/18] rank50_reg0.1_iter20: RMSE = 0.6596

[17/18] rank50_reg0.5_iter10: RMSE = 0.7815

[18/18] rank50_reg0.5_iter20: RMSE = 0.7801

🏆 Best 모델:

파라미터: {'rank': 50, 'regParam': 0.1, 'maxIter': 10}

RMSE: 0.65354.4 최종 모델 훈련 및 MLflow 등록

Best 파라미터로 전체 데이터(train + test) 를 사용하여 최종 모델을 훈련합니다.

MLflow Model Registry

- 훈련된 모델을 Unity Catalog Model Registry에 등록합니다

- 등록된 모델은 버전 관리가 되며, 이후 Serving 엔드포인트에 배포할 수 있습니다

Model Signature

- 입력:

user_id,movie_id(예측 시에는 rating 불필요) - 출력:

prediction(예측 평점) - Signature를 등록하면 MLflow UI에서 모델의 입출력 스키마를 확인할 수 있습니다

from mlflow.models.signature import infer_signature

# Best 파라미터로 최종 모델 설정

final_als = ALS(

userCol="user_id",

itemCol="movie_id",

ratingCol="rating",

coldStartStrategy="drop",

nonnegative=True,

**best_params

)

# 전체 데이터로 재훈련 (정보 손실 방지)

full_data = train_data.union(test_data)

final_model = final_als.fit(full_data)

# Signature 생성: 예측(Inference) 시에는 rating 컬럼이 없으므로 user_id, movie_id만 입력으로 정의

sample_spark_df = full_data.select("user_id", "movie_id").limit(10)

sample_input_pandas = sample_spark_df.toPandas()

sample_output_pandas = final_model.transform(sample_spark_df).toPandas()

# 입력(user_id, movie_id) → 출력(prediction) 관계의 서명 생성

signature = infer_signature(sample_input_pandas, sample_output_pandas)

# MLflow 모델 등록 및 로깅

with mlflow.start_run(run_name="Final_ALS_Model") as run:

# 파라미터 로깅

mlflow.log_params(best_params)

# 평가 지표 로깅

mlflow.log_metric("test_rmse", best_rmse)

# 데이터셋 통계 (모델 메타데이터로 유용)

mlflow.log_metric("n_users", full_data.select("user_id").distinct().count())

mlflow.log_metric("n_movies", full_data.select("movie_id").distinct().count())

mlflow.log_metric("n_ratings", full_data.count())

# 모델 저장 + 레지스트리 등록

# input_example을 추가하면 MLflow UI에서 예제 데이터를 바로 확인 가능

mlflow.spark.log_model(

final_model,

"als_model",

registered_model_name=f"{CATALOG}.{SCHEMA}.movie_recommender_als",

signature=signature,

input_example=sample_input_pandas

)

run_id = run.info.run_id

print(f"✅ 모델 저장 및 등록 완료!")

print(f" Run ID: {run_id}")

print(f" Model Name: {CATALOG}.{SCHEMA}.movie_recommender_als")output

/databricks/python/lib/python3.11/site-packages/mlflow/types/utils.py:394: UserWarning: Hint: Inferred schema contains integer column(s). Integer columns in Python cannot represent missing values. If your input data contains missing values at inference time, it will be encoded as floats and will cause a schema enforcement error. The best way to avoid this problem is to infer the model schema based on a realistic data sample (training dataset) that includes missing values. Alternatively, you can declare integer columns as doubles (float64) whenever these columns may have missing values. See `Handling Integers With Missing Values <https://www.mlflow.org/docs/latest/models.html#handling-integers-with-missing-values>`_ for more details.

warnings.warn(

2026/03/27 02:08:47 INFO mlflow.spark: Inferring pip requirements by reloading the logged model from the databricks artifact repository, which can be time-consuming. To speed up, explicitly specify the conda_env or pip_requirements when calling log_model().Downloading artifacts: 0%| | 0/38 [00:00<?, ?it/s]2026/03/27 02:09:16 WARNING mlflow.utils.environment: Encountered an unexpected error while inferring pip requirements (model URI: dbfs:/databricks/mlflow-tracking/2225541439018367/e52eef676a2948baa43f8caa1ce344e2/artifacts/als_model/sparkml, flavor: spark). Fall back to return ['pyspark==3.5.0']. Set logging level to DEBUG to see the full traceback.

/databricks/python/lib/python3.11/site-packages/_distutils_hack/__init__.py:33: UserWarning: Setuptools is replacing distutils.

warnings.warn("Setuptools is replacing distutils.")Uploading artifacts: 0%| | 0/5 [00:00<?, ?it/s]Successfully registered model '3dt016_databricks.movie_recommender.movie_recommender_als'.Downloading artifacts: 0%| | 0/43 [00:00<?, ?it/s]Uploading artifacts: 0%| | 0/43 [00:00<?, ?it/s]✅ 모델 저장 및 등록 완료!

Run ID: e52eef676a2948baa43f8caa1ce344e2

Model Name: 3dt016_databricks.movie_recommender.movie_recommender_alsCreated version '1' of model '3dt016_databricks.movie_recommender.movie_recommender_als'.5. 모델 평가 및 분석

5.1 전체 평가 메트릭

| 메트릭 | 설명 | 좋은 수준 |

|---|---|---|

| RMSE | 평균 제곱근 오차 (큰 오차에 민감) | < 1.0 |

| MAE | 평균 절대 오차 (직관적 해석 용이) | < 0.8 |

# 테스트 데이터로 최종 모델 예측

test_predictions = final_model.transform(test_data)

# RMSE (Root Mean Square Error)

rmse = evaluator.evaluate(test_predictions)

print(f"📊 RMSE: {rmse:.4f}")

# MAE (Mean Absolute Error)

mae_evaluator = RegressionEvaluator(

metricName="mae",

labelCol="rating",

predictionCol="prediction"

)

mae = mae_evaluator.evaluate(test_predictions)

print(f"📊 MAE: {mae:.4f}")

# 예측 vs 실제 분포 통계

display(

test_predictions

.select("rating", "prediction")

.withColumn("error", F.abs(F.col("prediction") - F.col("rating")))

.describe()

)output

📊 RMSE: 0.2747

📊 MAE: 0.2154| summary | rating | prediction | error |

|---|---|---|---|

| count | 1822 | 1822 | 1822 |

| mean | 4.110043907793633 | 4.01694546939251 | 0.2153937526120836 |

| stddev | 0.7388884733133042 | 0.5972829604503972 | 0.17055639174896156 |

| min | 1.5 | 1.8996191 | 6.318092346191406E-5 |

| max | 5.0 | 5.1576366 | 1.3421881198883057 |

5.2 사용자 활동량별 추천 품질

평점을 많이 남긴 사용자일수록 모델이 더 정확하게 예측하는지 확인합니다.

일반적으로 데이터가 많은 사용자(Heavy)의 RMSE가 낮고,

데이터가 적은 사용자(Light)의 RMSE가 높습니다.

# 사용자 그룹별 RMSE 분석

user_stats = spark.table("silver_user_stats")

user_rmse = (

test_predictions

.join(user_stats.select("user_id", "total_ratings"), "user_id")

.withColumn("user_activity_group",

F.when(F.col("total_ratings") < 30, "Light") # 30개 미만

.when(F.col("total_ratings") < 100, "Medium") # 30~100개

.otherwise("Heavy") # 100개 이상

)

.groupBy("user_activity_group")

.agg(

F.sqrt(F.avg(F.pow(F.col("prediction") - F.col("rating"), 2))).alias("rmse"),

F.count("*").alias("n_predictions")

)

)

print("📊 사용자 활동량별 RMSE:")

display(user_rmse)output

📊 사용자 활동량별 RMSE:| user_activity_group | rmse | n_predictions |

|---|---|---|

| Medium | 0.3317599043437797 | 577 |

| Light | 0.24379096999878566 | 1245 |

6. 추천 결과 생성

6.1 모든 사용자에 대한 Top-10 추천

recommendForAllUsers(N) 메서드는 모든 사용자에 대해 예측 평점이 가장 높은 N개 영화를 추천합니다.

결과를 Explode하여 사용자-영화 단위의 테이블로 저장합니다.

# 모든 사용자에 대해 Top 10 영화 추천

user_recommendations = final_model.recommendForAllUsers(10)

# 중첩 배열을 Explode하여 플랫 테이블로 변환

# posexplode: 위치(rank)와 값(rec)을 동시에 추출

recommendations_exploded = (

user_recommendations

.select(

"user_id",

F.posexplode("recommendations").alias("rank", "rec")

)

.select(

"user_id",

(F.col("rank") + 1).alias("rank"), # 0-based → 1-based

F.col("rec.movie_id").alias("movie_id"),

F.col("rec.rating").alias("predicted_rating")

)

# 영화 정보 조인

.join(

spark.table("silver_movies").select("movie_id", "title", "genres"),

"movie_id"

)

)

# Gold 테이블로 저장

recommendations_exploded.write.format("delta").mode("overwrite").saveAsTable("gold_user_recommendations")

print(f"✅ gold_user_recommendations 저장 완료: {recommendations_exploded.count():,} rows")output

✅ gold_user_recommendations 저장 완료: 10,000 rows# 샘플 사용자의 추천 결과 확인

sample_user_id = 100

print(f"🎬 사용자 {sample_user_id}의 Top 10 추천:")

display(

recommendations_exploded

.filter(F.col("user_id") == sample_user_id)

.orderBy("rank")

)output

🎬 사용자 100의 Top 10 추천:| movie_id | user_id | rank | predicted_rating | title | genres |

|---|---|---|---|---|---|

| 199 | 100 | 1 | 5.1367373 | Storm: Return of Warrior (1984) | War|Comedy|Romance|Adventure |

| 190 | 100 | 2 | 5.0933404 | Destiny of Journey (2013) | Comedy|Animation|Film-Noir|Fantasy |

| 222 | 100 | 3 | 5.051916 | Thunder of Destiny (2010) | Horror|Fantasy|Drama|Adventure |

| 7 | 100 | 4 | 5.051798 | Dark Journey (2004) | Documentary|Animation|Adventure |

| 413 | 100 | 5 | 5.0260873 | Dawn Storm (1999) | Mystery|Comedy|Romance |

| 160 | 100 | 6 | 5.0128026 | Destiny: Return of World (2002) | Animation|Western|War|Adventure |

| 120 | 100 | 7 | 5.0127053 | Destiny Dream (2012) | Sci-Fi|Horror|Documentary|Musical |

| 490 | 100 | 8 | 4.9882693 | Shadow of Heart (1995) | Sci-Fi|Fantasy|Mystery|Musical |

| 498 | 100 | 9 | 4.98409 | Heart Kingdom (2012) | Sci-Fi |

| 81 | 100 | 10 | 4.976892 | Lost Knight (2003) | Mystery|Western|Documentary |

6.2 영화별 추천 대상 사용자 (Item-based)

recommendForAllItems(N)는 각 영화에 대해 가장 좋아할 것으로 예측되는 N명의 사용자를 찾습니다.

이는 마케팅 타겟팅이나 푸시 알림 대상 선정에 활용할 수 있습니다.

# 모든 영화에 대해 추천할 사용자

movie_recommendations = final_model.recommendForAllItems(10)

# Explode하여 저장

movie_recs_exploded = (

movie_recommendations

.select(

"movie_id",

F.posexplode("recommendations").alias("rank", "rec")

)

.select(

"movie_id",

(F.col("rank") + 1).alias("rank"),

F.col("rec.user_id").alias("recommended_user_id"),

F.col("rec.rating").alias("predicted_rating")

)

)

movie_recs_exploded.write.format("delta").mode("overwrite").saveAsTable("gold_movie_user_recommendations")

print(f"✅ gold_movie_user_recommendations 저장 완료")output

✅ gold_movie_user_recommendations 저장 완료7. 결과 요약

print("=" * 70)

print("📊 영화 추천 시스템 훈련 결과")

print("=" * 70)

print(f"\n🎯 모델 성능:")

print(f" RMSE: {rmse:.4f}")

print(f" MAE: {mae:.4f}")

print(f"\n⚙️ Best 하이퍼파라미터:")

for k, v in best_params.items():

print(f" {k}: {v}")

print(f"\n📦 생성된 Gold 테이블:")

gold_tables = [

"gold_genre_popularity",

"gold_yearly_trends",

"gold_top_movies",

"gold_genre_top_movies",

"gold_recent_top_movies",

"gold_sentiment_top_movies",

"gold_user_recommendations",

"gold_movie_user_recommendations"

]

for table in gold_tables:

try:

count = spark.table(table).count()

print(f" {table}: {count:,} rows")

except Exception:

print(f" {table}: (테이블 없음)")

print(f"\n🔗 MLflow Run ID: {run_id}")

print(f"🔗 MLflow 실험: {EXPERIMENT_NAME}")

print("=" * 70)output

======================================================================

📊 영화 추천 시스템 훈련 결과

======================================================================

🎯 모델 성능:

RMSE: 0.2747

MAE: 0.2154

⚙️ Best 하이퍼파라미터:

rank: 50

regParam: 0.1

maxIter: 10

📦 생성된 Gold 테이블:

gold_genre_popularity: 18 rows

gold_yearly_trends: 50 rows

gold_top_movies: 100 rows

gold_genre_top_movies: 180 rows

gold_recent_top_movies: 0 rows

gold_sentiment_top_movies: 10 rows

gold_user_recommendations: 10,000 rows

gold_movie_user_recommendations: 5,000 rows

🔗 MLflow Run ID: e52eef676a2948baa43f8caa1ce344e2

🔗 MLflow 실험: /Users/3dt016@msacademy.msai.kr/movie-recommender-als

======================================================================생성된 테이블 및 모델

| 항목 | 설명 |

|---|---|

gold_genre_popularity | 장르별 인기도 분석 |

gold_yearly_trends | 연도별 트렌드 |

gold_top_movies | Top 100 영화 리더보드 |

gold_genre_top_movies | 장르별 Top 10 영화 |

gold_user_recommendations | 사용자별 Top 10 추천 |

gold_movie_user_recommendations | 영화별 추천 대상 사용자 |

movie_recommender_als | MLflow 등록 모델 |

추천 서비스 & 고급 분석

훈련된 ALS 모델을 활용하여 실제 추천 시나리오를 구현합니다.

주요 내용

- 추천 서비스 클래스 — 모델을 래핑한 재사용 가능한 서비스 구현

- Cold Start 처리 — 신규 사용자를 위한 인기도 기반 추천

- 장르 기반 필터링 — 특정 장르 내 개인화 추천

- 유사 영화 추천 — Item-Item 유사도 기반 추천

- 추천 다양성 분석 — 커버리지, 장르 다양성, 인기도 편향

- A/B 테스트 시뮬레이션 — 두 가지 전략 비교

추천 시스템의 핵심 과제

| 과제 | 설명 | 해결 방법 |

|---|---|---|

| Cold Start | 신규 사용자에 대한 데이터 부족 | 인기도 기반 폴백(fallback) |

| 인기도 편향 | 인기 영화만 추천되는 문제 | 하이브리드 전략, 다양성 측정 |

| 커버리지 | 추천되지 않는 영화가 많은 문제 | 커버리지 분석 및 모니터링 |

1. 환경 설정 및 모델 로드

이전 노트북에서 MLflow Model Registry에 등록한 ALS 모델을 로드합니다.

# mlflow 설치 확인 (이미 설치되어 있으면 건너뜀)

%pip install mlflow --quietoutput

[31mERROR: pip's dependency resolver does not currently take into account all the packages that are installed. This behaviour is the source of the following dependency conflicts.

petastorm 0.12.1 requires pyspark>=2.1.0, which is not installed.

databricks-feature-engineering 0.8.0 requires mlflow-skinny[databricks]<3,>=2.11.0, but you have mlflow-skinny 3.10.1 which is incompatible.

databricks-feature-engineering 0.8.0 requires protobuf<5,>=3.12.0, but you have protobuf 6.33.6 which is incompatible.

google-api-core 2.18.0 requires protobuf!=3.20.0,!=3.20.1,!=4.21.0,!=4.21.1,!=4.21.2,!=4.21.3,!=4.21.4,!=4.21.5,<5.0.0.dev0,>=3.19.5, but you have protobuf 6.33.6 which is incompatible.

googleapis-common-protos 1.63.0 requires protobuf!=3.20.0,!=3.20.1,!=4.21.1,!=4.21.2,!=4.21.3,!=4.21.4,!=4.21.5,<5.0.0.dev0,>=3.19.5, but you have protobuf 6.33.6 which is incompatible.

jupyter-server 1.23.4 requires anyio<4,>=3.1.0, but you have anyio 4.13.0 which is incompatible.

msal 1.29.0 requires cryptography<45,>=2.5, but you have cryptography 46.0.6 which is incompatible.

numba 0.57.1 requires numpy<1.25,>=1.21, but you have numpy 1.26.4 which is incompatible.

oci 2.126.4 requires cryptography<43.0.0,>=3.2.1, but you have cryptography 46.0.6 which is incompatible.

proto-plus 1.24.0 requires protobuf<6.0.0dev,>=3.19.0, but you have protobuf 6.33.6 which is incompatible.

pyopenssl 23.2.0 requires cryptography!=40.0.0,!=40.0.1,<42,>=38.0.0, but you have cryptography 46.0.6 which is incompatible.

tensorboard-plugin-profile 2.15.1 requires protobuf<5.0.0dev,>=3.19.6, but you have protobuf 6.33.6 which is incompatible.

tensorflow 2.16.1 requires protobuf!=4.21.0,!=4.21.1,!=4.21.2,!=4.21.3,!=4.21.4,!=4.21.5,<5.0.0dev,>=3.20.3, but you have protobuf 6.33.6 which is incompatible.

ydata-profiling 4.5.1 requires numpy<1.24,>=1.16.0, but you have numpy 1.26.4 which is incompatible.

ydata-profiling 4.5.1 requires pydantic<2,>=1.8.1, but you have pydantic 2.12.5 which is incompatible.[0m[31m

[0m[43mNote: you may need to restart the kernel using %restart_python or dbutils.library.restartPython() to use updated packages.[0m%restart_pythonfrom pyspark.sql import functions as F

from pyspark.sql.window import Window

from pyspark.ml.recommendation import ALSModel

import mlflow

from mlflow.tracking import MlflowClient

import mlflow.spark

from typing import List, Dict, Optional

# ============================================================

# ⚠️ 카탈로그 이름을 본인의 카탈로그로 변경하세요!

# ============================================================

CATALOG = "3dt016_databricks"

SCHEMA = "movie_recommender"

spark.sql(f"USE {CATALOG}.{SCHEMA}")

# MLflow 모델 이름 (Unity Catalog 3-level namespace)

MODEL_NAME = f"{CATALOG}.{SCHEMA}.movie_recommender_als"

client = MlflowClient()

print(f"🔎 모델 검색 중: {MODEL_NAME} ...")output

🔎 모델 검색 중: 3dt016_databricks.movie_recommender.movie_recommender_als ...모델 로드 프로세스

Unity Catalog Model Registry에서 최신 버전의 모델을 검색하여 로드합니다.

모델이 없는 경우 자동으로 최근 학습 기록(MLflow Run)에서 모델을 찾아 등록을 시도합니다.

try:

# Unity Catalog에서 모델의 모든 버전을 검색

results = client.search_model_versions(f"name='{MODEL_NAME}'")

if not results:

raise Exception("모델은 등록되었으나 사용 가능한 버전이 없습니다.")

# 버전 번호 기준 내림차순 정렬 → 최신 버전 선택

sorted_versions = sorted(results, key=lambda x: int(x.version), reverse=True)

latest_version = sorted_versions[0].version

print(f"📌 최신 버전: Version {latest_version}")

# 모델 로드

model_uri = f"models:/{MODEL_NAME}/{latest_version}"

print(f"📥 로드 주소: {model_uri}")

als_model = mlflow.spark.load_model(model_uri)

print(f"✅ 모델 로드 성공!")

except Exception as e:

print(f"⚠️ 모델을 찾을 수 없습니다: {e}")