Monocular Depth Estimation (MDE) 방법론들 중에서 가장 잘 활용되어 보이는 DepthAnything

DepthAnything v1

[Depth Anything: Unleashing the Power of Large-Scale Unlabeled Data]([2401.10891] Depth Anything: Unleashing the Power of Large-Scale Unlabeled Data) (Lihe Yang, Bingyi Kang, Zilong Huang, Xiaogang Xu, Jiashi Feng, Hengshuang Zhao / CVPR, 2024)

프로젝트 페이지 : https://depth-anything.github.io/

- MDE foundation model을 만들고자 한 연구

- Depth network 학습 자체는

midas와 비슷함. midas 리뷰

- 대신에 최대한 많은 데이터 + unlabeled dataset 끌어모아서 대량의 데이터 학습하는 방법 제시

핵심 방법론

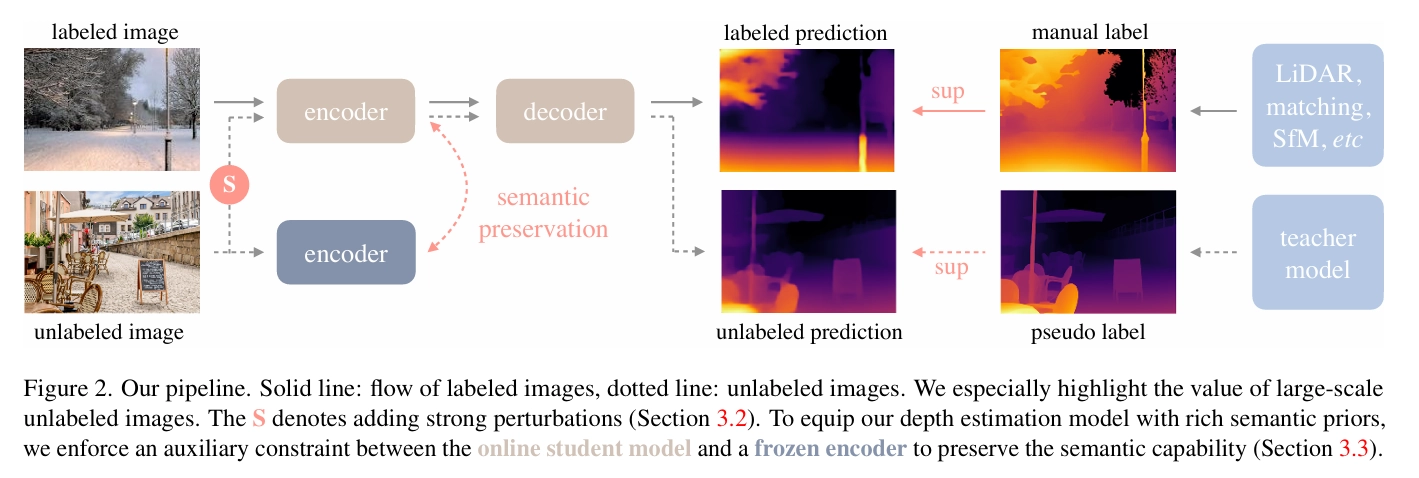

-

Harder optimization target for student network

- Unlabel dataset을 그대로 pretrained network로 inference한 pseudo-label로 곧바로 student를 학습시키면 성능 향상 없음

- 그래서 unlabel data의 경우 perturbation을 준 상태로 학습

-

Inherit rich semantic priors from pre-trained encoders

- 잘 학습된 DINOv2 네트워크 활용해서 depth network encoder에 semantic prior를 부여

- 하지만 같은 객체 내에서 깊이 차이가 나는 경우도 있기 때문에 tolerance를 둠

- 이렇게 학습된 encoder는 다른 downstream task에 대해서 기존 모델들 보다 더 semantic한 정보를 추출할 수 있게 됨

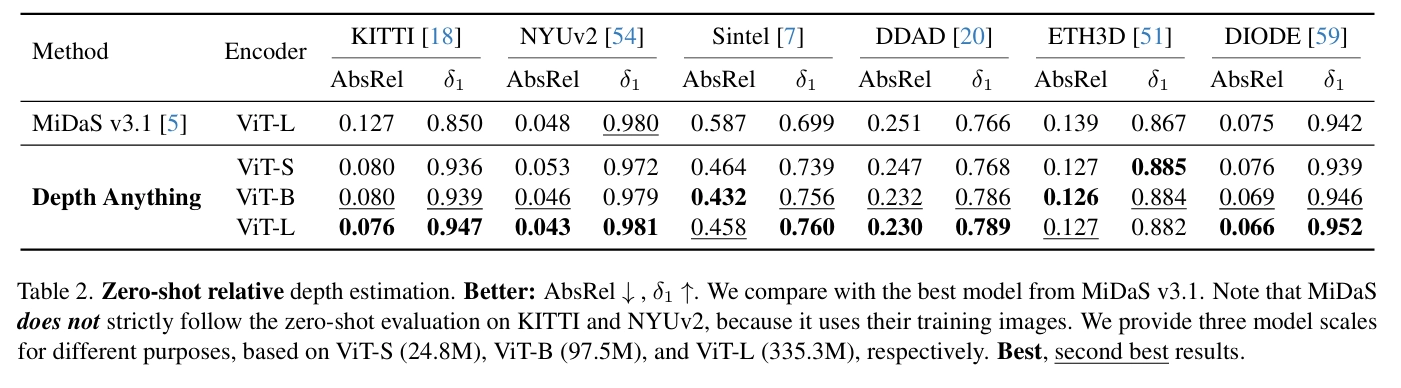

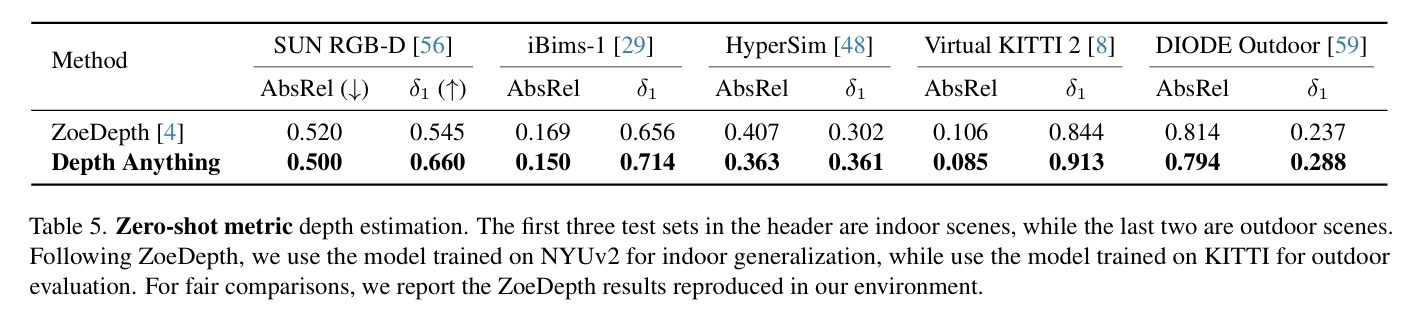

결과

- MiDaS나 zoeDepth에 비해서 꽤 쓸만한 성능

- Qualitative result는 프로젝트 페이지나 논문 참고