CS224n

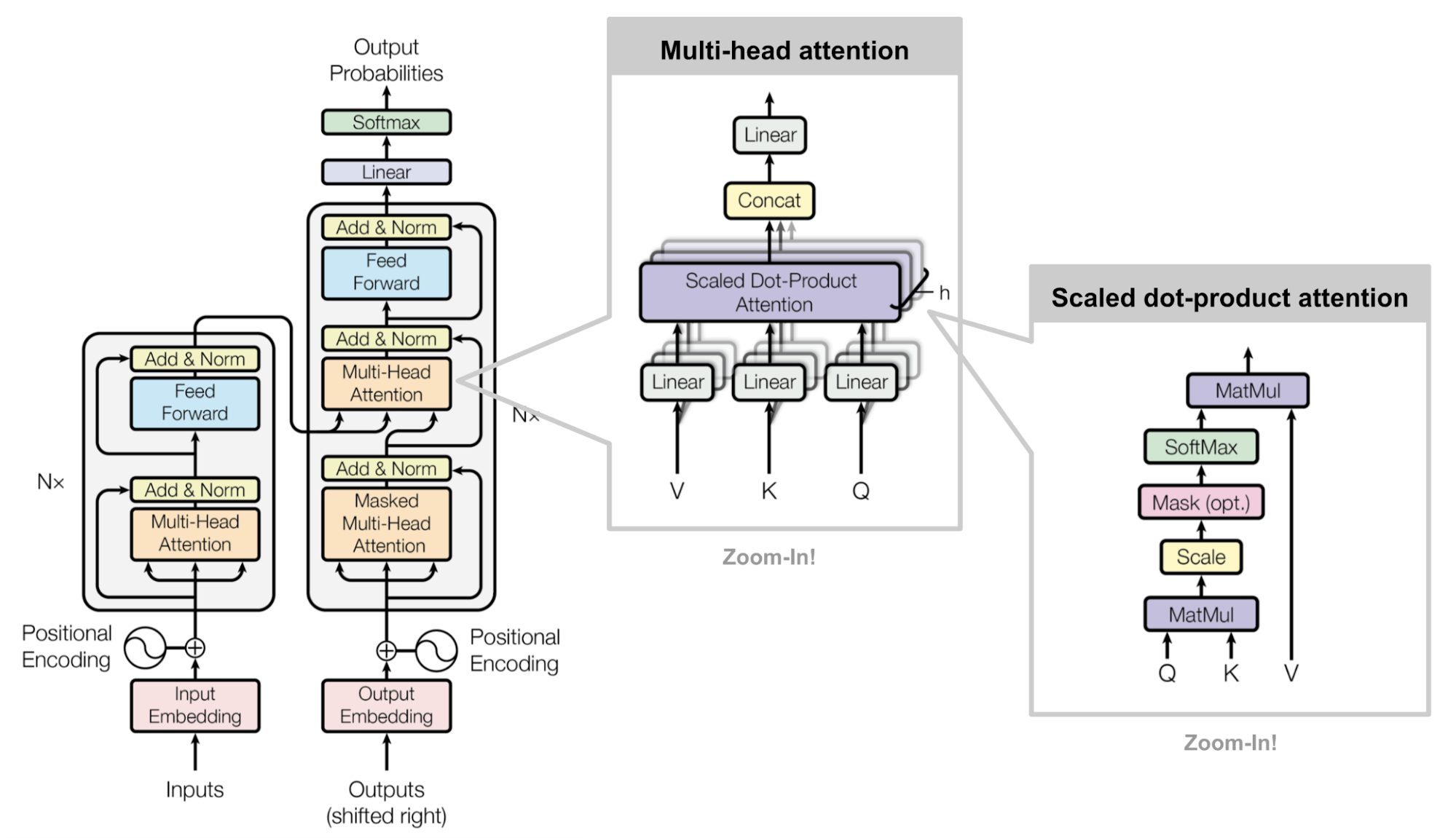

1.[CS224n] Transformers: 셀프 어텐션, 멀티 헤드 어텐션, 포지셔널 임베딩 등

[Stanford CS224N NLP with Deep Learning | Winter 2021 | Lecture 9 - Self- Attention and Transformers] 트랜스포머의 motivation, 계층 구조, 셀프 어텐션 등을 설명한다.

2022년 7월 5일

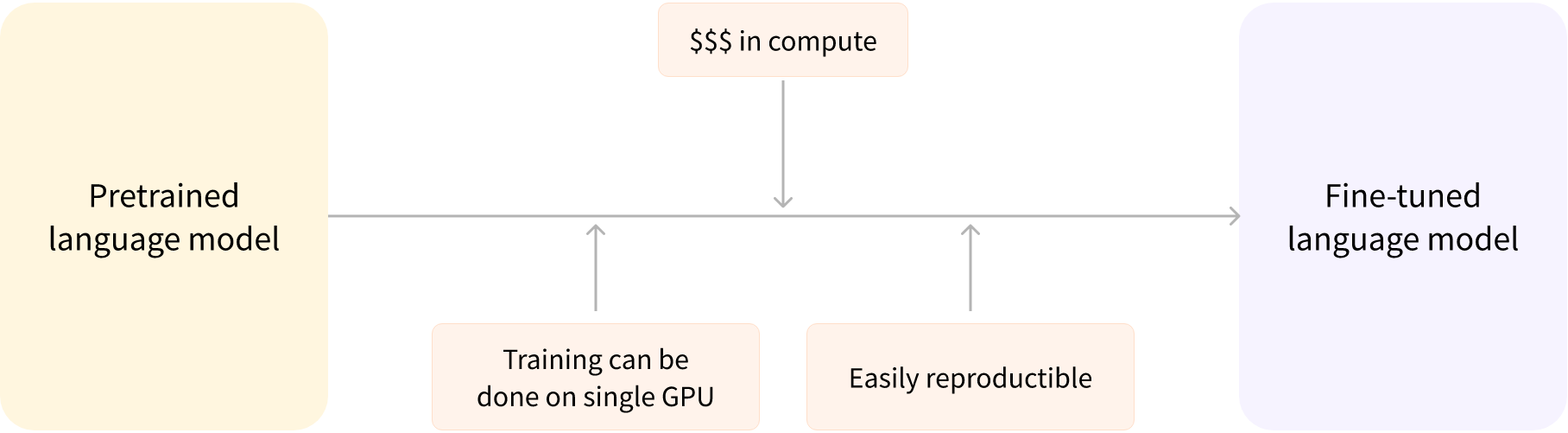

2.[CS224n] Pre-training Language Models: 전이 학습, 사전 훈련된 모델 종류 등

Stanford CS224N NLP with Deep Learning | Winter 2021 | Lecture 10 - Transformers and Pretraining 및 Hugging Face: 사전 훈련 모델이 등장하게 된 배경, 전이 학습 등을 설명한다.

2022년 7월 6일

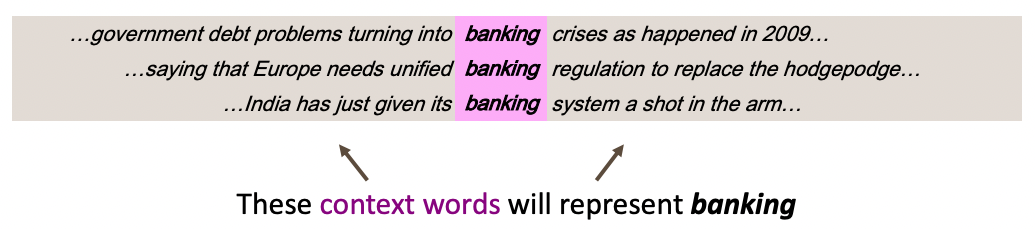

3.[CS224N] 1. Word Vectors & Word2Vec

자연어 처리에서 단어를 어떻게 표현하는지, 단어 임베딩이 무엇인지, 대표적인 단어 임베딩 모델인 Word2Vec의 아이디어가 무엇인지 학습한다.

2022년 7월 12일

4.신경망 학습 최적화 플로우: Word2Vec 모델을 예시로

1) 학습 목표 및 손실 함수 설정 2) 편미분으로 gradient 계산 3) 경사 하강법으로 손실 함수 최솟값 계산

2022년 7월 12일

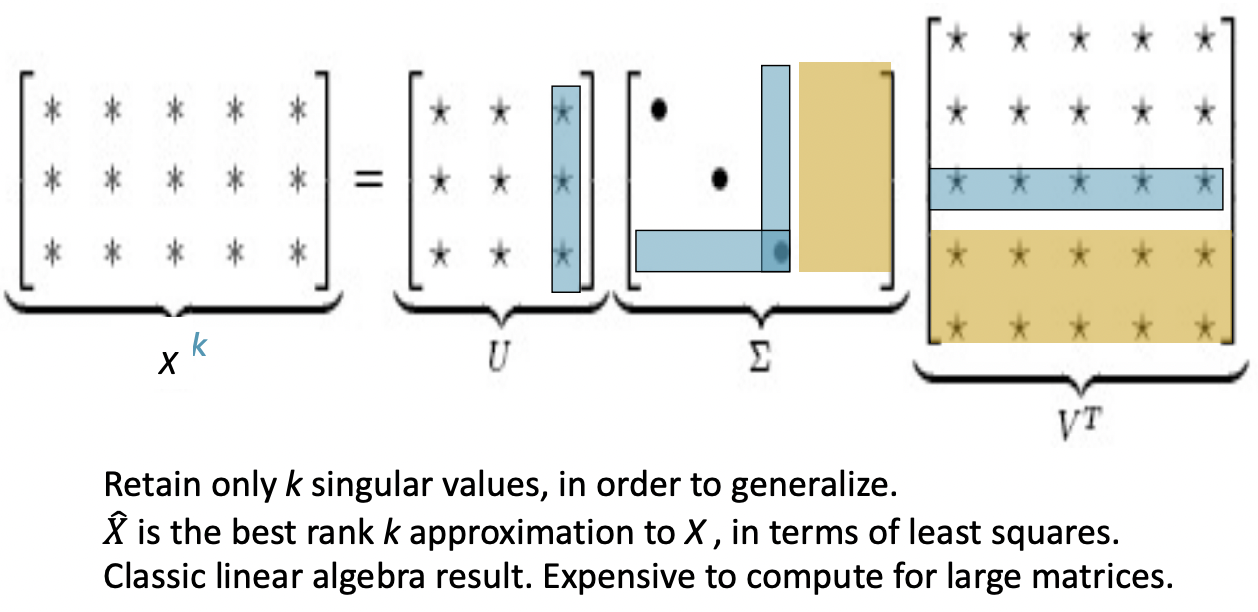

5.[CS224N] 2. Word Vectors and Word Senses

Word2Vec, GloVe, 유의어 처리 방법 등

2022년 7월 13일