https://arxiv.org/pdf/2310.12963

https://github.com/automix-llm/automix

간단 요약

AutoMix 논문 내용 요약과 세부 사항

1. AutoMix의 개요

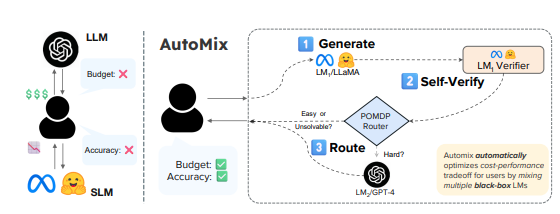

AutoMix는 대규모 언어 모델(LLM)을 효율적으로 라우팅하기 위해 설계된 프레임워크로, 작은 모델(SLM)과 큰 모델(LLM) 간의 쿼리를 동적으로 분배하여 성능-비용 간의 균형을 맞춥니다. AutoMix의 주요 기능은 다음과 같습니다:

- 자체 검증(self-verification): 작은 모델이 생성한 응답의 신뢰도를 스스로 평가.

- POMDP 기반 라우터: 쿼리의 난 이도와 모델 선택을 기반으로 적합한 모델에 라우팅.

- 다양한 모델 혼합: 블랙박스 API를 사용하여 다수의 모델을 조합.

2. AutoMix의 주요 단계

AutoMix는 세 가지 단계를 거칩니다:

- 해결 단계 (Solution Generation): SLM을 사용하여 초기 응답 생성.

- 자체 검증 단계 (Self-Verification): SLM이 생성한 응답을 확인하고, 올바른지 평가.

- 선택적 라우팅 단계 (Selective Routing): 자체 검증 결과를 기반으로 더 큰 모델로 라우팅하거나 SLM 응답을 최종 응답으로 반환.

3. 기술적 기여

- Few-shot 자체 검증: 모델이 생성한 답변이 컨텍스트와 질문에 부합하는지를 엔테일먼트(entailment) 문제로 재구성하여 평가.

- POMDP 기반 라우터: 불완전하거나 신뢰할 수 없는 관찰(검증 결과)을 처리하고, 모델의 성능을 최대화하면서 비용을 최소화하는 라우팅 정책을 학습.

4. AutoMix의 특징

- 블랙박스 접근: 모델의 내부 가중치나 파인튜닝 없이 API를 통해 모델 혼합 가능.

- 효율적 라우팅: 검증된 답변은 작은 모델에서 처리하고, 어려운 쿼리만 큰 모델로 라우팅.

- 경제적 이점: 성능을 유지하면서도 비용을 절감 (최대 50% 절감).

5. 실험 결과

AutoMix는 다양한 데이터셋(QASPER, QUALITY 등)에서 FrugalGPT 및 HybridLLM 같은 최신 라우팅 방법보다 우수한 성능을 보였습니다.

- 비용 대비 성능 (IBC) 메트릭: AutoMix는 모든 데이터셋과 모델 조합에서 더 높은 IBC 점수를 기록.

- POMDP 라우터 성능: Threshold 기반 라우팅보다 일관되고 향상된 결과 제공.

- 저자원 환경: 적은 학습 데이터(50개 샘플)로도 안정적인 성능 보장.

6. AutoMix의 한계

- 특정 태스크에 최적화: 대화 또는 컨텍스트 기반 추론에 적합하며, 상식 추론 또는 사실 기반 QA에는 적합하지 않을 수 있음.

- 모델 접근 제한: 블랙박스 모델에 의존하므로, 오픈소스 모델이 더 강력해질 경우 이 접근 방식의 유효성은 감소할 수 있음.

- 다중 모델 확장: 더 많은 모델을 포함하려면 추가 데이터가 필요하며, 효율성이 감소할 수 있음.

7. AutoMix 활용 방법

AutoMix는 특히 블랙박스 모델 혼합 및 비용 절감이 필요한 상황에서 유용합니다. 또한, 이를 기반으로 효율적인 라우팅을 구현하려면 POMDP 기반 라우터를 설정하고, 검증 및 비용-성능 트레이드오프를 사용자 정의하는 것이 중요합니다.

논문 세부 사항이나 특정 구현 방법이 필요하다면 더 자세히 설명드릴 수 있습니다.

AutoMix 논문에서 학습 방법 및 데이터 사용 요약

1. 학습 방식

AutoMix는 모델 라우팅을 학습하기 위해 두 가지 주요 컴포넌트를 사용합니다:

-

Few-shot Self-Verification:

- 모델이 생성한 응답이 컨텍스트와 질문에 부합하는지를 평가.

- 이를 위해, 엔테일먼트 문제로 재구성된 검증 프롬프트를 사용.

- 학습 과정 없이 few-shot 검증 방식으로 실행되며, 모델이 자체적으로 샘플링을 통해 정답 확률을 계산.

-

POMDP 기반 라우터 학습:

- Partially Observable Markov Decision Process(POMDP)를 사용해 라우팅 정책 학습.

- 검증된 응답에서 난이도를 추정하고, 더 큰 모델로 라우팅할지 결정.

- 최소한의 데이터(50개 샘플)로도 학습이 가능하며, 상태 전이 확률과 보상 함수를 정의하여 최적의 정책을 학습.

POMDP 구성 요소:

- 상태(S): 현재 선택된 모델과 성능 메트릭(정확도 등).

- 행동(A): 현재 모델 유지 또는 더 큰 모델로 라우팅.

- 보상(R): 성능(P)와 비용(C)의 트레이드오프를 나타내는 함수:, 여기서 는 사용자 선호도에 따른 가중치.

- 관찰(Ω): 검증 결과로부터 관찰된 신뢰도.

POMDP 학습 방법:

- 비신뢰성 있는 관찰 데이터를 처리하기 위해 커널 밀도 추정(KDE)를 사용해 관찰 확률을 추정.

- AdaOps POMDP 솔버를 활용하여 최적 정책을 학습.

2. 사용한 데이터셋

AutoMix는 다양한 대화 및 문맥 기반 추론 태스크에서 평가되었습니다. 주요 데이터셋은 다음과 같습니다:

- QASPER:

- 연구 논문을 기반으로 질문과 응답을 생성.

- 정보 추출과 관련된 태스크.

- 평가 메트릭: F1 점수.

- QUALITY:

- 긴 기사와 스토리 기반의 다중 선택 문제(MCQ).

- 평가 메트릭: 정확도.

- COQA:

- 대화 기반 질문 응답 태스크.

- 코어퍼런스 및 화용적 추론이 필요.

- 평가 메트릭: F1 점수.

- MUTUAL:

- 다중 턴 대화에서 다음 응답을 예측하는 태스크.

- 평가 메트릭: 정확도.

- DIPLOMAT:

- 다중 턴 대화에서 실용적 추론 및 식별 문제.

- 평가 메트릭: 정확도.

3. 학습 데이터 구성

- 학습 데이터는 다음과 같은 형태로 구성:

- <문맥, 질문, 모델 응답, 정답> 쌍으로 구성된 데이터셋 사용.

- 작은 데이터셋(50~200개 샘플)으로도 높은 성능 달성.

- 검증 확률 계산:

- 동일한 모델로 개의 샘플링 수행 후, 올바른 답변 확률 계산:

- 동일한 모델로 개의 샘플링 수행 후, 올바른 답변 확률 계산:

4. 학습 프로세스 요약

- 작은 모델(SLM)로 응답 생성.

- SLM으로 생성된 응답의 신뢰도를 평가(few-shot self-verification).

- 검증 결과와 라우팅 정책을 기반으로:

- 응답을 반환하거나,

- 더 큰 모델(LLM)로 라우팅.

5. 학습 데이터 사용의 장점

- 소량의 데이터로 학습:

- POMDP 기반 정책 학습은 최소한의 데이터로도 가능.

- 50개의 샘플로도 강력한 라우팅 성능 달성.

- 범용 프롬프트 사용:

- 동일한 프롬프트를 다양한 태스크에 적용 가능.

맞는지는 모르겠지만 gpt에게 해당 코드의 모델 추가 난이도 판단 질의 답변

AutoMix 논문에서 제안된 방법론과 GitHub에 공개된 코드를 살펴보면, 모델을 추가하는 것이 상대적으로 간단한 편입니다. 특히, AutoMix는 블랙박스 API 접근 방식을 기반으로 설계되었기 때문에, 특정 모델의 내부 구조나 파인튜닝 없이도 모델 추가가 가능하도록 설계되었습니다.

1. AutoMix의 구조적 장점

- 블랙박스 모델 지원:

- AutoMix는 API 호출로 모델을 사용할 수 있도록 설계되었습니다. 따라서 OpenAI의 GPT 시리즈, Hugging Face의 Transformers 모델, LLAMA2, MISTRAL 등 다양한 모델을 쉽게 추가할 수 있습니다.

- Few-shot 검증(Self-Verification):

- 모델 응답을 평가하는 과정에서 특정 모델의 구조나 가중치에 의존하지 않으므로, 새로운 모델을 추가할 때 모델 응답 형식만 맞춘다면 별다른 추가 작업이 필요 없습니다.

- POMDP 기반 라우팅:

- 상태 전이와 보상 함수가 특정 모델에 의존하지 않기 때문에, 새 모델을 추가하더라도 POMDP 라우팅 정책을 재학습할 필요가 없습니다.

초록

대규모 언어 모델(LLM)은 이제 클라우드 API 제공자를 통해 다양한 크기와 구성으로 제공됩니다. 이러한 다양성은 선택의 폭을 넓혀주지만, 계산 비용과 성능을 최적화하기 위해 이러한 옵션을 효과적으로 활용하는 것은 여전히 어려운 과제입니다. 본 연구에서는 AutoMix라는 접근 방식을 제안합니다. 이는 작은 LLM의 출력 정확성을 기반으로 보다 큰 모델로 쿼리를 전략적으로 라우팅합니다. AutoMix의 핵심 기술적 기여는 두 가지입니다. 첫째, 소량의 학습만으로도 자체 출력 신뢰도를 추정할 수 있는 몇 가지 예제 기반의 자체 검증 메커니즘을 제공합니다. 둘째, 자체 검증이 노이즈가 될 수 있음을 고려하여, 답변의 신뢰도를 기반으로 적절한 크기의 모델을 효과적으로 선택할 수 있는 POMDP 기반의 라우터를 활용합니다. 다섯 가지 언어 모델과 도전적인 다섯 개 데이터셋에서의 실험 결과, AutoMix는 강력한 기준선을 일관되게 능가하며, 동일한 성능을 유지하면서 계산 비용을 50% 이상 줄이는 데 성공하였습니다.

1. 서론

대규모 언어 모델(LLM)의 생태계는 빠르게 진화하고 있으며, 다양한 크기, 기능, 계산 요구사항을 가진 모델이 이제 폭넓게 제공되고 있습니다 [Touvron et al., 2023; OpenAI, 2023; Jiang et al., 2023a]. 일반적으로 더 큰 모델은 더 나은 성능을 보이지만, 그에 따른 막대한 계산 비용은 단순한 작업에는 비효율적일 수 있습니다. 또한, 사용자가 특정 요구에 맞는 최적의 모델 구성을 결정하는 것은 사용 가능한 옵션의 방대함 때문에 어려운 과제입니다. 이 문제는 실세계의 작업 복잡성과 변동성 때문에 더욱 복잡해지는데, 단순한 작업(예: 쉽게 분리 가능한 데이터의 이진 분류)에서 복잡한 작업(예: 코드 생성) 또는 잠재적으로 해결 불가능한 작업(예: 다단계 추론)의 스펙트럼까지 다양합니다.

이러한 문제를 해결하고 사용자들이 예산 제약 내에서 최고의 성능을 얻을 수 있도록 하기 위해, 모델 전환(model switching) 기술의 개발이 점점 더 중요해지고 있습니다. 이 기술은 서로 다른 크기와 기능을 가진 모델로 쿼리를 분배하여 계산 자원을 보다 효율적으로 활용할 수 있도록 합니다 [Liu et al., 2020; Zhou et al., 2020; Madaan and Yang, 2022; Geng et al., 2021; Schuster et al., 2022].

현대의 모델 전환 전략은 일반적으로 고정된 작업 집합에 대해 별도의 라우팅 모델을 학습하는 방식에 의존합니다 [Chen et al., 2023; Ding et al., 2024]. 그러나, 현대 LLM은 주로 블랙박스 API를 통해 접근 가능하며, 세부 튜닝 기능이나 가중치 접근 권한이 제한되어 직접적인 모델 최적화를 할 수 없는 상황이 많습니다. 이러한 제약은 대량의 작업별 데이터에 접근할 수 있다는 기대와 결합되어, 기존 라우팅 접근법으로 충분히 해결되지 않는 문제를 야기합니다.

이에 대응하여, 우리는 AutoMix를 소개합니다. AutoMix는 블랙박스 LLM API에 접근할 수 있다는 전제 하에, 다양한 크기와 기능을 가진 모델을 혼합할 수 있도록 설계된 방법입니다. 그림 1에서 설명한 바와 같이, AutoMix는 블랙박스 접근 제약 내에서 3단계로 구성되어 있습니다: 초기 답변을 생성하는 작은 모델을 활용한 솔루션 생성, 동일한 모델로 생성된 답변의 난이도를 평가하는 자체 검증, 그리고 자체 검증 결과를 바탕으로 더 큰 모델로 라우팅하는 선택적 라우팅.

그림 1 설명

AutoMix의 대표적인 2 모델 구성 예제입니다. 단일 소형 모델(SLM)의 낮은 성능이나 단일 대형 모델(LLM)의 높은 비용에 의존하지 않고, AutoMix는 사용자 지정 비용-품질 트레이드오프에 기반해 여러 블랙박스 언어 모델을 자동으로 혼합합니다. AutoMix는 3단계 과정으로 작동합니다:

- 작은 모델(LM1)로 답변 생성

- 생성된 답변의 자체 검증

- 자체 검증에서 도출된 신뢰도 평가를 바탕으로 더 큰 모델(LM2)로 적절히 라우팅.

AutoMix의 주요 기여

AutoMix를 통해 사용자는 다양한 시나리오에서 효율적이고 성능이 우수한 모델 전환을 수행할 수 있습니다. AutoMix는 다음과 같은 두 가지 주요 기술적 혁신을 제안합니다.

- 자체 검증을 추론 문제로 정식화: 생성된 답변의 컨텍스트와의 일관성을 평가하여 신뢰도를 추정합니다. 예를 들어, "차"에 관한 컨텍스트에서 "사과"에 관한 답변은 일관성이 크게 부족한 것으로 간주됩니다.

- 부분적으로 관찰 가능한 MDP(POMDP) 기반 라우터: POMDP는 관찰(자체 검증 확률)이 신뢰할 수 없는 상태(질문의 난이도)를 추정하기 위한 노이즈 있는 추정치를 제공하는 의사결정 문제를 확장합니다. POMDP 라우터는 다양한 난이도를 암묵적으로 모델링하고, 노이즈 있는 자체 검증 결과를 기반으로 이를 평가할 수 있습니다.

AutoMix는 다섯 가지 대화 및 컨텍스트 기반 추론 작업과 다섯 가지 모델에서 광범위한 평가를 수행하였으며, AutoMix가 기존 모델 전환 전략을 능가하고 동일한 성능을 유지하면서도 비용을 두 배 이상 절감하는 것을 확인했습니다. 이를 통해 AutoMix가 효율성과 성능 측면에서 상당한 개선을 제공한다는 것이 입증되었습니다.

2. 배경 및 관련 연구

자체 검증(Self-Verification)

추론 문제에서 자체 검증 개념은 여러 연구에서 탐구되어 왔습니다(Weng et al., 2023; Jiang et al., 2023b; Pan et al., 2023a). 이러한 접근법은 일반적으로 LLM의 지식을 활용합니다(Dhuliawala et al., 2023). 하지만 이는 추론 문제에서 문제를 야기할 수 있습니다(Madaan et al., 2023; Huang et al., 2023). AutoMix는 이를 해결하기 위해 컨텍스트 기반 검증을 활용하고, POMDP 라우터를 도입하여 검증기의 잠재적 노이즈를 완화합니다.

또한, 일부 연구는 모델이 이전에 발생시킨 실수를 모은 데이터셋이나 외부 지식 기반을 검증에 활용합니다(Madaan et al., 2022; Peng et al., 2023; Gao et al., 2023; Pan et al., 2023b). 반면 AutoMix는 질문의 컨텍스트를 사용해 답변의 타당성을 검증합니다.

모델 혼합(Mixing Models)

LLM 추론 비용 최적화를 위해 모델 전환을 활용하는 연구들이 진행되었습니다. 이 연구들은 주로 별도로 학습된 검증기를 사용합니다(Chen et al., 2023; Zhu et al., 2023; vSakota et al., 2023; Ding et al., 2024). 하지만 AutoMix는 고비용 검증기 학습이 필요하지 않으며, 몇 가지 예제를 제공하는 소형 언어 모델(SLM) 프롬프트를 통해 이를 대체합니다. AutoMix는 모든 입력 쿼리에 대해 사전 접근 권한이 없어도 작동하며, 단 50개의 샘플만으로 학습된 라우터가 특화된 모델보다 뛰어난 성능을 발휘합니다.

이 연구는 다양한 모델과 외부 도구를 결합해 언어 모델의 추론 시간을 개선하려는 최근 연구들과 맥락을 같이합니다(Khattab et al., 2023; Press et al., 2022; Yao et al., 2022; Zhou et al., 2022).

적응형 계산(Adaptive Computation)

적응형 계산 및 모델 라우팅 기법은 중간 표현을 활용해 계산을 사전에 최적화하는 데 초점을 맞추는 경우가 많습니다(Liu et al., 2020; Zhou et al., 2020; Geng et al., 2021; Schuster et al., 2022; Madaan and Yang, 2022). 그러나 AutoMix는 이러한 방식과 달리 아키텍처 변경 없이 블랙박스 API 접근만을 가정합니다.

일부 블랙박스 기반 방법(예: Adaptive-Consistency, Aggarwal et al., 2023)은 추론 작업을 최적화하려 하지만, 단일 LLM 모델에만 제한됩니다. 반면 AutoMix는 두 개 이상의 모델 간에서 유연하게 최적화를 수행합니다.

부분적으로 관찰 가능한 마르코프 결정 프로세스(POMDP)에 대한 배경

POMDP는 에이전트가 상태를 불완전하거나 노이즈가 있는 방식으로 관찰하는 상황을 다루기 위해 MDP(Markov Decision Processes)를 확장한 것입니다. POMDP는 ⟨S, A, T, R, Ω, O⟩라는 튜플로 정의됩니다.

- S: 상태 집합

- A: 행동 집합

- Ω: 가능한 관찰 집합

- T: 상태 간 전이 확률을 설명하는 전이 함수

- R: 특정 상태에서 수행된 행동에 대한 보상을 할당하는 보상 함수

- P: 행동과 상태를 관찰과 연결하는 관찰 함수

POMDP 에이전트는 상태에 대한 확률 분포(즉, 믿음 상태)를 유지하여 불확실성을 관리합니다. 이 믿음은 수행된 행동과 그로 인한 관찰에 따라 업데이트됩니다. POMDP의 목표는 장기 기대 보상을 극대화하는 정책 π: b 7→ a ∈ A를 찾는 것입니다.

POMDP는 로봇 공학, 자동 내비게이션, 크라우드소싱 워크플로우, 전략 계획 등 다양한 분야에서 사용되었습니다(Kaelbling et al., 1998; Schwarting et al., 2018; Dai et al., 2010; Meuleau et al., 2013). 그러나 AutoMix는 POMDP를 새로운 방식으로 활용하여 쿼리를 LLM 간에 라우팅합니다. AutoMix에서 자체 검증의 노이즈 있는 출력은 POMDP의 관찰로 작용하며, 질문의 난이도를 평가하고 적절한 LLM으로 라우팅하여 비용과 성능이라는 보상 함수가 극대화되도록 합니다.

3. 문제 정의 (Problem Formulation)

우리는 사용자 정의 비용-품질 트레이드오프를 극대화하기 위해 적절한 언어 모델(LM)을 선택하는 문제를 다룹니다. 이를 위해 NN개의 서로 다른 언어 모델(LM1, LM2, ... LMN)에 접근할 수 있다고 가정합니다. 이 모델들은 매개변수 수에 따라 번호가 매겨지며, 각 모델은 관련 비용(C_i)과 각 입력 쿼리에 대한 (알 수 없는) 성능(P_i)을 가집니다. 우리의 목표는 주어진 총 비용 제약 내에서 적절한 테스트 포인트에 대해 각 모델을 동적으로 호출하여 총 성능을 극대화하는 것입니다.

실험 설정

- 우리는 비용-품질 곡선을 비교하고, 새롭게 제안한 IBC(Incremental Benefit of Cost) 메트릭을 통해 평가합니다(5.1절 참조).

- AutoMix의 접근법을 테스트하기 위해 문맥 기반 추론 작업을 다룹니다. 예를 들어, 이해 기반 질의응답(QA) 및 다양한 대화 추론 작업 등에서 주어진 컨텍스트 (예: 이야기, 뉴스 기사, 대화 기록)와 질문 에 대해 모델이 제공된 문맥과 일치하는 정확하고 일관된 답변을 생성해야 합니다.

작업 선택 동기

- 긴 쿼리는 계산 요구량이 더 크므로 AutoMix와 같은 접근법을 통해 비용-정확성 트레이드오프를 관리할 필요성이 있습니다.

- 문맥은 자체 검증(self-verification)을 통해 초기 답변을 교차 검증할 수 있는 기반을 제공합니다.

제약 사항

- LM API에 대한 블랙박스 접근만 가능하다고 가정합니다.

- 라우터 모델을 학습하기 위해, 작은 크기의 학습/검증 데이터셋 에 접근할 수 있다고 가정합니다. 이 데이터셋은 트리플렛으로 구성됩니다. 여기서 y는 정답이고 는 LMi가 생성한 답변입니다.

4. AutoMix

AutoMix는 다음 3단계로 구성됩니다:

-

솔루션 생성(Solution Generation)

작은 언어 모델(LMi, 초기에는 i = 1)을 사용해 답변 를 생성합니다.

-

자체 검증(Self-Verification)

동일한 모델(LMiLMi)을 사용해 생성된 답변 A_s의 신뢰성을 평가합니다.

-

선택적 라우팅(Selective Routing)

자체 검증 결과를 기반으로 더 큰 언어 모델(LMj, j > i)로 라우팅하거나, 를 최종 답변으로 반환합니다.

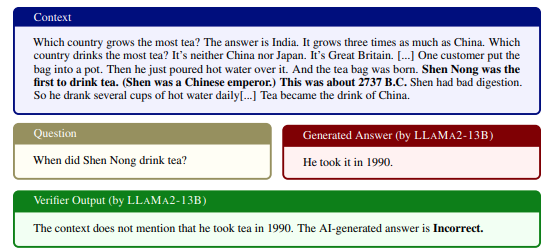

4.1 자체 검증(Self-Verification)

AutoMix는 소량의 학습 예제를 사용하는 검증기 V를 통해 A_s의 타당성을 평가합니다. 기존 연구(Weng et al., 2022; Jiang et al., 2023b)는 새로운 질문을 생성해 검증을 수행하지만, AutoMix는 이를 포함 관계(entailment) 과제로 재구성합니다(Dagan et al., 2005; Poliak, 2020).

검증기는 로 나타나는 확률을 계산합니다. 여기서 은 가 정확함을 나타냅니다. 이를 추정하기 위해, 검증기에서 높은 샘플링 온도로 k > 1번 샘플링하고, 확률은 로 계산됩니다.

AutoMix는 모든 작업에 동일한 4샷(4-shot) 검증 프롬프트를 사용하며, 검증기를 학습시키지 않습니다. 프롬프트와 자체 검증 사례는 그림 1과 그림 2에 나와 있습니다.

4.2 라우터(Router)

라우팅은 솔루션 생성 및 자체 검증 이후 수행됩니다. 라우터는 LMi의 출력을 수용할지, 또는 LMj (j > i)로 쿼리를 라우팅해 성능을 개선할지를 결정합니다.

- 라우터는 메타-검증기(meta-verifier)로 해석될 수 있으며, 자체 검증의 평가에 추가적인 신뢰도를 제공합니다.

- 예를 들어, 해결 불가능한 쿼리(Unsolvable queries)는 더 큰 모델로 라우팅해도 성능이 향상되지 않고 자원을 낭비하게 됩니다. 라우터는 자체 검증 확률과 학습 데이터에서 얻은 트렌드를 바탕으로 이러한 쿼리를 추가 라우팅하지 않도록 결정합니다.

AutoMix는 라우팅 시 LLM의 환각(hallucination) 문제와 추론 오류를 피하기 위해 비-LLM 기반의 설정을 채택하며, 슈퍼바이즈드 학습, 강화 학습, 심볼릭 추론 등 다양한 학습 전략을 채택할 수 있습니다.

라우팅 전략

-

임계값 기반(Thresholding)

두 모델(N=2) 설정에서, v가 t 이상이면 LM1의 답변을 반환하고, 그렇지 않으면 LM2로 라우팅합니다. 이 방식은 t 값을 조정하여 비용-성능 트레이드오프를 탐구할 수 있습니다.

-

POMDP 기반 라우터

POMDP는 성능 차이가 비용-품질 트레이드오프를 정당화할 때만 더 큰 LLM으로 쿼리를 라우팅하도록 설계되었습니다. POMDP는 본질적으로 관측(observations)이 완벽하지 않은 상황에 적합합니다.

POMDP의 구성 요소

- 상태(S): 현재 선택된 LMi 및 데이터 포인트에 대한 성능 지표()

- 행동(A): 현재 모델(LMi)의 답변을 유지하거나 더 큰 모델로 라우팅

- 관찰(Ω): LMi의 검증 결과 v

- 보상 함수(R): , P는 성능, C는 비용, 는 사용자 선호에 따라 두 기준을 조정하는 조정 매개변수

AutoMix는 AdaOps POMDP 솔버(Wu et al., 2021)를 사용하며, 신념 상태를 입자로 표현하여 관측 결과에 따라 업데이트합니다. POMDP 솔버는 초기 균일 분포로 시작하며, 업데이트된 신념 상태에서 기대 보상을 극대화하는 행동을 선택합니다.

추가 세부 사항과 완전한 POMDP 공식화는 부록 A.3에 제공됩니다.

5. 실험 (Experiments)

연구 질문

본 실험에서는 다음과 같은 연구 질문을 다룹니다.

- AutoMix는 다른 모델 전환 전략과 비교했을 때 어떤 성능을 보이는가?

- AutoMix는 (1) 모델 간 비용 비율 및 (2) 사용 가능한 학습 데이터 양의 변화에 따라 얼마나 잘 동작하는가?

설정

대부분의 실험은 N = 2인 설정에서 수행되며, SLM(소형 언어 모델, LM1)과 LLM(대형 언어 모델, LM2)로 각각 표기합니다. 추가적으로 N = 3인 결과도 5.5절에서 보고합니다.

5.1 비용-성능 효율성 분석을 위한 메트릭

Incremental Benefit Per Cost (IBC)

모델 성능을 평가할 때, 단순한 정확도뿐만 아니라 관련 계산 비용이나 금전적 비용도 고려해야 합니다. 이를 위해, AutoMix는 SLM과 LLM의 통합을 최적화하는 방법 MM을 정의합니다.

각 방법 MM에 대해 비용 CMC_M과 성능 PMP_M이 주어질 때, IBC는 다음과 같이 정의됩니다:

이 메트릭은 추가 비용 대비 성능 향상의 효율성을 포착합니다.

- : M이 독립적인 LLM보다 비용 효율적으로 성능을 개선.

- : 비용 대비 효율성이 감소.

기하학적 해석

성능-비용 그래프에서 SLM과 LLM 간의 선분 기울기는 추가 비용 대비 기본적인 성능 증가율을 나타냅니다.

- 방법 M이 이 선분 위에 위치하면 기울기가 가파르며, 이는 긍정적인 IBC를 나타냅니다.

- 반대로 선분 아래에 위치하면 부정적인 IBC를 나타냅니다.

AutoMix의 목표는 일관되게 긍정적인 IBC를 제공하는 방법을 개발하거나 식별하는 것입니다.

5.2 실험 설정

모델 및 비용 계산

- SLM: GPT-3.5, LLAMA2-13B, MISTRAL-7B

- LLM: GPT-4

- 각 모델의 비용은 고정된 값으로 설정되며, 검증 비용()은 과 동일하게 설정합니다.

비용 CC는 다음과 같이 계산됩니다:

여기서 w는 LLM이 호출되었는지 여부를 나타냅니다.

데이터셋

다양한 데이터셋에서 실험을 수행했습니다:

- QASPER: 연구 논문에 대한 질의응답 [Dasigi et al., 2021].

- QUALITY: 긴 기사와 이야기의 다지선다형 질문 [Pang et al., 2022].

- COQA: 대화 이해와 참조 및 실용적 추론 [Reddy et al., 2019].

- MUTUAL: 다중 턴 대화 추론 [Cui et al., 2020].

- DIPLOMAT: 다중 턴 대화에서 실용적 식별 및 추론 [Li et al., 2023].

평가지표:

- F1 점수: QASPER, COQA

- 정확도: QUALITY, MUTUAL, DIPLOMAT

모든 모델은 동일한 프롬프트를 사용하며, SLM과 LLM 모두에 대해 greedy decoding(온도=0)을 사용했습니다. 자체 검증에는 온도=0.7로 설정하고 8개의 샘플을 추출했습니다.

기준선(Baselines)

AutoMix는 두 가지 최신 기준선 모델과 비교했습니다:

- FrugalGPT [Chen et al., 2023]: DistillBERT [Sanh et al., 2019]을 라우터로 활용.

- HybridLLM [Ding et al., 2024]: DeBERTa [He et al., 2021]를 라우터로 활용.

5.3 주요 결과

결과 분석

- AutoMix는 POMDP 기반 라우터를 사용했을 때, 모든 데이터셋에서 높은 성능을 보이며, 비용 대비 성능 효율성을 일관되게 유지했습니다.

- 표 1에서는 AutoMix의 변형(T: Threshold, P: POMDP 기반 라우터)이 FrugalGPT 및 HybridLLM을 대부분의 시나리오에서 능가함을 보여줍니다.

결과 시각화

- 그림 3: SLM-LLM 선형 보간(random mixing)보다 AutoMix의 성능-비용 곡선 기울기가 더 가파릅니다.

- 그림 4: AutoMix + POMDP는 모든 데이터셋에서 비용 대비 성능 효율성(IBC)을 극대화합니다.

∆IBC 값 분석

- AutoMix + POMDP는 모든 데이터셋에서 가장 높은 를 기록하며, 계산 자원을 가장 효과적으로 활용합니다.

- FrugalGPT와 HybridLLM은 도메인 특화 학습 데이터 및 0비용 검증기를 활용했음에도 AutoMix보다 성능이 낮았습니다.

| 모델 | 방법 | DIPLOMAT | MUTUAL | COQA | QASPER | QUALITY |

|---|---|---|---|---|---|---|

| MISTRAL-7B | AutoMix + P | 156.8 | 46.7 | 12.4 | 69.3 | 51.6 |

| LLAMA2-13B | AutoMix + P | 58.5 | 12.4 | 83.1 | 8.5 | 10.3 |

| GPT-3.5 | AutoMix + P | 151.2 | 18.8 | 65.0 | 114.7 | 24.1 |

AutoMix는 Thresholding(T)보다 POMDP 기반 접근(P)에서 더 일관된 성능을 보였습니다.

5.3 주요 결과 (Main Results)

성능-비용 곡선 분석

그림 4는 다양한 데이터셋과 모델 혼합 방법을 사용해 MISTRAL-7B를 SLM으로 설정한 성능-비용 곡선을 보여줍니다.

- AutoMix-POMDP와 AutoMix-Threshold는 모든 데이터셋에서 FrugalGPT 및 HybridLLM을 일관되게 능가하며, SLM-LLM 곡선 위에 위치하여 비용 대비 성능 효율성이 높습니다.

- 특히 FrugalGPT와 HybridLLM은 도메인 특화 학습된 라우터를 활용하고 검증 비용이 없다는 이점이 있음에도 AutoMix에 뒤쳐졌습니다.

- LLAMA2-13B와 GPT-3.5를 SLM으로 설정한 결과도 유사한 경향을 보이며, 이는 그림 18과 19에서 확인할 수 있습니다.

∆IBC 분석

표 1은 각 방법, 데이터셋, SLM에 대해 다섯 개의 동등한 비용 영역에서 평균 값을 비교한 결과를 보여줍니다.

- AutoMix-POMDP는 모든 데이터셋과 모델에서 FrugalGPT와 HybridLLM을 일관되게 능가했습니다.

- LLAMA2-13B 모델을 사용한 QASPER 데이터셋에서는 FrugalGPT와 동등한 성능을 보였지만, 나머지 경우에는 모두 우수했습니다.

- DIPLOMAT 데이터셋에서는 평균 122%의 성능 향상을 보여 가장 큰 성능 향상을 기록했습니다.

- AutoMix-POMDP는 모든 설정에서 긍정적인 를 제공하며, AutoMix-Threshold의 성능을 일관되게 매치하거나 초과했습니다

성과 및 경제적 중요성

AutoMix의 성능 향상은 직접적인 비용 절감으로 이어지며, 다양한 비용, 작업 난이도(30%~90% 정확도), 모델 간 성능 차이(8%~50%)를 포함한 시나리오에서 실질적인 성능 향상을 보여줍니다.

AutoMix는 모델 가중치나 도메인 특화 라우팅 데이터를 활용하지 않고도 SLM과 GPT-4를 다양한 작업에 효과적으로 혼합할 수 있음을 입증했습니다.

5.4 추가 실험 (Additional Experiments)

비용 비율 변화의 영향

- 주 실험에서는 SLM과 LLM의 비용 비율이 1:60에서 1:200까지 변한다고 가정했습니다.

- 그림 5 (오른쪽)에서는 비용 비율을 조정하며 각 비용 비율에서 값을 데이터셋의 최대 값으로 정규화한 결과를 보여줍니다.

- 결과:

- 비용 비율이 1:10과 같이 낮은 경우에도 AutoMix는 많은 데이터셋에서 높은 이득을 제공하기 시작합니다.

- 비용 비율이 더 skewed(편향)될수록 성능이 더욱 향상됩니다.

- 비용은 금전적 비용뿐 아니라 지연(latency)이나 에너지 사용량과 같은 요소도 포함할 수 있습니다. AutoMix는 이러한 다양한 시나리오에서도 일관된 성능을 보여줍니다.

저자원 시나리오에서의 효과

- 그림 5 (왼쪽)는 검증 데이터 크기에 따른 AutoMix, FrugalGPT, HybridLLM의 성능 변화를 보여줍니다.

- 결과:

- AutoMix는 제한된 데이터 환경에서 FrugalGPT와 HybridLLM을 크게 능가합니다.

- 예: 학습 예제가 50개에 불과한 경우, AutoMix는 15%의 를 유지하며 기준선을 절대적으로 20% 이상 초과했습니다.

- 이는 학습 데이터가 부족한 실세계 시나리오에서 AutoMix가 특히 유리하다는 점을 강조합니다.

기타 실험

- 소량의 샘플(Self-Verification) 분석: 자체 검증이 SLM이 생성한 답변의 오류를 효과적으로 식별할 수 있음을 확인했습니다(부록 A 참조).

- 지연 시간 분석: POMDP 기반 라우터는 2모델 설정에서 쿼리당 1ms 미만의 계산 시간이 소요되며, 네트워크 지연 시간(≈ 10ms)은 SLM과 LLM의 솔루션 생성 시간(수 초 단위)에 비해 매우 적습니다. AutoMix는 기존 언어 모델 추론에 비해 추가적인 계산 또는 지연 시간을 초래하지 않습니다.

5.5 세 모델로 확장된 AutoMix (Results with Three Models)

설정

- SLM: LLAMA2-13B

- MLM(Medium Language Model): LLAMA2-70B

- LLM: GPT-4

결과 분석

- 그림 6은 세 모델 설정에서 AutoMix가 FrugalGPT 및 기타 기준선 대비 모든 비용 영역에서 성능을 크게 개선했음을 보여줍니다.

- AutoMix는 비용 영역별로 SLM-MLM 및 MLM-LLM 간 최적의 성능을 제공합니다.

기준선과의 비교

- Union AutoMix:

- SLM-MLM 및 MLM-LLM AutoMix 변형 중 하나를 비용 요구사항에 따라 선택.

- 그러나 AutoMix3 대비 전반적으로 낮은 성능을 보임.

- Chained AutoMix:

- SLM에서 시작하여 MLM으로 라우팅 후, 다시 MLM에서 LLM으로 라우팅.

- 직접적으로 SLM에서 LLM으로 라우팅하지 못하기 때문에 전반적으로 성능이 저하됨.

추가 시나리오 실험

- MLM이 SLM보다 성능이 낮고 검증기가 유효하지 않은 경우:

- AutoMix는 MLM을 건너뛰고 직접적으로 SLM에서 LLM으로 라우팅 가능.

- MLM이 SLM보다 성능이 낮지만 검증기가 유효한 경우:

- AutoMix는 MLM 검증기의 정보를 활용하여 모든 기준선을 능가하는 성능을 발휘.

6. 결론 (Conclusion)

AutoMix는 여러 블랙박스 LLM API를 통합하여 다단계 문제 해결 프레임워크를 구성하고, 계산 비용과 성능 간의 트레이드오프를 최적화합니다. 본 연구는 전통적인 인공지능(GOFAI) 접근법과 LLM을 결합하여, POMDP를 활용한 효과적인 LLM 간 라우팅 가능성을 입증하였습니다.

AutoMix는 몇 가지 흥미로운 연구 방향을 열며, 특히 LLM의 자체 검증 및 수정이 일반적으로 어려운 문제임에도 불구하고, 문맥 기반 몇 가지 샷(few-shot) 검증을 사용하여 유망한 결과를 보였습니다. 이는 유사한 접근법이 다른 시나리오에서도 효과적일 가능성을 시사합니다. 본 연구는 주관적인 성능 개념이 중요한 생성 작업으로 확장될 가능성도 제시합니다.

한계점 (Limitations)

- 모델 및 데이터셋 의존성

- 다양한 모델과 데이터셋에서 AutoMix의 효과를 실증했지만, 특정 모델이나 데이터셋에 따라 그 효과가 달라질 수 있습니다.

- 특화된 작업 설계

- AutoMix는 효과적인 자체 검증을 위해 대화 관련 또는 문맥 기반 추론 작업을 염두에 두고 설계되었습니다.

- 사실 기반 질문 응답(factual QA)이나 상식 추론과 같은 작업은 포함되지 않았습니다.

- 미래의 변화 가능성

- 향후 오픈소스 모델의 성능이 더 강력해지고 추론 비용이 감소하면 모든 쿼리에 대해 강력한 모델을 제공하는 것이 가능할 수 있습니다.

- 그러나 이 경우에도 가용성 관련 트레이드오프는 여전히 존재할 수 있으며, 이를 AutoMix로 관리할 수 있을 것입니다.

- 지연 시간의 한계

- AutoMix는 지연 시간을 비용의 한 형태로 처리할 수 있지만, 모델 간 지연 시간 비율이 작으면 개선 효과가 미미할 수 있습니다.

- POMDP 확장성

- AutoMix의 POMDP 공식은 일반적이며 모델 설정으로 확장할 수 있지만, 이 클 경우, 강력한 정책을 학습하기 위해 더 많은 데이터가 필요할 수 있습니다.