Routing

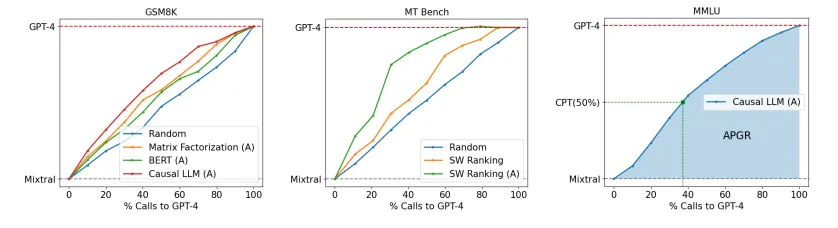

1.RouteLLM: Learning to Route LLMs with Preference Data

다양한 언어 모델(LLM) 간의 효율적 라우팅을 통해 비용 절감과 성능 유지 간의 균형을 맞추는 방안을 다룹니다.

2.Cost-Effective Online Multi-LLM Selection with Versatile Reward Models

C2MAB-V 프레임워크에 대한 논문. 정리 및 번역

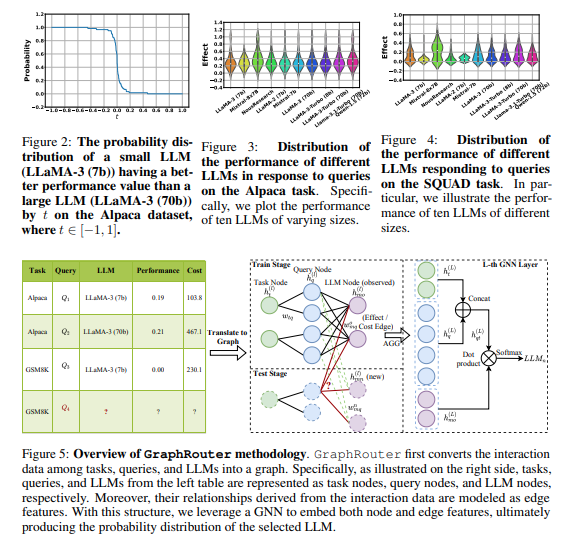

3.GRAPHROUTER: A GRAPH-BASED ROUTER FOR LLM SELECTIONS

이 논문은 'GraphRouter'라는 새로운 방법론을 제안합니다. 이를 통해 다양한 LLM(Large Language Models) 중 적합한 모델을 선택하는 과정을 효율화하려고 합니다. 정리 및 번역

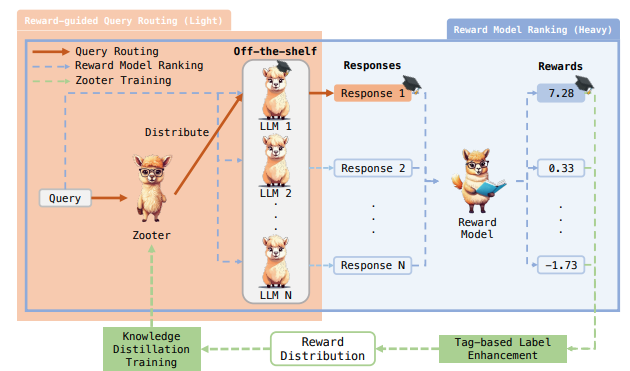

4.Routing to the Expert: Efficient Reward-guided Ensemble of Large Language Models

이 논문은 "ZOOTER"라는 대규모 언어 모델(LLM)들의 효율적인 집합 방식을 제안하고 있습니다. ZOOTER는 주어진 입력 쿼리를 가장 적합한 LLM에 전달하여 컴퓨팅 효율을 극대화하려는 방법론. 정리 및 번역

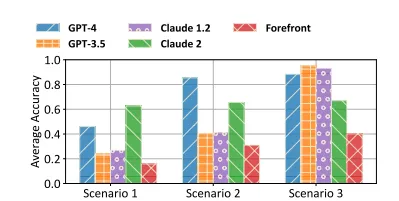

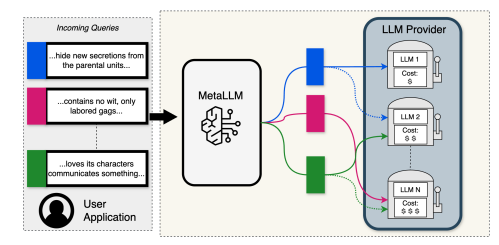

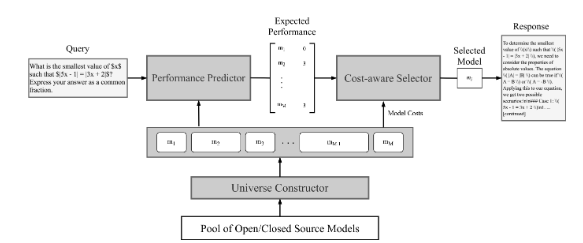

5.MetaLLM: A High-performant and Cost-efficient Dynamic Framework for Wrapping LLMs

MetaLLM 방법론은 비용 효율적이면서도 높은 성능을 유지하기 위해 각 쿼리에 대해 최적의 LLM(대형 언어 모델)을 선택하여 라우팅하는 동적 프레임워크입니다.

6.Large Language Model Routing with Benchmark Datasets

이 논문은 다양한 작업(task)에 대해 새로운 작업을 수행할 때 최적의 LLM(Large Language Model)을 선택하는 문제를 다룹니다. 이 논문은 기존의 벤치마크 데이터셋을 활용하여 델 라우터(router)를 학습하는 방식을 제안합니다.

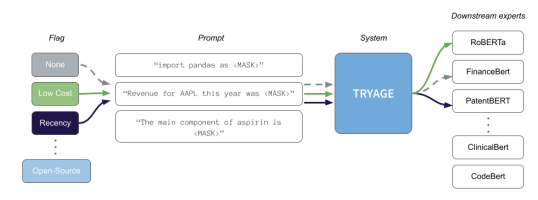

7.Tryage: Real-time, intelligent Routing of User Prompts to Large Language Models

사용자 입력 프롬프트를 다양한 대형 언어 모델(LLM) 라이브러리로 동적으로 라우팅하기 위한 지능형 시스템 Tryage를 소개합니다.

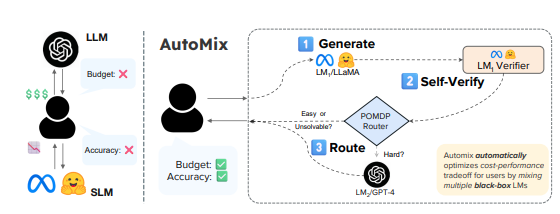

8.AutoMix: Automatically Mixing Language Models

AutoMix는 대규모 언어 모델(LLM)을 효율적으로 라우팅하기 위해 설계된 프레임워크로, 작은 모델(SLM)과 큰 모델(LLM) 간의 쿼리를 동적으로 분배하여 성능-비용 간의 균형을 맞춥니다.

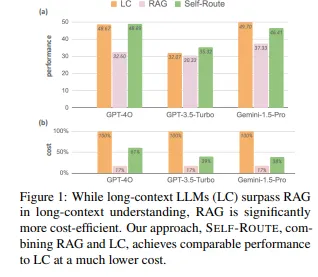

9.Retrieval Augmented Generation or Long-Context LLMs? A Comprehensive Study and Hybrid Approach

SELF-ROUTE라는 간단하지만 효과적인 방법을 제안하며, 이는 모델의 자체 평가에 기반해 쿼리를 RAG 또는 LC로 라우팅하는 방식입니다. SELF-ROUTE는 비용을 크게 줄이면서 LC와 유사한 성능을 유지합니다.

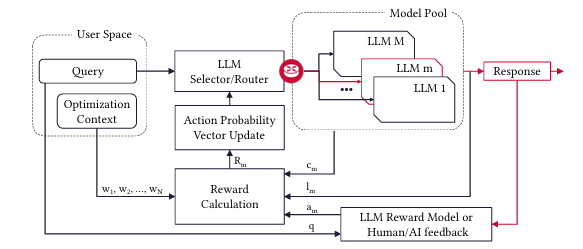

10.PickLLM: Context-Aware RL-Assisted Large Language Model Routing

특정 쿼리에 대해 사용자 맞춤형 목적에 따라 최적의 LLM을 선택하는 문제를 해결하고자 합니다. 이를 위해 Reinforcement Learning(강화 학습, RL)을 기반으로 쿼리마다 동적으로 LLM을 선택하는 경량 프레임워크인 PickLLM을 제안합니다.

11.ROUTOO: LEARNING TO ROUTE TO LARGE LANGUAGE MODELS EFFECTIVELY

Routoo는 비용과 품질 간의 균형을 최적화하며 LLM(대규모 언어 모델) 사용을 효과적으로 조율하는 시스템입니다

12.REROUTING LLM ROUTERS

LLM(대형 언어 모델) 라우터는 쿼리의 복잡도에 따라 저비용 및 고성능 LLM으로 분류하고 라우팅하여 응답의 품질과 비용을 균형 있게 조정하는 시스템입니다. 본 논문은 이러한 LLM 라우터의 공격 저항성(adversarial robustness)을 조사합니다.

13.LLM Bandit: Cost-Efficient LLM Generation via Preference-Conditioned Dynamic Routing

본 연구에서는 LLM 선택을 멀티 암드 밴딧(Multi-Armed Bandit) 문제로 정의하고, 사용자의 선호도를 반영한 동적 라우팅(preference-conditioned dynamic routing) 기법을 제안한다.

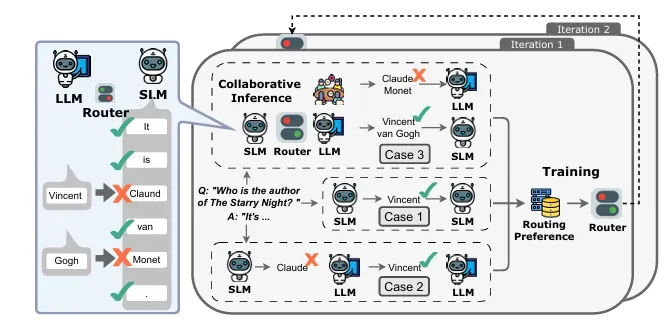

14.CITER: Collaborative Inference for Efficient Large Language Model Decoding with Token-Level Routing

CITER는 작은 언어 모델(SLM)과 대형 언어 모델(LLM) 간의 협력적인 추론(collaborative inference) 을 통해 토큰 수준에서 라우팅(token-level routing) 을 수행하는 새로운 접근법이다.

15.LLM-Based Routing in Mixture of Experts: A Novel Framework for Trading

기존 MoE 방식은 단일 모달(unimodal) 접근법을 사용하여 뉴스, 경제 지표, 시장 심리 등 텍스트 기반 정보를 제대로 활용하지 못하는 문제가 있다. 또한, 고정적인 신경망 기반 라우터는 시장 변동성과 현실적 맥락을 반영하는 데 한계를 가져 이를 해결 제안.

16.CARROT: A Cost-Aware Rate-Optimal Router

CARROT는 쿼리에 적절한 모델을 비용 대비 최적의 성능 기준으로 선택하는 방식의 LLM 라우팅 기법으로, 기존의 비효율적인 LLM 라우팅 문제를 해결하고자 한다.

17.MixLLM: Mixed Large Language Models

MixLLM은 다양한 대형 언어 모델(LLM)의 장점을 활용하여 각 쿼리에 대해 최적의 모델을 선택하는 동적 라우팅 시스템입니다.

18.Capability Instruction Tuning: A New Paradigm for Dynamic LLM Routing

**MODEL-SAT(Model Selection with Aptitude Test)**이라는 프레임워크를 도입하여 각 모델의 능력을 평가하고 특정 작업에 적합한 모델을 동적으로 선택하는 방식을 개발

19.RouterEval: A Comprehensive Benchmark for Routing LLMs to Explore Model-level Scaling Up in LLMs

RouterEval이라는 대규모 벤치마크를 제안해 라우터 성능을 체계적으로 비교·분석

20.Collaborative Speculative Inference for Efficient LLM Inference Serving

CoSine은 speculative inference의 효율성과 정확성 문제를 해결하기 위해 협업 기반 다중 노드 시스템을 도입합니다. SSM의 도메인 전문성과 LLM의 강력한 검증 능력을 분리 및 조율하여 성능, 지연 시간, 비용 측면 모두에서 우수한 성과를 보입니다

21.ROUTERRETRIEVER: Routing over a Mixture of Expert Embedding Models

도메인 특화 전문가(Expert) 임베딩 모델을 라우팅 메커니즘으로 조합하여 검색 성능을 개선하는 새로운 모델을 제안

22.Learning to Decode Collaboratively with Multiple Language Models

Co-LLM은 여러 언어 모델이 서로 협력하여 한 문장을 생성하도록 학습하는 프레임워크입니다. 각 토큰을 누가 생성할지 스스로 학습하며, 이로 인해 전문성과 범용성을 결합한 응답 생성을 달성합니다.

23.Efficient Hybrid Inference for LLMs: Reward-Based Token Modelling with Selective Cloud Assistance

고성능 LLM과 경량화된 SLM(Small Language Model)을 결합하여 효율적이고 비용 절감형 추론을 실현하는 새로운 하이브리드 방식의 디코딩 전략

24.Universal Model Routing for Efficient LLM Inference

라우터를 재학습하지 않고도, 시험 시점에서 관찰되지 않은 여러 LLM들 간의 라우팅을 수행하는 이론적인 전략

25.Collaborative Decoding of Critical Tokens for Boosting Factuality of LLMs

사실성(factuality) 문제를 해결하기 위해 크리티컬 토큰(Critical Token) 개념과 함께 모델 협력 기반 디코딩 방식(Model CDS) 을 제안하는 연구

26.Smoothie: Label Free Language Model Routing

라벨 없이 LLM을 선택하거나 라우팅할 수 있는 새로운 기법(SMOOTHIE)**을 제안

27.MasRouter: Learning to Route LLMs for Multi-Agent Systems

LLM 기반 멀티 에이전트 시스템(MAS)의 효율성과 성능을 동시에 높이기 위한 새로운 라우팅 프레임워크인 MasRouter를 제안

28.Dynamic LLM Routing and Selection based on User Preferences: Balancing Performance, Cost, and Ethics

대형 언어 모델(LLMs)을 보다 효율적이고 사용자 맞춤형으로 선택 및 활용하기 위한 시스템인 OptiRoute를 제안

29.IRT-Router: Effective and Interpretable Multi-LLM Routing via Item Response Theory

Item Response Theory(IRT, 문항반응이론)에 기반한 라우팅 프레임워크 제안.

30.Token Level Routing Inference System for Edge Devices

토큰 단위 라우팅 기반 협업 디코딩 구조를 실질적으로 엣지 디바이스-클라우드 연동 환경에서 구현했다.중요 토큰의 작은 하위 집합을 추론을 위해 클라우드의 대규모 모델로 라우팅함으로써 시스템은 낮은 추론 지연 시간을 유지하면서 에지 모델의 성능을 크게 향상

31.Router-R1: Teaching LLMs Multi-Round Routing and Aggregation via Reinforcement Learning

라우터도 LLM으로 만들자”는 발상으로, 내부 추론()과 외부 LLM 호출(→)을 여러 라운드로 엮어가며 답을 조립하도록 RL로 학습한 멀티-LLM 라우팅 프레임워크

32.Route-and-Reason (R2-Reasoner)

입력 문제를 서브태스크(subtask)로 분해한 뒤, 각 서브태스크에 대해 **모델 풀(model pool)**에서 적절한 모델을 골라 순차 실행함으로써 정확도를 유지하면서 비용을 크게 절감하는 routing + reasoning 프레임워크를 제안합니다.

33.CP-Router: An Uncertainty-Aware Router Between LLM and LRM

Conformal Prediction(CP)을 이용해 LLM의 불확실성을 예측셋(prediction set) 크기로 정량화하고, 그 크기가 작으면(확실) LLM에 잔류, 크면(불확실) LRM으로 라우팅

34.RouterDC: Query-Based Router by Dual Contrastive Learning for Assembling Large Language Models

쿼리–LLM 간 대조학습으로 “잘하는 LLM들 쪽으로 끌어당기고 못하는 LLM들은 밀어내며”, 쿼리–쿼리 대조학습으로 임베딩 공간을 안정화하는 Dual Contrastive 라우터를 제안

35.OmniRouter: Budget and Performance Controllable Multi-LLM Routing

탐욕적 라우팅을 버리고, 전역 성능·예산 제약을 동시에 만족시키는 제약최적화(constrained optimization) 로 라우팅을 풀어 정확도는 올리고 비용은 내리는 프레임워크

36.DeepSieve: Information Sieving via LLM-as-a-Knowledge-Router

질의→분해(Decompose)→라우팅(Route)→관찰·리플렉션(Reflect)→**융합(Fuse)**의 4단계 파이프라인. 각 서브질의마다 “도구–코퍼스 쌍(tool–corpus pair)”을 선택해 검색/질의하고, 부족하면 경로를 바꿔 다시 시도

37.BEST-Route: Adaptive LLM Routing with Test-Time Optimal Compute

작은 모델이라도 best-of-n(여러 샘플 중 최선 선택)을 쓰면 품질이 크게 오르며, 여전히 큰 모델 1샷보다 싸다”는 점에 착안해, 모델 선택 + 샘플 개수 n까지 함께 결정하는 라우팅을 제안

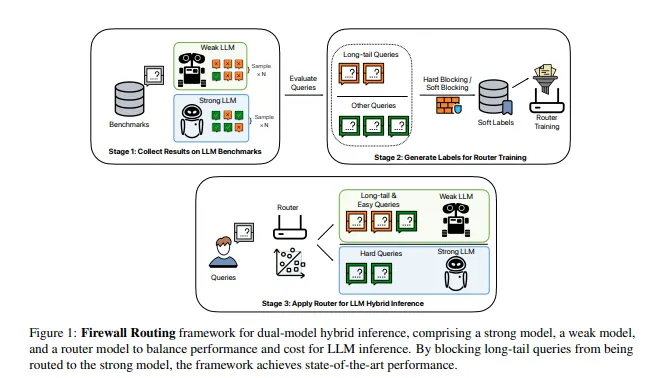

38.Firewall Routing: Blocking Leads to Better Hybrid Inference for LLMs

Soft label 기반 라우터 학습 패러다임. - 여러 번 sampling한 결과를 활용해, weak가 strong만큼 좋을 “승률(Win Rate)”을 soft label로 계산. weak가 strong보다 잘하는 long-tail을 자동 찾고 라우팅.

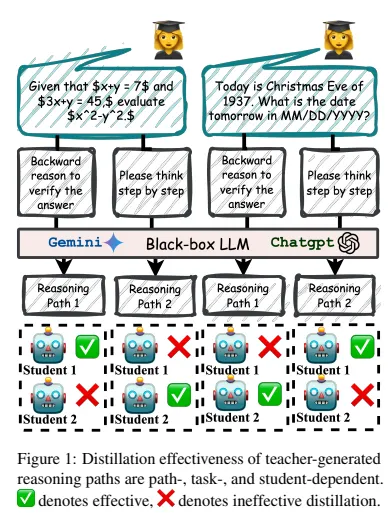

39.Learning from Diverse Reasoning Paths with Routing and Collaboration

강한 teacher로부터 다양한 스타일의 reasoning path를 생성하고, (2) 정답/논리 품질로 필터링한 뒤, (3) 개별 student의 상태에 맞춰 path를 라우팅해서, (4) 여러 student 사이의 협력 distillation으로 부족한 부분 보완

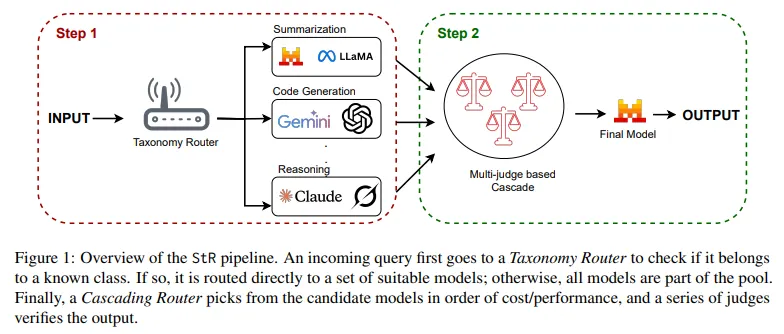

40.SELECT-THEN-ROUTE: Taxonomy guided Routing for LLMs

taxonomy 기반으로 모델 후보 pool을 먼저 줄이고 그 안에서 multi-signal judge(CASCADE) 기반 confidence cascade로 최종 모델을 고르는 2단계 구조로, decision space를 줄여 정확도·비용 면에서 개선.

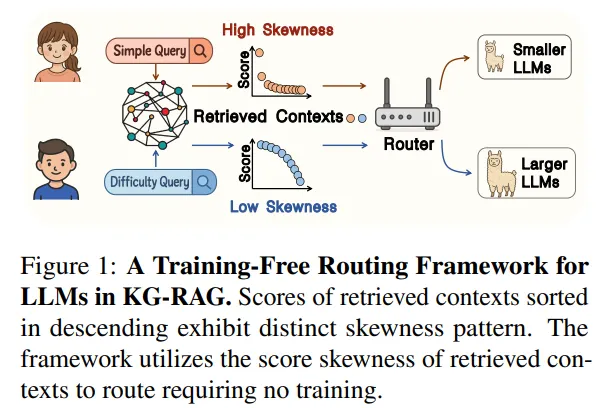

41.SkewRoute: Training-Free LLM Routing for Knowledge Graph Retrieval-Augmented Generation via Score Skewness of Retrieved Context

스큐니스가 높은(simple) 질의는 작은 LLM으로 보내고, 스큐니스가 낮은(difficult) 질의는 큰 LLM으로 보내도록 라우팅하는 논문.

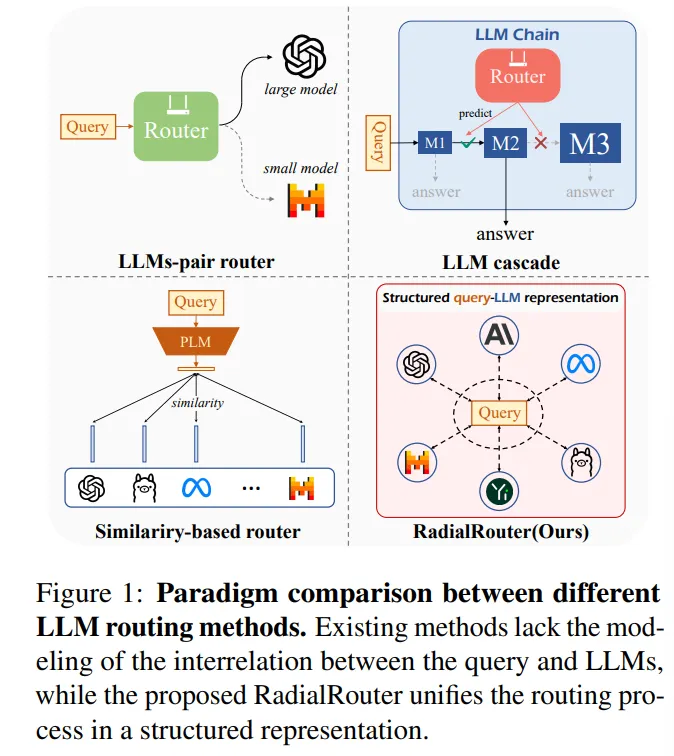

42.RadialRouter: Structured Representation for Efficient and Robust Large Language Models Routing

Transformer 기반의 RadialRouter 프레임워크 제안 – 질의별로 최적 LLM을 동적으로 선택.

43.Route to Reason: Adaptive Routing for LLM and Reasoning Strategy Selection

RTR은 **모델 선택(Model Routing)**과 **추론 전략 선택(Strategy Routing)**을 통합적으로 수행하는 프레임워크

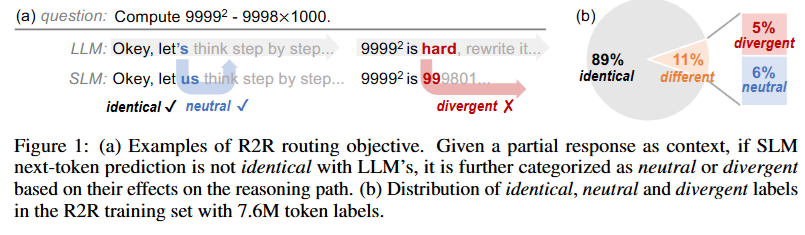

44.R2R (Roads to Rome): Efficiently Navigating Divergent Reasoning Paths with Small-Large Model Token Routing

토큰 단위 라우팅 + 발산 토큰만 LLM 호출하며 Divergent 토큰만 LLM으로 생성(혹은 교정)하고, 나머지는 SLM이 계속 생성 하도록 하는 라우팅 방법.