LLM을 다뤄보지 않아 관련 자료를 찾던 중

유투브에서 '테디노트'님의 영상을 보고 따라해보고자 한다.

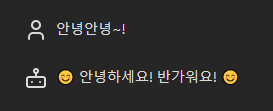

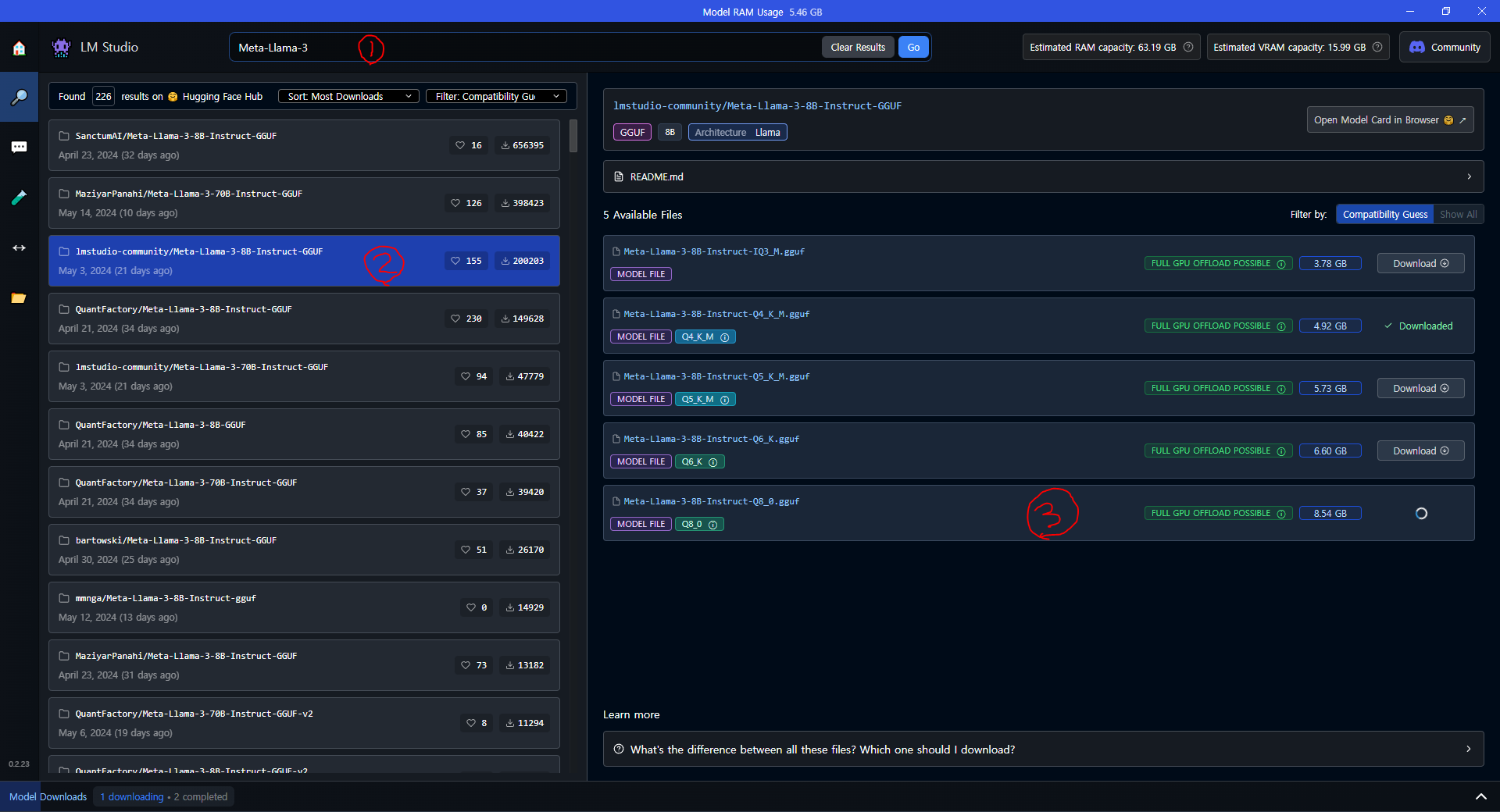

Step. 1

- LM Studio 홈페이지에서 설치 프로그램 다운.

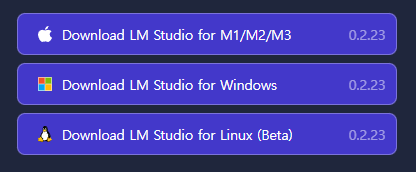

Step. 2

- LM Studio 실행 후 배너에 보이는 Llama3 다운로드 (없다면 상단 검색창에 찾아본다.)

- 다운로드를 클릭하면 최하단에 프로그래스바가 진행 된다.

- 다른 버전을 원하면 Step. 2-1

Step. 2-1

- 다른 버전을 찾기위해 좌측 두번째 돋보기 버튼을 클릭한다.

- 검색창에 Meta-Llama-3 입력

- lmstudio-community/Meta-Llama-3-8B-Instruct-GGUF 라고 되어있는 칸 선택

- 우측에 원하는 파일을 다운로드 해준다.

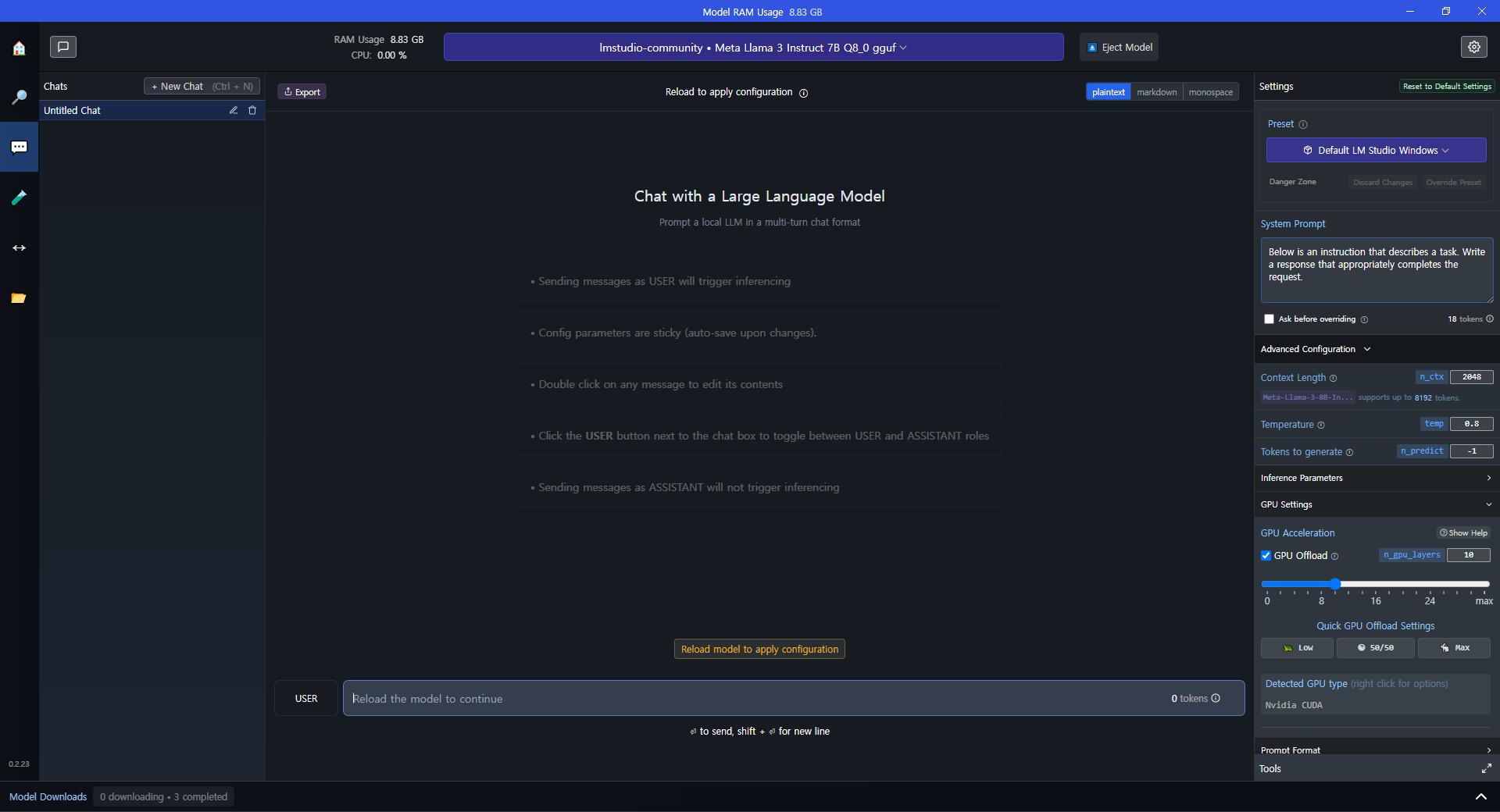

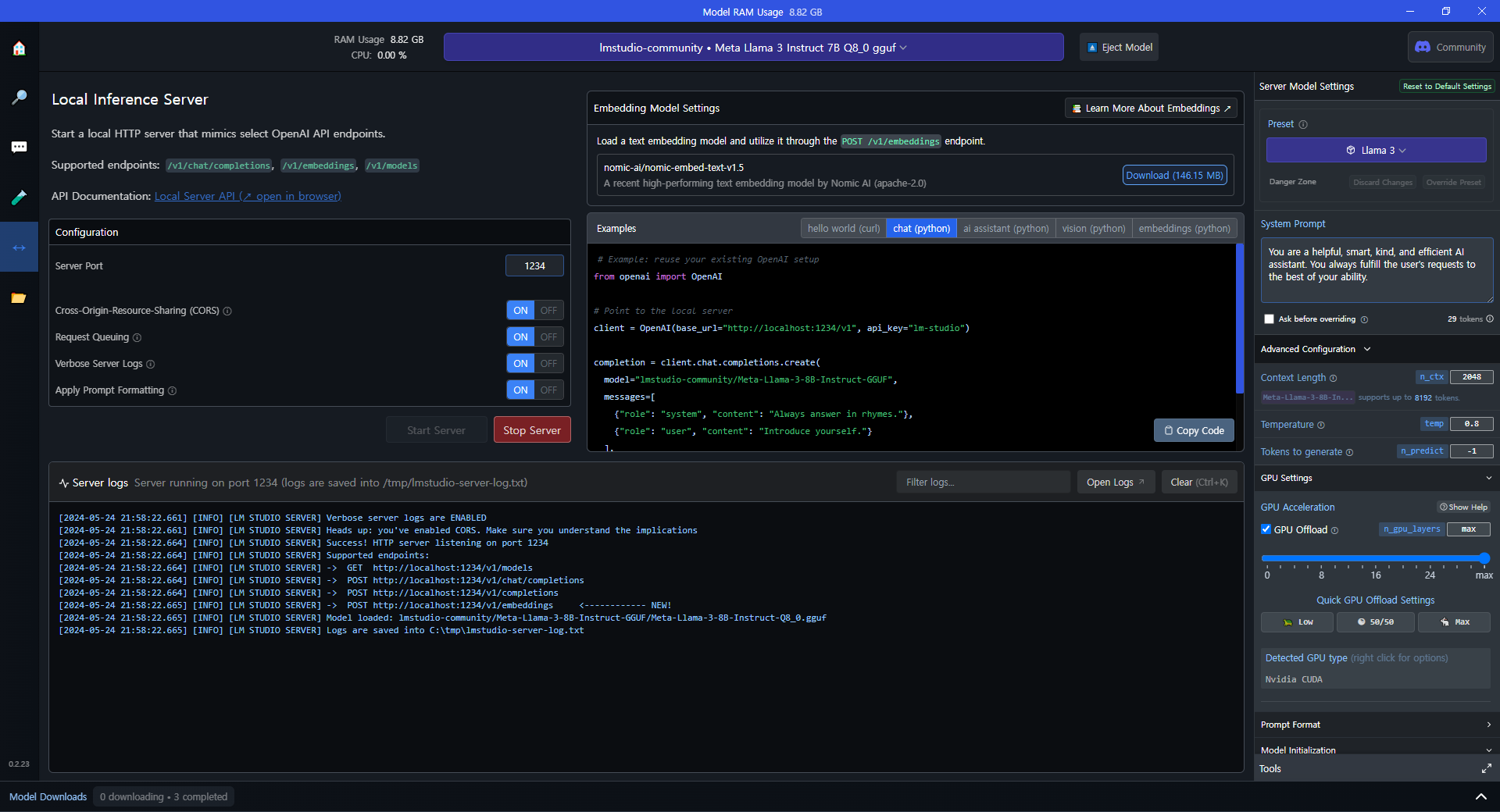

Step. 3

- 모델 테스트를 위해 좌측 세번째 말풍선 버튼을 클릭한다.

- 상단에 모델을 선택한다.

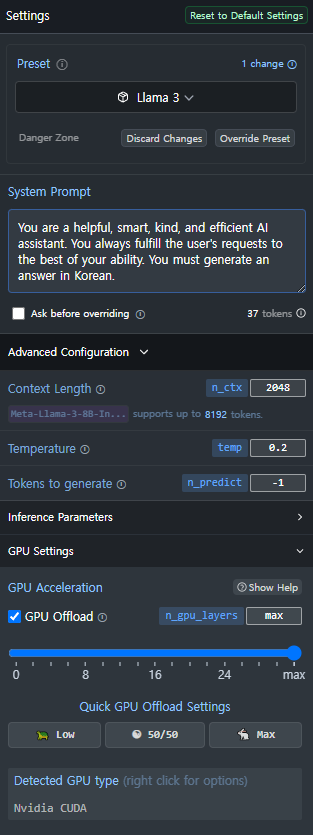

- 우측에 Preset을 Llama3로 선택한다.

- System Prompt를 입맛에 맞게 설정한다.

Step. 3-1

- Advanced Configuration을 연다.

- Temperature를 입맛에 맞게 설정한다. ( 높을수록 창의성, 낮을수록 명확성, 0~1 )

- GPU 사용량을 설정한다. ( 높을수록 출력속도 )

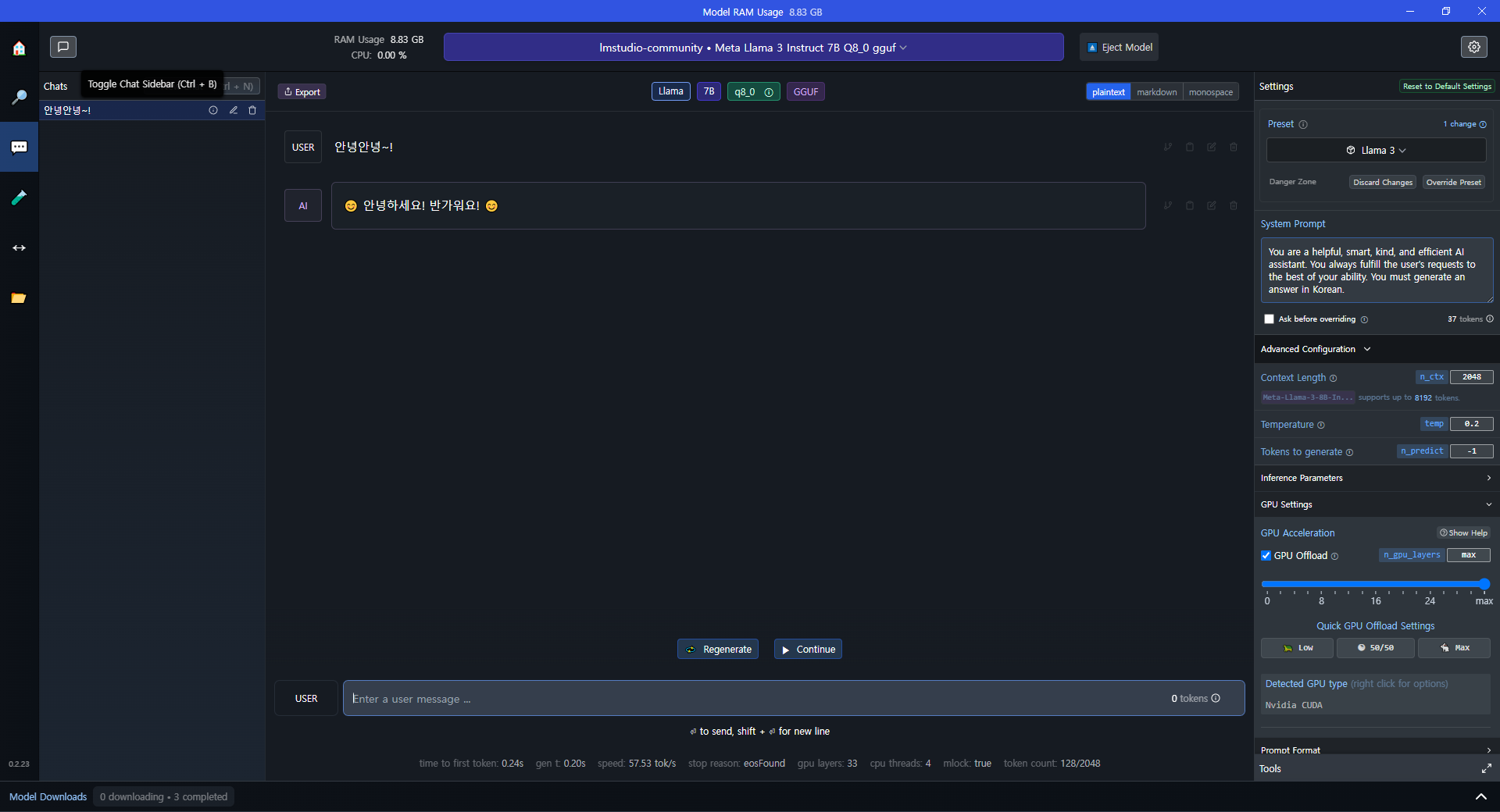

Step. 4

- 하단에 'Reload model' 버튼이 있다면 클릭.

- 채팅을 입력해본다.

Step. 5

- Obsidian 홈페이지에서 설치 프로그램 다운 및 설치.

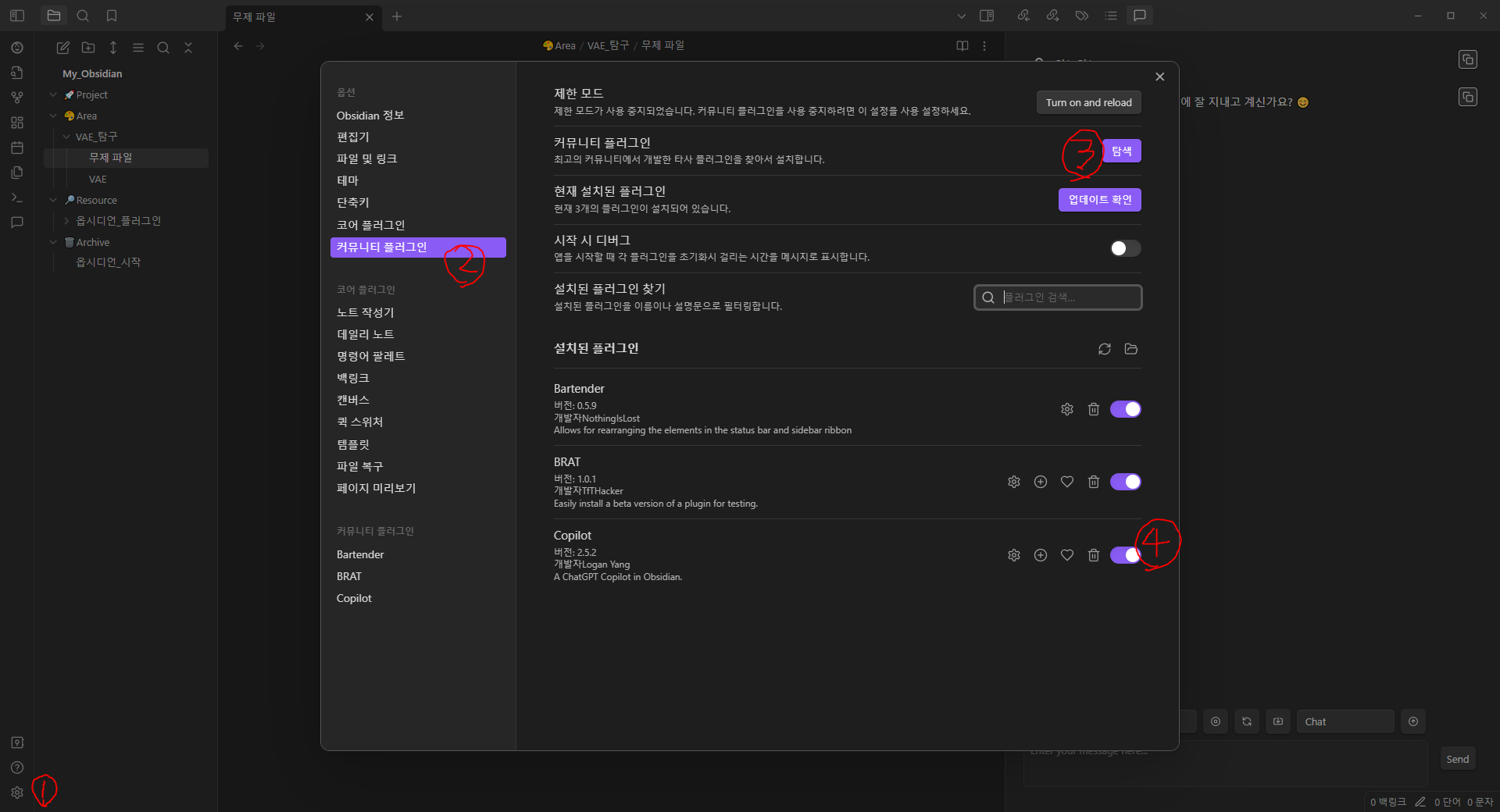

Step. 6

- 실행 후 좌하단에 톱니바퀴모양 클릭

- 커뮤니티 플러그인 선택

- 탐색을 눌러 'Copilot'을 검색후 설치해준다.

- 설치가 완료되면 스위치를 눌러 실행해준다.

Step. 7

- 다시 LM Studio로 돌아와서 좌측의 5번째 아이콘 'Local Server'를 클릭한다.

- 원하는 모델이 잘 선택된 것을 확인하고 'Start Server'를 클릭한다.

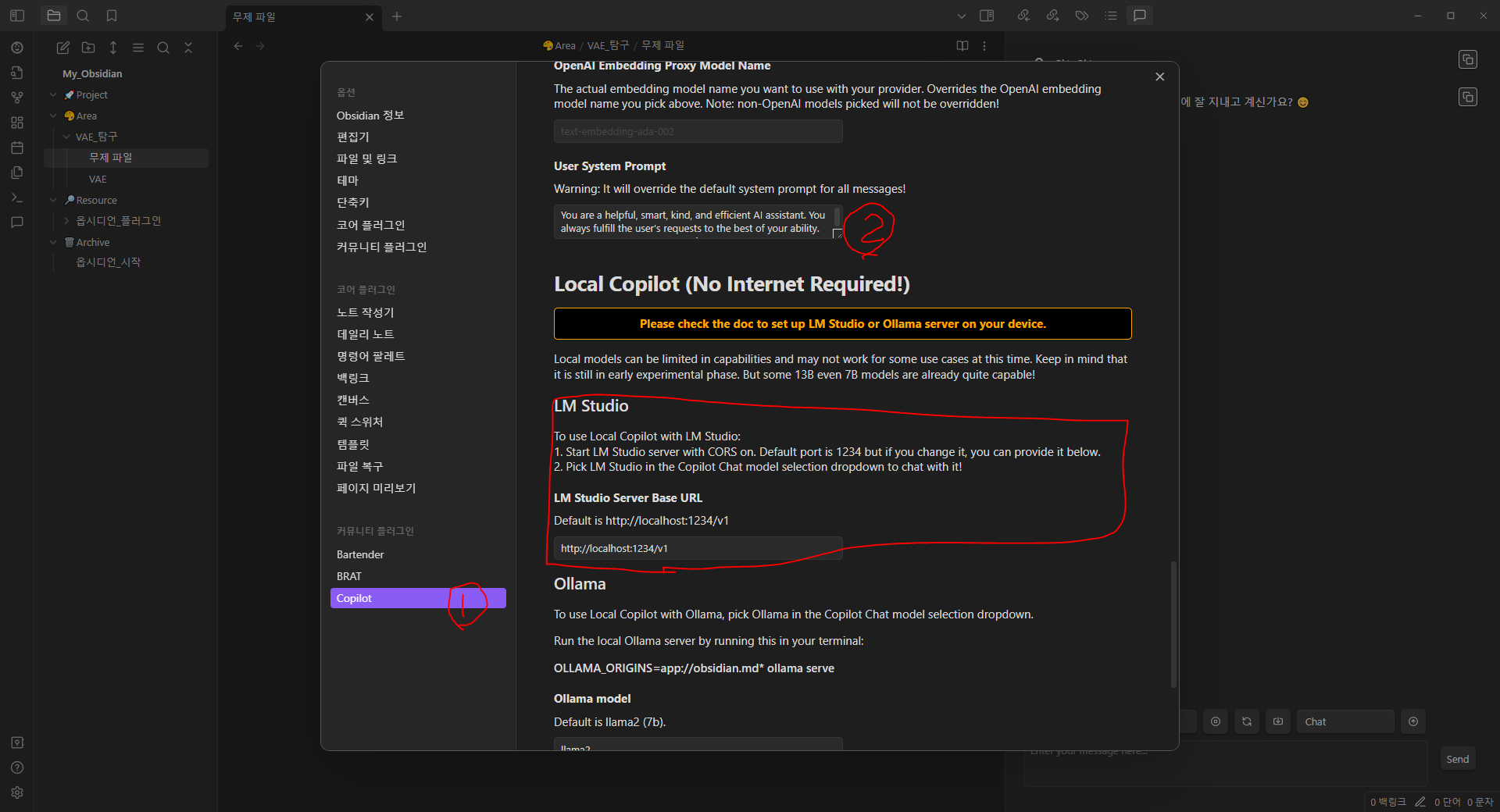

Step. 8

- 다시 Obsidian으로 돌아와서 설정창의 좌하단 - 커뮤니티 플러그인 - Copilot을 선택한다.

- 하단으로 스크롤을 내리면 User System Prompt와 LM Studio 관련 설정이 보인다.

- User System Prompt은 셋팅하면되고, LM Studio 설정은 기본값으로 입력되어있다.

- 스크롤로 상단으로 올라가서 Save and Reload를 클릭.

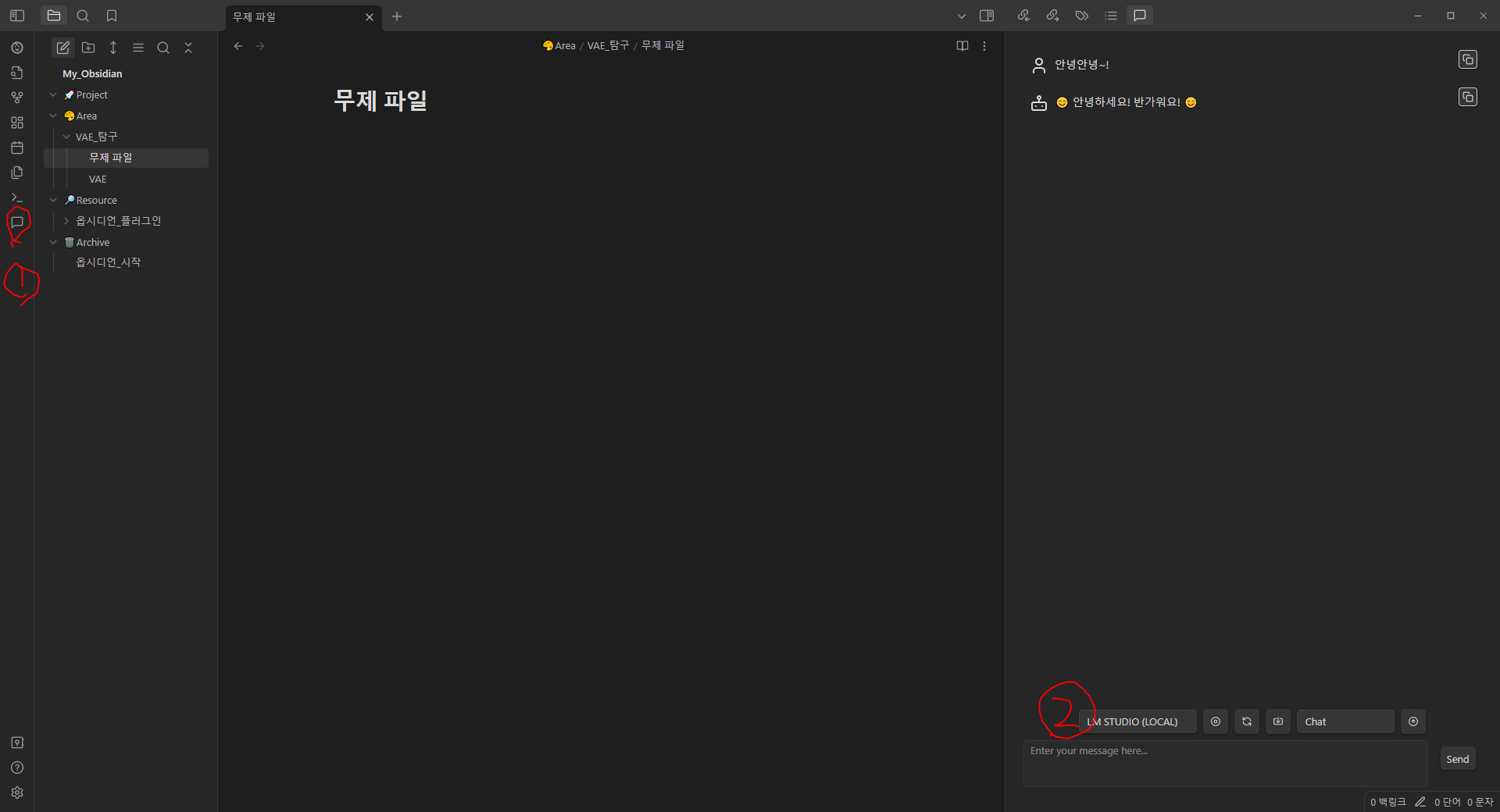

Step. 9

- 좌측에 말풍선 모양을 선택.

- 우측의 채팅창 하단에서 모델을 선택한다.

Step. 10

- 대화를 한다.