LLM 관련

1.Llama3 + LM Studio + Obsidian

LLM을 다뤄보지 않아 관련 자료를 찾던 중 유투브에서 '테디노트'님의 영상을 보고 따라해보고자 한다.LM Studio 홈페이지에서 설치 프로그램 다운.LM Studio 실행 후 배너에 보이는 Llama3 다운로드 (없다면 상단 검색창에 찾아본다.)다운로드를 클릭하면

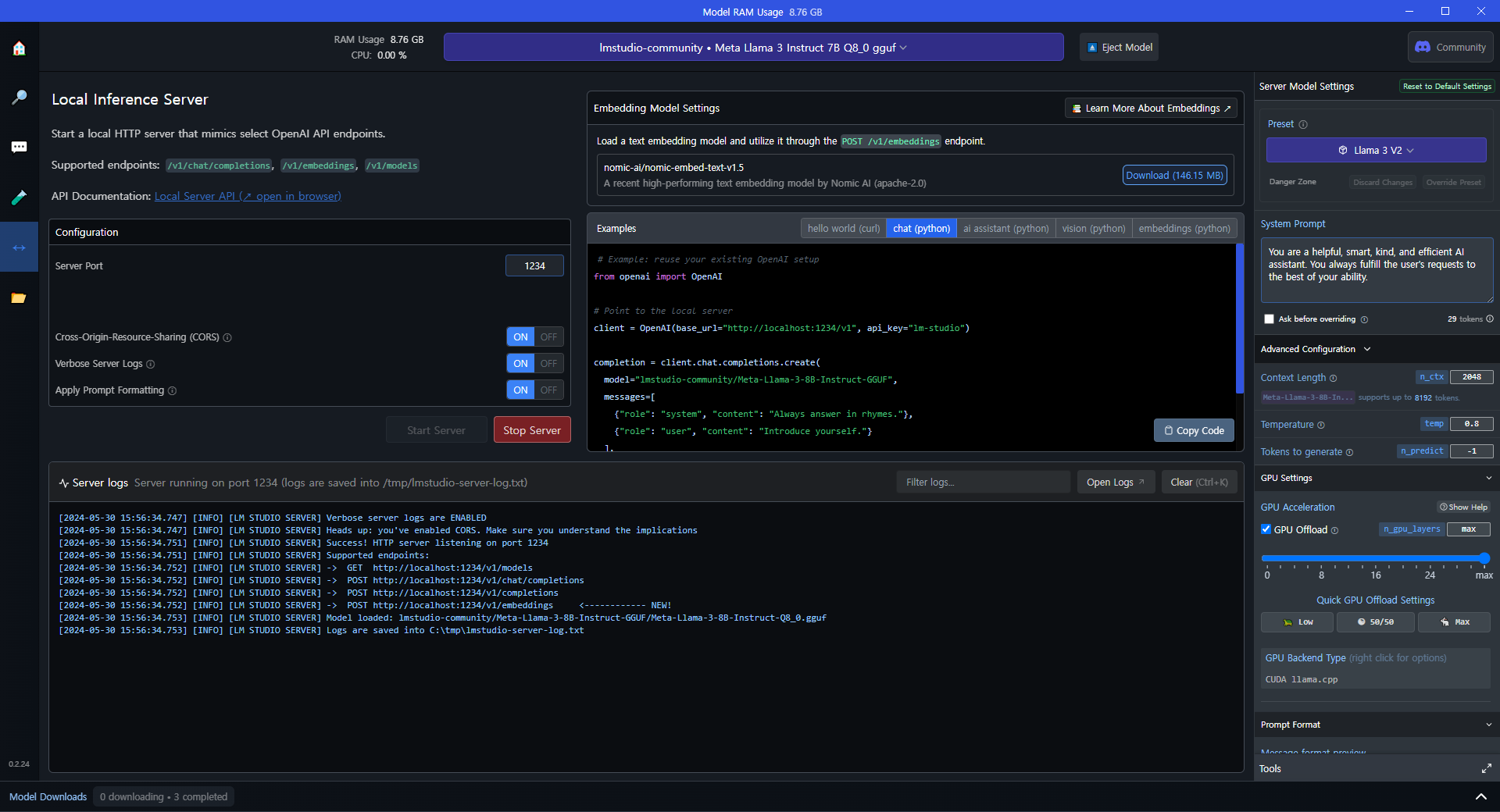

2.LLM 코드에서 돌려보기

지난번에 LM-Studio에서 llm 서버를 동작하여 Obsidian에서 챗봇을 돌려보았다.이 글에서는 파이썬 코드상에서 langchain을 llm 서버에 연결하여 동작시켜보고자 한다.먼저 LM Studio 에서 llm 로컬 서버를 실행해 준다.코드 창을 자세히 보면

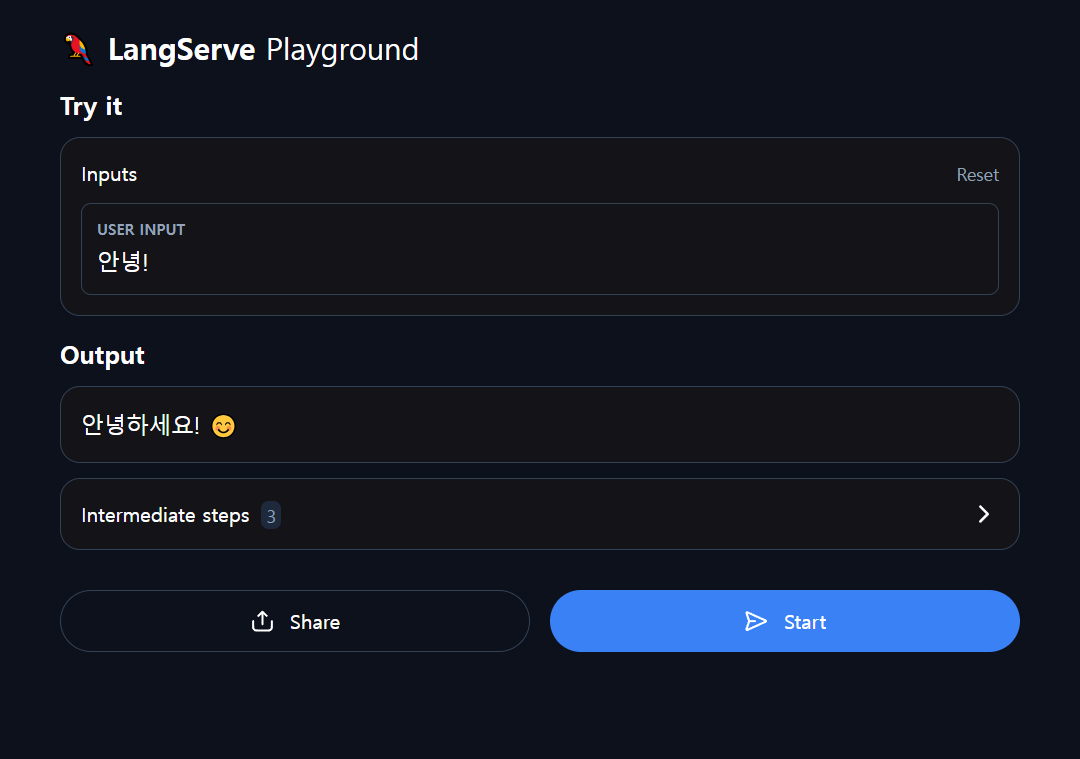

3.간단한 웹 챗봇 만들기

이 글에서는 번역, 요약, 채팅 등을 웹 상에 간단히 만들어 보고자 한다.서버 생성을 위해 필요한 모듈들을 설치해준다.langserve 까지만 설치했었는데 실행해보니 필요한 것들 더 설치하라고 에러 띄운다.app/model.py해당 파일 안에 아래 코드를 넣어 다른 p

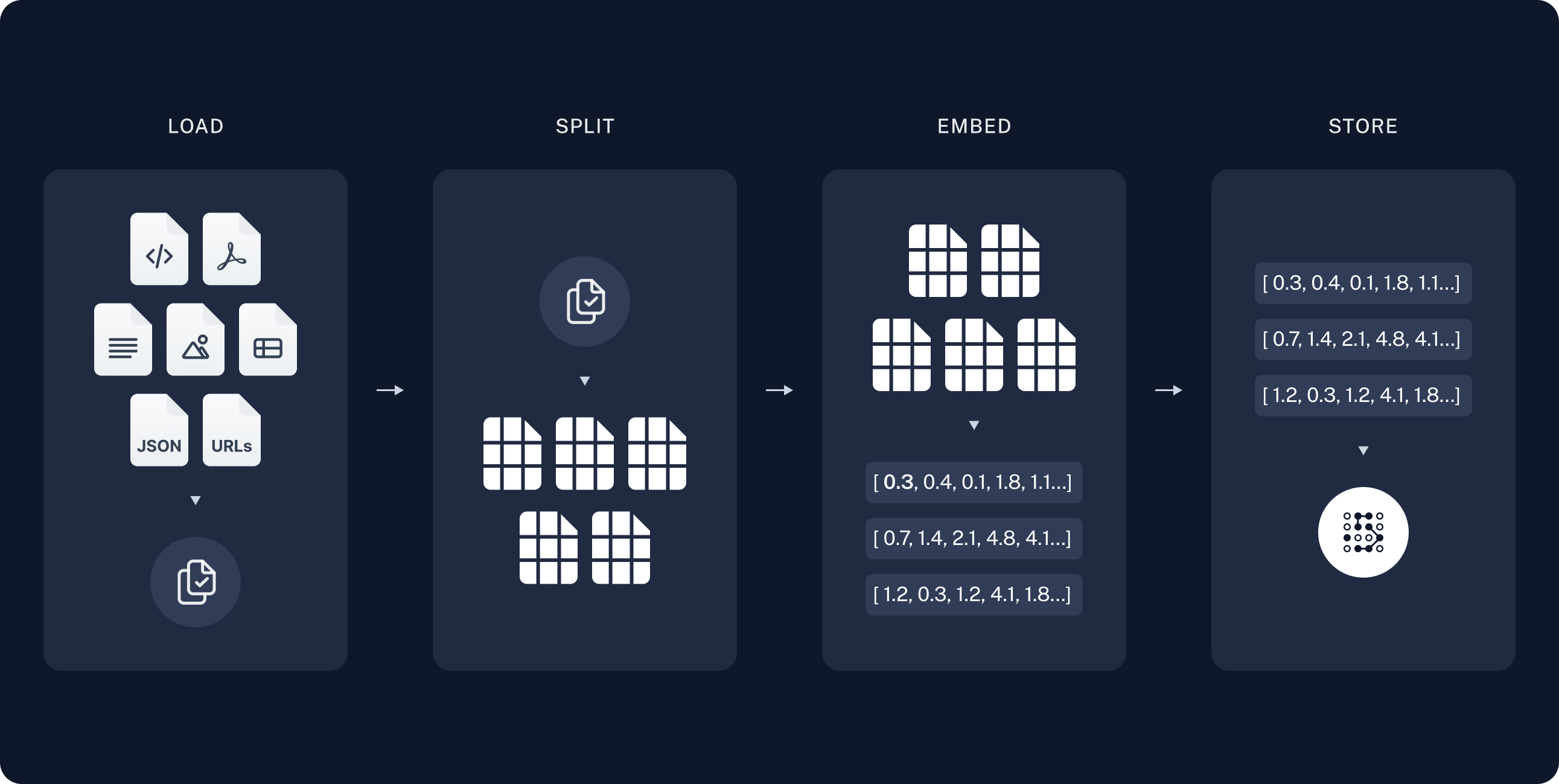

4.LM Studio + RAG 해보기 - 1

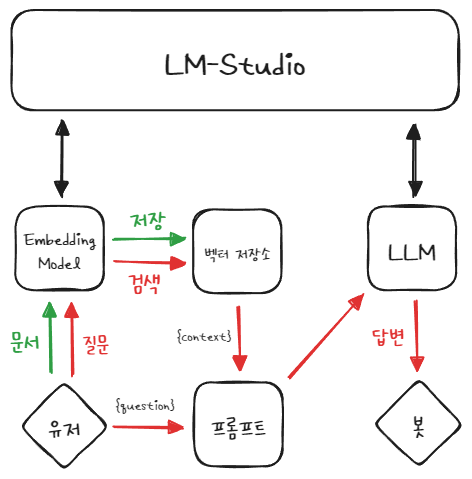

LM Studio에서 로컬로 실행하는 LLM 서버를 기반으로 RAG를 구현하는 것을 목표로 한다.이 글에서는 langchain과 LM Studio를 이용한 embedding, loader, vector store에 관해 다루고자 한다.RAG는 Retrieval Augm

5.LM Studio + RAG 해보기 - 2

이 글에서는 LM Studio에서 로컬로 실행하는 LLM 서버를 기반으로 RAG를 구현해보고자 한다.사용자가 액션을 취할 때마다 코드가 처음부터 끝까지 다시 실행 되는 것 같다.사용자가 액션을 취할 때마다 llm, emb_model 등을 다시 가져오는 불상사가 존재.다