Physical AI

1.[논문 리뷰] OpenVLA: An Open-Source Vision-Language-Action Model

안녕하세요 그루비한입니다. 어느덧 2025년도 마무리 되어가고 2026년이 다가오고 있습니다. 오늘은 회사에서 2025년 한해를 돌아보고 2026년은 어떤 방향으로 나아갈지에 대한 시간을 가졌습니다. 역시 2026년은 Physical AI가 본격적으로 등장하고 미래 먹

2.[논문 리뷰] RT-2: Vision-Language-Action Models Transfer Web Knowledge to Robotic Control

안녕하세요. 그루비한입니다. 지난번에 예고한대로 오늘은 RT-2 논문을 리뷰해보도록 하겠습니다.최근 인터넷 규모의 대규모 Vision-Language Dataset이 비약적으로 발전했지만, 이를 로봇의 실제 동작(Action)과 직접 연결하려는 시도는 여러 난관에 부딪

3.[논문 리뷰] π0: A Vision-Language-Action Flow Model for General Robot Control

안녕하세요. 그루비한입니다.최근 로보틱스 분야의 핵심 과제는 다양한 환경과 태스크에서도 강건하게 동작하는 Generalist Robot Policy를 구축하는 것입니다. 본 포스팅에서는 인터넷 스케일의 세만틱 지식과 정교한 제어 능력을 결합하여 복잡한 조작 태스크를 성

4.[논문 리뷰] CogACT: VLM의 인지 능력과 DiT의 정밀 제어를 결합한 새로운 VLA 모델

안녕하세요 그루비한입니다. 오늘은 지난번 $$\\pi_0$$모델에 이어 어떻게 하면 VLM의 인지능력은 보존하면서 Action Chunk 생성의 능력을 키울 수 있을지 연구한 CogACT 모델을 리뷰해보고자 합니다.논문 링크: Arxiv기존의 VLA(Vision-Lan

5.AI가 세상을 배우는 법 : '월드 모델(World Model)'의 모든 것

안녕하세요 그루비한입니다. 인공지능을 공부하다보면 인공지능의 다음 스텝은 어디일까? 하는 상상을 하게 됩니다. 오늘은 세계적인 인공지능 석학들이 이끄는 각 빅테크 기업에서 시도하는 AI의 다음 스텝인 월드 모델에 대해 알아보겠습니다.인공지능이 텍스트를 생성하고 이미지를

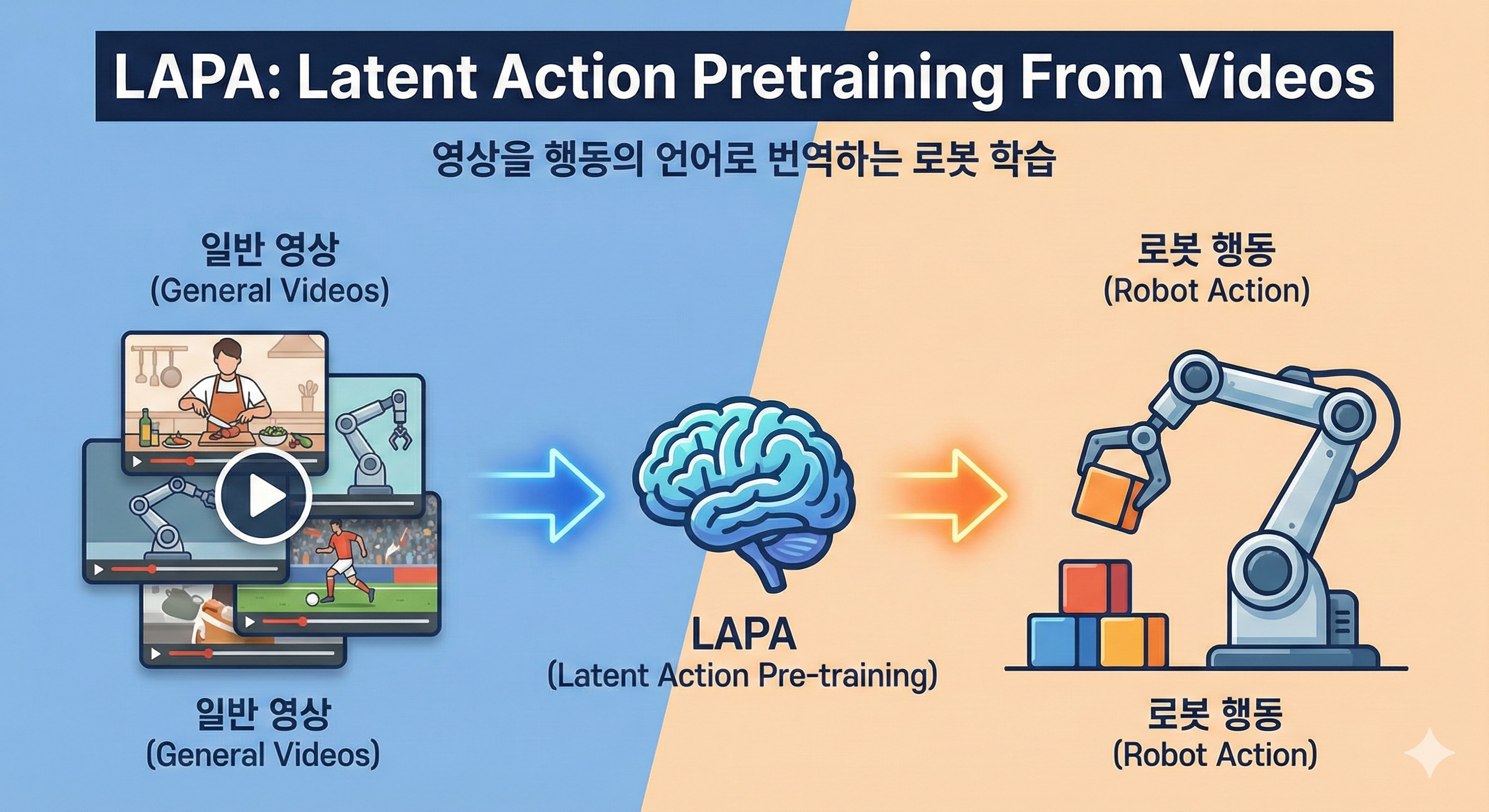

6.[논문 리뷰] LAPA: Latent Action Pretraining From Videos

로봇 공학 분야에서 고성능 VLA(Vision-Language-Action) 모델을 구축할 때 가장 큰 걸림돌은 바로 Action 데이터의 부족입니다. 인터넷에 널려 있는 수많은 영상 데이터와 달리, 로봇의 실제 관절값이나 좌표가 포함된 데이터는 수집하기가 매우 까다롭