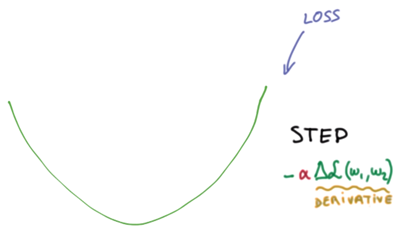

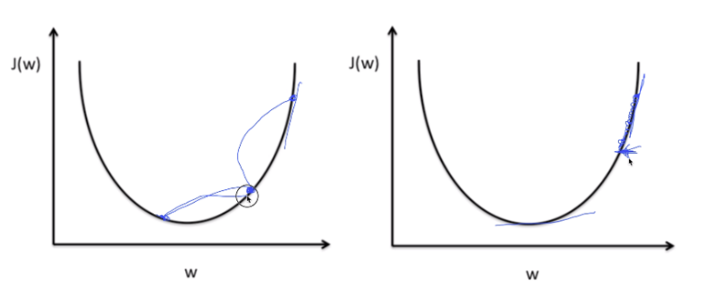

Learning rate

:경사를 따라 한 번 내려갈때 얼마만큼 움직일 지에 대한 수치

-

Gradient Descent Algorithm

-

알파값을 임의로 설정

-

learning_rate = 0.1로 임의로 설정

-

적절히 변경하여 사용 ( Step decay / Exponential decay / 1/t decay )

- Large : 너무 많이 이동하여 W값이 계속 큰 쪽으로 이동하게 됨

- Small : 너무 조금씩 이동하여 최저점에 도달하지 못하고 종료됨

-

Data preprocessing

= Feature Scaling

: 서로 다른 변수의 값 범위를 일정한 수준으로 맞추는 작업

: Feature들의 크기, 범위를 정규화시켜주는 것

- Standardization(Mean Distance)

: 서로 다른 범위의 변수들을 평균이 0이고 분산이 1인 가우시안 정규 분포를 가진 값으로 변환 - Normalization

: 서로 다른 범위의 변수들의 크기를 통일하기 위해 이를 변환

-> 일반적으로 [0, 1] 범위의 분포로 조정

Overfitting

: 학습 데이터(Training Set)를 과하게 학습 하는 것

- 해결방법

- 더 많은 Training Set 수집

- 중복 features 제거

- Regularzation : W값 줄이기

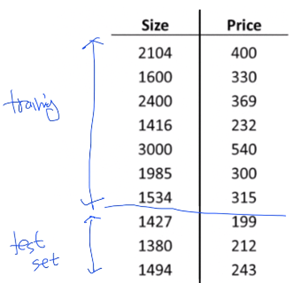

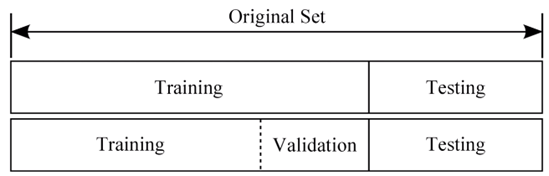

Training and Test Data Sets

-

Training : 훈련 데이터

-

Validation : 모의테스트를 위한 데이터 (튜닝시 사용)

-

Testing : 테스트 데이터

- Online learning : 데이터가 많을 떈 학습시키기 힘들기 때문에 데이터를 잘라서 학습시킴

- Accuracy : 정확도 측정