1.Cost funtion

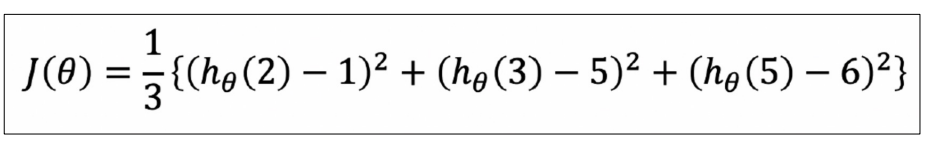

Cost funtion, Loss function(손실함수) : 머신 러닝, 통계 모델에서 모델의 성능을 측정하고 모델을 최적화하는 데 사용

이 함수는 모델의 예측값과 실제 관측값 간의 차이를 측정하고, 이 차이를 최소화하는 방향으로 모델의 매개 변수(가중치 및 편향)를 조정하는 데 도움을 준다.

- 설명

- 성능 측정

- Cost함수는 모델 성능을 측정한다. 예측을 수량화 지표를 만든다.

- 예측값과 실제값 사이의 차이를 나타낸다. 높은 차이는 낮은 모델 성능이다.

- 모델 최적화

- Cost 함수는 모델의 매개 변수(가중치 및 편향)를 조정하여 모델을 최적화하는 데 사용

- 목표는 Cost함수의 값을 최소화하는 모델 파라미터를 찾는 것 이렇게 하면 모델의 예측이 실제 값과 가장 가까워진다.

1.

import numpy as np

#poly1d: 1차 다항식을 나타내는 객체를 생성 ex [2,1] --> [2x+1]

a = np.poly1d([1,1]) # x+1

b = np.poly1d([1, -1]) #x-1

#출력 a,b의 값

#(poly1d([1, 1]), poly1d([ 1, -1]))

#출력 a*b의 값 다항식(x+1) (x-1) = x^2 -1 -->( 1,0 -1)

#poly1d([ 1, 0, -1])

2.

np.poly1d([2, -1]) **2 + np.poly1d([3, -5])**2 + np.poly1d([5, -6]) **2

# poly1d([ 38, -94, 62])

2. 심볼릭 미분(Symbolic Differentiation)

심볼릭 미분(Symbolic Differentiation): 수학적인 식이나 함수를 기호(Symbol)로 표현하고, 이를 사용하여 미분과 같은 수학적 연산 해결하는 과정 의미

#symbolic 연산

import sympy as sym

diff_th = sym.Symbol('theta')

diff_th = sym.diff(38*theta**2 -94*theta + 62, theta) #diff 미분

diff_th

#출력 76θ−94

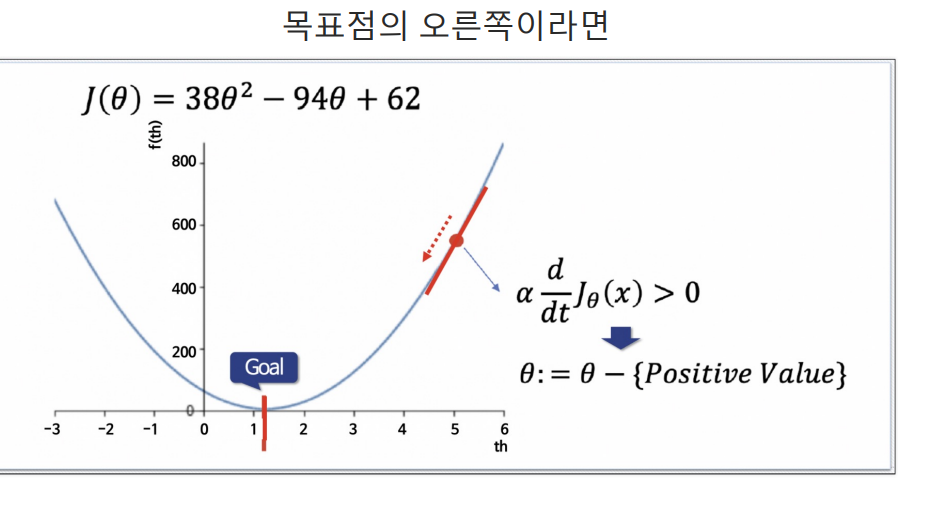

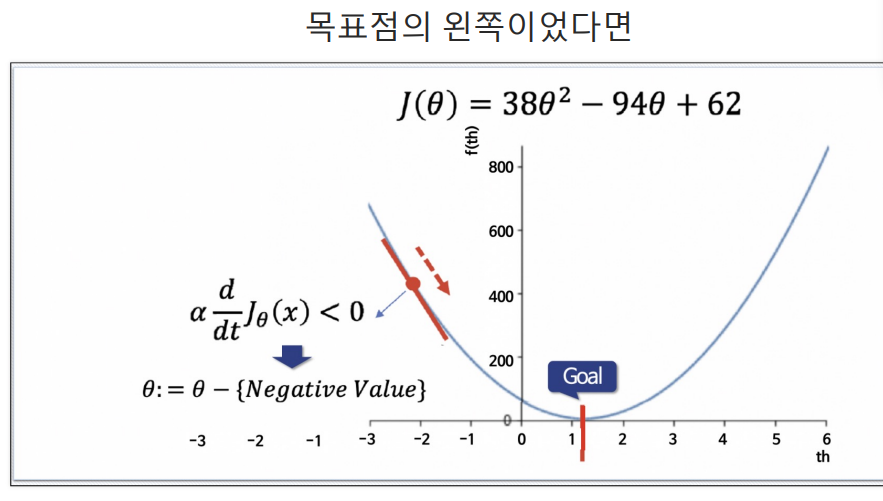

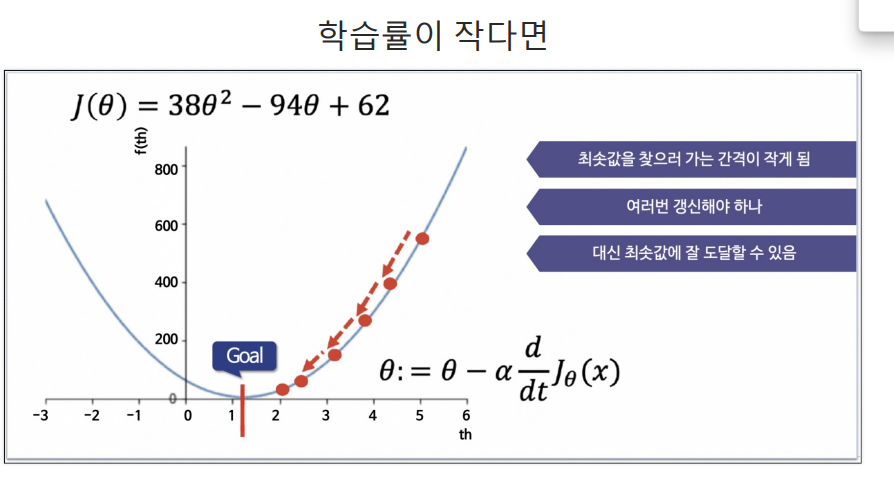

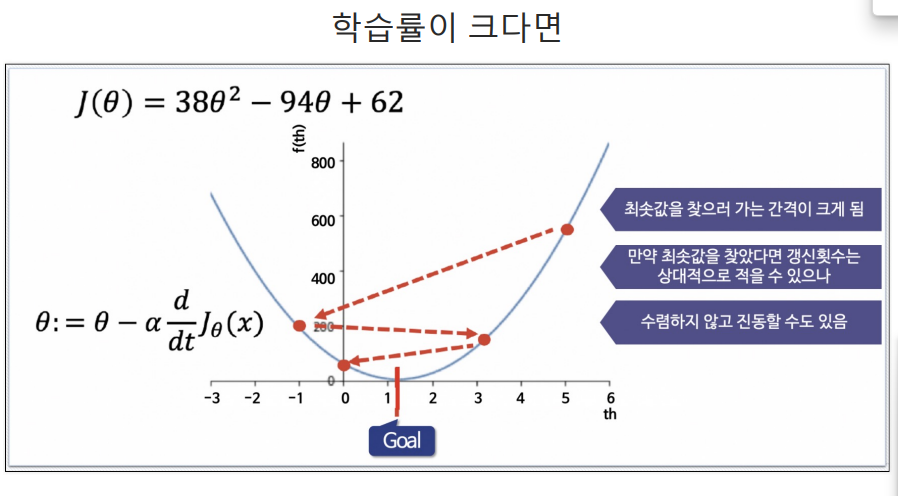

3. Gradient Dscent(경사 하강법)

- 한번의 시도로 cost Fucntion 최소값을 구할수없을때...

- 함수의 최소값을 찾기 위해 사용되는 반복적인 최적화 알고리즘이다.

최소값은 함수의 기울기가 0인 지점- 모델의 손실 함수를 최소화하거나 비용 함수(Cost Function)을 최소화

- 학습률이 너무 크면 안된다. 학습률이 크다면 수렴하지 않고진동