Overview

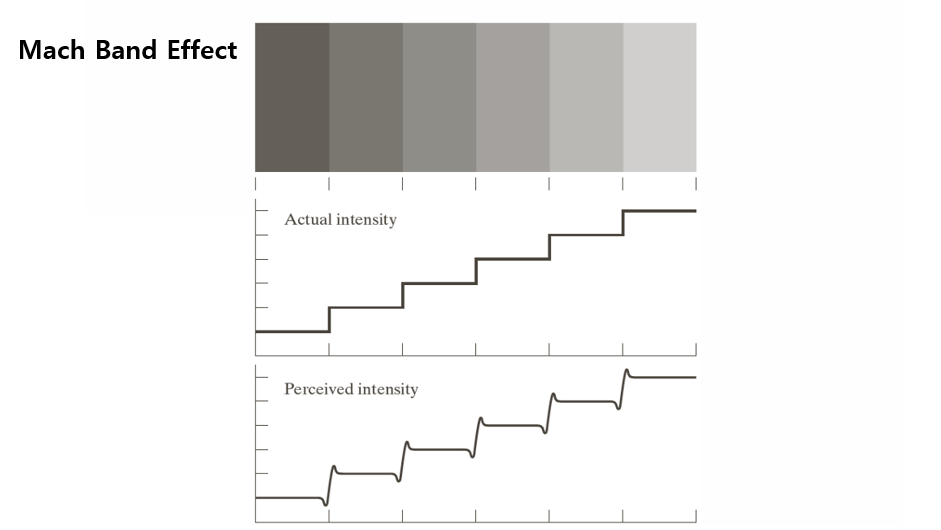

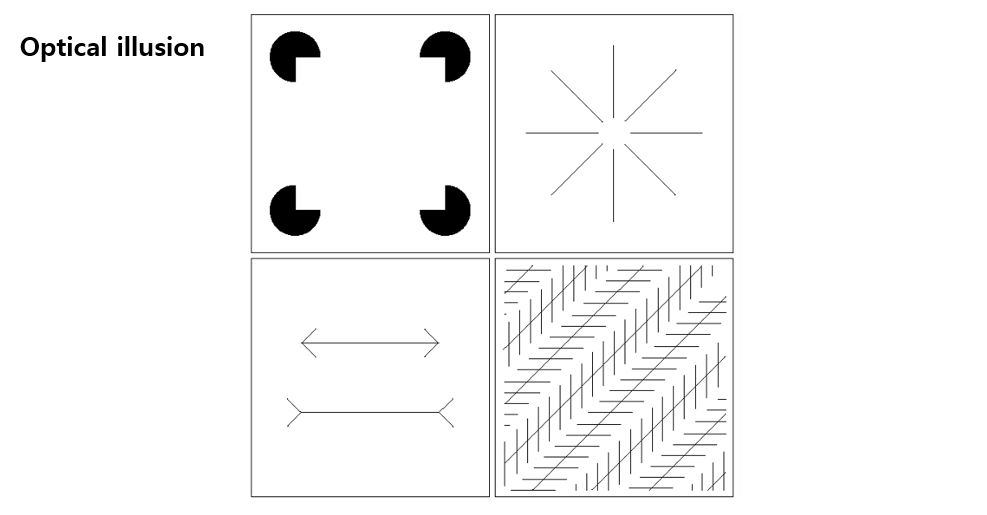

컴퓨터 비전(Computer Vision)은 인간의 시각 시스템을 모방해 이미지를 해석하는 기술이지만, 그 시작점에서 중요한 사실은 인간의 시각 자체도 완벽하지 않다는 점이다. 이를 보여주기 위해 Mach Band 효과, 동시 대비(Simultaneous Contrast), 다양한 시각 착시(Optical illusion) 사례가 제시된다. 이러한 현상들은 실제 물리적 특성과 우리가 인지하는 시각적 정보가 다를 수 있음을 보여준다.

Mach Band는 밝기 변화의 경계에서 더 어둡거나 밝게 인식되는 과잉 반응을 보여주며,

Simultaneous Contrast는 동일한 색이 주변 색상에 따라 다르게 보이는 맥락 의존성을 나타낸다. 이는 인간의 시각이 단순한 '빛의 측정'이 아니라 복잡한 해석 과정임을 의미한다.

이 사실은 컴퓨터 비전 문제의 본질적 난이도를 설명하는 단서가 된다. 비전 시스템은 단순히 픽셀 값을 읽는 것이 아니라, 주어진 영상에서 의미를 유추하는 역문제(inverse problem)를 해결해야 한다. 따라서 인간의 시각적 착시를 통해 강조되는 점은, 이미지 처리와 인식은 단순하지 않으며, 체계적인 접근이 필요하다는 것이다.

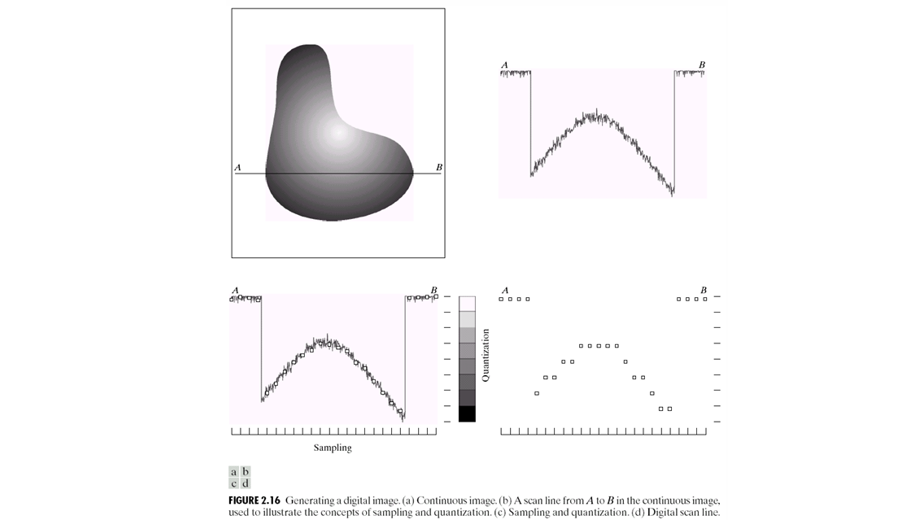

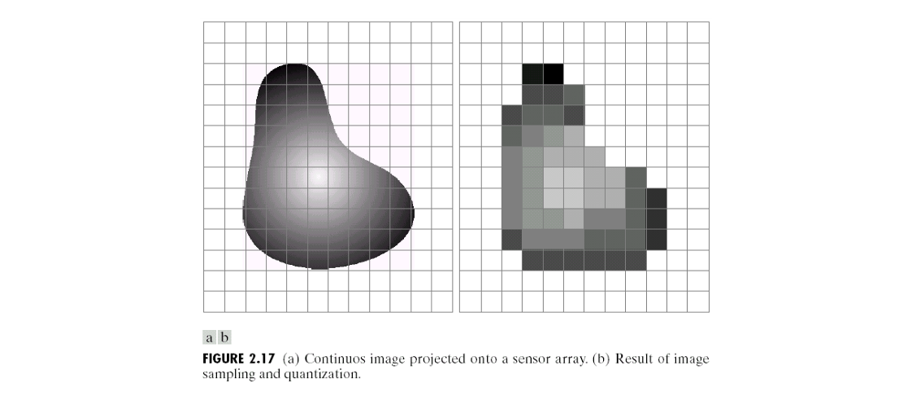

이후 우리는 컴퓨터가 이미지를 다루기 위해 무엇을 해야 하는지 살펴본다. 컴퓨터는 연속적인 아날로그 신호를 직접 처리할 수 없기 때문에, 이를 이산적인 디지털 데이터로 변환해야 한다. 이 과정에서 핵심이 되는 개념이 샘플링(Sampling)과 양자화(Quantization)이다. 샘플링은 공간적, 시간적 간격에 따라 데이터를 추출하는 과정이며, 양자화는 연속된 값을 제한된 범위의 수치로 근사하는 과정이다. 이러한 기초 과정을 통해 실제 세계의 이미지는 컴퓨터가 이해할 수 있는 형태로 표현되고, 이후의 다양한 비전 알고리즘이 적용될 수 있다.

Wave

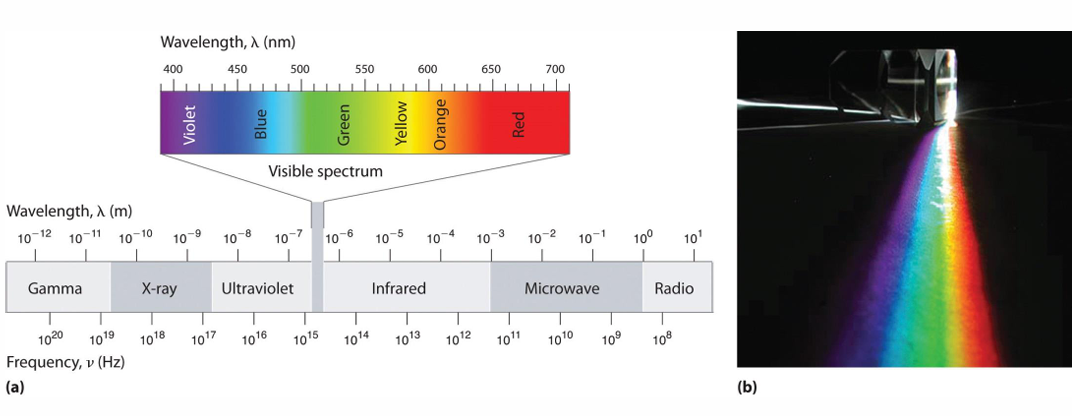

빛은 전자기파(Electromagnetic Wave)로, 컴퓨터 비전에서 가장 중요한 파동이다. 파동은 일반적으로 진폭(Amplitude), 파장(Wavelength), 주파수(Frequency)로 표현된다.

- 파장 () : 파동의 한 주기 길이, 빛의 색을 결정 (단위: nm)

- 가시광선: 약 400nm(보라) ~ 700nm(빨강)

- 주파수(f) : 1초에 반복되는 파동의 횟수 (Hz)

- 진폭 : 파동의 에너지 크기, 밝기와 관련

빛은 파동의 성질뿐 아니라 입자의 성질도 갖지만, 이미지 센서에서는 파장의 차이를 감지하여 색상을 표현하게 된다.

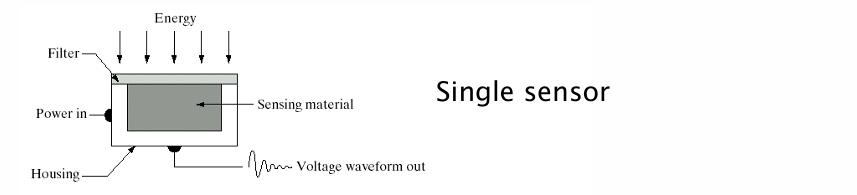

Image Sensor (이미지 센서)

이미지 센서는 빛을 전기 신호로 변환하여 컴퓨터가 처리할 수 있는 디지털 데이터로 만드는 장치이다. 카메라나 비전 시스템의 핵심 요소이며, 센서 구성에 따라 세 가지 형태로 구분된다.

(1) Single Sensor 단일 센서

- 카메라의 전체 이미지를 단일 센서로 감지

- 일반적으로 컬러 필터 배열(CFA, Bayer Filter)을 사용 (R, G, B 픽셀을 격자 형태로 배치)

- 장점 : 소형화 가능, 비용 효율적

- 단점 : 컬러 정보 보간(Interpolatioin) 필요 > 해상도 손실 가능

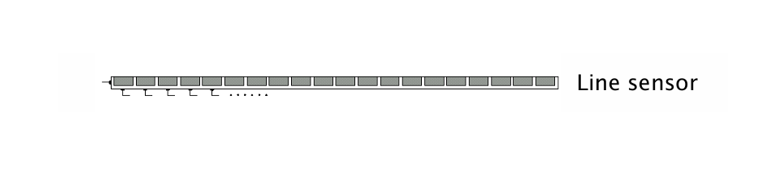

(2) Line Sensor 라인 센서

- 한 줄의 픽셀(1D)만 존재하는 센서

- 카메라나 물체가 이동하면서 라인 단위로 스캔 > 2D 이미지 구성

- 주로 고속 스캐닝 시스템, 산업용 검사 장비에서 사용

- 장점 : 고해상도 가능, 큰 폭의 이미지 처리

- 단점 : 라인 스캔 시 정확한 동기화 필요

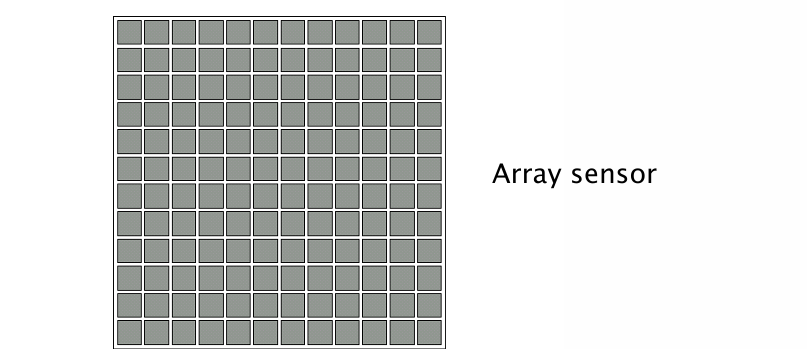

(3) Array Sensor 배열 센서

- 2D 배열 형태의 픽셀로 구성

- 대부분의 디지털 카메라에서 사용

- 장점 : 즉시 2D 이미지 캡쳐 가능

- 단점 : 제조 비용이 비교적 높음, 고성능 이미지 센서 제작 어려움

요약 정리 표

| 센서 유형 | 구조 | 특징 | 주요 활용 |

|---|---|---|---|

| Single Sensor | 1개 센서 | Bayer 필터 활용, 색상 보간 필요 | 스마트폰, DSLR |

| Line Sensor | 1D 라인 | 이동 스캔 필요, 고속 처리 가능 | 산업용 검사, 스캐너 |

| Array Sensor | 2D 배열 | 즉시 이미지 캡처 가능, 일반 카메라에 적용 | 디지털 카메라 |

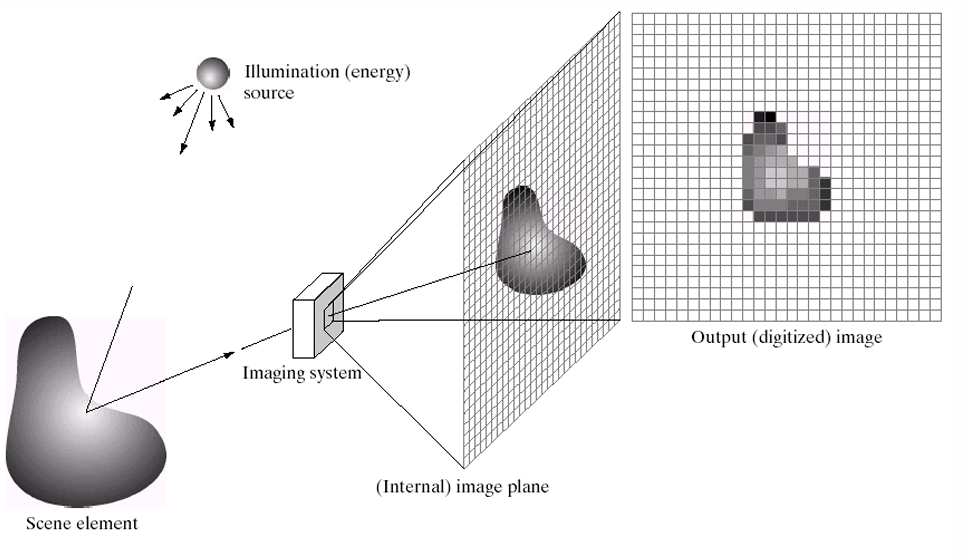

Digital Image Acquisition Process (디지털 이미지 획득 과정)

디지털 이미지 획득(Digital Image Acquisition)은 실세계의 장면(Scene)을 디지털 데이터로 변환하는 과정이다. 이 과정은 카메라, 센서, 광원 등 다양한 요소가 상호작용하여 수행된다. 기본적인 흐름은 다음 단계로 설명할 수 있다.

1. Illumination (Energy Source)

- 이미지 획득의 첫 단계는 에너지 소스(빛)이다.

- 대부분의 경우 가시광선이 사용되지만, 적외선, X선 등 특정 응용에서는 다른 파장대의 에너지도 활용된다.

- 조명은 장면(Scene) 요소에 반사 또는 투과되어 카메라로 전달된다. (빛의 특성(세기, 파장)에 따라 이미지 품질과 색상이 달라짐)

2. Scene Elements

- 장면(Scene)의 물체들이 빛을 반사, 흡수, 산란한다.

- 이때 물체의 반사율, 질감, 색상 등 물리적 특성에 따라 카메라로 들어오는 빛의 양이 달라진다.

- 물체 특성 + 조명 조건 = 센서가 받는 신호의 차이

3. Imaging System

- 장면에서 반사된 빛은 이미지 시스템(렌즈 + 광학 요소)을 통해 카메라 내부로 전달된다.

- 렌즈는 빛을 굴절시켜 초점(focus)을 맞추고, 이미지가 내부 영상 평면(Internal Image Plane)에 맺히도록 한다.

- 이 과정에서 광학 왜곡(distortion), 초점 거리, 조리개 크기 등이 이미지 품질에 큰 영향을 미친다.

4. Internal Image Plane

- 센서가 위치하는 영역으로, 빛의 강도 정보가 전기 신호로 변환된다.

- 이미지 센서의 역할

- 광전 변환(Photoelectric conversion) : 빛 -> 전하

- 샘플링(Sampling) : 연속적인 빛 신호 -> 픽셀 단위 이진화

- 양자화(Quantization) : 밝기 값을 정해진 디지털 값으로 변환

- 이 단계에서 Raw 이미지가 생성된다.

5. Output Digitized Image

- 변환된 전기 신호는 ADC(Analog-to-Digital Converter)를 통해 디지털 데이터로 변환된다.

- 최종적으로 디지털 이미지(픽셀 값의 행렬)가 생성되어 저장되거나, 추가적인 이미지 처리 단계로 전달된다.

- 결과 : 픽셀(x, y) + 밝기 값(intensity or RGB) 형태의 데이터

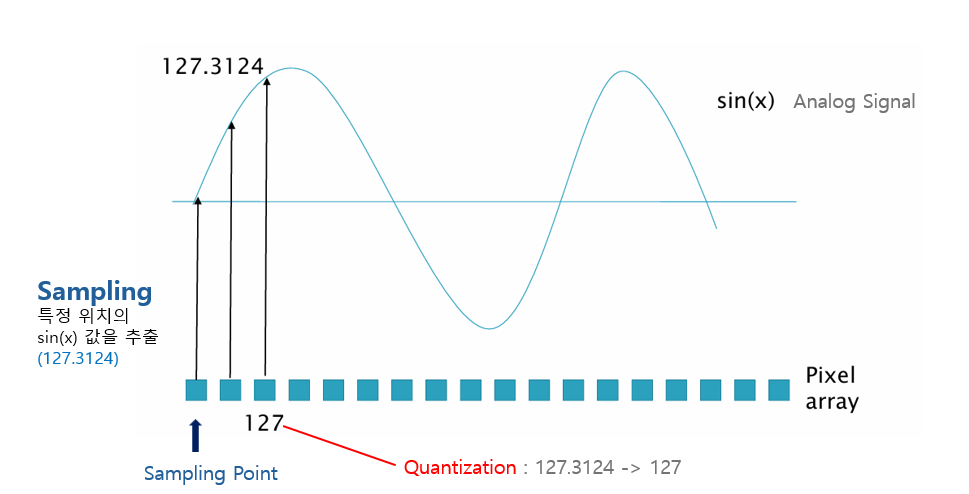

Example of Sampling and Quantization

- sin(x) 곡선

- 상단의 곡선은 연속적인 아날로그 신호(여기서는 sin(x))를 나타낸다.

- 실제 세계에서 빛의 강도, 소리의 파형 등은 모두 이런 연속적인 형태를 가진다.

- Pixel Array(하단의 파란 사각형)

- 하단의 사각형 배열은 픽셀의 위치를 의미한다.

- 각 픽셀은 일정한 간격으로 샘플링 포인트(Sampling Point)를 나타낸다.

- 공간적 샘플링 : 연속적인 신호를 특정 간격으로 나누어 값 추출

- 화살표 (Sampling)

- 각 화살표는 특정 위치에서 sin(x)의 값을 추출하는 과정(샘플링)을 보여준다.

- 예를 들어, 첫 번째 화살표는 sin(x)=0, 세 번째는 sin(x)=127.3124

- 이 단계에서 샘플링 주기가 해상도를 결정한다.(픽셀 간격이 넓으면 저해상도(Detail 손실), 촘촘하면 고해상도)

- 양자화 (Quantization)

- 그림에서는 127.3124 -> 127로 변환된 값이 있다.

- 이것이 바로 양자화(Quantization)이다.

- 샘플링으로 얻은 연속값(예: 127.3124)을 정해진 비트 깊이(예: 8bit > 0~255) 안에서 가장 가까운 정수 값으로 변환

- 이로 인해 정보 손실(Quantization Error)가 발생 가능하다.

센서는 이산적인 에너지 레벨 집합에서 제한된 수의 샘플만 측정할 수 있다.

즉, 실제 세계의 연속적인 신호(빛, 에너지)를 센서는 무한히 측정할 수 없으며, 정해진 위치에서만 샘플링하고, 측정값은 정해진 몇 개의 에너지 레벨 중 하나로 표현된다는 의미이다.

쉽게 말해, 센서는 "연속적인 신호"를 "픽셀 단위"로 나누어(샘플링), 그 값은 "정해진 단계(0~255)" 중 하나로 저장한다.(양자화)

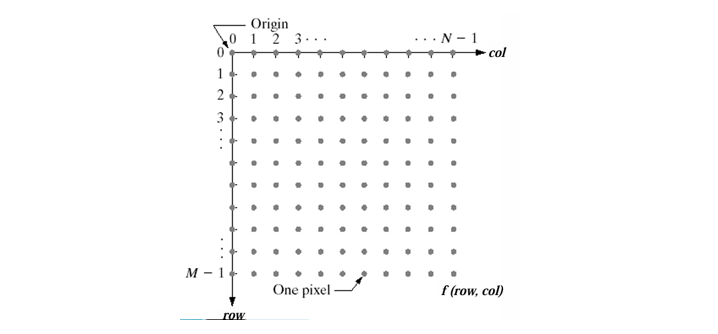

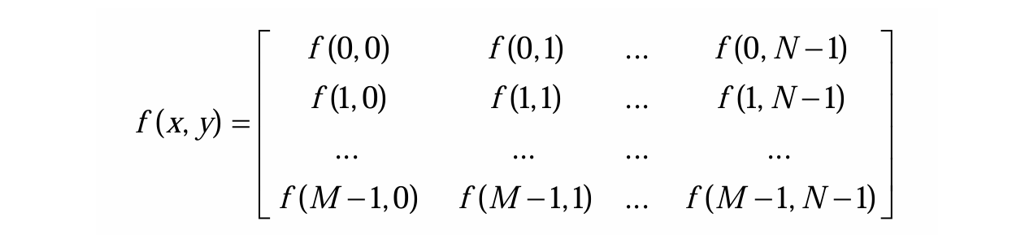

Cordinate for Digital Images

디지털 영상에서 좌표계는 픽셀의 위치를 정의하는 기준이다. 좌표계 이해는 영상 처리(회전, 이동, 보간) 및 컴퓨터 비전 알고리즘에서 필수이다.

- Discrete Coordinate System(이산 좌표계) 영상은 MxN 픽셀의 격자(grid)로 구성되어 있다.

- 원점 위치 : 일반적으로 왼쪽 상단이 (0,0)

- x축 : 오른쪽으로 증가, y축 : 아래쪽으로 증가

영상은 수치 배열(numerical array) 형태로 표현 가능하며, 이를 행렬(Matrix)로 생각할 수 있다.

- M : 행(Row) 개수 > 세로 방향 픽셀 수

- N : 열(Column) 개수 > 가로 방향 픽셀 수

- Gray Image : 1채널(밝기)

- Color Image : 3채널(RGB)

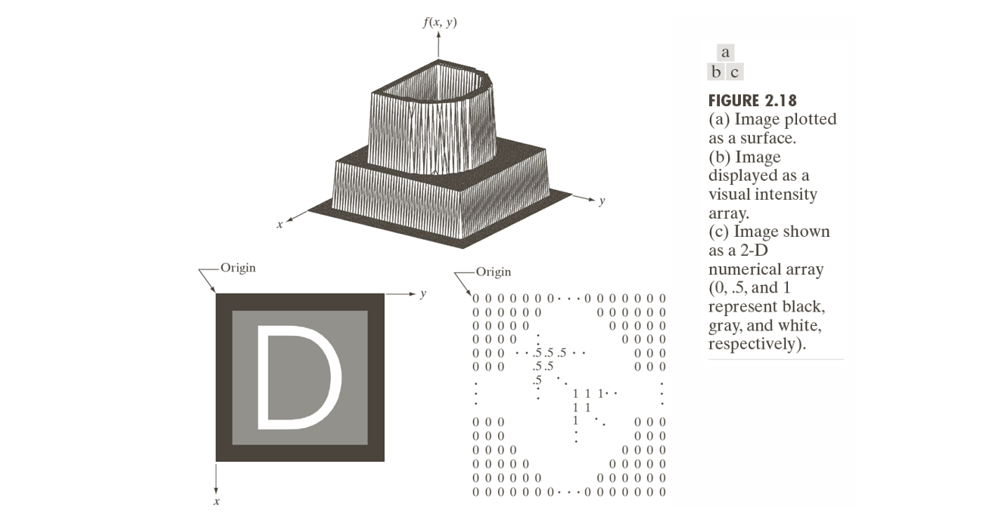

디지털 이미지는 하나의 물체를 다양한 관점에서 표현이 가능하다.

(1) 3D Surface Plot

- 이미지의 픽셀 좌표(x, y)를 바탕으로 밝기 값 f(x,y)를 z축으로 표현

- 즉, 밝기가 클수록(흰색) 더 높은 "봉우리", 밝기가 낮으면(검정) 더 낮은 부분

(2) 시각적 영상 배열(Visual Intensity Array)

- 우리가 일반적으로 보는 2D 이미지

- 픽셀 값은 눈으로 구분할 수 있는 밝기 단계로 표시

(3) 수치 배열(Numerical Array Representation)

- 각 픽셀 값을 숫자로 표현한 2D 행렬

Numer of Storage Bits

디지털 이미지를 저장하기 위해서는 픽셀 수(M x N)와 픽셀당 필요한 비트 수(색상 깊이, Bit Depth)에 따라 메모리 용량이 결정된다.

Assumption

- 이미지 해상도 : x (행 x 열)

- 그레이스케일: 밝기 단계(Intensity Level) = -> 8비트

- 컬러 이미지(RGB) : 각 채널마다 8비트 -> 총 24비트 = 3바이트

(1) Gray Image(흑백)

- 1픽셀 = 8비트 = 1바이트

- 전체 픽셀 개수 : x

- 총 저장 용량 :

(2) Color Image(RGB 컬러)

- RGB 3채널 -> R, G, B 각각 8비트

- 즉, 1픽셀 = 24비트 = 3바이트

- 전체 픽셀 개수 :

- 총 저장 용량 :

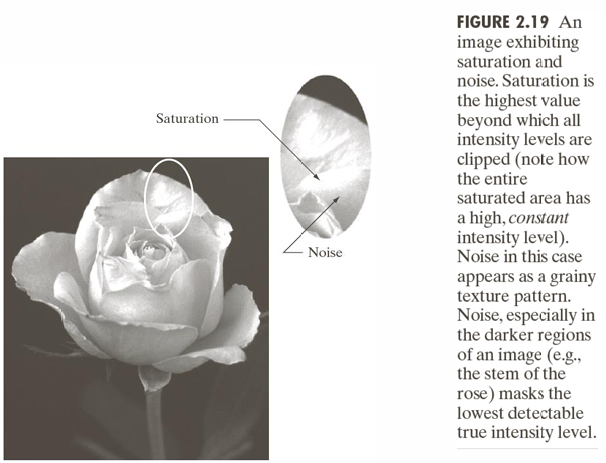

Saturation and Noise

디지털 이미지 품질에 영향을 미치는 두 가지 주요 요인은 포화(Saturation)와 잡음(Noise)이다.

- 포화(Saturation)

센서나 이미지가 포현할 수 있는 최대 밝기(예: 255, 8비트 기준)을 초과하는 경우, 모든 값이 최대치로 고정되어 하얀색으로 표시되는 현상이다. 이로 인해 밝은 영역의 디테일이 손실된다.

-

잡음(Noise)

원하지 않는 무작위 신호가 픽셀 값에 섞이는 현상이다. 센서 특성, 전기적 간섭, 저조도 촬영 시 발생하며, 이미지에 거친 질감을 만들어 시각적 품질 저하를 일으킨다.

Saturation

- 원인

- 카메라 센서가 지나치게 강한 빛을 받음

- 이미지의 동적 범위(Dynamic Range)가 부족

(동적 범위: 센서가 표현할 수 있는 최소~최대 밝기)

- 결과

- 밝은 부분이 모두 동일한 최대값(255)으로 고정 -> 세부 정보 손실

- 시각적 특징

- 이미지에서 하이라이트 영역이 모두 하얗게 날아감

Noise

- 원인

- 저조도 환경에서 고감도(ISO) 촬영

- 센서 열 잡음, 전기적 간섭

- 특징

- 픽셀 값이 랜덤하게 변화

- 주로 어두운 영역에서 더 심함

- 시각적 특징

- 얼룩진 점 무늬(grain), 색 잡음 발생

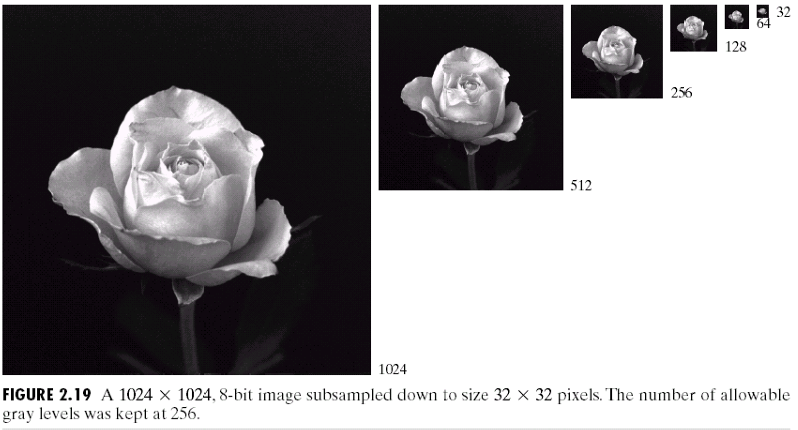

Image Resolution

영상 해상도(Image Resolution)는 디지털 이미지가 표현할 수 있는 세부 정도(detail level)을 나타내며, 크게 두 가지 요소로 구성된다.

1. 공간 해상도(Spatial Resolution) : 이미지의 가로 x 세로 픽셀 수로 표현된다.

- 1024 x 1024 > 약 1백만 픽셀(1MP)

- 1920 x 1080 > Full HD(2mp)

- 픽셀 수가 많을수록 더 많은 세부정보 표현 가능

2. 명암 해상도(Intesity Reolution) : 각 픽셀이 표현할 수 있는 밝기 단계의 수

- 8bit > 256단계(0~255)

- 16bit > 65536단계

- 단계가 많을 수록 더 부드러운 명암 표현 가능

즉, 해상도는 "픽셀 개수 + 픽셀당 명암 단계"의 조합으로 결정된다.

- 원본 이미지 : 1024x1024, 8비트 그레이스케일

- 픽셀 수 = 약 1048576

- 한 픽셀당 1바이트 > 약 1MB

- 디테일이 매우 선명하게 보임

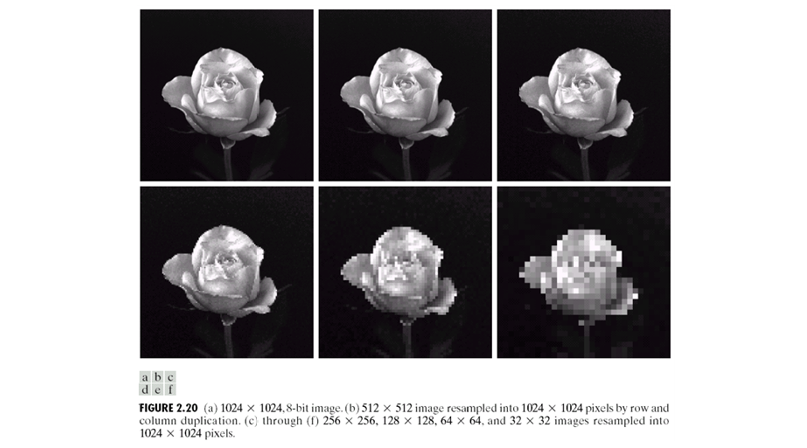

- 서브샘플링(Subsampling) : 원본 이미지를 점점 작은 크기로 줄인다.

- 512x512 > 디테일은 줄지만 전체 구조는 유지

- 128x128 > 세부 패턴 흐려짐

- 32x32 > 디테일 거의 사라짐, 모자이크처럼 단순해짐

- 리샘플링(Resampling) : 위에서 서브샘플링으로 축소된 이미지를 다시 1024x1024 크기로 확대한다.

원본이미지를 다운샘플 후 다시 1024x1024로 업샘플한 결과 32x32와 원본을 비교하면, 세부 디테일이 완전히 사리지고, 큰 블록 형태만 남는 모습이 보인다.

이는 공간 해상도가 낮으면 원본 정보가 손실되고 복원이 어렵다는 것을 보여준다.

References

Images from Rafael C. Gonzalez and Richard E.

Wood, Digital Image Processing, 2nd Edition.