Abstract

- 대규모 데이터셋을 정확하고 효율적으로 주석을 다는 것은 비용이 많이 들고 어려움.

- coarse 라벨들은 전문가의 지식을 요구하지 않기 때문에 더욱 얻기 쉬움.

- 따라서, 더 미세한 라벨링을 위해 coarse 라벨을 사용하는 Masked Contrastive Learning (MaskCon)을 제안함.

1. Introduction

- 지도 학습의 성공은 주석이 시간이 많이 걸리고 노동 집약적인 대규모 및 고품질 인간 주석 데이터 세트에 의존함.

- 레이블이 거의 없는 데이터셋을 활용하여 세분화된 표현을 학습하는 것을 목표로 함.

- 보다 전문화된 도메인에서는 세분화된 레이블보다 거친 레이블을 얻기가 더 쉬움.

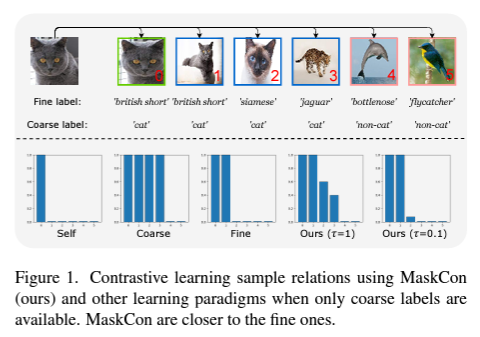

- 예를 들어, 애완동물을 구별하는 작업에서는 전문가 수준의 지식이 필요하지만, 고양이와 고양이가 아닌 것을 구별하는 데에는 더 간단한 레이블만으로도 도움이 될 수 있음.

- 이 연구에서는 거친 레이블을 이용하여 세분화된 레이블 문제를 해결하는 방법을 제안함.

2. Related Works

2.1. Self-supervised contrastive learning

- SimCLR (Simple Contrastive Learning)

- MoCo (Momentum Contrast)

- SwAV (Swapped Augmentations and Views)

- Triplet Loss (Triplet-based Contrastive Learning)

*대조학습에서는 동일한 클래스이 샘플을 부정적인 예로 간주하는 경우가 있음.

-> 이를 자기 지도 대조학습에서는 샘플 간의 관계를 직관적으로 수정하여 사용함

2.2. Combing contrastive learning with supervised learning

- Neighbourhood Components Analysis (NCA)

- Supervised Contrastive Learning

- Cross-Entropy Loss

- Rotation-Prediction Objective

- Few-Shot Learning

- Label-Filtered Instance Discrimination

- S4

- Exemplar Prediction

- Semi-Supervised Learning

- Self-Supervised Contrastive Loss

2.3. Hierarchical image classification & Unsupervised clustering

- DeepCluster

- SCAN

3. Selective Supervised Contrastive Learning

3.1. Supervised Learning

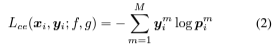

- 대부분의 지도 학습 프레임워크에서는 아래의 경험적 위험을 최소화하는 것이 목표임.

- the cross-entropy loss function

3.2. Contrastive Learning

-

Cosine Similarity of x_i

-

Empirical risk

-

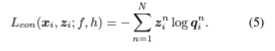

Contrastive loss

3.3. Baseline methods

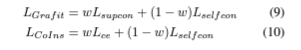

- 최근의 연구들은 추가적인 자기-지도 대조 손실을 특정 지도 손실과 결합하여 이러한 하위 클러스터링을 다루려고 시도함.

- Grafit[31]은 지도 대조 손실과 결합시켰고, CoIns[37]은 지도 교차 엔트로피 손실과 결합시킴.

- 두 경우 모두, 각 샘플을 개별적인 클래스로 고려하는 자기-지도 대조 손실은 하위 클러스터링 경향을 완화하는 것을 목표로 함.

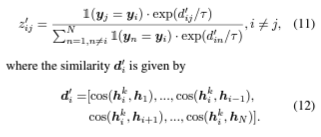

3.4. MaskCon: Masked Contrastive Learning

- 거친 클래스 내의 모든 샘플을 동일하게 가중하는 대신, 동일한 세분화된 레이블을 가진 샘플에 주목하고 다른 샘플의 중요성을 줄이려고 함.

- 이를 위해 우리는 상호 샘플 관계를 직접 활용하는 대조 학습의 프레임워크 내에서 새로운 대조 학습 방법인 Masked Contrastive Learning (MaskCon)을 도입함.

- 최종적인 loss는 다음과 같음.

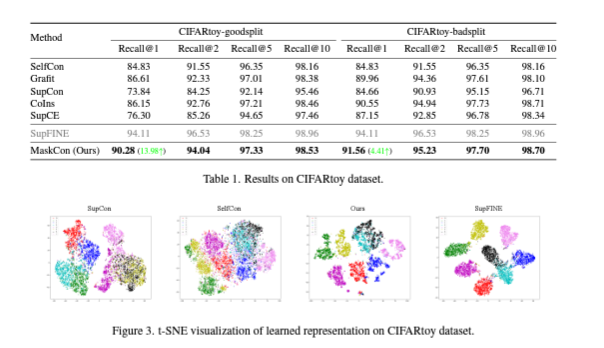

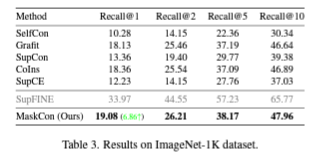

4. Experiments

-

Benchmark model

: Grafit , Colns , Moco , SupCon -

Dataset

: Cifar10, Cifar100, ImageNet 1K, Stanford Cars19

-

Good Split

Class A : ’airplane’, ’truck’, ’automobile’, ’ship’ Class B : ’horse’, ’dog’, ’bird’, ’ -

Bad Split

Class A : ’airplane’, ’automobile’, ’bird’, ’cat’ Class B : ’horse’, ’dog’, ’ship’, ’

5. Discussion

- CIFAR 데이터셋에서 제안 방법의 성능은 세밀한 레이블이 있는 지도 학습과 거의 비슷함.

- 우리는 거친 레이블이 일반적으로 더 나쁜 결과로 이어지지 않는 한, 문제가 되는 instance discrimination 작업이 세부 그룹 분류에 유용한지를 고려해야 한다고 주장함.

- 이에 대해 supervised contrastive learning의 핵심 아이디어인 augmentation invariance가 세부 그룹 작업에 파괴적일 수 있다는 것을 보여줌.

- 예를 들어, 일반적으로 적용되는 색상 왜곡 augmentation은 모델이 색상 정보에 무감각해지도록 유도함. 그러나 색상은 서로 다른 새 종류를 구별하는 핵심일 수 있음.

- 따라서, 거친 레이블 데이터셋에 instance discrimination 작업을 어떻게 적응시킬 수 있는지 연구하는 것이 필요함.