DuoGuard: A Two-Player RL-Driven Framework for Multilingual LLM Guardrails

Introduction

- 영어 외 언어에 대해서는 공개된 안전 데이터가 많지 않아 다국어 가드레일 모델의 종류 및 성능 또한 제한됨

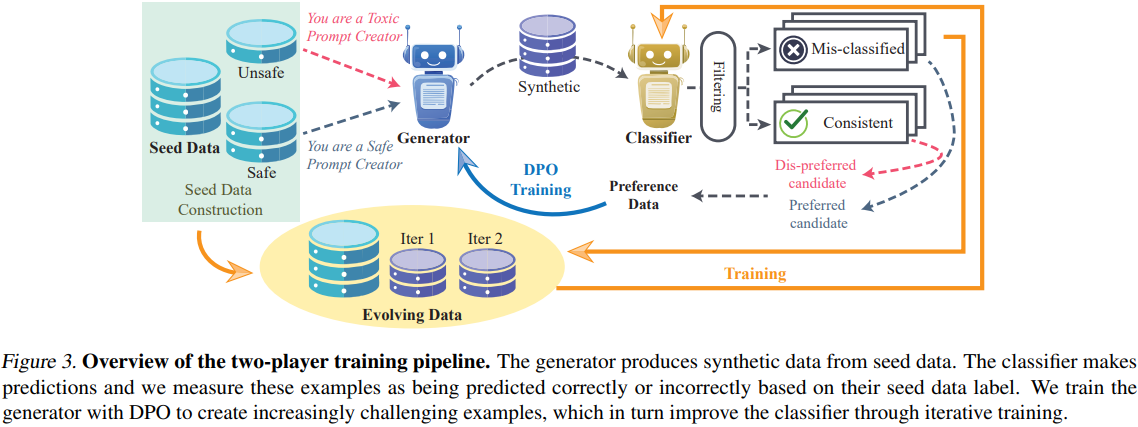

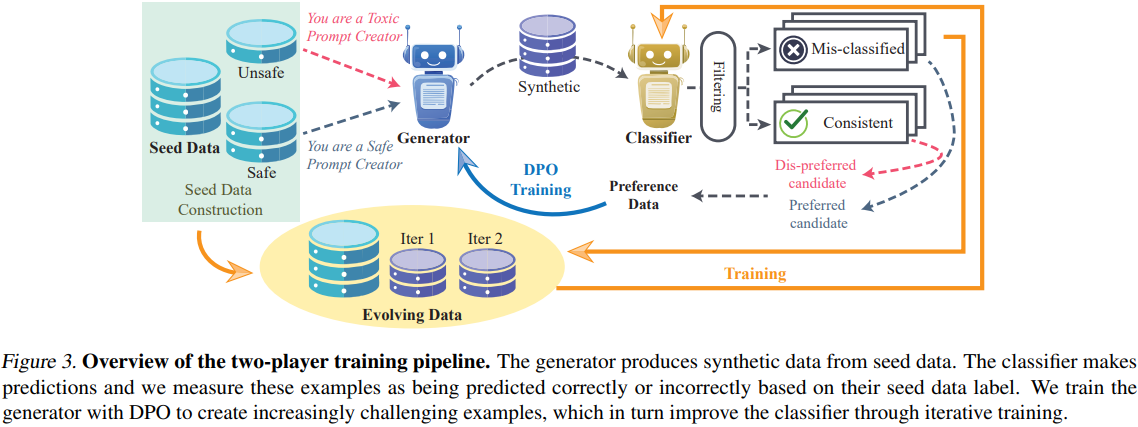

- 생성자와 가드레일 모델 간 적대적 훈련을 통해 고품질의 합성 데이터를 생성하는 2-Player 강화 학습 프레임워크 DuoGuard 제안

Methodnology

- 가드레일 모델

- 생성자에 의한 LLM의 입력 또는 출력 사례 중 가드레일 모델이 오분류한 사례를 최소화

→ 훈련 시 현재 생성된 데이터 분포 pϕt(ex∣x,y)에 대해 실제 레이블의 negative log-likelihood를 최소화하도록 함θt+1=θargmaxLtC(θ),LtC(θ)=Eex∼pϕt(ex∣x,y)[−logpθ(y∣ex)]

- 구현 시에는 binary cross-entropy loss를 사용한 다중 레이블 분류를 통해 12가지 유해 클래스에 대한 각 손실을 최소화하도록 함

LC(t)(θ)=−∣S(t)∣1(ex,{yc})∈S(t)∑c=1∑12[yclogpθ(yc∣ex)+(1−yc)log(1−pθ(yc∣ex))]

- 생성자

- 생성자에 의한 LLM의 입력 또는 출력 사례 중 가드레일 모델이 오분류한 사례를 최대화

- 훈련 시 오분류를 야기하는 샘플의 가능성을 높이도록 하는 DPO 적용

- 리워드는 가드레일 모델의 실제 레이블에 대한 negative log-likelihood rt((x,y),ex)=−logpθt(y∣ex)로 정의

ϕt+1=ϕargmaxLtG(ϕ,ϕref)LG(ϕ,ϕref)=Eexw,exl∼pϕt(ex∣x,y)[βlogpϕref(exw∣x,y)pϕ(exw∣x,y)−βlogpϕref(exl∣x,y)pϕ(exl∣x,y)] 여기서 ϕref는 레퍼런스 생성자 모델이고 β는 정규화 파라미터임

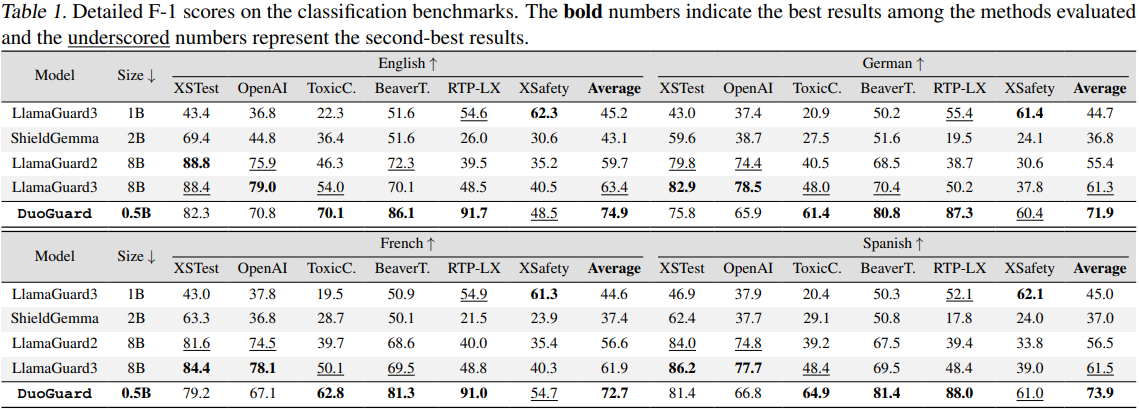

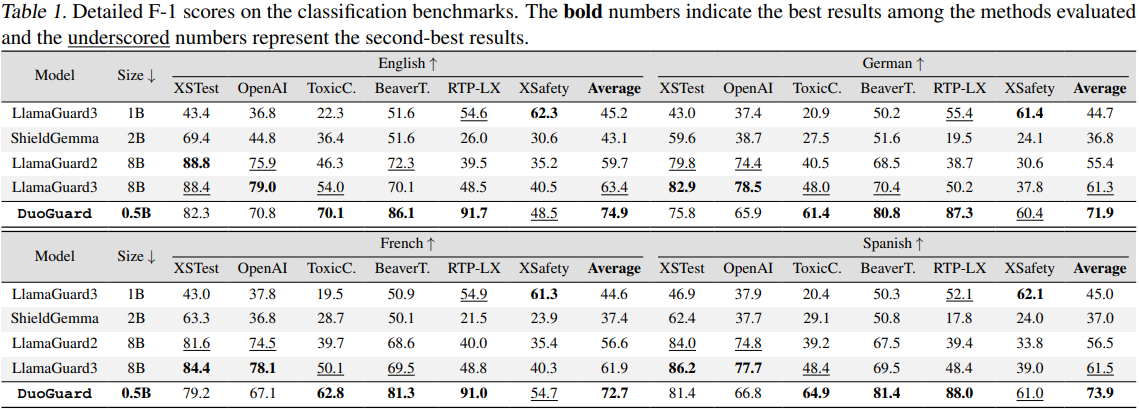

Experimental Result