분류 평가 지표

1. 정확도와 F1-Score

- 회귀분석이 숫자를 예측하고 실제 값과 평가했던 것처럼, 분류라는 문제를 평가하긴 쉽게 보인다. 예를 들어, 맞춘 정답을 전체 데이터의 개수로 나누면 될 것처럼 보이지만 과연 그럴까?

1) 정확도의 한계

- 러닝이는 끝내주는 데이터 분석가라고 소문나있다. 이 친구는 병원에 암을 예측하는 진단 소프트웨어를 개발 해달라는 요청을 받고 납품하는 상황이다. 그런데 너무 귀찮은 나머지 모든 환자를 정상이라고 판정하는 '암 예측 모델'을 만들었다.

암 예측 모델 : 무조건 환자가 음성(정상인)이라고 판정

- 100명의 환자 입실, 95명은 음성(정상), 5명은 양성(암환자)

- 위에 따르면 암 예측 모델의 정확도는 95%

- 정확도는 매우 높은 것 같지만 실제로 양성(암 환자)은 하나도 못 맞췄다. 이런 사기를 잘 걸러내기 위한 지표를 만들어야한다.

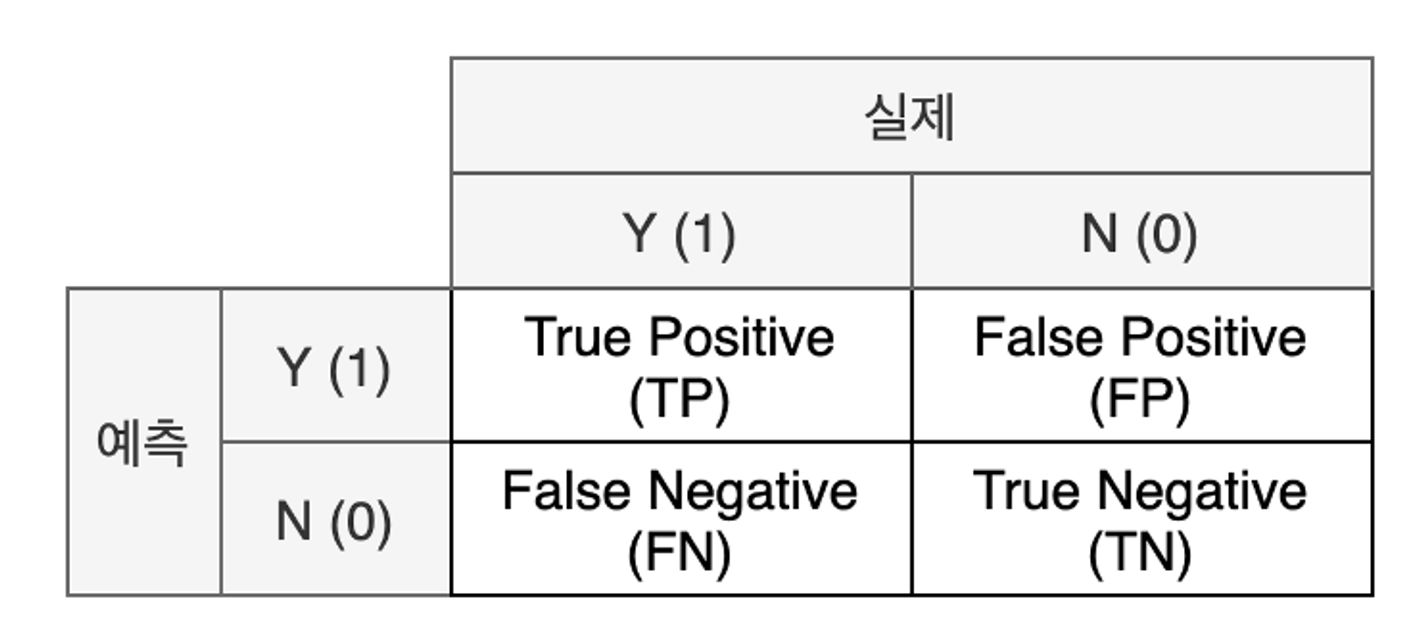

2) 혼동 행렬(Confusion Matrix)

: 실제 값과 예측 값에 대한 모든 경우의 수를 표현하기 위한 2×2 행렬

① 표기법 : 결과+예측

- 실제와 예측이 같으면 True / 다르면 False

- 예측을 양성으로 했으면 Positive / 음성으로 했으면 Negative

② 해석

- TP : 실제-양성, 예측-양성 = 올바르게 분류

- FP : 실제-음성, 예측-양성 = 잘못 분류

- FN : 실제-양성, 예측-음성 = 잘못 분류

- TN : 실제-음성, 예측-음성 = 올바르게 분류

③ 지표

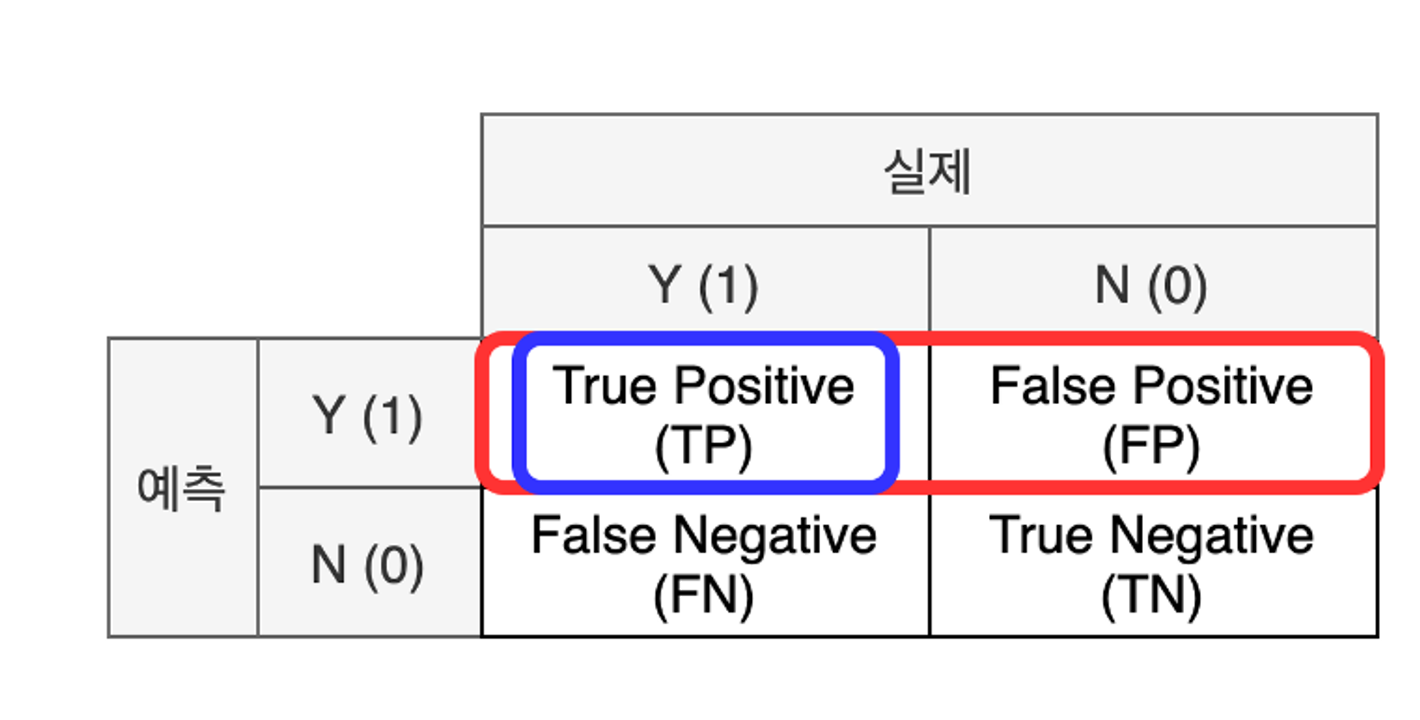

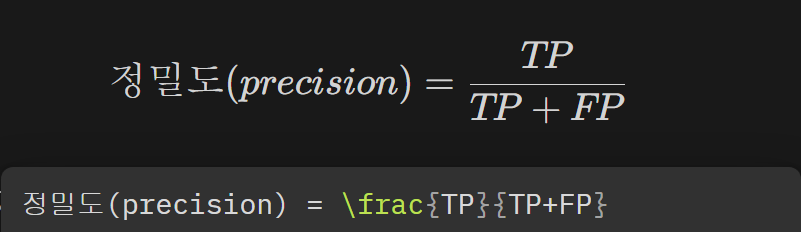

1. 정밀도(Precision) : 모델이 양성 1로 예측한 결과 중 실제 양성의 비율(모델의 관점)

"내가 예측했는데, 얼마 맞췄어!"

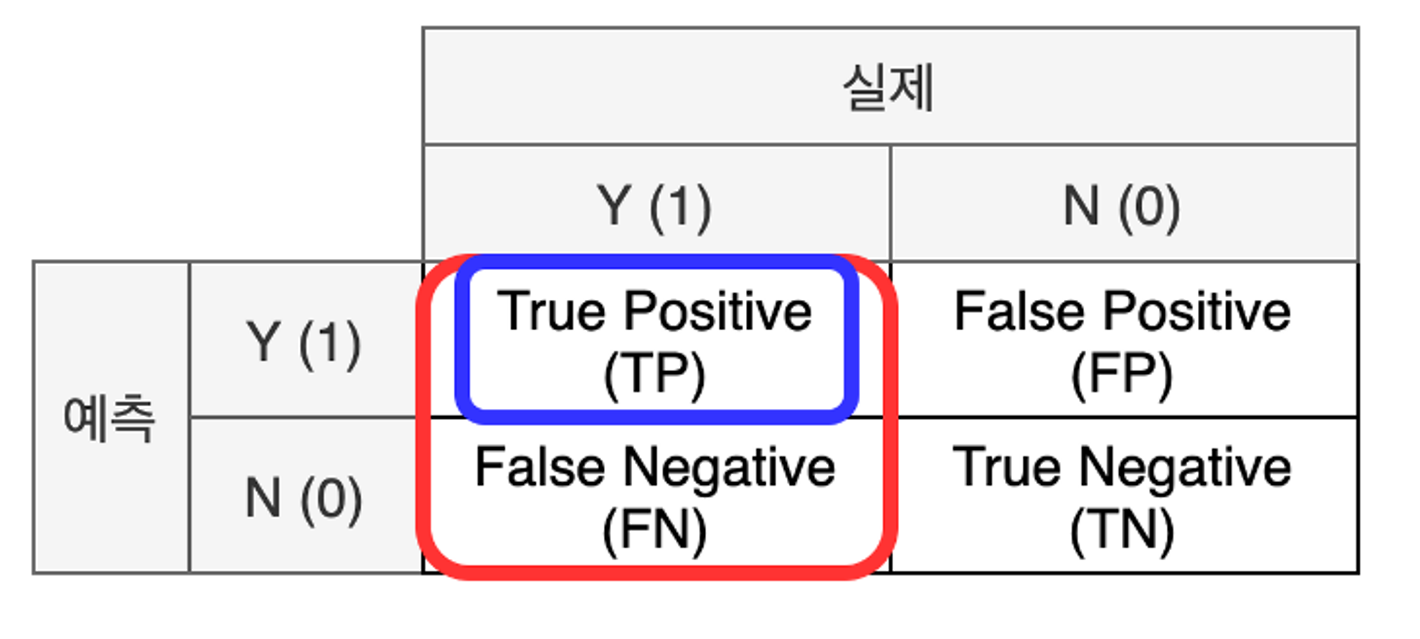

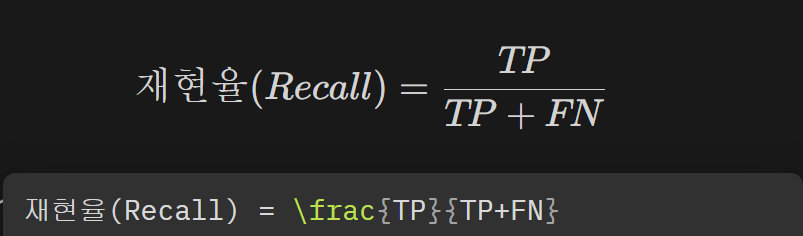

2. 재현율(Recall) : 실제 값이 양성인 데이터 중 모델이 양성으로 예측한 비율(데이터의 관점)

"실제 암환자 중에 모델이 얼마나 맞췄어!"

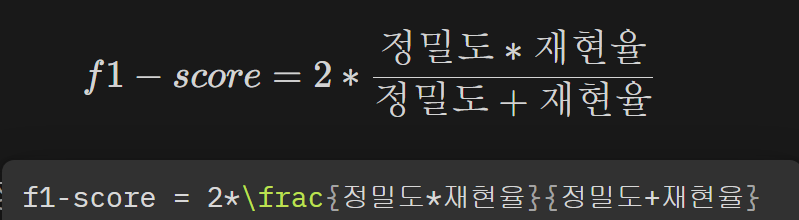

3. F1-Score : 정밀도와 재현율의 조화 평균

*조화평균이란? 1/a + 1/b로 구하는 것.

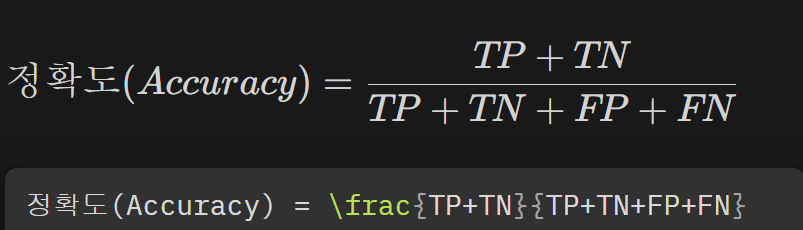

4. 정확도(Accuracy) : 맞춘 것(모든 True 값 더한 것) / 전체 데이터

④ 실제 적용

- TP : 실제-양성, 예측-양성 = 올바르게 분류 → 0명

- FP : 실제-음성, 예측-양성 = 잘못 분류 → 0명

- FN : 실제-양성, 예측-음성 = 잘못 분류 → 5명

- TN : 실제-음성, 예측-음성 = 올바르게 분류 → 95명

- 정밀도는 TP/TP+FP = 0/0+0 = 정의되지 않음(division by zero)

- 재현율은 TP/TP+FN = 0/0+5 = 0

- 결과적으로 F1-Score는 2 00/0+0 = 0

= 제대로 작동 안한다.

3) 정리

- 위처럼 정확도가 제 기능을 못할 때는 분류에서 특히 y값이 unbalance할 때 일어난다.

- 따라서 이를 위해서 y범주의 비율을 맞춰주거나 평가 지표를 F1-Score를 사용함으로써 이를 보완한다.