딥러닝

1.퍼셉트론

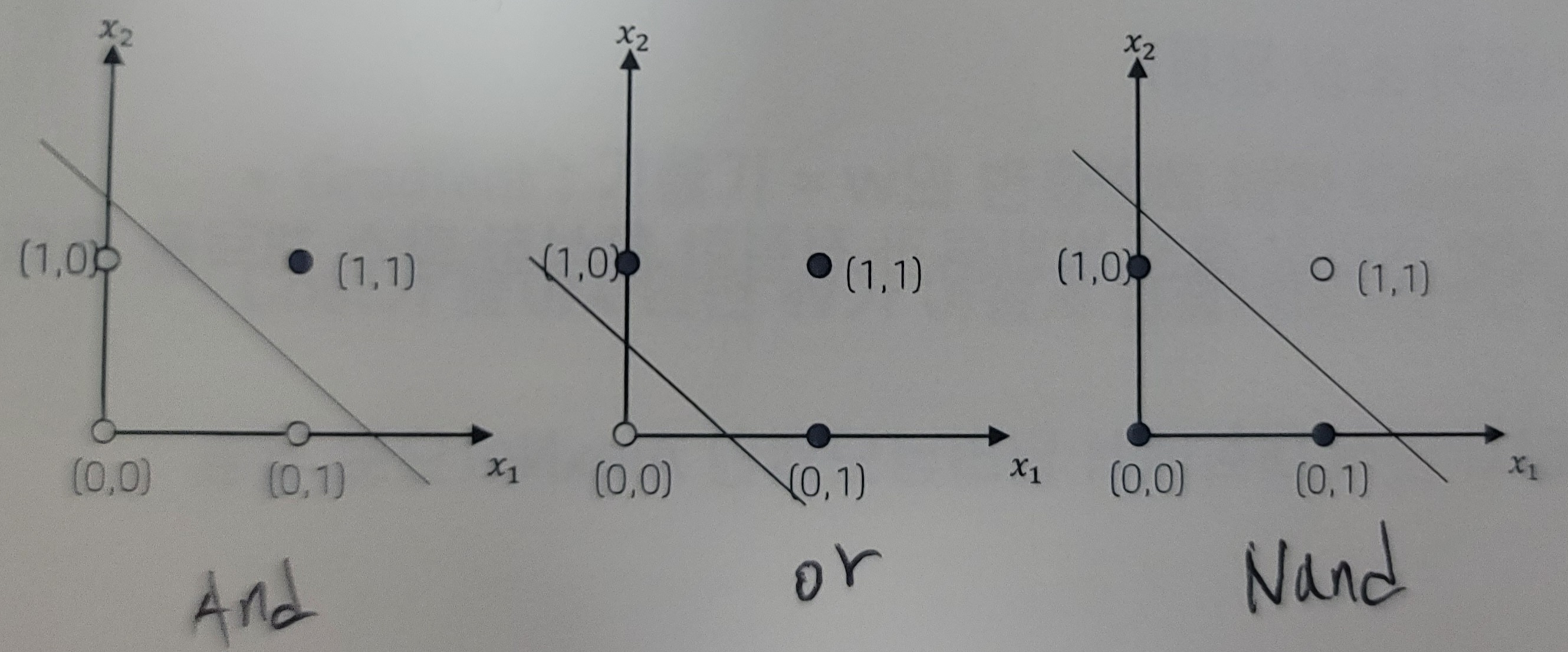

인공 신경망의 한 종류이진 분류(binary classification)문제를 위한 간단한 형태의 인공 뉴런(artificial neuron)선형 분류 모형이기 때문에 AND, OR, NAND 연산 등 선형 문제는 해결 할 수 있다하지만 XOR 문제를 해결 할 수 없다

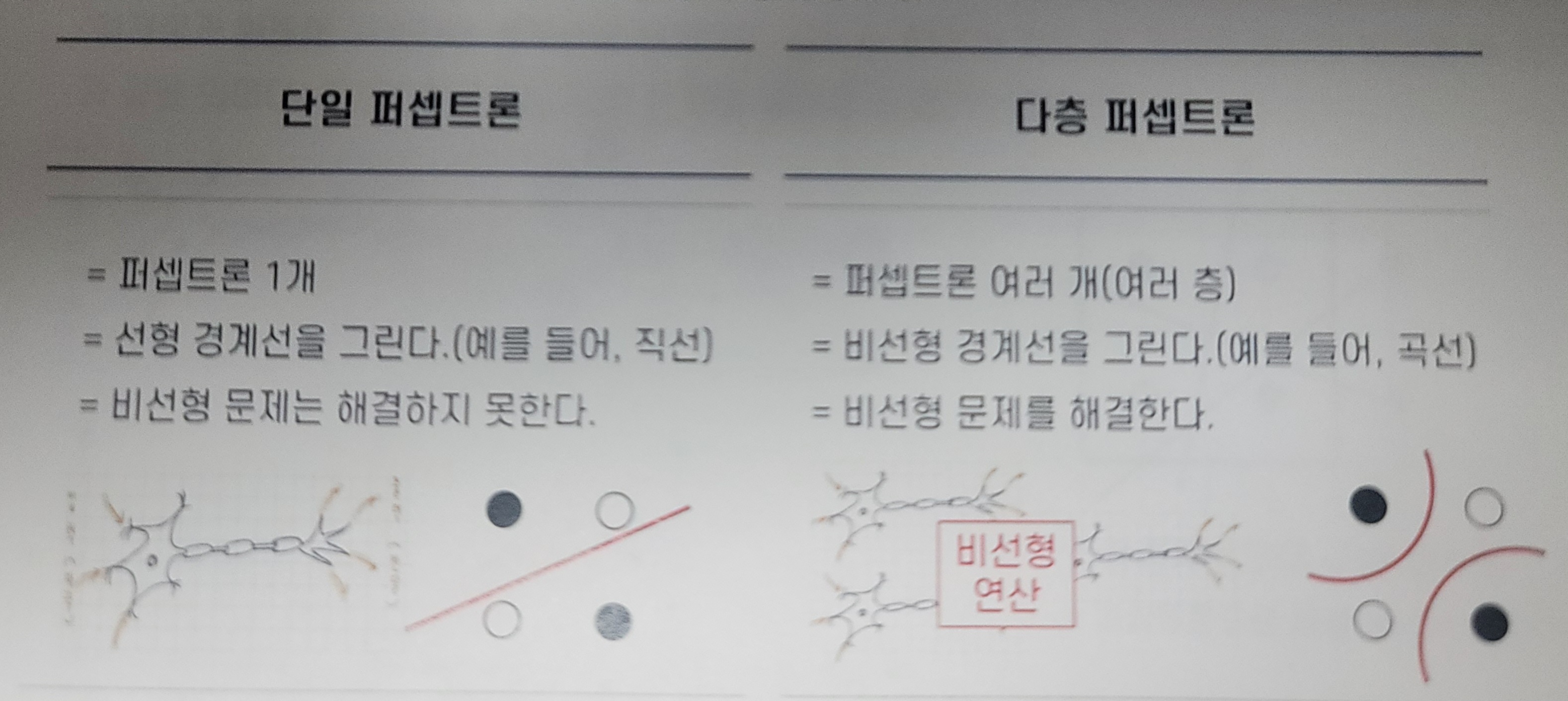

2.다층 퍼셉트론(MLP)

인공 신경망(Artificial Neural Network, ANN)의 한 종류MLP는 기본적으로 여러 개의 인공 뉴런(또는 퍼셉트론)이 서로 연결된 다층 구조를 가지며, 비선형 문제를 모델링하고 다양한 복잡한 작업을 수행하는데 사용된다 MLP는 입력 레이어(input

3.오차 역전파

오차를 역방향으로 전파해나가며 출력부와 가까운 층의 weight들 부터 순차적으로 weight를 업데이트해 나가는 방식Weight를 업데이트해나가는 방식은 경사하강법을 각 층별로 적용한다고 이해하면 된다신경망의 가중치(weights)를 조정하여 모델이 원하는 출력을

4.활성화 함수(ReLu)

렐루(Rectified Linear Unit)함수 기울기 소실 문제를 완화하고 빠른 학습을 가능하게 하는 장점 렐루 함수는 입력이 양수인 경우 입력 값을 그대로 출력 음수인 경우 0을 출력한다 렐루 함수의 주요 특징 비선형성(Non-linearity) 렐루 함

5.Dropout

정규화 기법 중 하나과적합(overfitting)을 줄이고 모델의 일반화 성능을향상 시키는 방법신경망의 학습 중에 무작위로 선택한 뉴런들을 제외하고(뉴런의 출력을 0으로 설정), 나머지 뉴런만 사용하여 순전파와 역전파를 수행하는 것학습 과정에서 무작위로 일부 뉴런을 비

6.Call back 함수

Early Stopping은 기계 학습과 딥 러닝 모델의 과적합을 방지하기 위한 정규화 기법 중 하나모델의 학습을 중지함으로써 과적합을 방지하고, 검증 데이터를 사용하여 모델의 일반화 능력을 평가하여 더 신뢰성 있는 모델을 얻을 수 있도록 도와 준다.학습이 진행될 수록

7.TensorFlow(텐서플로)

텐서플로는 텐서를 기본으로한다 변수 : 변경이 가능한 수 상수 : 값을 바꾸지 못하는 수 텐서의 타입이 다르면 연산이 안된다. as타입을 사용해서 타입을 맞쳐주고 연산하기 X = sigle data 1차원 -> 2차원 text = [~] 1차원 시퀀셜한 데이터 =

8.자연어 처리(NLP, RNN)

자연어 처리 분야 RNN(Recurrent NN) 시계열 데이터, 순차 데이터 에 특화 시계열 데이터 순서(Order)를 가지고 있는 데이터 DNA 염기 서열(Sequential Data) 서계 기온 변화(Temporal Sequence)

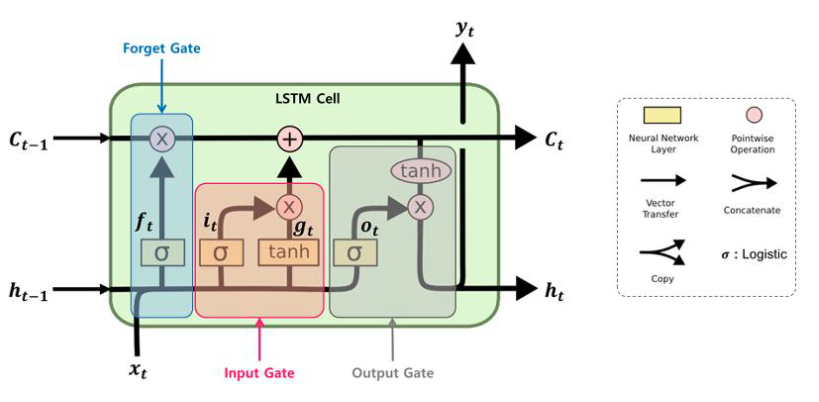

9.Gated RNN(LSTM, GRU)

LSTM(Long Short Term Memory)장기 기억 능력을 갖춘 모델 3개를 입력받아 2개를 출력 Forget Gate 기존 Cell state에서 어떤 정보를 잊을지 결정하는 게이트 ft = σ (Wf[ht-1, xt]) σ = sigmoid

10.Seq2Seq with Attention

Seq2Seq 란? 시퀀스-투-시퀀스 는 입력된 시퀀스로부터 다른 도메인의 시퀀스를 출력하는 다양한 분야에서 사용되는 모델 고정된 차원의 입력을 받아, 입력값에 대응하는 "가변적 길이의" 결과값을 출력하는 모델 챗봇(Chatbot)과 기계 번역(machine Tra

11.Transformer

RNN 문제점 해결 Long-term dependency problem 어떤 정보와 다른 정보 사이의 거리가 멀 때 해당 정보를 이용하지 못하는것 -> RNN의 문제점 Attention 메커니즘으로 문장을 한번에 모두 봄으로써 문제를 해결 Parallelizatio