수강내용 정리

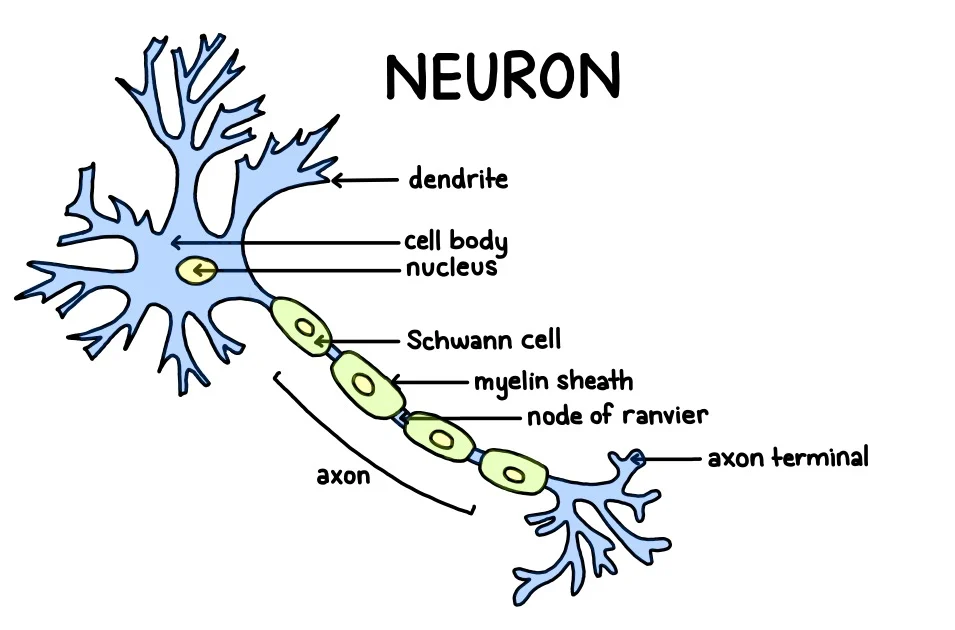

1.1. Neural Network이란...

최근에 인공지능 강의와 실습을 통해 Neural Network에 대해 배우고 CNN과 Transformer에 대해 간략하게 배우게 되었다.배운걸 조금 정리해놓고 싶어서 포스트를 작성해보려 한다.일기 쓰는 것도 초등학교 후로 손을 놓아버린 나지만.... 아무튼 이제 시작

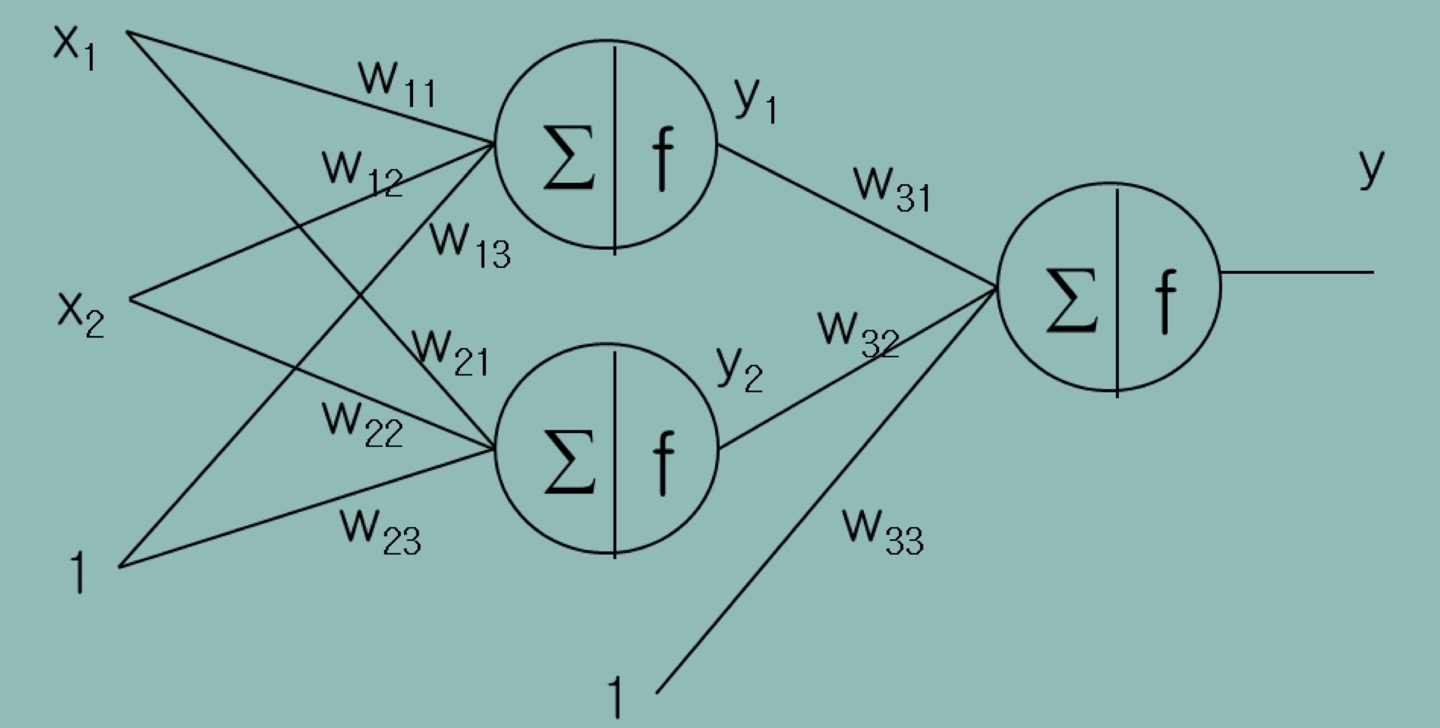

2.2. Error Back Propagation

지난 포스트에서 NN에서 w값을 스스로 조절하는 방법을 찾았다고 했다.w값을 조절하는 일련의 과정을 "학습"이라고 한다.비유를 좀 하자면 Training Data가 교과서, Learning Algorithm이 암기하는 학원이라고 생각하면 좋다.암기한 Training D

3.3. Configuration of Neural Networks

1번, 2번 포스트에서는 NN이 무엇이고 어떻게 구성되어 있는지, 학습이란 무엇이고 어떤 방법으로 진행되는지에 대해 간략하게 알아봤다.그럼 이 NN으로 어떤 것들을 할 수 있냐?요즘 나오는 인공지능 관련된 서비스들을 모두 할 수 있다. 근데 그 서비스들도 다 분해해보면

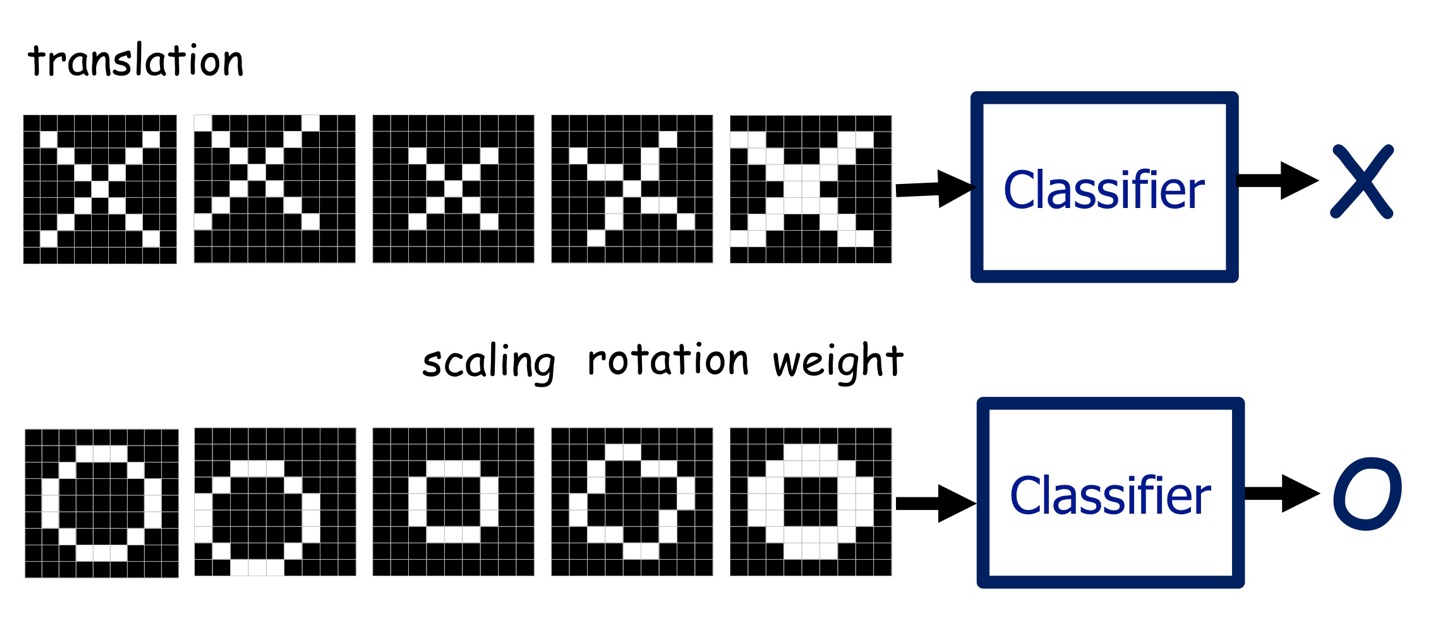

4.4. CNN Basics

지금까지 Neural Net에 대해, 그리고 Classification 과정에 대해 알아보았다.이제부터는 인공지능에 대해 조금 알아봤다면 한번쯤 들었을 CNN에 대해 정리해보고자 한다.CNN, RNN, Transformer....등등 모두 Neural Net을 어떻게

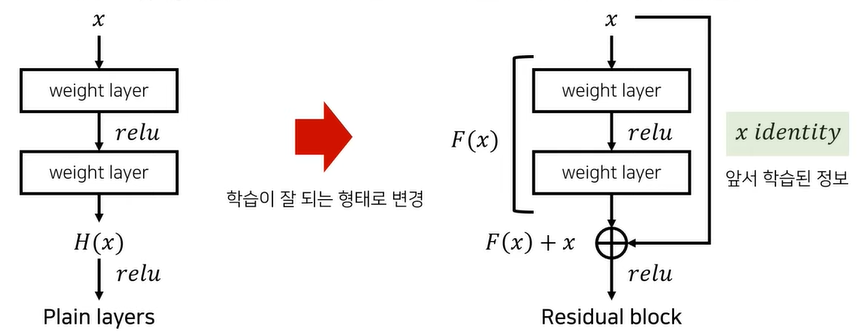

5.5. Various CNNs

이전 포스트에서 CNN의 구조에 대해 작성했었다. 세부적인 부분은 모델마다 다르겠지만, 이미지를 Feature Learning하고, Classification한다 라는 특징은 모든 CNN에 적용된다는걸 기억하면 된다. CNN에 대한 개념이 LeNet을 시작으로 처음

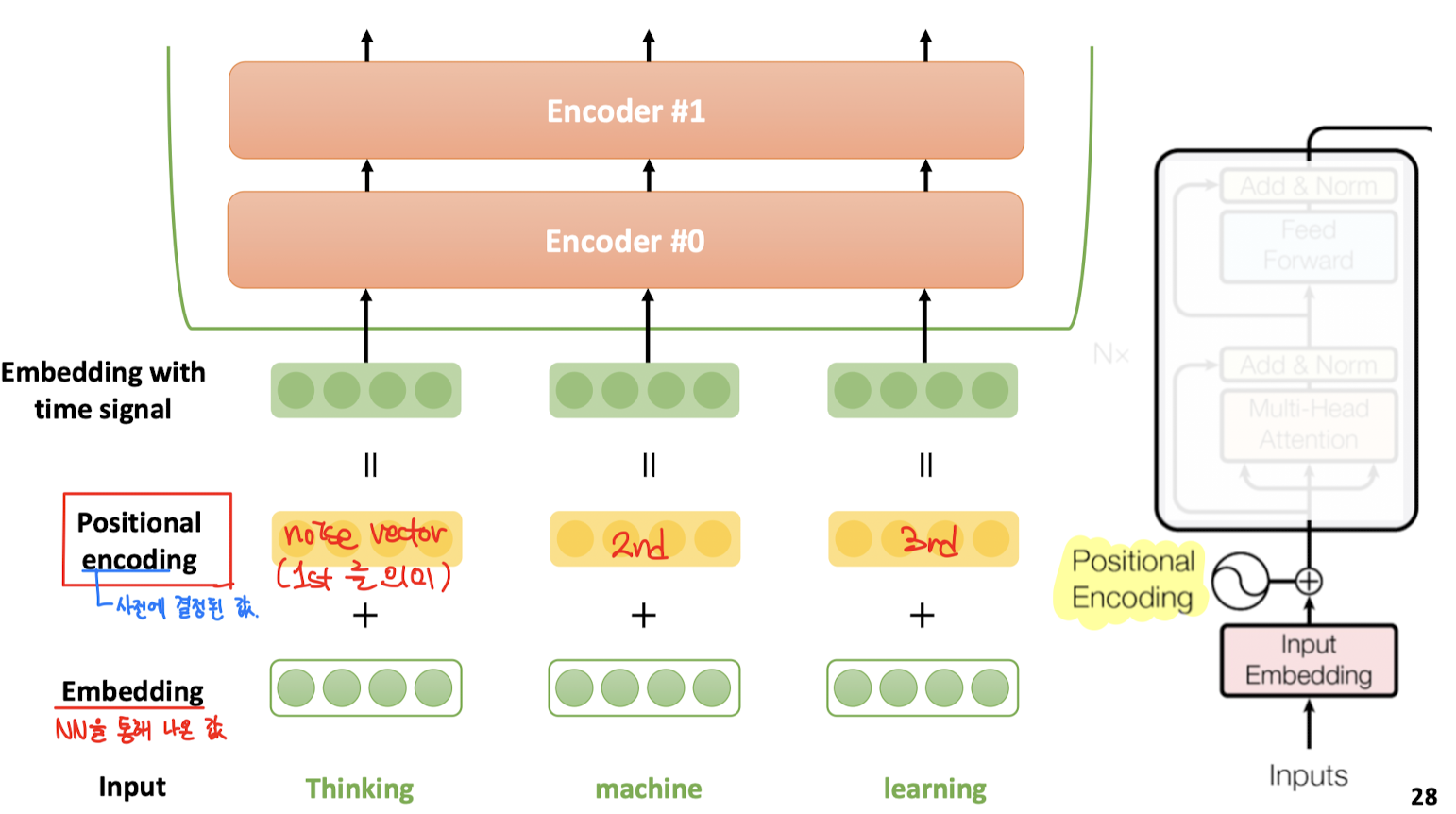

6.6. Transformer

VGG와 ResNet을 다루다가 갑자기 Transformer에 대해 다루게 되었다.... 이 Transformer는 요즘 아주아주 뜨거운 감자인 ChatGPT에 핵심 구조라고 볼 수 있다. 당연히 자연어 처리(NLP)쪽 모델이고, Transformer를 이해하기 위해서