Introduction

- 의료용 narratives은 일반적인 텍스트, 그리고 non-clinical, non-biomedical 텍스트와 차이가 있기 때문에, 의료용 task를 수행할 때 specialized clinical BERT model이 필요로 함.

- 기존 BERT(original)에서 Fine tuning을 통해 의료용 임베딩에 대한 사전 훈련된 새로운 BERT 모델 구현.

Method

- Contextual Embeddings in General

a. 기존의 world-level vector representations에서는 주변 문맥에 기반한 말뜻을 정확하게 구분하지는 못했었음. (단순한 Word2Vec 등)

b. BERT는 Attention mechanism을 통해서 주변 맥락을 파악하고 이에 따라 임베딩을 진행하기 때문에, 문맥에 기반한 말뜻을 구분하는 것을 필요로 하는 TASK에 효과적임. - BERT training

a. Clinical BERT initialized from BERT-BASE

b. Clinical BioBERT initialized from BioBERT - Clinical Tasks for Evaluation

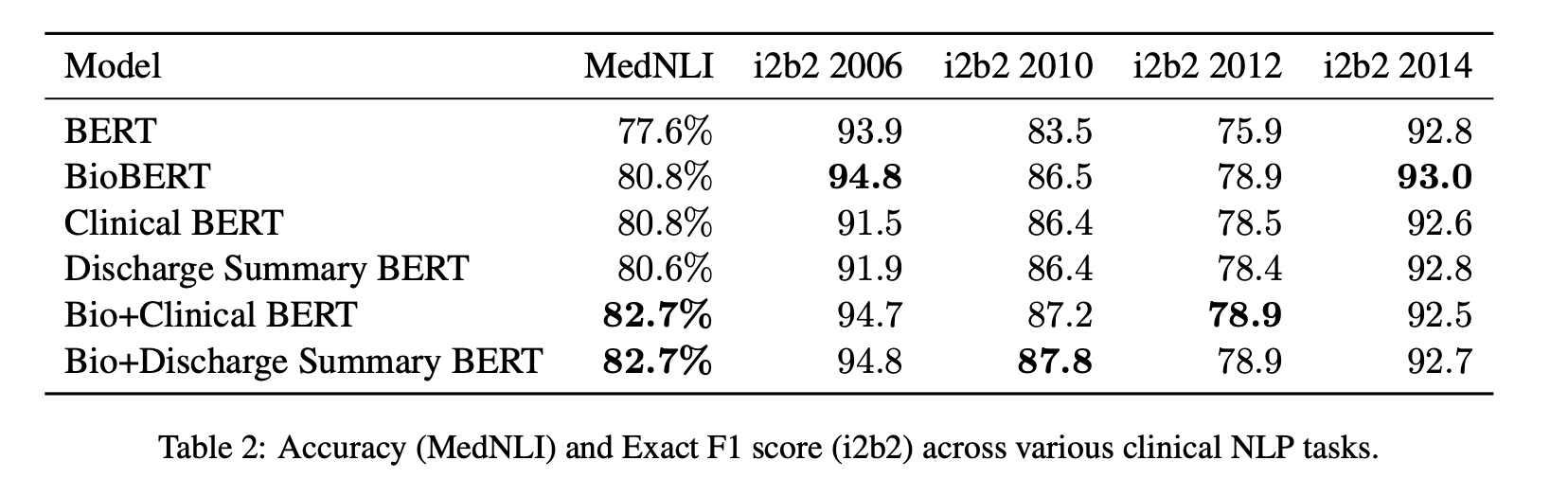

a. MedNLi

b. i2b2(2006,2010,2012,2014)

Data

- MIMIC-3

Result

1. Clinically fine-tuned BioBERT가 mednli, i2b2 tasks에서 우수한 성능을 보임. 특히, MedNLi에서 기존의 가장 우수한 성능이었던 것 보다 훨씬 우수한 성능을 냄.

2. 하지만, clinical BERT는 BioBERT, general BERT에 비해서 뛰어난 성능 향상을 보이지는 못했음.

3. De-ID corpora에서는 비성공적., non de-ID tasks에 적합.