NLP study

1.Count based word Representation 1

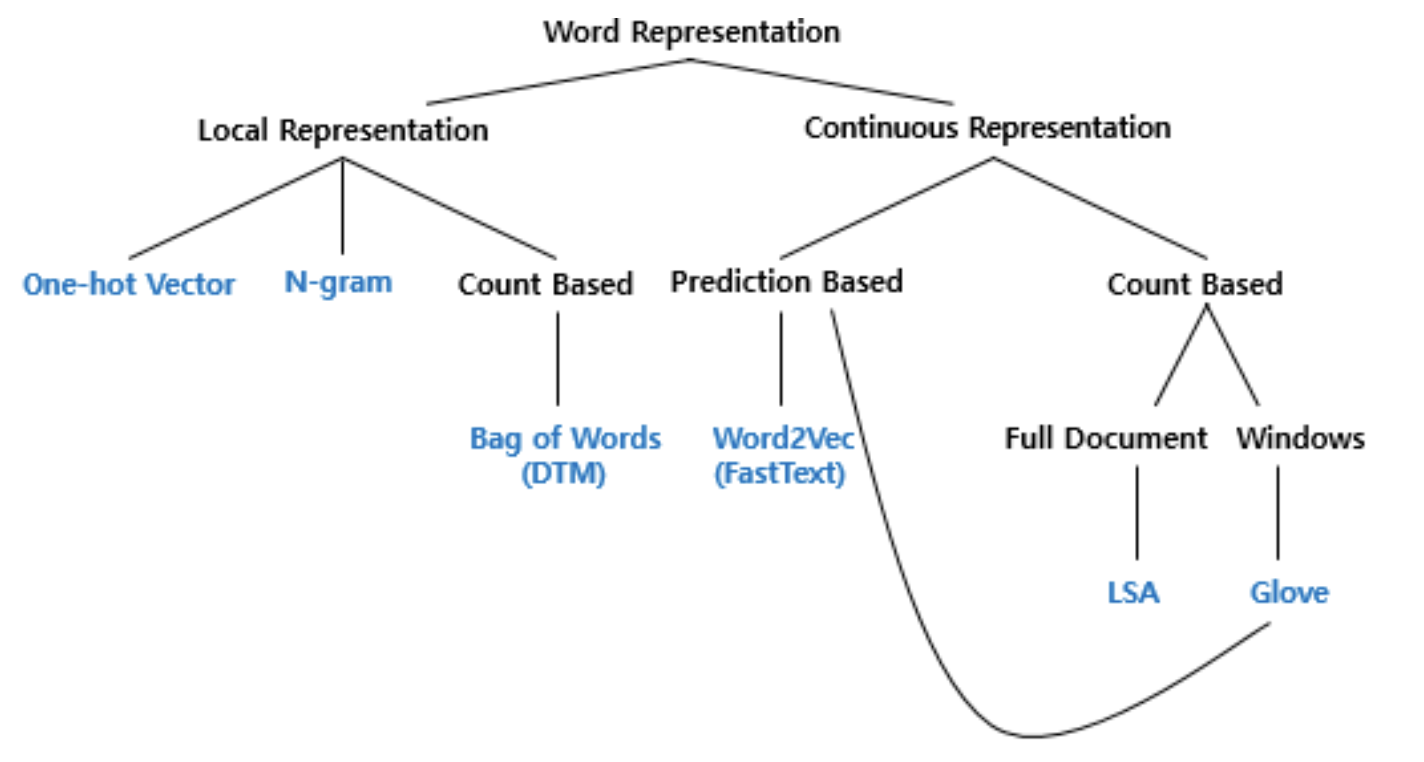

Local Representation국소 표현, 해당 단어 그 자체만 보고 특정값을 맵핑하여 단어를 표현하는 방법Discrete Representation (이산 표현) 이랑 유사ex) One-hot vector, N-gram, BoWDistributed Represe

2.Count based word Representation 2

저번시간에 배운 BoW에 이어서 DTM에 대해 공부해보겠습니다. DTM (Document‐Term Matrix) 서로 다른 문서들의 BoW 들을 결합한 표현 방법 즉, 각 문서에 대한 BoW를 하나의 행렬로 만든 것 행과 열을 반대로 하면 TDM이라고 부른다 문서단어

3.Recurrent Neural Network 1 (Vanilla RNN)

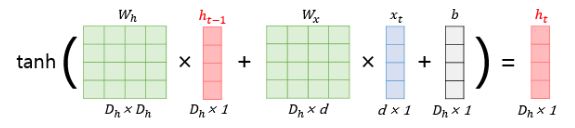

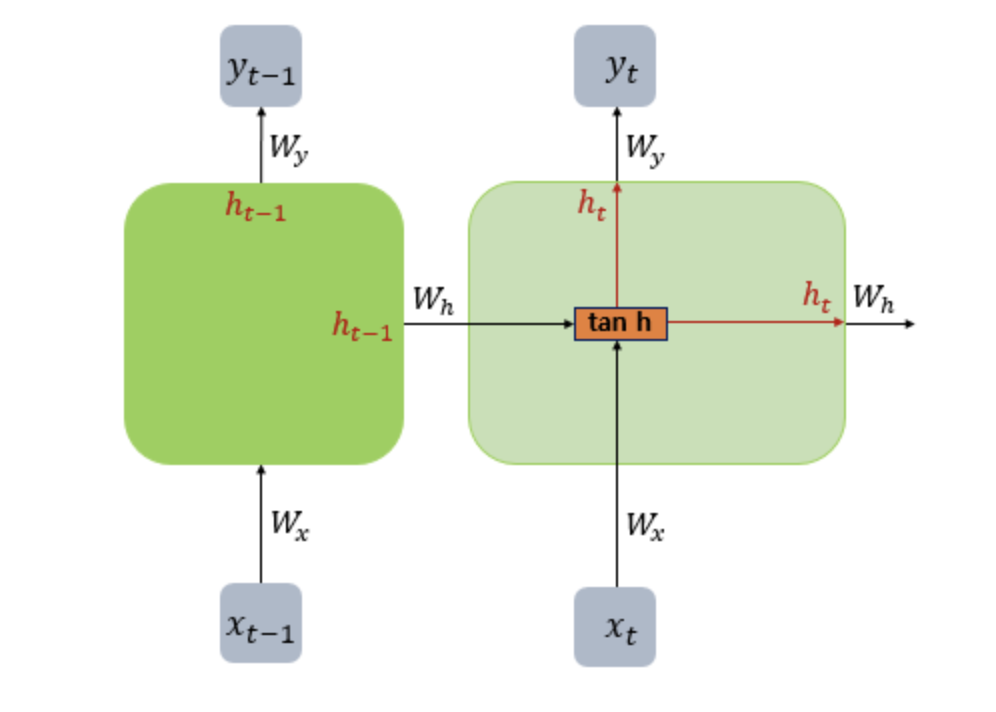

순환신경망 RNN: 입력과 출력을 시퀀스 단위로 처리하는 시퀀스 (Sequence) 모델 Sequence - 연속적인 바닐라 RNN(Vanilla RNN) 이라고 합니다. (케라스에서는 SimpleRNN) 장기 의존성 문제 (the problem of Long‐T

4.Recurrent Neural Network 2 (LSTM, GRU)

LSTM은 이름에서 알 수 있듯이 장단기메모리를 사용한다LSTM은 은닉층의 메모리 셀에 입력 게이트, 망각 게이트, 출력 게이트를 추가하여 불필요한 기억을 지우고, 기억해야할 것들을 정한다셀 상태(cell state)라는 값을 추가구조도를 통해 Vanilla RNN과

5.Recurrent Neural Network 3 (RNNLM)

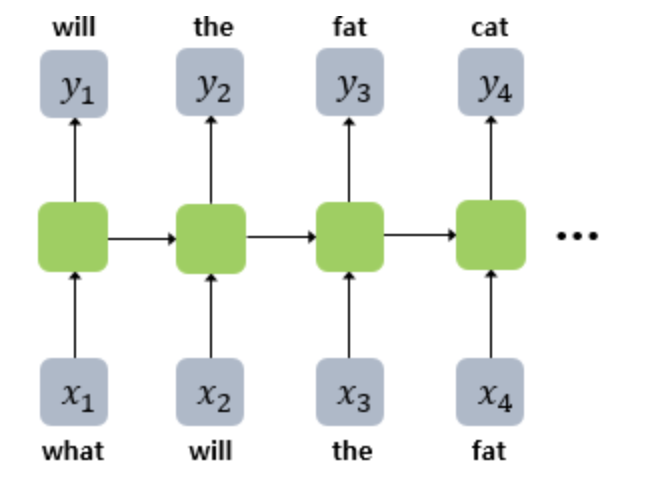

간단히 RNN으로 만든 언어모델time step이 있어입력길이를 고정하지 않고 사용가능교사 강요(teacher forcing)를 이용해 학습학습 과정다음 문자 예측예문 : 'what will the fat cat sit on' 교사 강요(teacher forcing)란

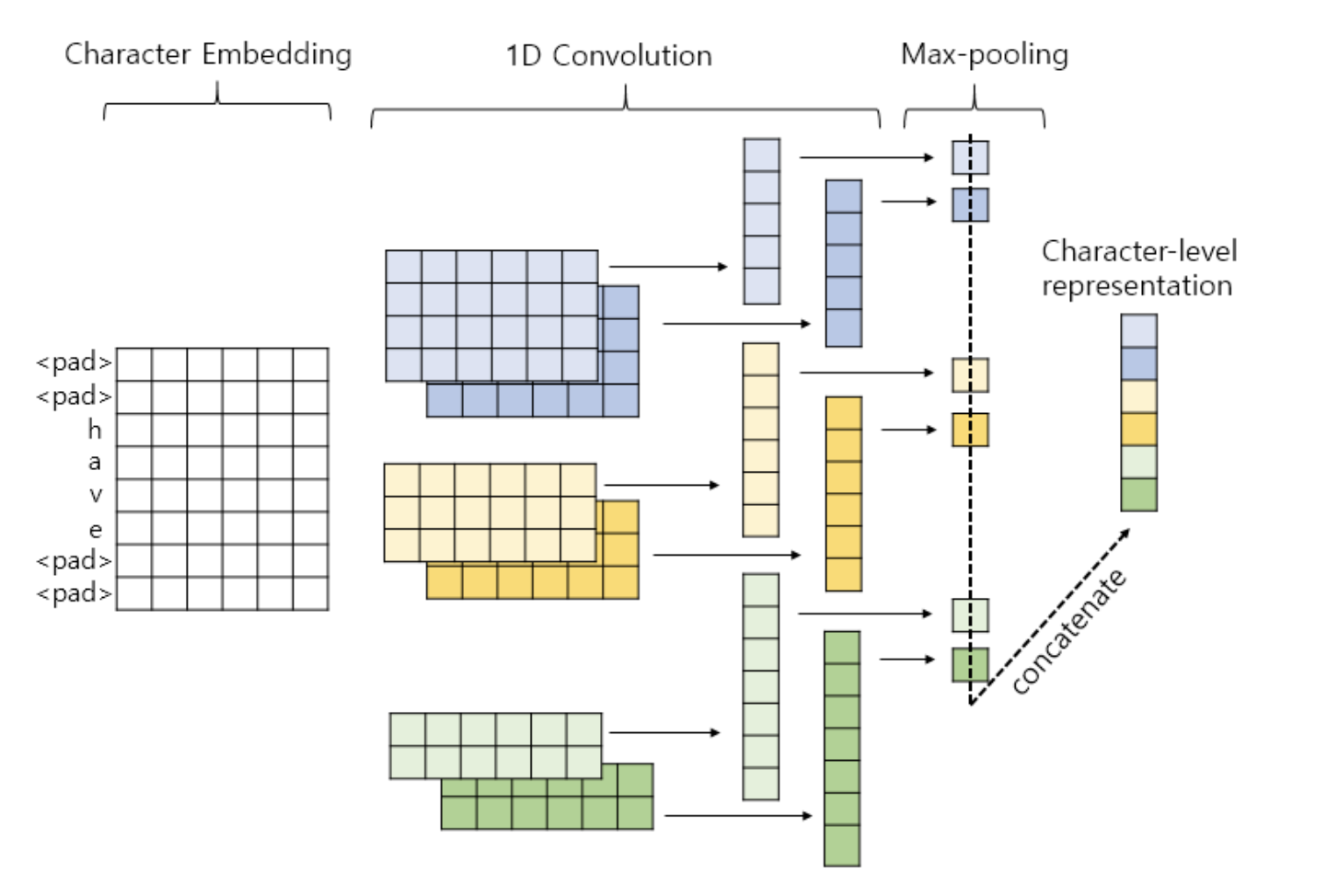

6.NLP-CNN

Convolutional Neural Network(합성곱신경망)의 줄임말이미지 처리 분야에서 활발히 사용합성곱 신경망은 크게 합성곱층과 (Convolution layer) 와 풀링층 (Pooling layer) 으로 구성됨다층퍼셉트론의 한계원래 어떤 이미지였는지 알아