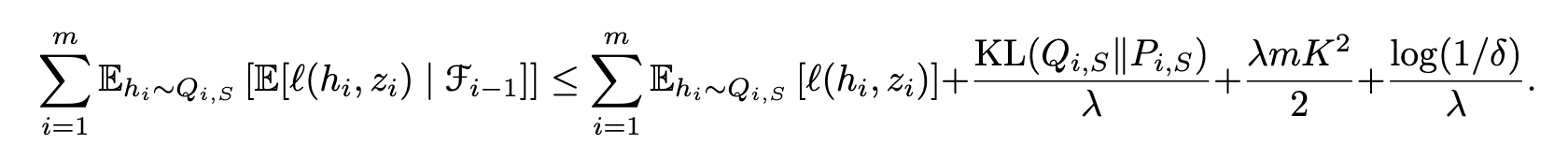

[Paper Review] Online PAC-Bayes Learning

Learning sample $\\mathcal{S} := {z_1, z_2, \\dots, z_n} \\sim \\mathcal{D}^n$Predictors $h : \\mathcal{X} \\to \\mathcal{Y}$Prior $P$, Posterior $Q$L

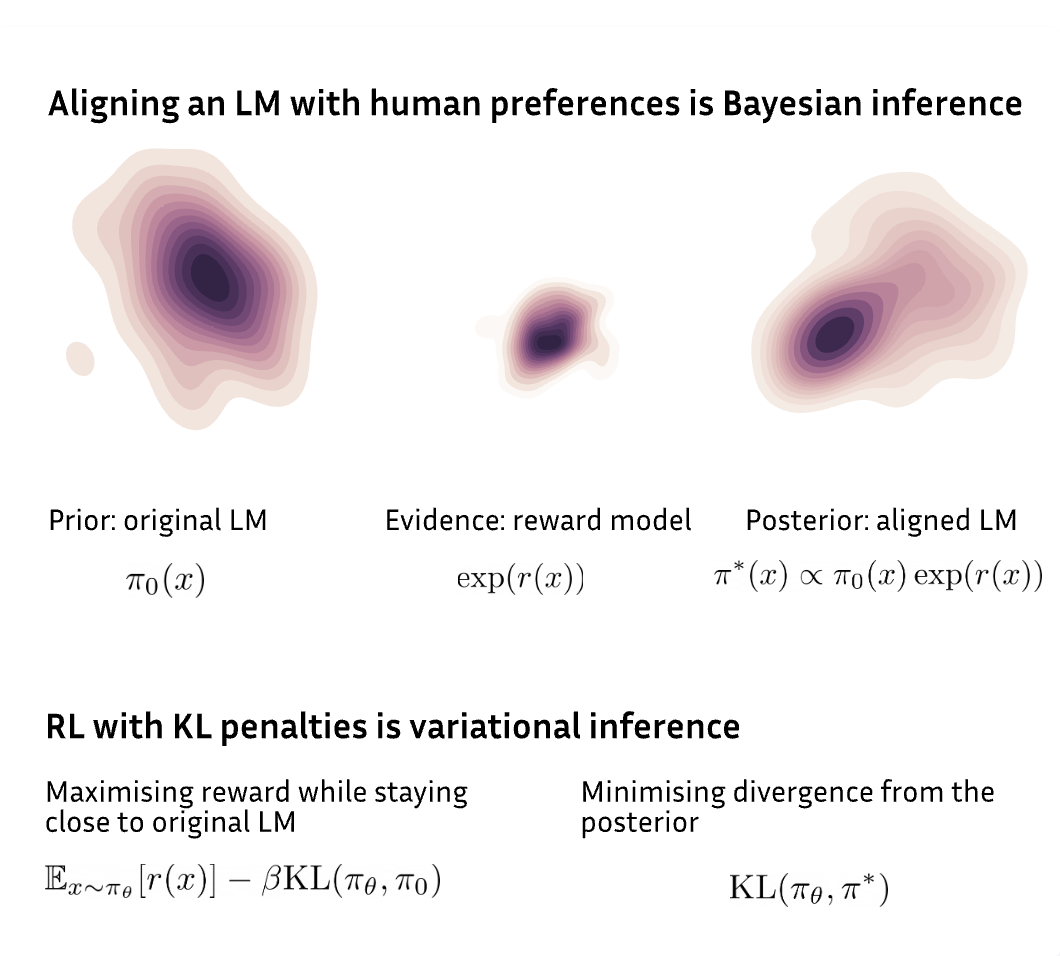

[Paper Review] RL with KL penalties is better viewed as Bayesian inference

$\\mathcal{X}$ : set of sequences of tokens from some vocabulary$\\pi$ : Language Model (LM)$\\pi_0$ : Pretrained LM$\\pi(x)$ : probability of sequenc

Extreme Value Theorem

Thm. (EVT)If $f: K \\to \\mathbb{R}$ is conti. on a compact $K \\subseteq \\mathbb{R}$, then $f$ attains a maximum and minumum value.Proof.Since $K$ i

Open Set

Def. Open SetA set $O \\subseteq \\mathbb{R}$ is open if $\\forall a \\in O, \\exists V\_{\\epsilon}(a) \\subseteq O.$Thm. (Intersection and Union of

Generalized Least Squares (일반화최소제곱법, GLS)

기존에 우리가 고려했던 선형모형과 달리, 다음의 모형을 고려해보자.$$\\begin{aligned}Y \\sim N(X\\beta , \\sigma^2V)\\end{aligned}$$$V$는 우리가 알고있다고 가정하고, $\\sigma^2$만 모를때, 어떻게 추정할까?

Graphical LASSO

Graphical LASSO는 다음의 식을 최소화하면서 풀어나가는 방법을 일컫는다. 모형이 $Y1 ,\\dots, Y_n \\sim N (0, \\Sigma)$라고 할때, Precision Matrix $\\Theta = \\Sigma^{-1}$를 찾는 문제를 푼다.

Scheffe Test (쉐페 다중가설 검정)

실험계획법 때도 나오고 여기저기 나오는 이름인데, 맨날 공부하고 까먹게 되는 것 같다. 약간 왈드, 스코어 감성이다. $H_0 : C\beta = 0$ 가설검정에서 F 통계량이 다음과 같이 나온다. (s는 MSE임) $$ F = \frac{(C \hat \beta)^{\top}[C(X^{\top}X)^{-1}C^{\top}]^{-1}(C \hat \beta...

Restricted Regression (제한회귀)

Restricted Regression 다음의 가설검정 문제를 생각해보자. $$ H0 : C\beta = 0 \quad \textup{versus} \quad H1 : C\beta \neq 0 $$ 선형모형에서, 이런 가설검정 문제에서 LR Test를 수행하려면 좀 난감하다. 귀무가설 하에서 MLE를 어떻게 찾아야할까? 귀무 가설 하에서 LRT는 다음과 ...

Karlin-Rubin Theorem and UMPU

Def. (Monotone Likelihood Ratio)A model ${f\\theta : \\theta \\in \\Theta }$ is said to have a monotone likelihood ratio (MLR) in a statistic $T$ if,

Neural Tangent Kernel

정리가 매우 잘되어있는 블로그 1. Gradient Flow 먼저, Gradient Flow라는 것에 대해서 이해할 필요가 있다. Gradient Descent를 조금 다르게 생각하는 것이다. $$ \theta{t+1} = \theta{t} - \eta \nabla_{\theta} \mathcal{L}(\theta) $$ 간단한 식조작을 통해서 아래와...

가능도비 검정 (Likelihood Ratio Test)

1. 가능도비 검정이란 >$X{1}, ... , X{n} \overset{\mathrm{r.s.}}{\sim} f(x;\theta), \; \theta \in \Theta$ >$H{0}: \theta \in \Theta{0} \; vs \; H{1}:\theta \in

라오-블랙웰 정리 (Rao Blackwell Theorem)

1. 라오-블랙웰 정리 > $S(X)$ : Estimator for $\theta$ > $T(X)$ : Sufficient Statistic for $\theta$ > $S^\star(X) = E[S(X)|T(X)]$ 라고 하자. > >이때, 다음이 성립한다. > >

분포수렴 (Convergence in Distribution)

$F{n}$ : $cdf$ of $X{n}$$F$ : $cdf$ of $X$$C(F) = {x \\in R : F\\; is\\; continious \\; at \\; X}$ 이라고 하자.다음의 명제를 만족할때, 확률변수 $X{n}$이 $X$로 분포수렴한다고 한다.$