모빌리티 지능

1.Mobility and Intelligence Intro

1. 이 글을 작성하는 목적 우선 이 글은 고영민 교수님의 '모빌리티 지능' 수업을 기반으로 적게 되었다. 학부 2학년 때 국민대학교 자율주행 대회에 참여하여, RRT*와 Pure Pursuit을 통해서 예선을 경험한 적이 있었는데, 당시에는 아무런 지식없이, 단지 R

2.Chapter 1-1.Computer Vision(Introduction)

Computer Vision이란 컴퓨터가 이미지, 비디오 등의 입력데이터로부터 유용한 정보를 추론하도록 하는 인공지능 기술의 일종이다.사람의 경우 과일 사진을 보면 해당 이미지는 과일이라는 것을 바로 인식이 가능하다. 하지만 컴퓨터의 경우 해당 이미는 단지 Pixel로

3.Chapter1-2. Computer Vision(Filtering, Warping)

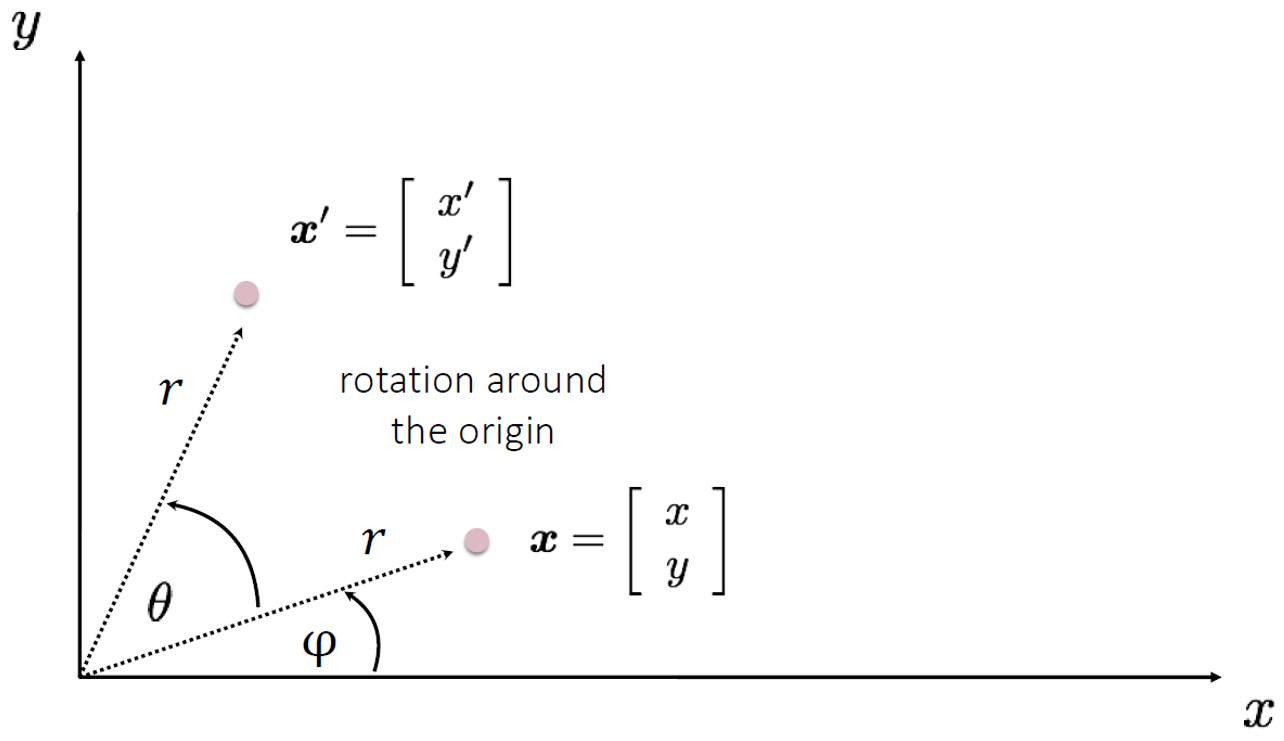

지난 포스트에서는 Image이고 1개의 Matrix이고, 이를 활용하여 동일한 Size의 matrix를 생성하여, Image를 변조시킬 수 있다고 하였다. Image를 변조하는 방법에는 크게 2가지가 있는데 Filtering과 warping이다. Filtering과

4.Chapeter2-1. Lane Detection

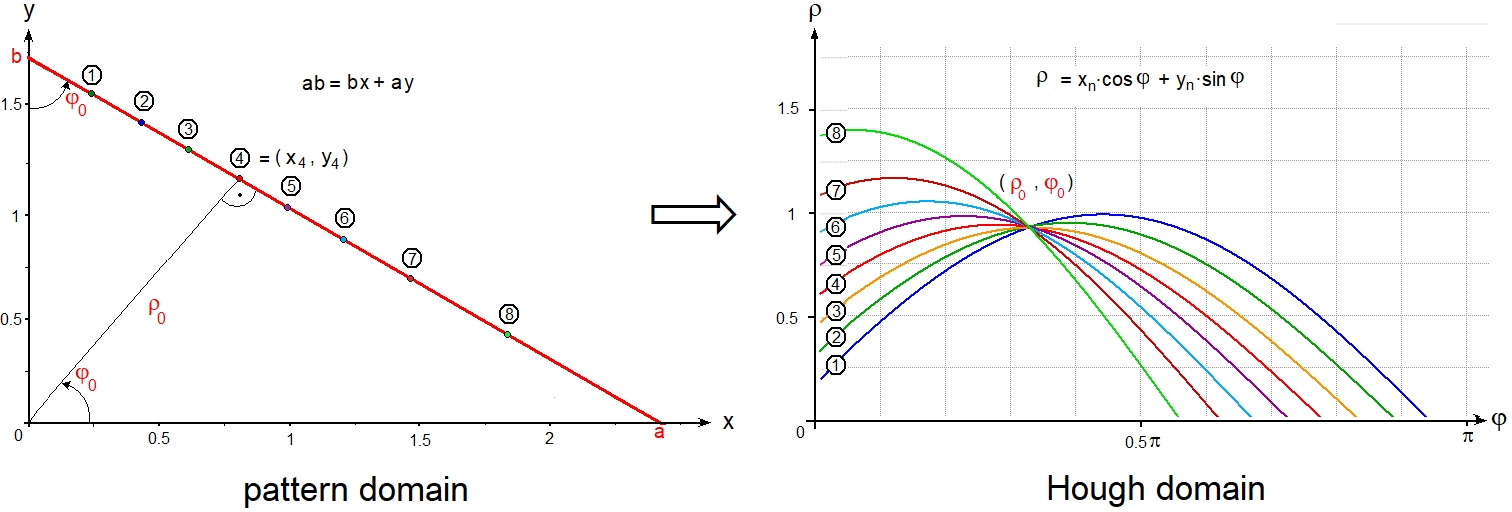

Lane Detection이란 Image가 주어지면 차선을 검출하는 기법이다.먼저, Lane Detection을 진행하기 위해서는 다음과 같은 Preprocessing 과정이 필요하다.1\. RoI(Region of Interest) 설정하기먼저 관심이 있는 영역만을

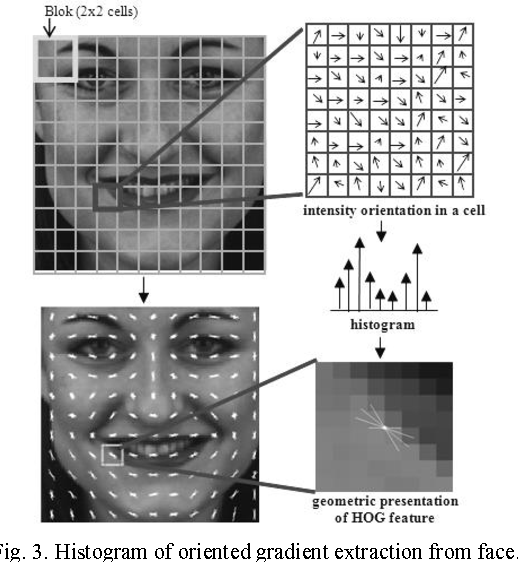

5.Chapter 2-2. Object Detection

Object Detection이란 Image가 주어졌을 경우 관심객체의 위치를 찾아내는 기법이다. 1. Template Matching Object Detection의 대표적인 기법인 Template Matching은 Template이 주어진 상태에서 Template과

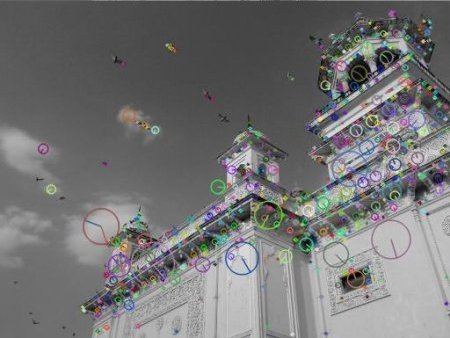

6.Chapter 2-3. Local Feature Matching

Local Feature Matching이란 Image 내의 객체의 특징이 되는 점을 matching하는 기법이다. 1. why do we need Keypoint? Key point란 주어진 이미지에서 특징이 되는 점을 말한다. 즉 다른 지점과는 구분되는 특징이 되

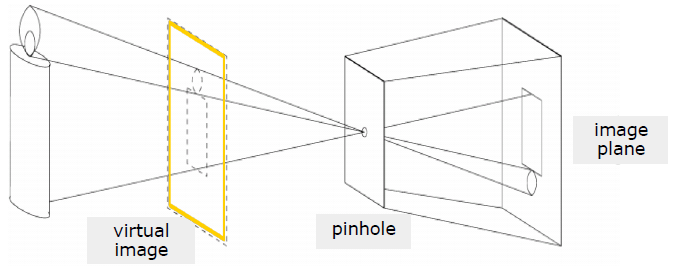

7.Chapter3-1. Camera Parameter

Camera Parameter는 주변의 3차원 환경이 Camera에 어떻게 투영되는지를 나타내는 Parameter이다. 즉, World Coordinate로 표현된 3차원 점이 2차원인 Image Coordinate상에 mapping되는 지점은 어디인지를 알고 싶은 것

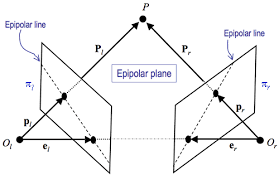

8.Chapter 3-2. Depth

먼저 해당 포스트를 쓰기 전에 저번 포스트에서 다루었던, 내용 중 Camera Calibration에 관련된 내용을 다루지는 않았지만, 이와 관련된 내용(Zhang's method)이 고영민 교수님의 Velog 상에 올라와 있어서 관심있는 사람은 찾아보길 바란다.개인적

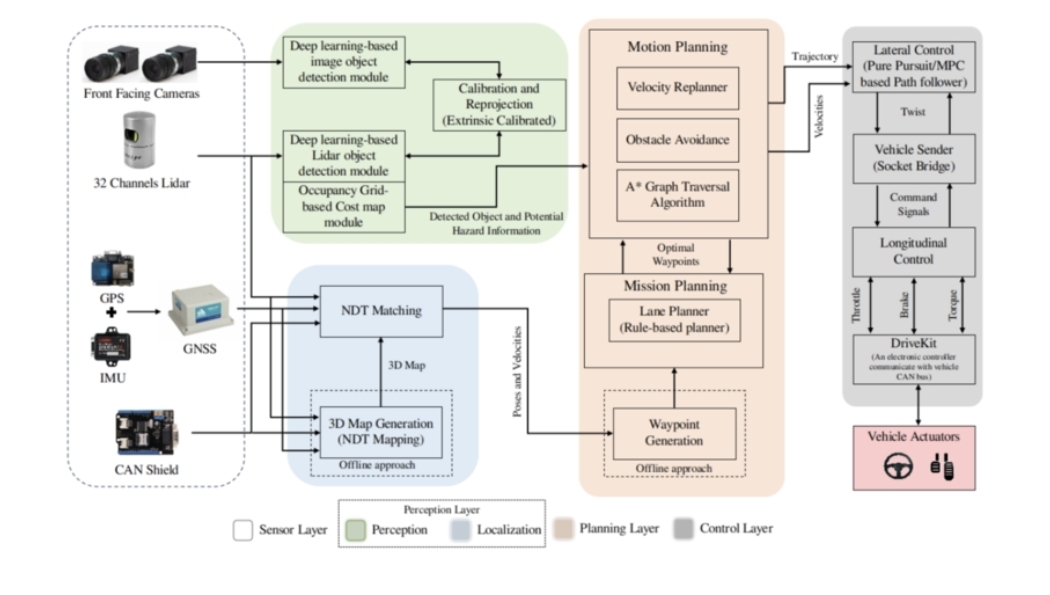

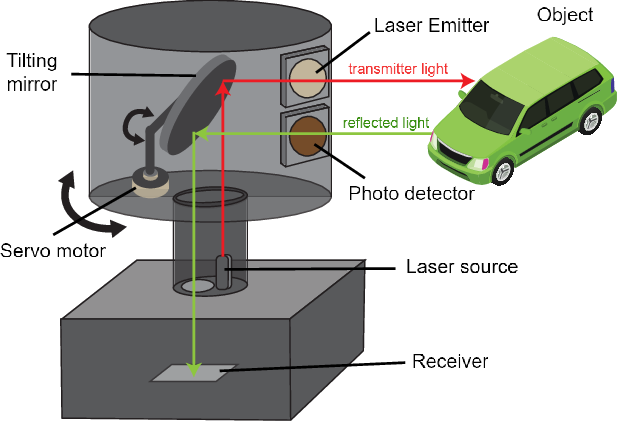

9.Chapter4. Lidar

지난 포스트까지 Computer Vision과 관련된 내용을 끝내고 오늘은 Lidar Sensor를 어떻게 다룰 것인가와 관련하여 써보고자 한다. Lidar는 레이저를 쏘아서 거리를 측정하는 Sensor로써, 아래 그림에서 보이는 것과 같이 레이저를 쏘아 객체에 닿은

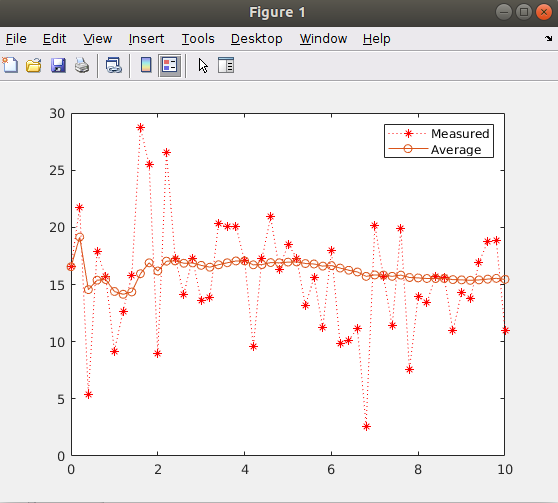

10.Chapter5-1. Localization(Filter Basic)

Localization이란 차량 또는 로봇의 위치를 알아내는 것으로, 현재 해당 로봇이 어디에 존재하는지를 알아내는 것이다. 로봇이 현재 어디에 있는지를 알아야 목적지까지의 경로를 만들어낼 수 있다. Localiztion의 경우 GPS 혹은 Beacon을 사용하여 위치

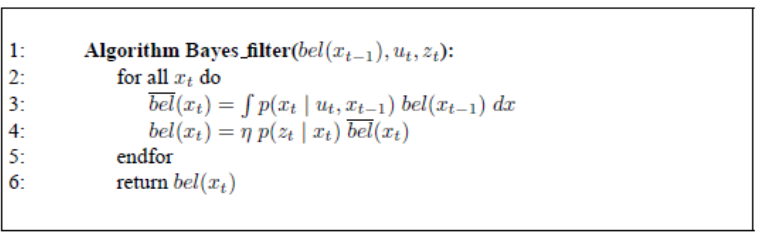

11.Chapter 5-2. Localization(Bayes Filter)

지난 포스트에서는 기초적인 Filter들에 대해서 살펴보았다. 이번에는 KF(Kalman Filter)와 EKF(Extended Kalman Filter)의 기반이 되는 Bayes Filter에 대해서 살펴보고자 한다.처음 해당 내용을 들었을 때, Filter라는 것을