Paper Review

1.[Paper Review] GoogLeNet(Going deeper with convolutions)

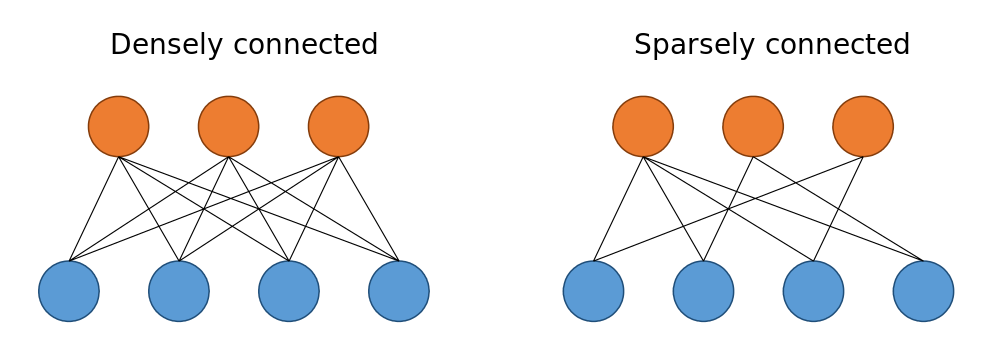

#AI 논문 리뷰 생활스터디 오늘의 논문은 Going deeper with convolutions ! 왜 GoogLeNet인가 했더니 저자들이 구글팀이라서..? 1. Abstract 논문에서는 Inception이라는 모듈을 제안하며 네트워크상에서 파라미터 계산에 사

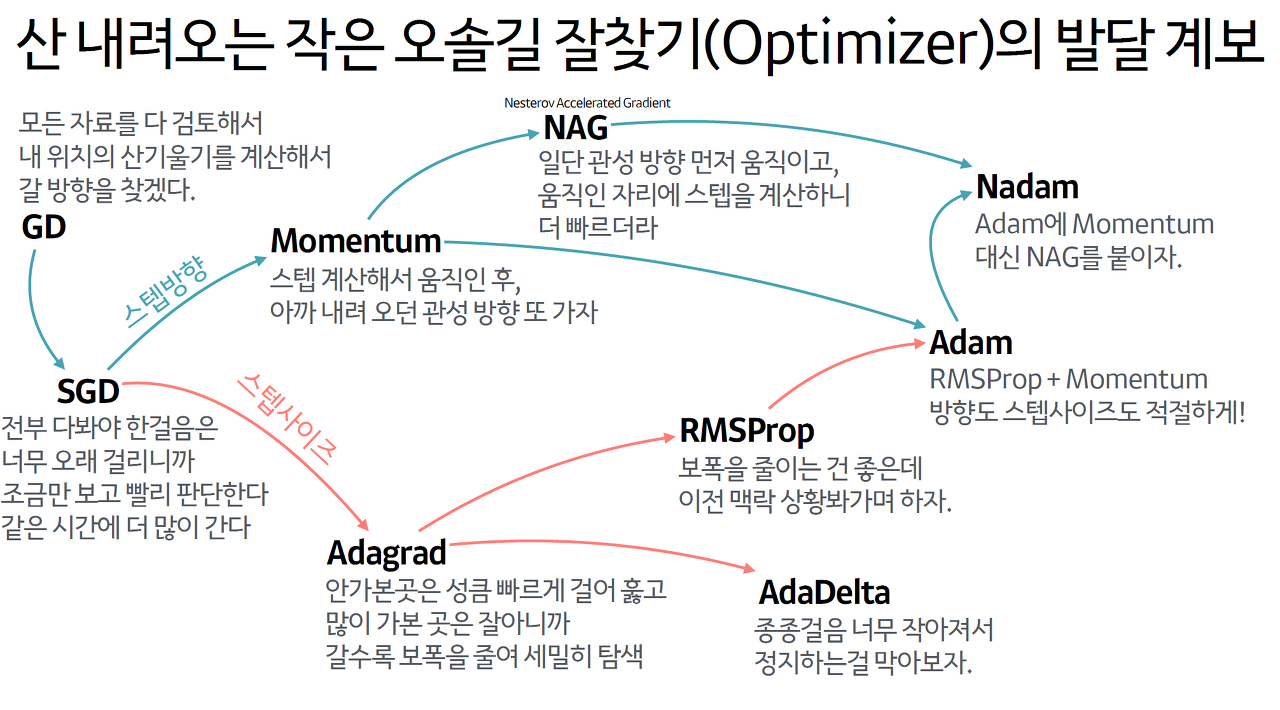

2.[Paper Review] An overview of gradient descent optimization algorithms

What is Gradient desecent algorithms?

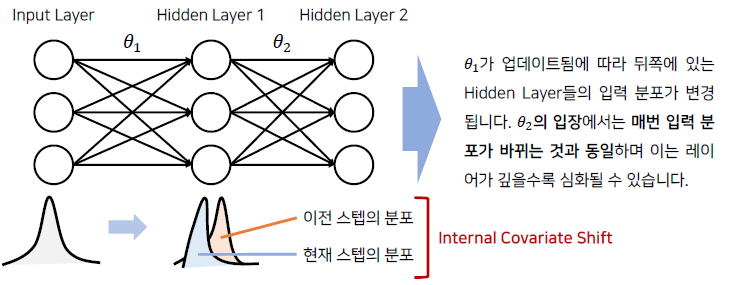

3.[Paper Review] Batch Normalization: Accelerating Deep Network Training by Reducing Internal Covariate Shift

1. Introduction SGD(Stochastic Gradient Descent) : 이전 포스터 참고 링크텍스트 SGD의 문제점 hyperparameter들의 초기값 설정을 굉장히 신중하게 해줘야 한다. -> 아닐 경우, covariate shift가 발생

4.[Paper Review] Language Models are Unsupervised Multitask Learners

1. Introduction 지금까지 ML에서 데이터셋이 많아지면서 효율이 높은 모델들이 많이 나왔지만, 아직까진 데이터가 조금만 어려워지고 변화가 일어나 분배가 잘못된다면 결과에 큰 영향을 미치게 된다. 또한, 단일 주제에서 그 주제와 관련된 데이터셋으로만 학습되는

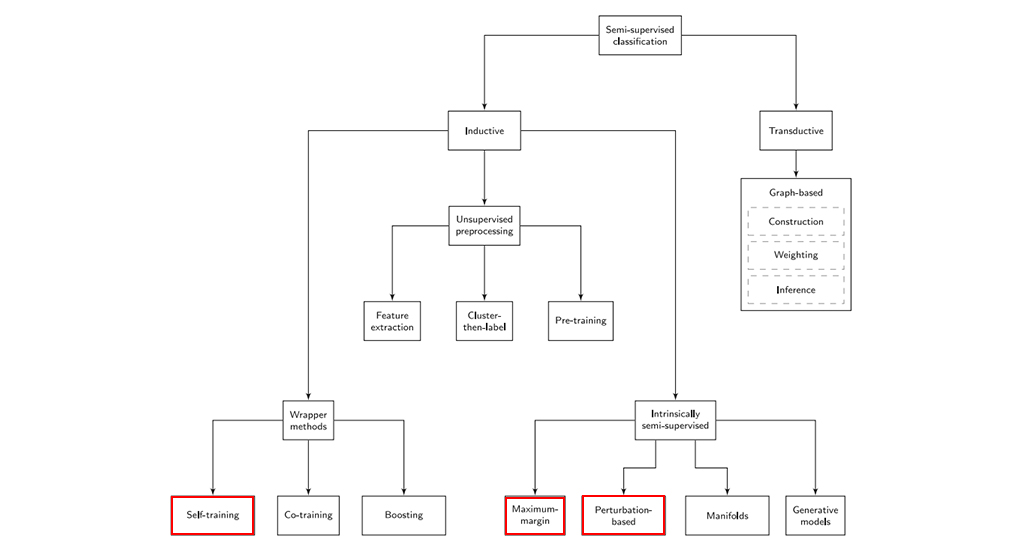

5.[Paper Review] ReMixMatch & FixMatch : Consistency-based Semi-supervised Learning Methods

준지도학습의 이름에는 절반을 뜻하는 ‘semi-’가 붙지만, 실제로 이 학습방식에는 위에서 언급한 레이블링된 데이터와 레이블링되지 않는 데이터가 모두 사용된다. 준지도학습에서는 한 쪽의 데이터에 있는 추가 정보를 활용해 다른 데이터 학습에서의 성능을 높이는 것을 목표로

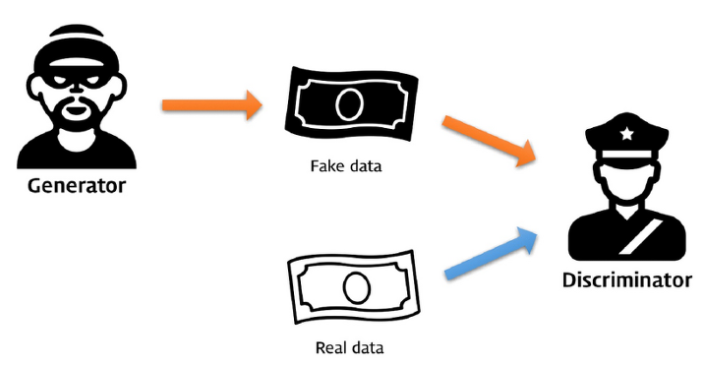

6.[Paper Review] Generative Adversarial Networks

본 논문에서는 적대적 과정을 통해 모델을 추정하기 위한 프레임워크를 제안한다.GAN에서 자주 볼 수 있는 그림인데, 데이터를 생성하는 Generator, 판별하는 Discriminator가 있다. 이 프레임워크는 두 명의 플레이어가 minmax game을 하는 것과 같