SONSU

1.CNN으로 수어 동작 학습하기-2

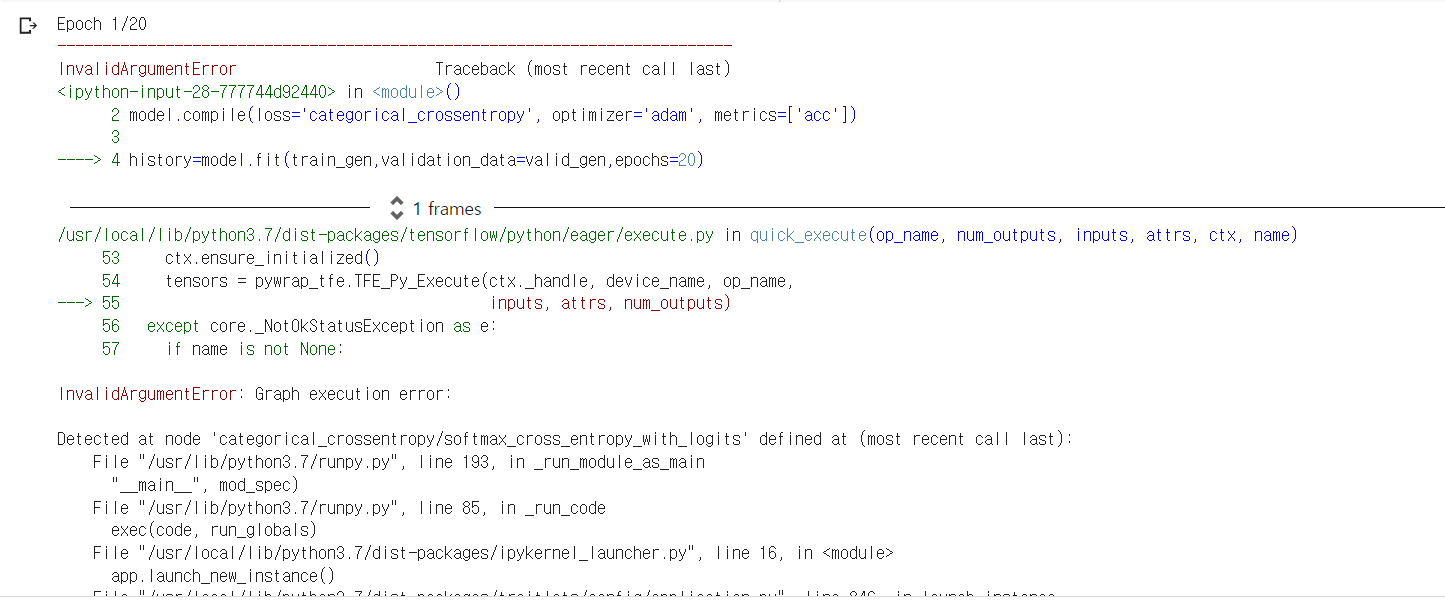

5프레임 당 1장, test data 일부 (5프레임), epoch 20: training accuracy 70% 부근 근처 왔다갔다 - 75%정도: validation accuracy 100%1프레임 당 1장, test data 일부 (5프레임), epoch 30:

2.CNN으로 수어 동작 학습하기 -1

https://patch-wilderness-074.notion.site/0412\_-852ae8eb75f1423f943b7b7df1b62152

3.CNN으로 수어 동작 학습하기-3

ㄴㄴ

4.[딥러닝] 헷갈리는 개념 - epoch? batch size? iteration?

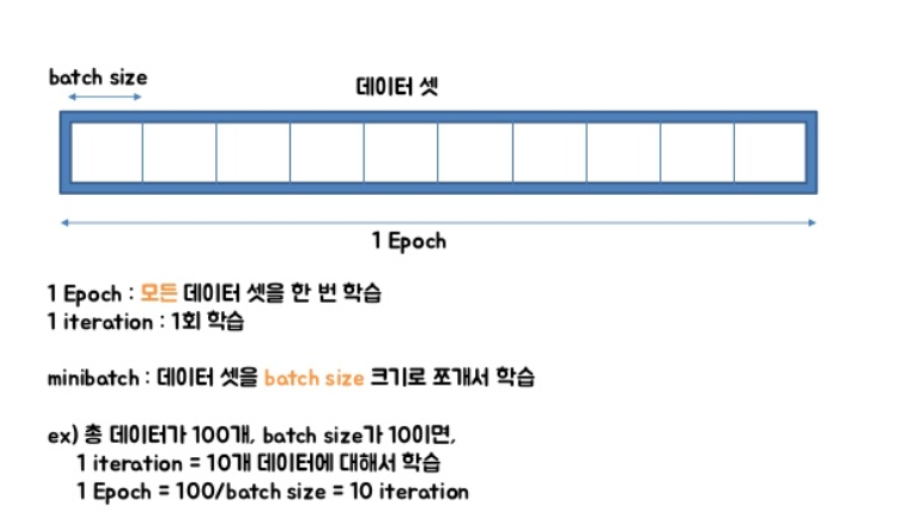

cnn 학습을 진행하다보니 이용하게 된 epoch, batch size 개념을 정확하게 짚고 기록에 남기고 싶어 포스팅 하게 되었다.다루어야 할 데이터가 너무 많기도 하고(메모리 부족), 한번의 계산으로 최적화된 값을 찾는 것은 힘들다. 따라서 머신 러닝에서 최적화를

5.CNN으로 동작 학습하기 - code review_ ver1.0

코랩으로 진행한 코드\_cnn_binary_5f11\. 텐서플로우, 넘파이, 맷플롯립 등 기본 라이브러리와 함께 케라스로부터 ImageDataGenerator 함수를 불러온다.2\. 구글 드라이브 마운트3\. 훈련셋, 검증셋 위치 지정케라스 ImageDataGenera

6.[CNN-LSTM 1] input data가 이미지인 CNN-LSTM 모델 자료조사

논문 정리노란색으로 표시해놓은 논문이 우리의 프로젝트에 가장 가까운 논문이라고 판단되었다.해당 논문에서 모델을 구축하는 데에 참고한 사이트이다. 하지만 실시간 판단이 아닌거같아 실시간으로 동작을 인식하는 모델을 찾아 보았다.그 결과, 실시간으로 pose recognit

7.[CNN-LSTM 2] input data가 이미지인 CNN-LSTM 모델 - video classification 중심으로

Video-Classification-CNN-and-LSTM github딥러닝을 사용하여 비디오 분류하기(GoogLeNet을 사용)Video-Classification-CNN-and-LSTM github에서는 VGG16을 사용함우리가 원래 참고하던 논문은 Incetio

8.[딥러닝] 3frame 당 1장? 1frame 당 1장?

기존에는 데이터 셋에는 train data, test data 2가지만 존재하는 줄 알고 cnn을 진행했는데, 회의를 통해서 train data, test data, validation data 3종류의 데이터가 필요하다는 것을 인지했다. 그러면서 든 생각은 그러면 내

9.[CNN-LSTM 3] input data가 이미지인 CNN-LSTM 모델 - video classification 중심으로2

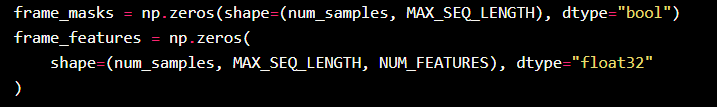

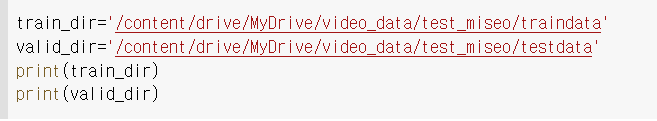

데이터 - UCF101데이터 셋의 서브샘플링된 버전을 사용한다.우리는 우리의 데이터 셋을 이용할 것이기 때문에 필요없다.필요한 라이브러리 import매개변수 정의video의 제목과 라벨링이 되어있는 csv 파일로 추정된다. 총 traing,test에 사용될 영상의 개수

10.[CNN-LSTM 4] AI HUB 데이터 살펴보기 및 CNN-LSTM 진행

결론적으로는 데이터셋이 정리되어있는 파일은 존재하지 않아 쉽게 찾을 수 있는 방법은 없었고, json 파일만 다운받아 csv파일로 변환하는 방법을 이용하기로 했다.다시 ai hub에서 제공하는 데이터셋을 찾다가 다른 외부데이터도 발견했다. 어째서 지금 처음본거지? 아니

11.[CNN-LSTM 5]

Using Modified Inception V3 CNN for Video Processing and Video ClassificationIt https://www.apriorit.com/dev-blog/606-inception-v3-for-video-clas

12.[CNN-LSTM 6] 코드 오류 해결 및 VGG16 구축완료

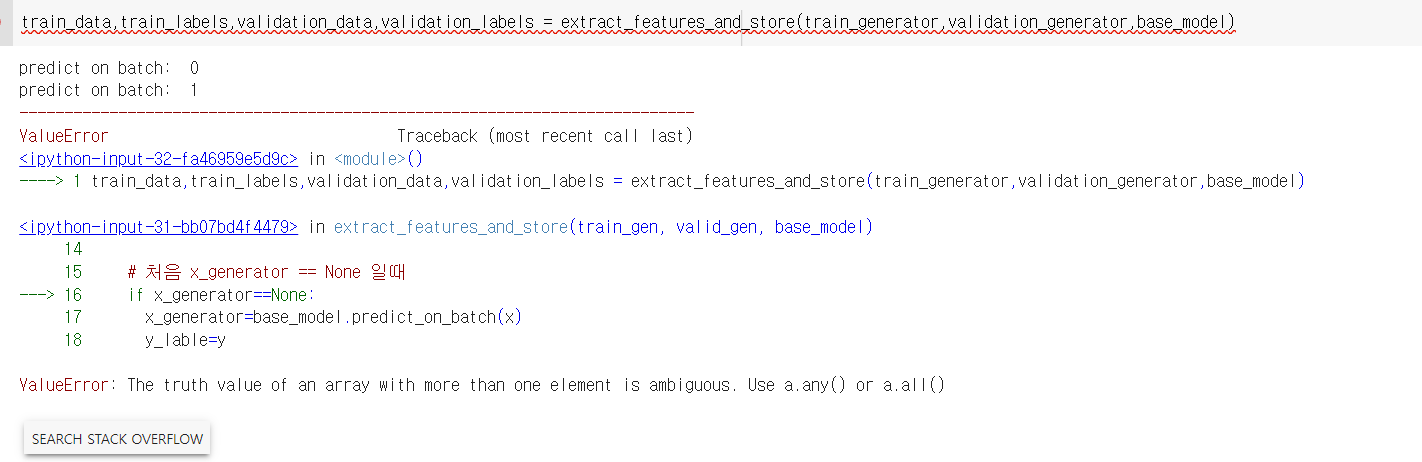

https://webclub.tistory.com/458https://okky.kr/article/1008493오류 및 해결 사항✅ 인코딩 오류 2개 \- 'utf-8' codec can't decode byte 0x93 in position 0:

13.[CNN-LSTM 7]

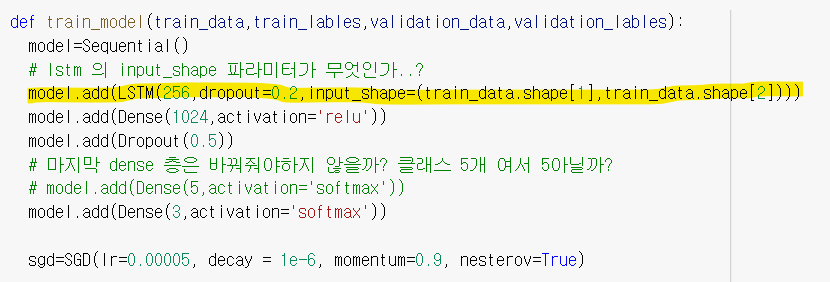

lstm 과 gru 모두 3차원의 입력을 받는다.samples: 데이터의 크기(data size)이며, 원본 데이터를 window size에 따라 슬라이싱 할 경우 생기는 데이터의 갯수이다.time steps: 과거 몇개의 데이터를 볼 것인가를 나타내며, 네트워크에 사

14.[웹] React 환경구축

이전에 node.js를 설치한 적이 있어 node -v 명령어를 통해 최신 버전인지 확인했다. 최근 릴리즈되어 있는 버전은 v16.15.0으로, 업데이트가 필요했다. node.js는 최신 버전을 다운받으면 기존의 버전이 업데이트 되므로 따로 업데이트 방법을 쓰지 않아도

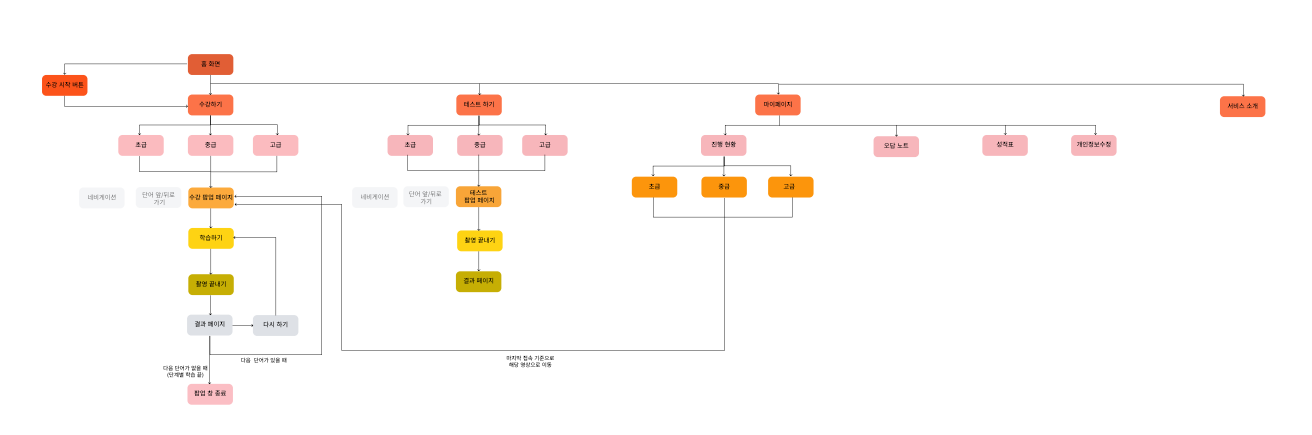

15.[웹] 메뉴 트리, 사이트맵 작성

📌 메뉴트리 📌 사이트맵

16.[웹] 리액트 알아가기 -1

.js 파일인데 html과 같은 문법을 쓴다. 이게 뭐지?✅.js파일에서 쓰는 html == JSXCSS 지정해줄때, class가 아니라, 'className'변수 넣을때는 { 변수 } == 데이터 바인딩css외에 style을 직접 넣을 때는 style={{스타일명:'

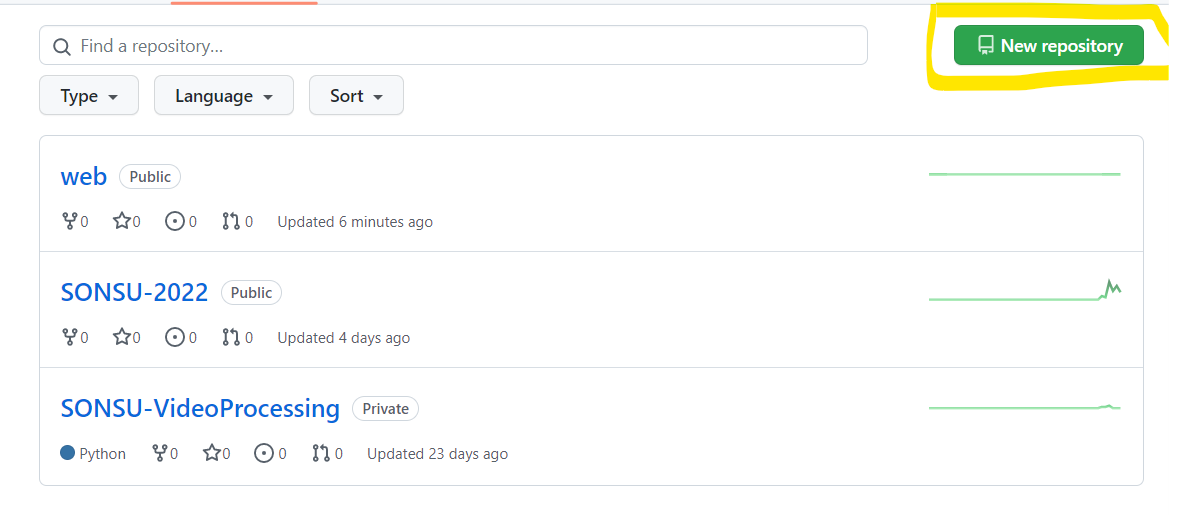

17.[GIT] organization에서 repository를 생성하여 협업하기 -1

1\. 먼저 organization에 repository를 생성한다.web이라는 repository를 이미 만들어놓아서 예시 사진은 webb으로 되어있지만, 우리가 사용할 repo의 이름은 'web'이다.2\. repository가 생성되었으니, 이제 프로젝트 참여자는

18.[GIT] pull & push를 통해 협업하기

pull : 다른 팀원A가 수정하여 업데이트 해놓은 상태 + 나의 로컬에는 그 수정사항이 반영되지 않은 상태 => 내가 작업을 시작하기 전에는 꼭 팀원A가 업데이트 해놓은 상태에서 내 코드를 짜야하기 때문에 pull을 통해서 수정된 파일로 업데이트 해줘야함.: 원격 저

19.[웹] React 페이지 이동

📝 페이지 구성을 위한 리액트의 페이지 이동방법을 알아보고 익히는 것을 목표로 한다. 📌 react-router-dom 라우팅 : url 요청에 대해 어떤 페이지를 보여줄지 결정하는 과정. react-router-dom 내장 컴포넌트 BrowserRout

20.[웹] Material UI 사용하기

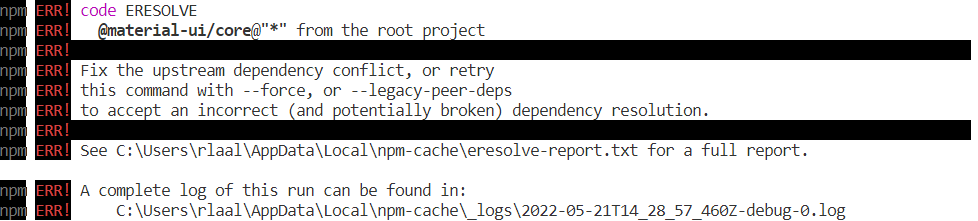

모두가 이렇게 설치하라고 했지만 대차게 오류가 났다.fix the upstream dependency conflict, or retrynpm ERR! this command with --force, or --legacy-peer-depsnpm ERR! to accept

21.[웹] 리액트 진행(1/N) - sidebar만들기 | map() | 새창열기(window.open)

📌 배열 내장 함수 map을 통한 component 반복 📝 map () 함수 : 각 배열의 요소를 돌면서 인자로 전달된 함수를 사용하여 처리된 새로운 결과를 새로운 배열에 담아 반환하는 함수. map을 이용하면 위의 코드를 아래와 같이 나타낼 수 있다.

22.[웹] CSS 속성 (1/n) - position | display:flex | text 가운데 정렬

📌 position : 레이아웃을 배치하거나, 객체를 위치시킬 때 사용하는 속성 : position 속성은 상속되지 않으며, top, bottom,left,right 를 같이 설정할 수 있다. > static(기본값) : 위치를 지정하지 않을 때 사용 > rela

23.[CNN-LSTM] Dropout?

📝 파라미터의 변화보다 오버피팅을 해결해야한다는 피드백을 받았다. 📝 오버피팅 문제를 dropout으로 해결해보는 건 어떠냐는 피드백과 함께 ,, 우리의 dropout은..? 하고 확인해봤다. dropout은 한 층으로, 0.5 였다. 📌 overfitting

24.[웹] 리액트 웹캠 연결하기

npm에 react-webcam 이 있는 것을 확인했다.공식 페이지에 적혀있는 것을 보고 따라했다.react-webcam을 설치한다.태그로 웹캠을 나타낼 수 있다.\++ audio,mirrored 등 props 들이 존재한다.딥러닝 - 딥러닝 웹서비스 개발 도전기 -

25.[웹] 리액트 동영상 재생

✔️ embed 태그는 외부 콘텐츠를 사용할 수 있도록 설정해주는데, 현재 대부분의 최신 브라우저는 플러그인 지원을 중단하고 있어서 권하지 않는다고 한다.✔️ iframe은 설정한 크기의 공간을 만들어놓고, 그 안에 다른 사이트나 다른 페이지의 소스를 불러와서 보여주는

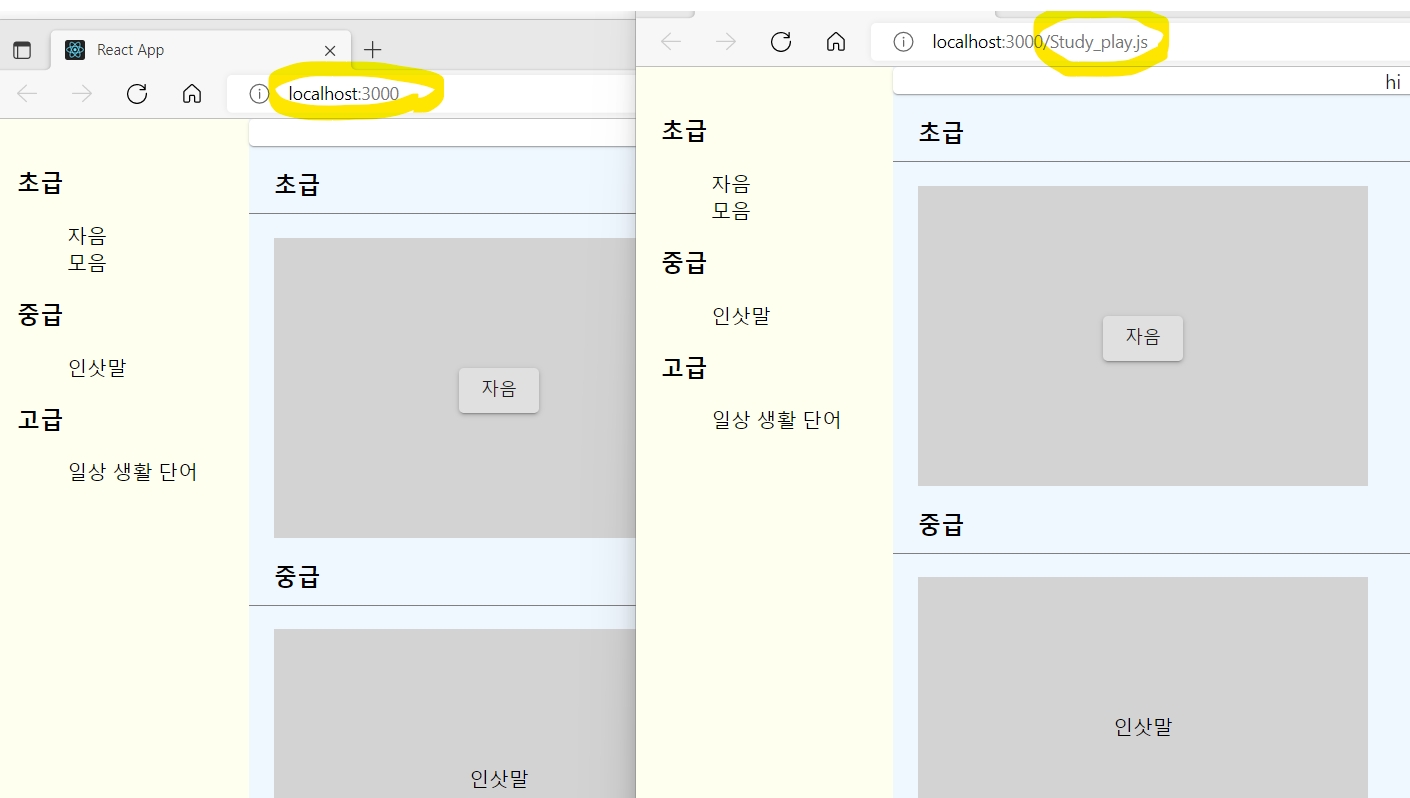

26.[웹] react-router-dom 을 활용하여 페이지 이동하기

📝 react-router-dom을 활용하여 페이지 이동을 구현한다. 🚩 react-router-dom 설치 🚩 React Router 사용 ✔️ 브라우저의 url과 컴포넌트를 연결하는 작업이다. ✔️ react-router-dom에서 BrowserRoute

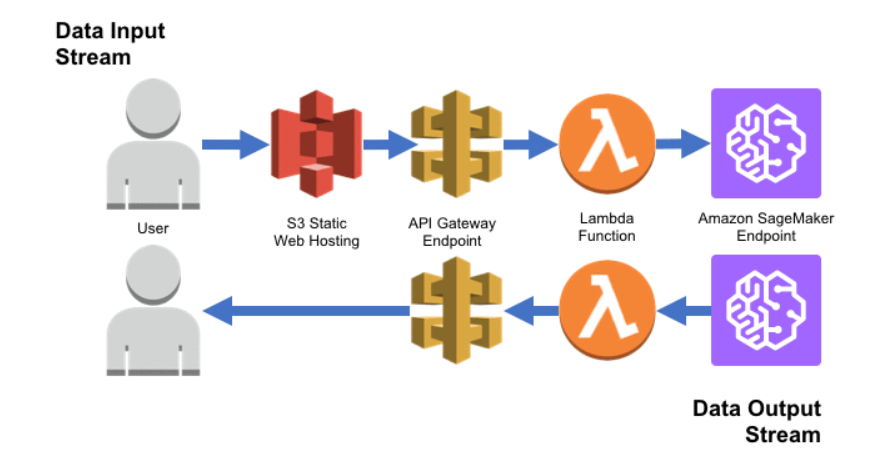

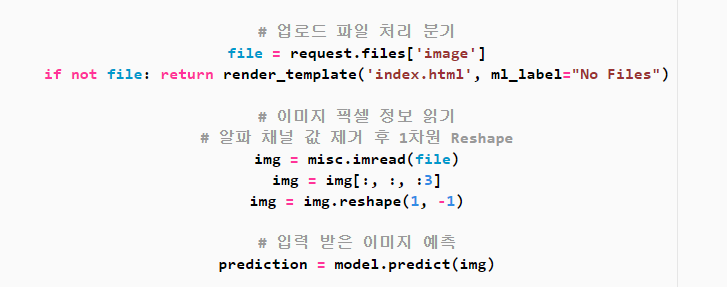

27.[웹] 모델을 웹에 올리는 방법 조사

📝 우리는 최종적으로 완성한 모델을 웹에서 구현해야한다. 어떻게 하는걸까? 🔹Ref-1 머신러닝모델 웹에 올리기- REST API를 이용해 손글씨 숫자 예측 웹 만들기 ✔️ flask 이용 ✔️ RESTapi를 설계하여 프론트와 백이 소통한다. ✔️ h5 형식의

28.[웹] 웹캠으로 촬영한 사용자의 영상의 전처리 과정은 어떻게 이루어져 모델로 넘어갈까? - 조사

📝 웹캠으로 촬영한 사용자의 영상이 어떻게 모델로 넘어가고, 예측 결과를 받아올 수 있는지에 대해 조사하는 시간을 가진다. 🔹Ref1 -지능형 행동인식 기술을 이용한 실시간 동영상 감시시스템 개발 ✔️ 스트리밍 서버로 실시간으로 동영상을 전송한다. ✔️ 이후 모

29.[웹] 프론트와 백엔드의 소통에 관하여 - 조사

REpresentatioanl State Transfer리소스를 이름으로 구분하여 해당 리소스의 상태(정보)를 주고받는 모든 것네트워크 상에서 클라이언트와 서버 사이의 통신 방식중 하나HTTP 기반으로 필요한 자원에 접근하는 방식을 정해놓은 아키텍쳐HTTP 프로토콜을