GNN

1.Graph Representation Learning

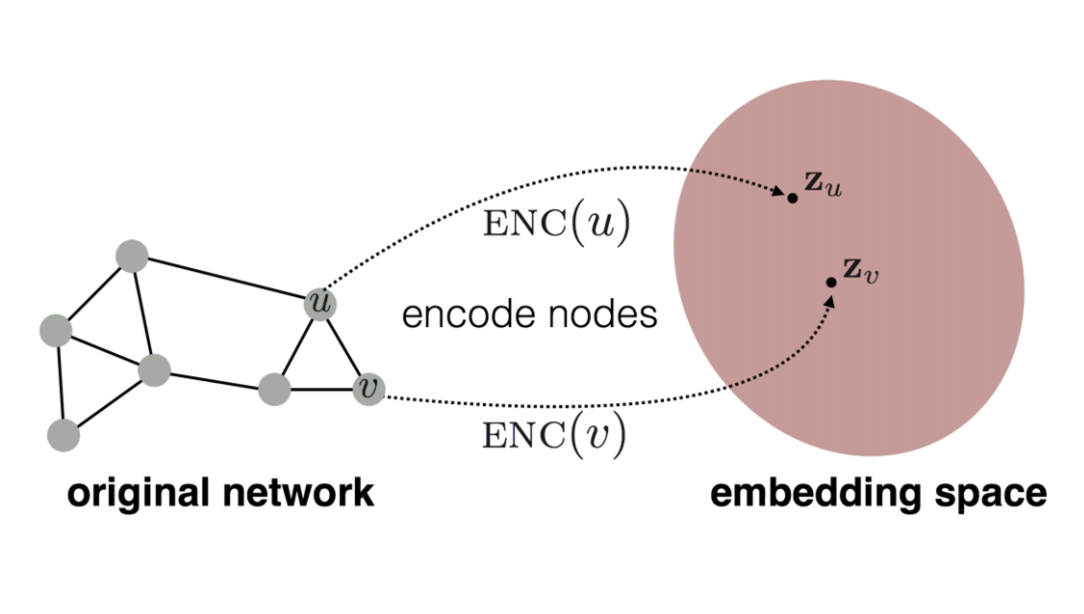

representation learing?어떤 task 를 수행할 수 있는 표현을 만드는 것임베딩이 필요한 이유는 Adjacency Matrix 가 매우 sparse 하기 때문에 computation 측면에서 필요임베딩의 목적은 원본 Graph 의 유사도와 embedd

2.Graph Neural Network 기본

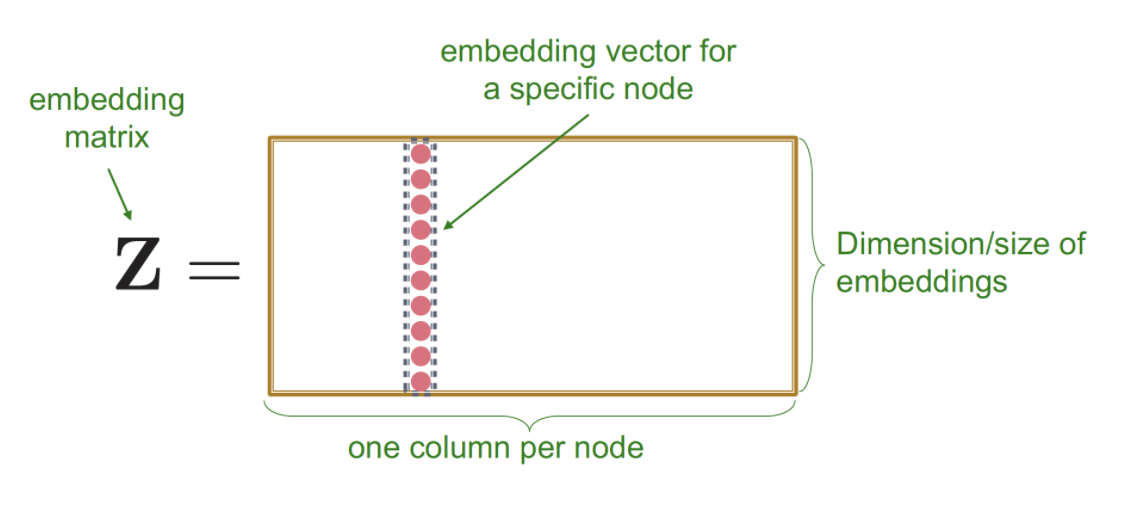

Shallow Encoder는 Single layer(f)로 구성되어 있고, 이를 통해 node embedding 진행($u$ → $z_u)$, 유사도 계산($z_u^tz_v$)Lookup table 형식으로 노드 임베딩 값을 꺼내 사용1) 각 node끼리 파라미터

3.GNN 관련 기타 이슈

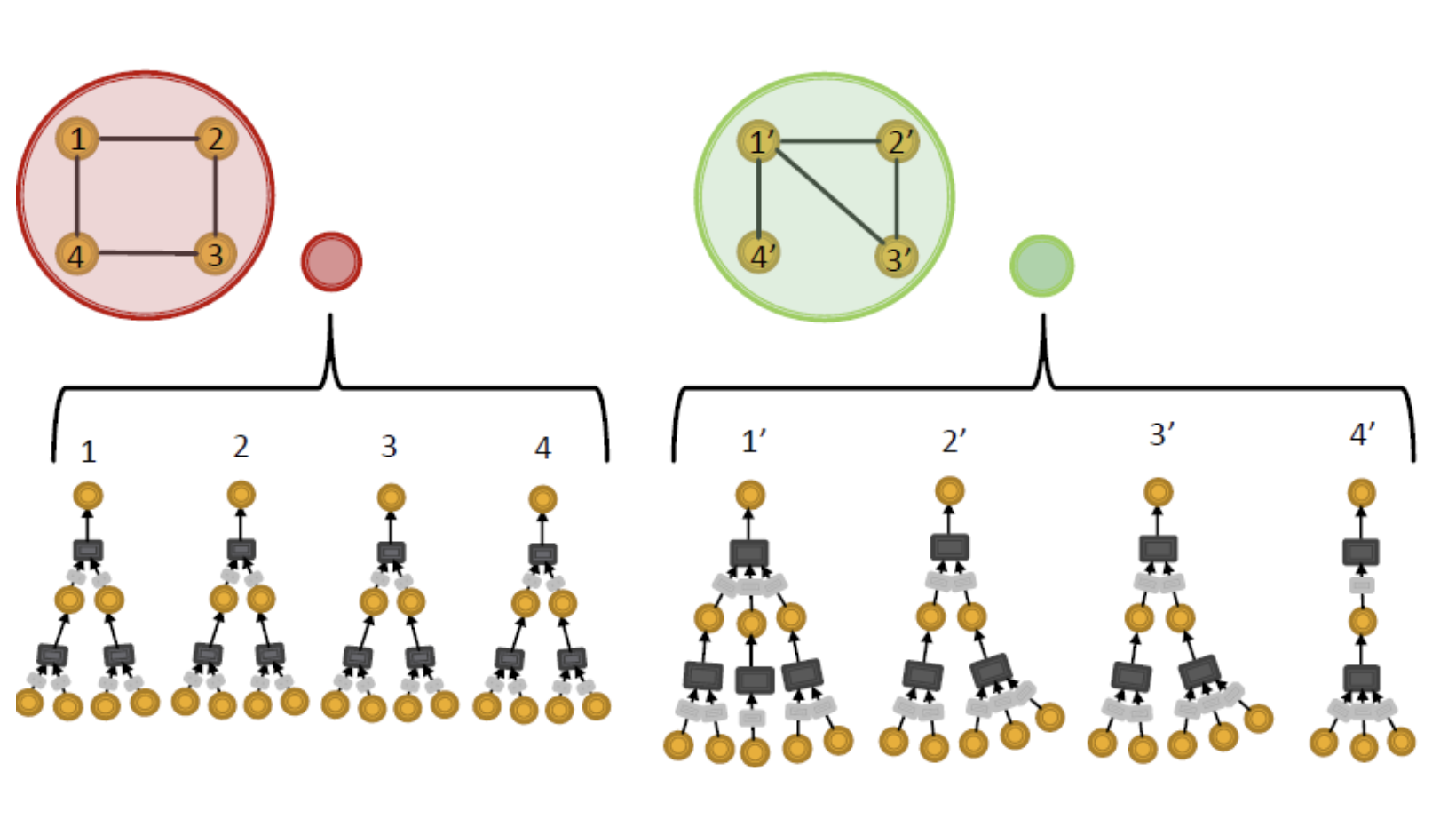

GNN 구현시 관련 기타 이슈를 기록 & 업데이트 Inductive learning Ground truth 를 알고있는 data로 모델을 학습한 후, 전혀 새로운 graph에 대해 node와 edge를 추정하는 것Transductive learningKnown data

4.GNN application

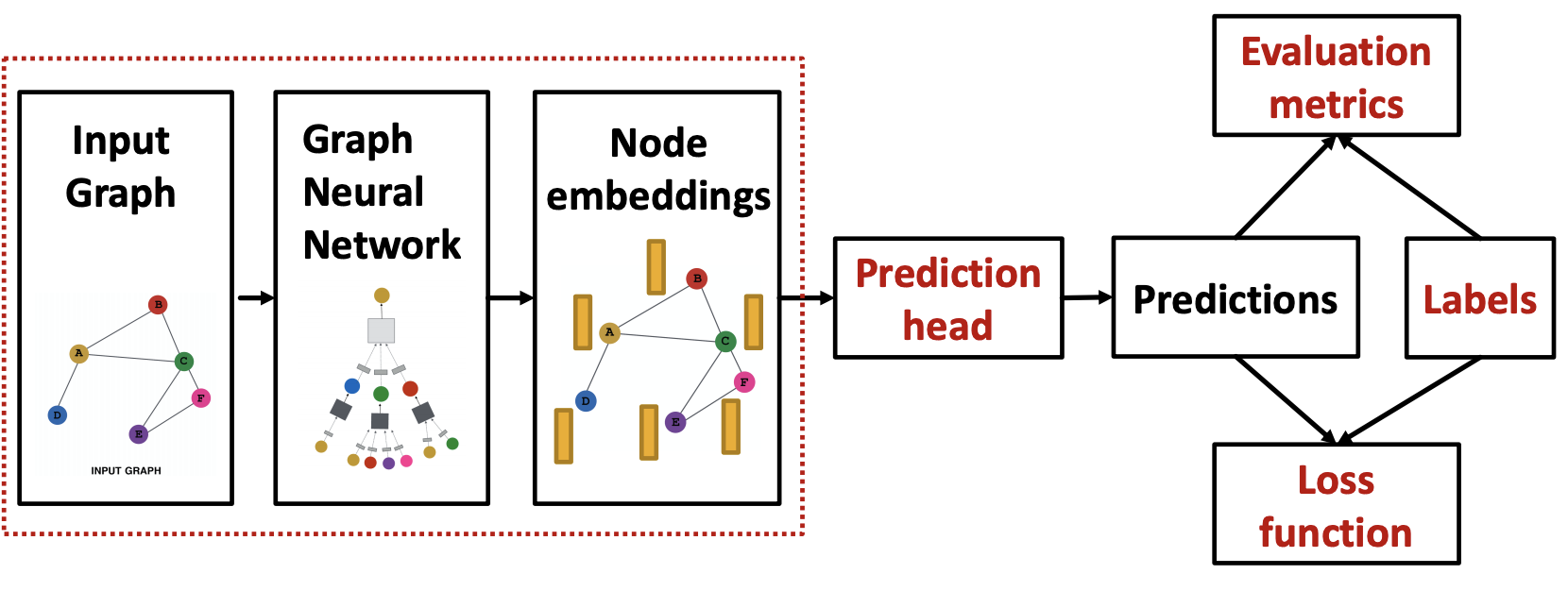

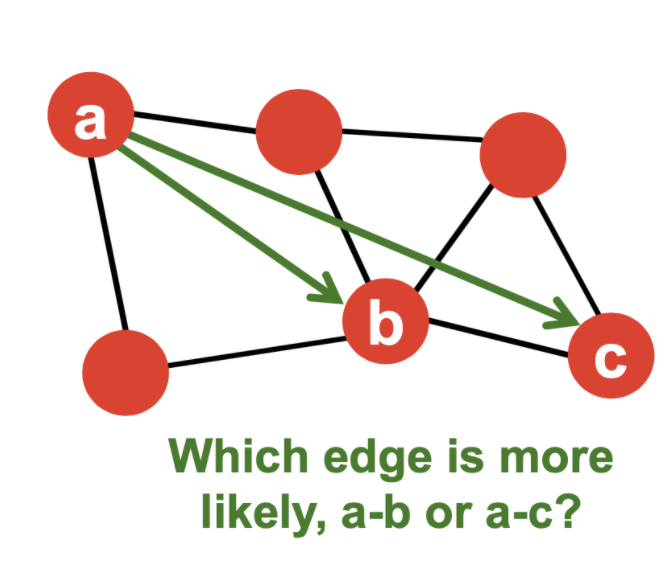

CS224W- 8강 GNN application 내용 정리실제 industry에서의 GNN 응용 관점을 정리한 강의 내용Node level predction$\\hat yv = Head{node}(h_v^{(L)}) = W^{(H)}h_v^{(l)}$Edge level

5.Limitations of GNN

CS224W의 Limitations of GNN, Advanced topic in GNN, A General perspective on GNN, Scaling up GNN Large Graph 강의 중 GNN의 한계점과 대안법에 요약한 글→ agg 과정에서 max p

6.Community Detection

CS224W의 Community Structruture in Networks 강의와 Spectral Clutering 강의 부분을 정리한 글입니다. 아래 4가지 알고리즘에 대한 내용을 알아봄Louvain 알고리즘BigCLAMSpectral ClusteringMotif-