😊안녕하세요. 오늘 알아볼 주제는 바로 Super Resolution(SR)입니다.

Super Resolution이란 무엇일까?

Super Resolution은 초해상화라고 하고, 이는 저해상도 영상을 고해상도 영상으로 변환해주는 과제입니다. 영상의 해상도가 좋을수록 그 영상을 시청하는 사람들의 만족도가 좋을수 밖에 없겠죠? 따라서 SR은 컴퓨터 비젼 분야 중 매우 실용적인 분야 중 하나로 뽑히고 있습니다.

그림1. 저화질 이미지 고화질 이미지 변환

딥러닝을 통한 SR이 등장하기 전에는 바이큐빅 보간법과 같은 다항식 기반의 보간법 혹은 선형 매핑을 사용하는 로컬 패치기반의 초해상화 기법들이 널리 연구되었습니다. 이러한 방법들은 상대적으로 적은 복잡도와 연산량으로 고품질의 영상들을 생성해 낼 수 있었습니다. 하지만 이러한 방법들은 단순한 선형 매핑을 기반으로 하기 때문에, 복잡하고 비선형적인 저해상도-고해상도 모델을 구현하기 어렵다는 단점이 존재했습니다.

해당 문제를 해결하기 위해 CNN기반의 초해상화 알고리즘들이 등장하기 되었습니다. 이는 여러겹으로 쌓은 다층 네트워크를 사용하여 비선형적 관계를 정밀하게 분석하여 정확하게 변환할 수 있는 합성곱 필터를 학습합니다.

특히 이러한 딥러닝 기반 Image Classification에 큰 성능을 보인 ResNet에서 영감을 얻어 Residual Learning을 이용하여 보다 깊은 네트워크를 효율적으로 학습 시킬 수 있었습니다.

EDSR(Enhenced Deep Super Resolution)

일반적으로 깊은 딥러닝 모델로 깊은 네트워크를 설계한다면 연산량이 많아지고, 파라미터 수가 증가하게 됩니다. 하지만 깊은 네트워크를 학습 시 역전파(back propagation)시 입력층으로 갈 수록 기울기(Gradient)가 작아져 결국 기울기가 소실되는 Gradient Vanishing 현상이 발생하거나 반대로 기울기가 매우 커져서 발산하는 Gradient Exploding 문제가 발생하여 네트워크의 학습이 제대로 되지 않을 수 있는 문제가 있습니다.

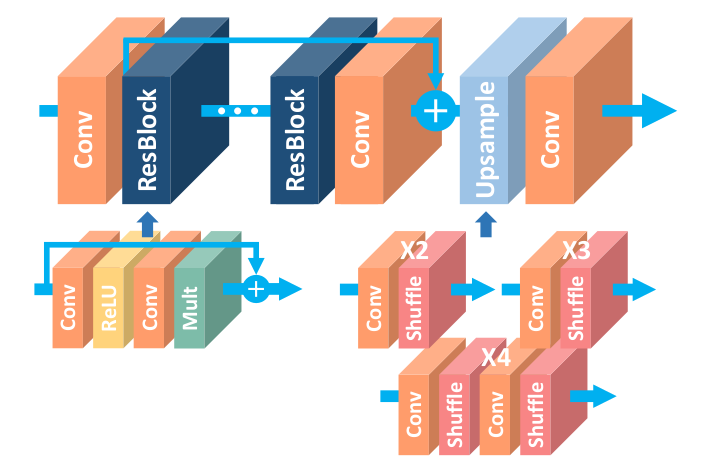

이러한 문제를 해결하기 위해 EDSR은 크게 두가지 방법을 사용했습니다. 첫번째는 잔여학습(Residual Learing)이고, 두번째는 SPCNN(Sub Pixel Convolutional Neural Network)입니다.

Residual Learning

잔여 학습이란 입력 LR 영상을 최종 출력 HR 영상에 더해주고 두 영상의 차이 값을 학습하는 방법입니다. 일반적으로 입력 LR 영상과 출력 HR 영상은 비슷하기 때문에 그 차이 값은 매우 작거나 0이므로 기울기 소실/폭주 문제를 해결할 수 있었다.

EDSR은 32개 이상의 층을 사용하였고 채널 수도 기존의 다른 네트워크 대비 4배 이상 늘려 파라미터 수도 그에 비례하여 매우 많이 증가하였습니다. 이는 깊어진 네트워크를 보다 안정적으로 학습하기 위해 네트워크를 잔여 블록(Residual Block) 별로 나누고 각각을 스킵 커넥션(Skip Connection)을 사용해 연결하며 필터 파라미터들이 더 쉽게 최적화되도록 네트워크를 설계하였습니다.

또한 EDSR에서는 은 각각의 잔여 블록 안에서 feature map들이 더해지면서 feature map들의 분산이 커지는 경우가 생겨 학습이 잘 안되는 문제를 해결하기 위해 일정한 상수 값을 CNN 층 이후에 곱해주는 Multi 층을 추가하였습니다.

SPCNN(Sub Pixel Convolutional Neural Network)

EDSR에서는 SPCNN(Sub Pixel Convolutional NeuralNetwork)을 사용해 학습과정에서 입력 LR 영상의 해상도를 키웠습니다. SPCNN을 사용한다면 CNN층을 거친 뒤 마지막 층에서 feature map의 개수를 업스케일링 배수의 제곱 개만큼 늘려준 뒤 이를 픽셀 셔플(Pixel Shuffle) 연산을 통하여 적절히 배치하여 원하는 해상도의 출력 HR 영상을 복원해낼 수 있습니다. 이는 기존 바이큐빅 보간법을 사용해 입력 LR 영상의 해상도를 키우고 네트워크에 입력한 기존 VDSR(처음으로 잔여학습을 사용함) 대비 효율적인 연산이 가능하고 네트워크 정확도 또한 높아졌습니다.

EDSR code

EDSR의 코드는 다음 사이트에서 확인 할 수 있으며, Super Resolution task에서 사용되는 데이터 셋인 DIV2K 데이터셋을 학습시키고 테스트하기 위한 코드이다.

EDSR 코드 보러 가기