ZFNet

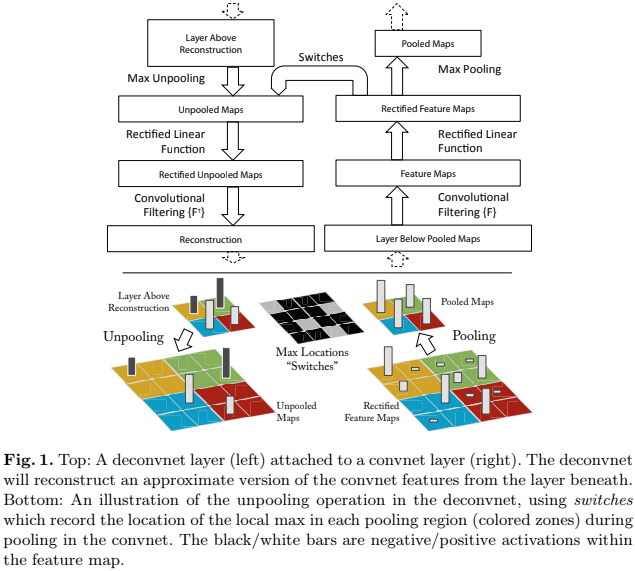

목표 : AlexNet에서 pooling을 시켰을 때 어떤 상태인지 확인하기

의의 : Visualization, ablation study

pooling한 것을 복원하면 디테일이 다 죽기 때문에 완벽하게 복원이 안 되고, 가장 큰 값이 무엇인지 확인이 가능함

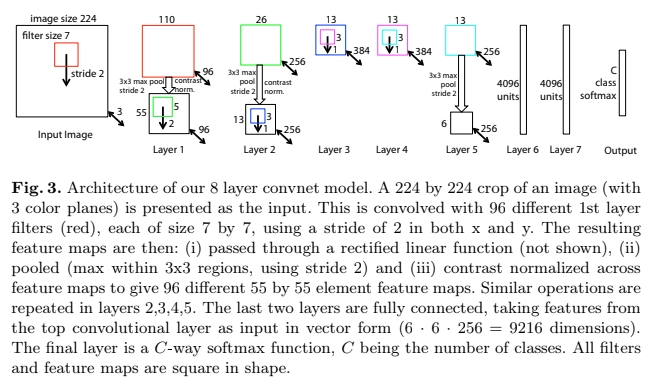

AlexNet과 다른 점

1. 11x11, /4 -> 7x7, /2 : 7x7 receptive field가 더 성능이 좋은 것을 확인 가능함 + parameter도 줄어드는 부차적인 효과가 있음

2. overlapping pooling

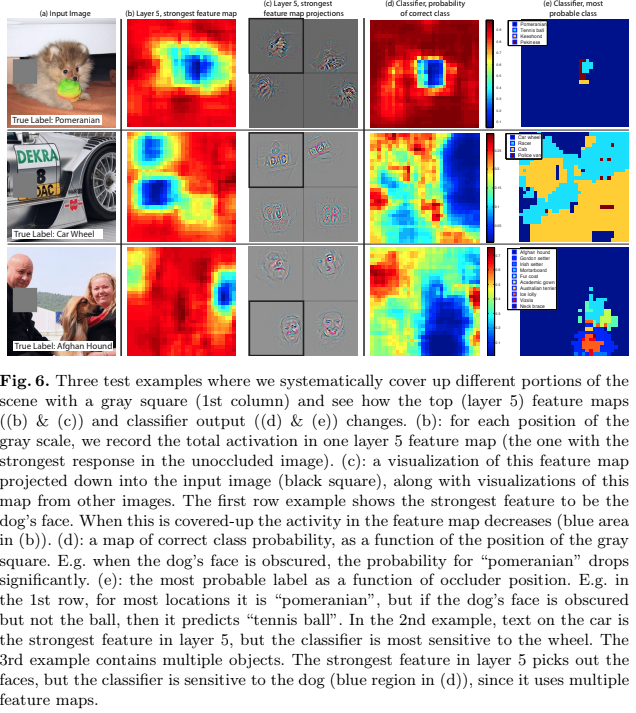

abulation study 관점에서 convolution의 활성화 영역을 보는 것. 푸른 색일 수록 크게 영향을 미쳤음을 확인 할 수 있고, 만약 회색 filter가 있는 영역이 파란색으로 표현이 되었으면 그 영역이 중요한 영역임을 확인 함

Network In Network

Convolution에 Fully connected layer(Dense)를 집어 넣음

학습을 통해서 제일 잘 특성있는 것을 찾기 때문에 효과는 없었음

하지만, 2014년도 GoogleNet에 영향을 많이 줬음

local patches with the receptive field

구조 활용

1. Convolution 안에 NN 집어넣음 - 효과가 없음

Not linear하기 때문에 복잡한 형태도 학습을 시킬 수 있을 것이라고 예측을 하였으나 실제로는 효과가 없음

2. 같은 구조를 stacking함

3. Flatten이 없음 - Global average pooling layer

하나의 값으로 예측을 하기 위해서는 Flatten을 시켜야 하지만 Flatten은 weight를 폭발적으로 증가시킴.

Dense layer에 집어넣기 위해서 Flatten을 안 쓰고 2차원에 있는 값들을 global average pooling을 하여 1차원으로 바꿈.

얘를 들어 (3, 3, 256)을 (3, 3)짜리를 average pooling을 하여 depth(256)가 만큼 구하는 것

Global Average Pooling은 outlier, 학습 안 된것들을 하나의 값으로 학습하기 때문에 성능이 좋을 때가 있음