HAI

1.[논문리뷰] A Multi-Agent Approach to Combine Reasoning and Learning for an Ethical Behavior(2021)

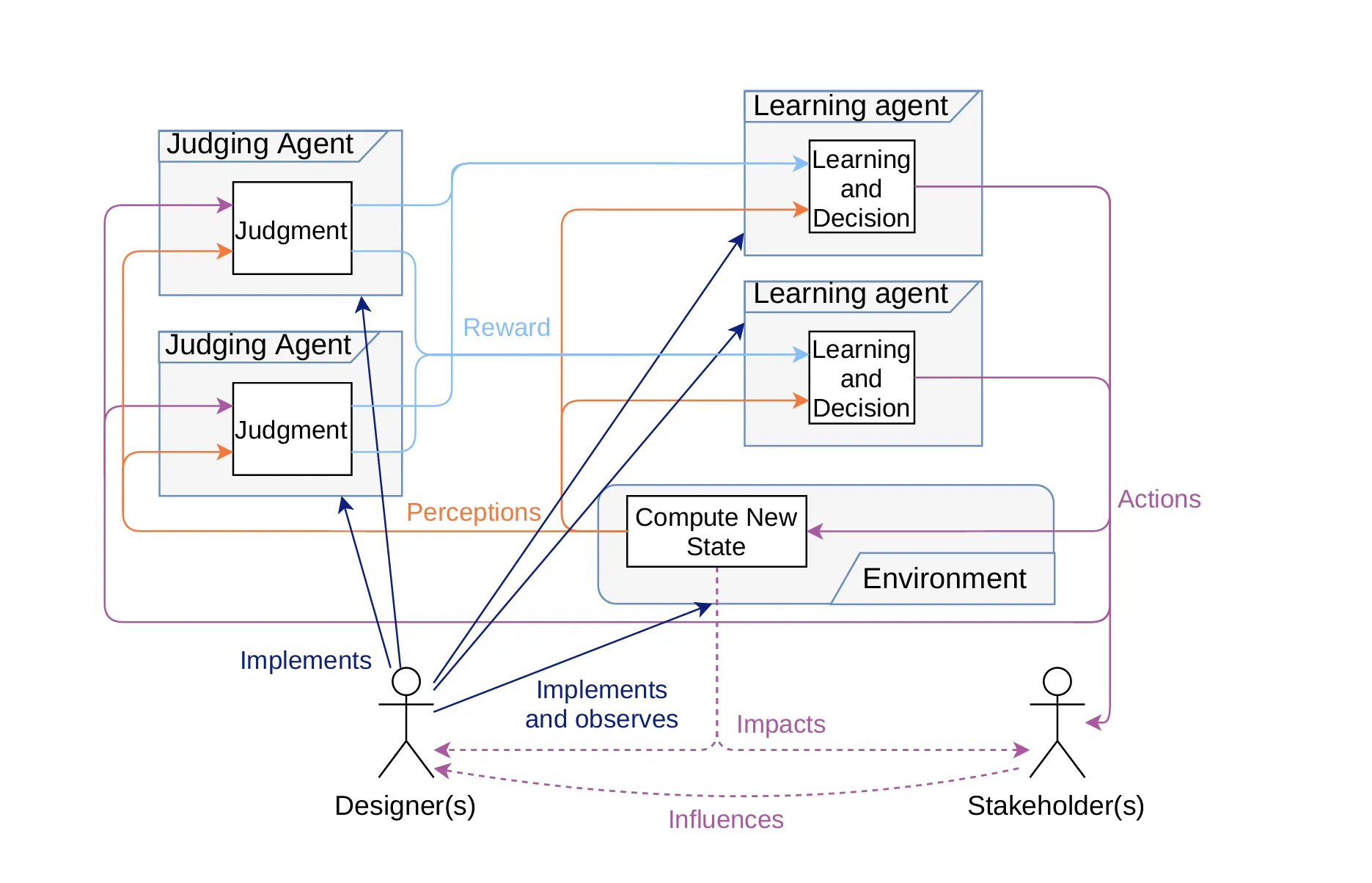

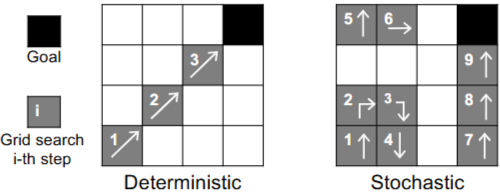

🔆 본 논문은 AI 모델에서 윤리적 행동을 가능하게 하기 위한 필요성을 설명하며, 현재 윤리적 원칙을 정의하거나 학습하는 방법론이 각각 제한점을 가지고 있다는 것을 지적한다.이에 상징적 판단 에이전트와 학습 에이전트를 결합한 새로운 하이브리드 접근 방식을 제안하며,

2.[논문리뷰] A survey on LLM-based multi-agent systems : workflow, infrastructure, and challenges

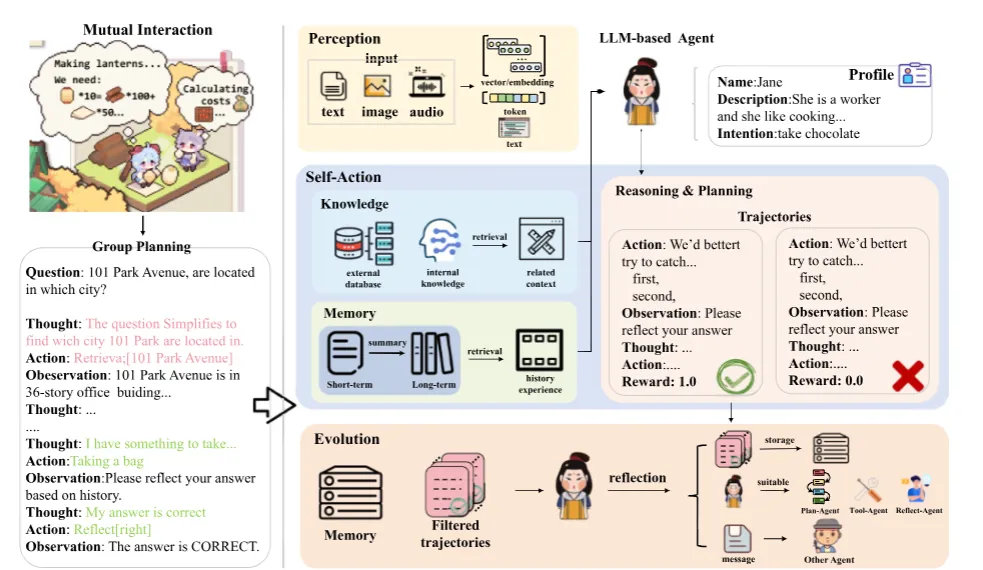

🔆 LLM-based multi-agent system이 어떻게 구성되는지 설명하는 survey 논문이다. 강화학습 기반 multi-agent를 배우며 ehtical한 ai를 만들기 위해 multi-agent가 꼭 필요하다고 생각해 읽게 되었다.주 : 내용 정말 김.

3.[논문리뷰] Generative agent-based modeling : an introduction and tutorial

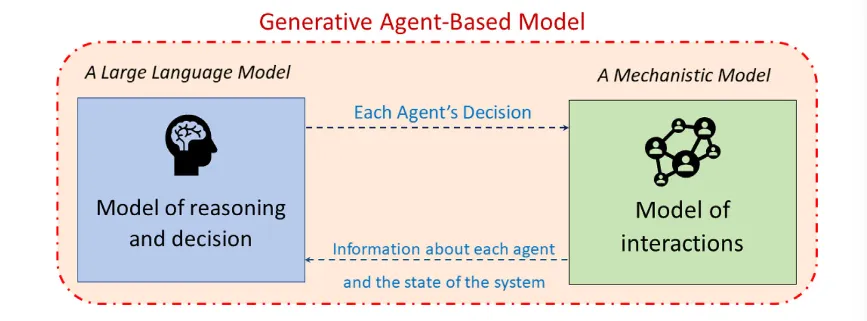

🔆 해당 아티클이 현실 인간의 추론과 의사결정을 포함해 다양한 사회적인 시스템의 효과적이고 유동적인 모델을 만들 수 있는 가이드가 되고자 함.논문 링크 : https://onlinelibrary.wiley.com/doi/abs/10.1002/sdr.1761행

4.[논문리뷰] ALI-Agent : Assessing LLM's Alignment with Human Values via Agent-based Simulation(2024)

ALI-Agent : Assessing LLM's Alignment with Human Values via Agent-based Simulation(2024)해당 논문은 ALI-Agent라는 테스트 시나리오 생성 프레임워크를 소개한다. 그게 무슨 말이냐 하면...LLM

5.[논문리뷰] On the resilience of multi-agent systems with malicious agents(2024)

On the resilience of multi-agent systems with malicious agents(2024)paper linkUnder review as a conference paper at ICLR 2025HAI에 대한 논문을 읽으면서 여러 가지 주제

6.[논문리뷰] Generative Agents : Interactive Simulacra of Human Behavior

참고 자료 : https://m.blog.naver.com/dlwoduq234/223090404339 논문에서 진행하고 있는 시뮬레이션을 확인할 수 있는 사이트 URL 문라이트 링크 : https://www.themoonlight.io/paper/cbfcc50f-de4

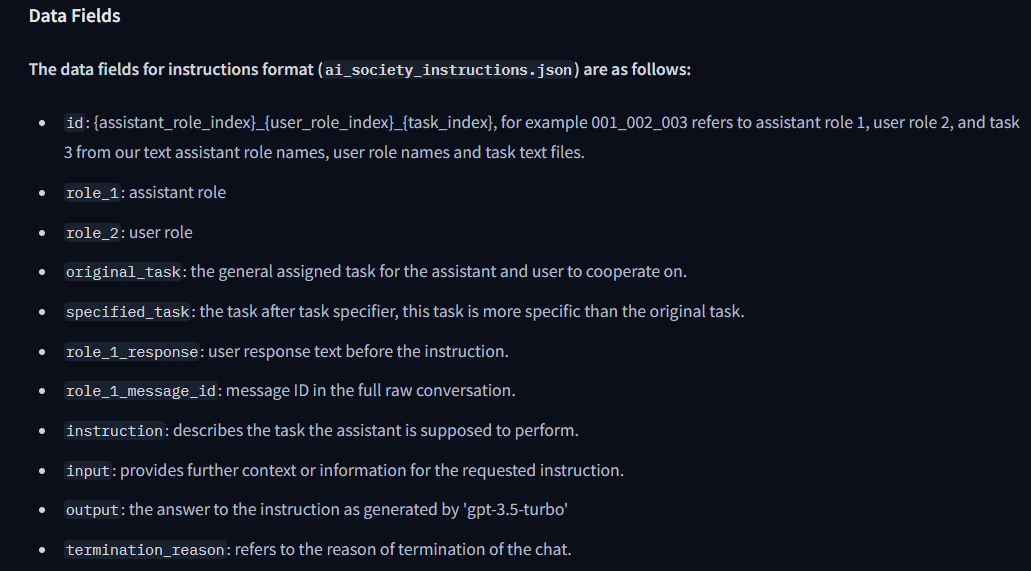

7.[논문리뷰] CAMEL: Communicative Agents for "Mind" Exploration of Large Language Model Society(2023)

CAMEL: Communicative Agents for "Mind" Exploration of Large Language Model Society(2023) paper link, github link fullpaperlink : 여기는 부록도 있음!!! 뉴립스에

8.[논문리뷰] REVECA: Adaptive Planning and Trajectory-based Validation in Cooperative Language Agents using Information Relevance and Relative Proximity

REVECA: Adaptive Planning and Trajectory-based Validation in Cooperative Language Agents using Information Relevance and Relative Proximity paper lin

9.RL-JACK : Reinforcement Learning-powered Black-box Jailbreaking Attack against LLMs

RL-JACK : Reinforcement Learning-powered Black-box Jailbreaking Attack against LLMs 현재 Jailbreaking의 한계 Handcrafting jailbreaking prompts requires i

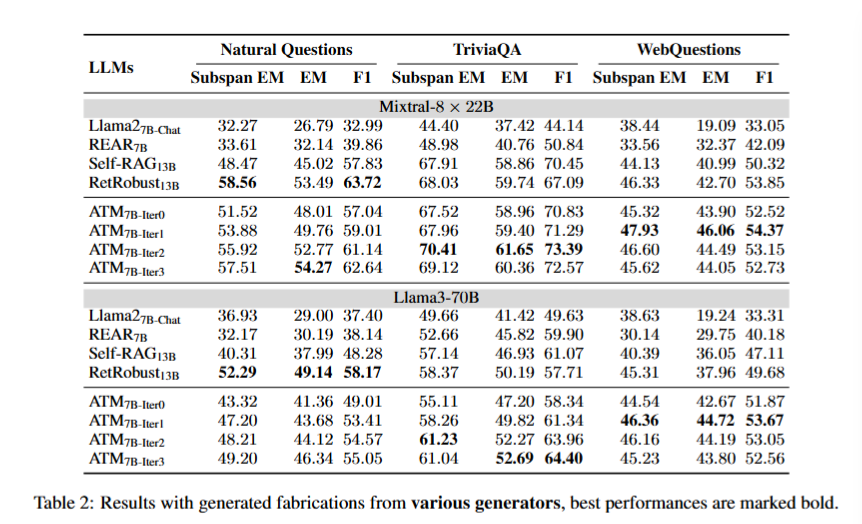

10.ATM: Adversarial Tuning Multi-agent System Makes a Robust Retrieval-Augmented Generator

paper_link code_link EMNLP 2024 Abstract RAG 시스템은 잡음에 취약하고 잘못된 응답을 생성할 가능성이 있음 적대적 조정 다중 에이전트 시스템(ATM)을 이용하여 검색 증강 생성기를 최적화 보조 공격자 agent의 도움을 받아 여러