Paper-Review

1.[Paper Review] : Trailer

회사를 다니면서 동시에 Velog 이전을 조금씩 하다보니 포스팅을 하는 속도가 더디네요..ㅎ 이번주부턴 Paper Review를 정리해서 올려보려고 합니다! 핵심내용을 정리하고자 하니 보시는 분들한테도 도움이 되면 좋겠네요!

2.Transformer : Attention is all you need (2017)

오늘 리뷰할 논문은 현대 LLM이 나오기까지 가장 큰 출발이라 불리는 Transformer가 소개된 2017년 논문 "Attention is all you need"입니다.

3.Compounded AI System : The Shift from Models to Compound AI Systems

Matei Zaharia , Omar Khattab , Lingjiao Chen , Jared Quincy Davis , Heather Miller , Chris Potts , James Zou , Michael Carbin , Jonathan Frankle , Nav

4.CoVe : Chain of Verification Reduces Hallucination in LLMs (2023)

사실적으로 그럴듯하지만 잘못된 정보를 생성하는 것, 즉 환각현상(=Hallucinations)은 LLMs에서 해결되지 않은 문제입니다. 환각현상을 Prompting을 활용하여 검증하는 방법론인 CoVe에 대해 알아봅시다!

5.RAG Survey : A Survey on Retrieval-Augmented Text Generation for Large Language Models (2024)

Retrieval-Augmented Generation (RAG)은 대규모 언어 모델(LLM)의 정적인 한계를 극복하기 위해 검색 방법과 딥러닝 발전을 결합하여 등장한 각광받는 방법론입니다. RAG에 대한 최신 동향을 살펴봅시다.

6.Interleaving Retrieval with Chain-of-Thought for Knowledge-Intensive Multi-Step Questions (2023)

사용자 질의를 분석해서 중간중간 검색을 덧붙이는 흥미로운 Prompt Retriever 방법론을 가져왔습니다! 바로 IRCoT라고 하는데요, 깊게 알아보시죠!

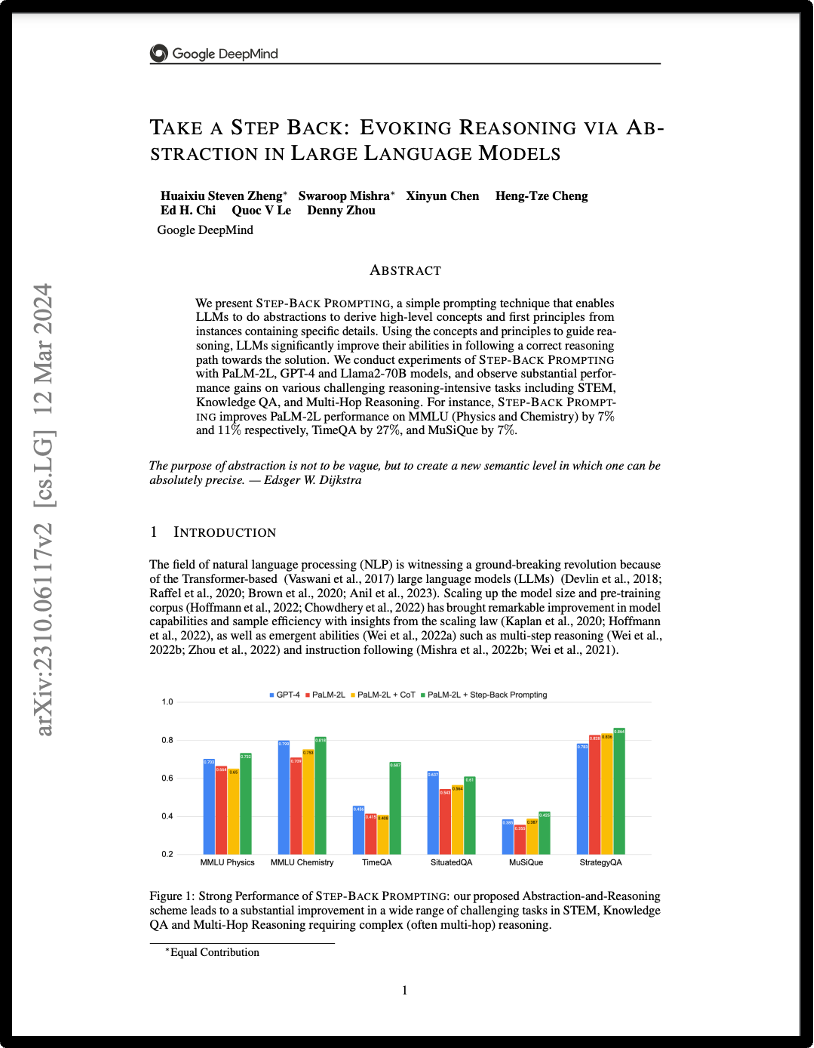

7.Take a Step Back: Evoking Reasoning via Abstraction in Large Language Models (2024)

특정한 세부 사항을 포함한 사례로부터 고수준 개념과 기본 원칙을 도출하기 위해 대규모 언어 모델(LLM)이 추상화를 수행할 수 있도록 하는 간단한 프롬프트 기법인 Step-Back을 알아봅시다!