NLP

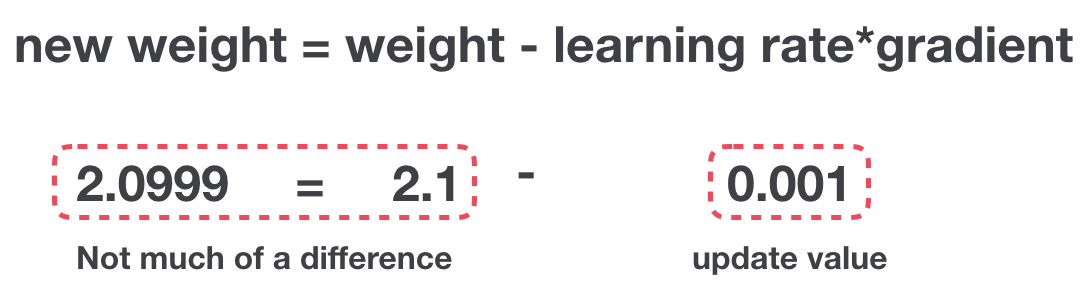

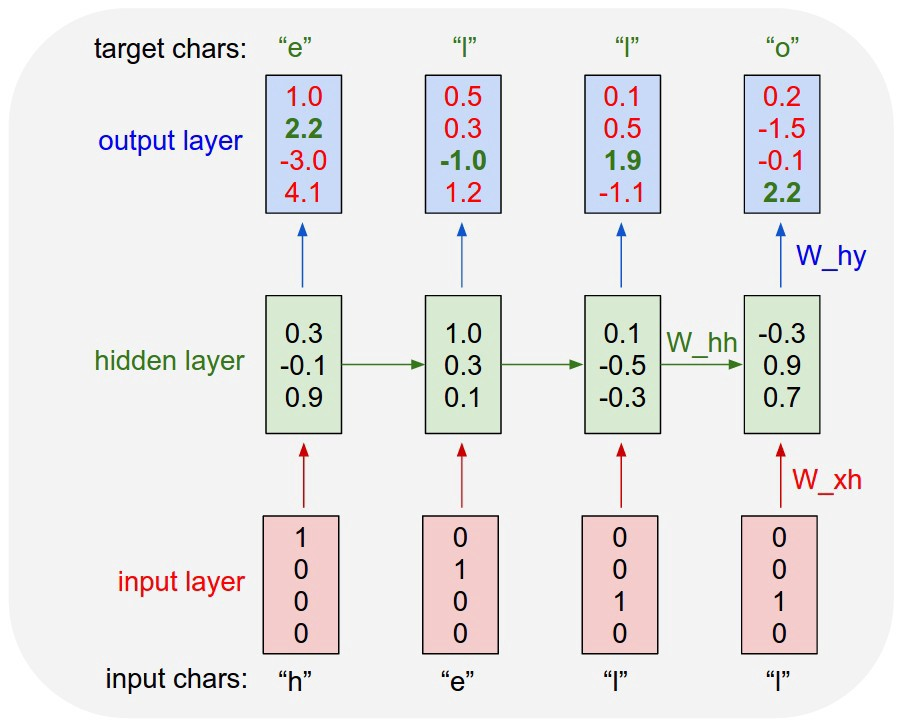

1.[DL] Recurrent Neural Networks (순환 신경망)

이번 포스팅은 RNN의 아주 기초적인 부분에 대해 공부해보려고 합니다.🚀 앞으로 NLP 분야를 공부할 예정이니 기본기를 탄탄하게 쌓는 포스팅이 되면 좋겠군요!해당 포스팅은 Reference에 있는 일러스트로 설명하는 RNN 포스팅을 바탕으로 번역하여 정리했음을 밝힙니

2.[DL] Long Short-Term Memory(LSTM) and GRU

이번 포스팅은 LSTM의 아주 기초적인 부분에 대해 공부해보려고 합니다.🚀 앞으로 NLP 분야를 공부할 예정이니 기본기를 탄탄하게 쌓는 포스팅이 되면 좋겠군요!해당 포스팅은 Reference에 있는 일러스트로 설명하는 LSTM 포스팅을 바탕으로 번역하여 정리했음을 밝

3.[DL] Recurrent Neural Networks and LSTM

이번 포스팅은 RNN과 LSTM에 대해 공부하고 정리하려고 합니다.🚀 이전에 RNN과 LSTM에 대해 따로 정리한 자료가 있습니다. 해당 자료는 일러스트를 이용해서 정리한 자료이니 필요하신 분은 참고하세요. 🔗 [Recurrent Neural Networks

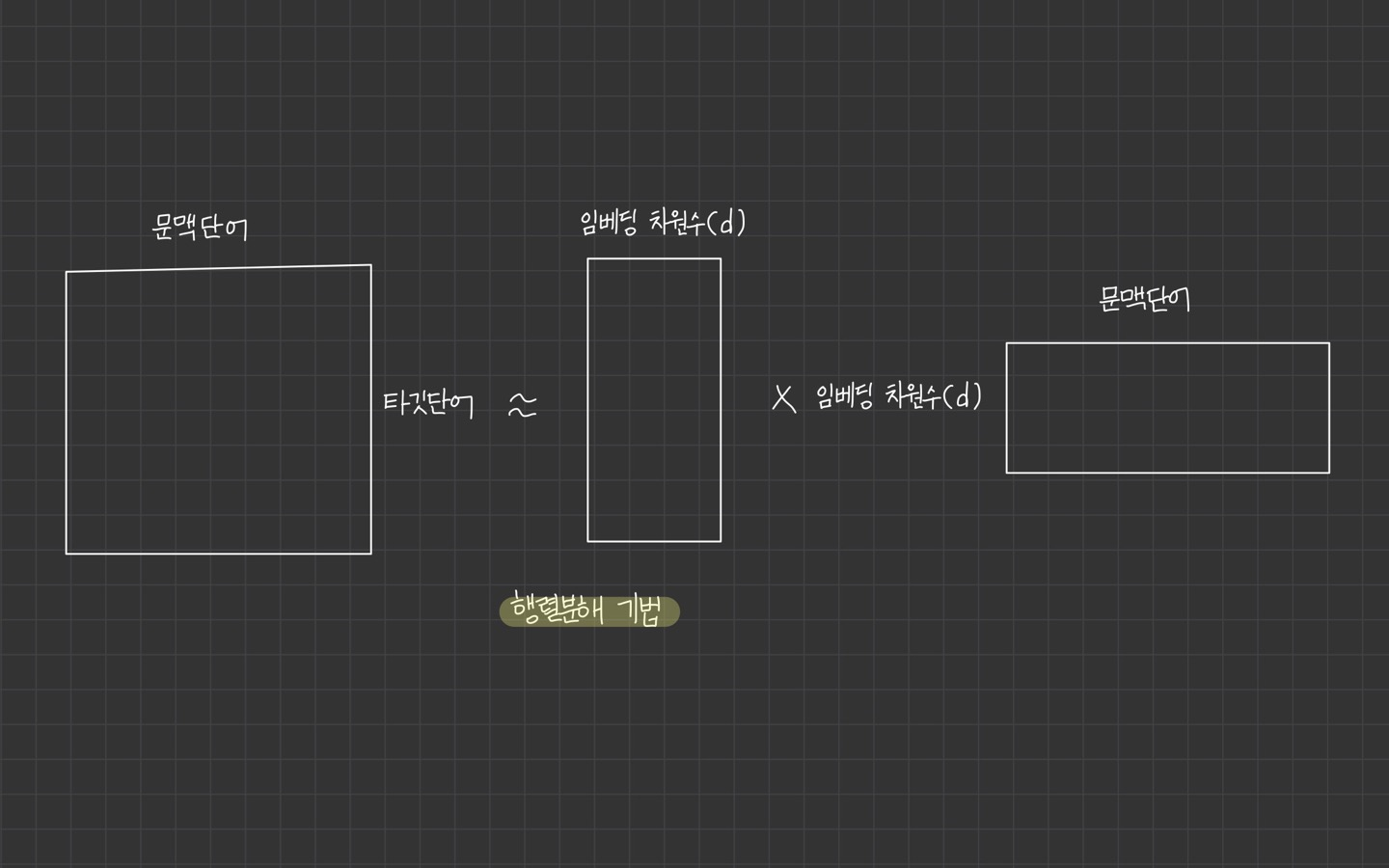

4.[NLP] 임베딩(Imbedding)

해당 포스팅은 이기창님의 📒 '한국어 임베딩' 책을 바탕으로 개념을 정리합니다.따라서 책에서 정의 내리고 쓰는 용어가 기준이므로 기존 용어와 살짝 다른 부분이 있을 수도 있습니다. (없을 것 같긴 하지만요)이기창님의 관련 자료한국어 임베딩 튜토리얼한국어 임베딩 깃헙

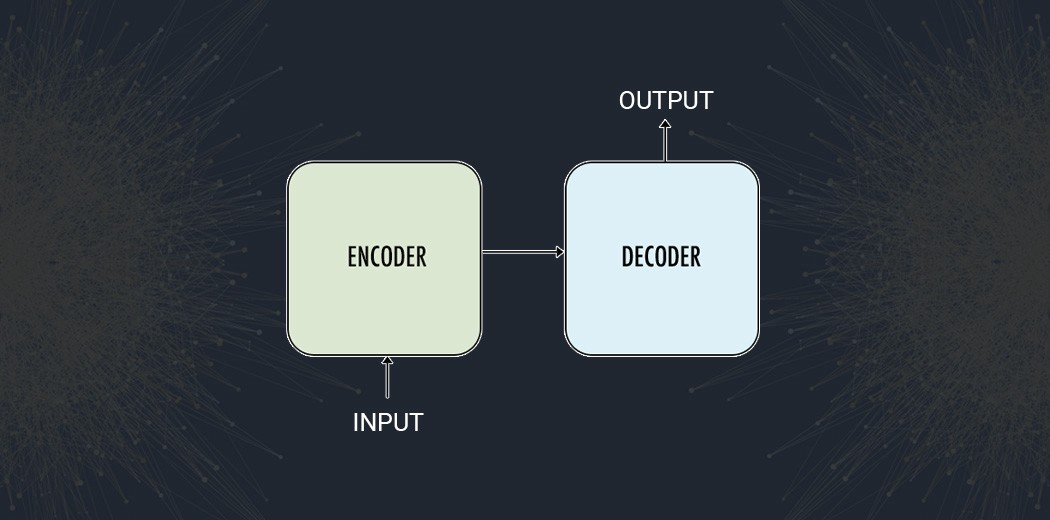

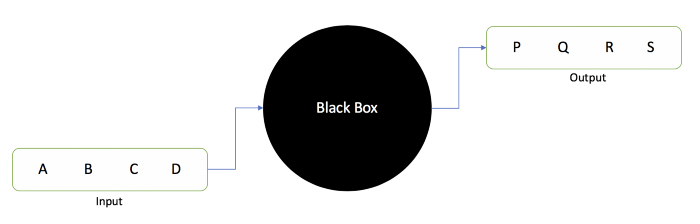

5.[DL] Sequence to Sequence model

📄 A Simple Introduction to Sequence to Sequence ModelsSeq to Seq를 공부하다가 Architecture에 대한 이해가 잘 되지 않아, 해당 포스팅을 찾았고 이를 바탕으로 공부하고 정리합니다.내용에 오류가 있는 경우 댓글

6.[DL] Attention - Seq2Seq Models

📄 Attention - Seq2Seq Modelsseq2seq with Attention을 이해하기 위해 포스팅합니다. 위 reference를 바탕으로 내용을 이해하고 정리하였습니다.재생산되는 제 내용 중 오류가 있을 수 있습니다. 그럴 경우 댓글로 알려주시면 감사