kmooc

1.[KMooc] 머신러닝 개념

강의실습으로 배우는 머신러닝 링크$$y=h\*x0+h∗x1+h∗x2+h∗x3+...+h∗xn$$loss functionloss function 을 최소화 시키는 h를 찾는것이다. loss function 는 2차함수이기 때문에 미분해서 미분값이 0인곳을 찾으면 보통 최

2.[KMooc] 모델 복잡도

Classification : 범주형을 예측이미지분류, 텍스트 분류 등Regression : 연속형을 예측주식, 날씨, 온도, 센서값 등참고하이퍼파라메터란 링크파라메터와 하이퍼파라메터 링크머신러닝에서 하이퍼파라미터는 최적의 훈련 모델을 구현하기 위해 모델에 설정하는 변

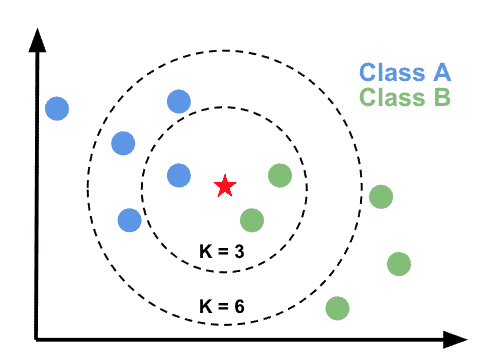

3.[KMooc] Classification - KNN

제품이 불량인지 아닌지고객이 이탈고객인지 잔류 고객인지카드 거래가 정상인지 사기인지최근접 이웃법 새로운 데이터를 입력 받았을 때 가장 가까이 있는 것이 무엇이냐를 중심으로 새로운 데이터의 종류를 정해주는 알고리즘이다.여기서 K 는 이웃의 숫자다. 보편적으로 K 값은 홀

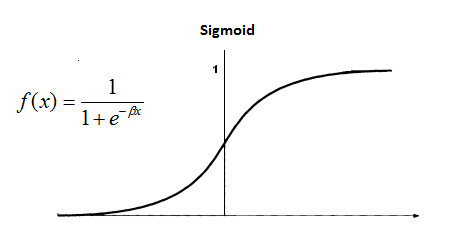

4.[KMooc] Classification - Logistic Regression

참고로지스틱 회귀와 시그모이드 함수 링크로지스틱회귀 링크로지스틱 회귀 위키백과 링크Logistic Regression(로지스틱 회귀)이란?로지스틱 회귀는 독립 변수의 선형 결합을 이용하여 사건의 발생 가능성을 예측하는 데 사용되는 통계 기법이다.로지스틱 회귀의 목적은

5.[KMooc] Optimization (최적화)방법

머신러닝 모델은 Loss 함수를 정의하고 그 Loss함수를 최적화하게끔 만드는 것이 목적이다. Loss는 y(실제값)와 y^(예측값)의 차이를 어떻게 정의하는가(measure하는가), 여기에는 여러 종류가 있다.Mean Squared Error LossCross Ent

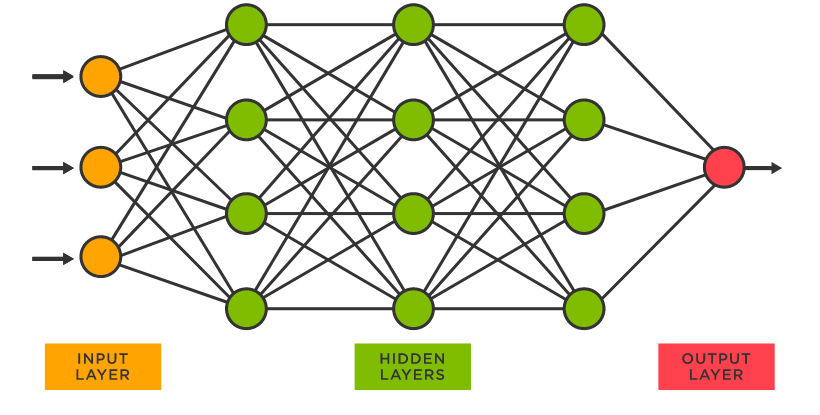

6.[Kmook] 딥러닝 - Neural Network

Neural Network 는 perceptron 으로 구성되어 있고, percepton 은 linear regression, rogistic regression 과 연관이 있다. $$sigmoid = \\frac{1}{1 + e^(-x)}$$Logistic Regre