Paper Review

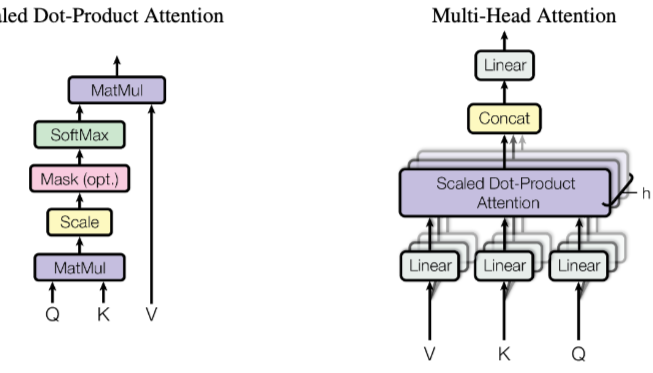

1.Attention Is All You Need

Attention Is All You Need Paper Review 다양한 논문들이 있었지만 해당 논문만큼 제목을 공격적으로 작성한 논문이 없다고 생각한다. 얼마나 자신이 있으면 이렇게 작성했을지.. 하지만 현재, 가장 인공지능의 기술을 끌어 올린 다양한 요인 중 하

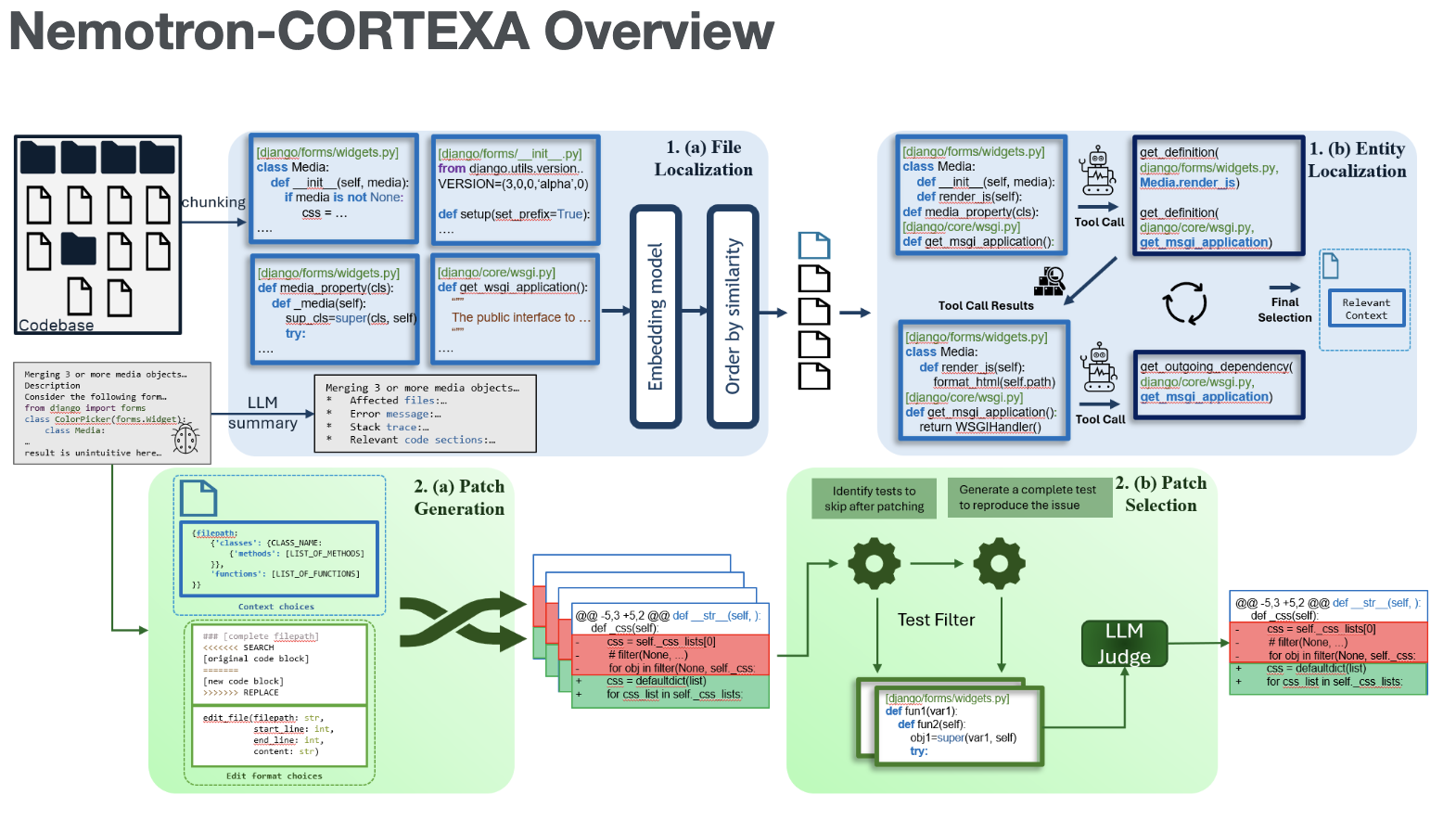

2.Nemotron-CORTEXA: Enhancing LLM Agents for Software Engineering Tasks via Improved Localization and Solution Diversity Paper Review

이번에 리뷰할 논문은 Nemotron-CORTEXA: Enhancing LLM Agents for Software Engineering Tasks via Improved Localization and Solution Diversity 입니다. 해당 논문은 LLM의 발

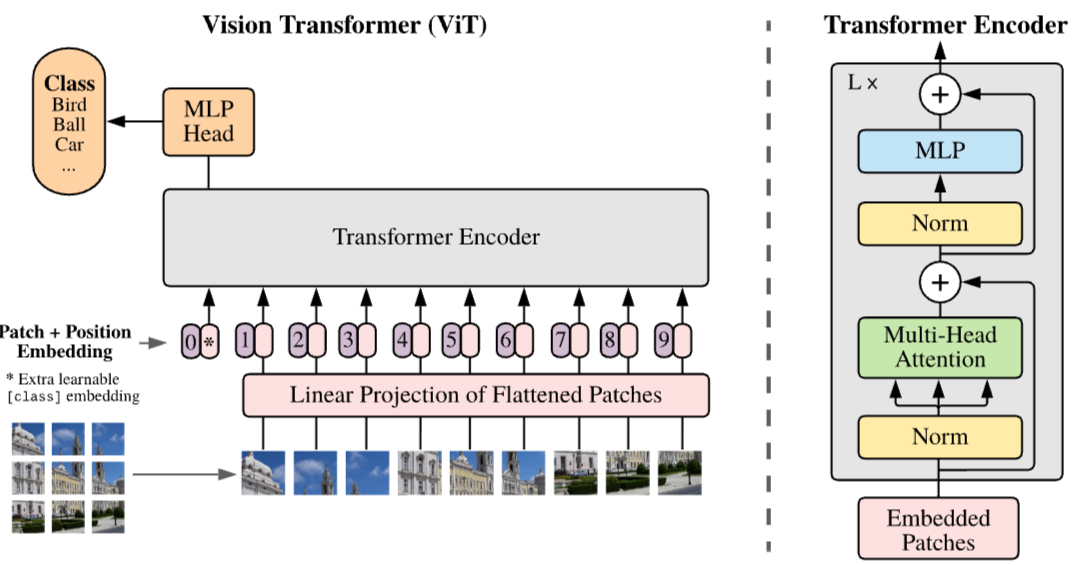

3.AN IMAGE IS WORTH 16X16 WORDS: TRANSFORMERS FOR IMAGE RECOGNITION AT SCALE

이번에 리뷰할 논문은 'AN IMAGE IS WORTH 16X16 WORDS: TRANSFORMERS FOR IMAGE RECOGNITION AT SCALE'입니다. 해당 논문은 너무나도 유명한 ViT에 대한 논문으로 기존의 Transformer가 NLP 분야에서 엄

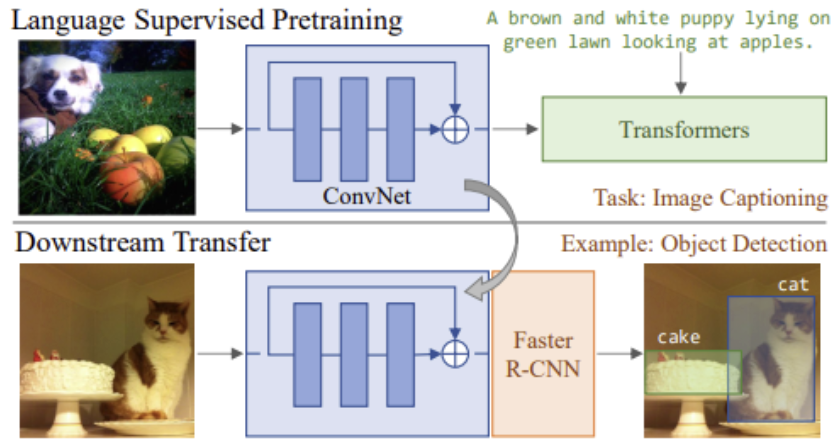

4.Learning Transferable Visual Models From Natural Language Supervision

이번에 리뷰하고자 하는 paper는 바로 'Learning Transferable Visual Models From Natural Language Supervision' 이라는 논문입니다. 본 논문은 너무나도 잘 알려져 있는 'CLIP'라고도 불립니다. 해당 CLIP의

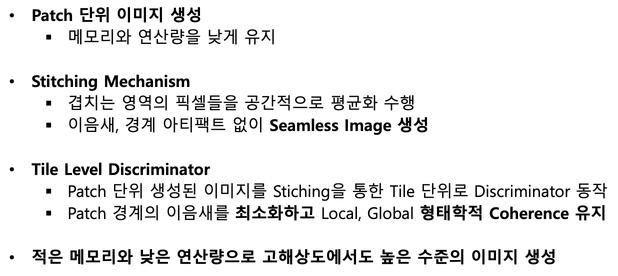

5.SAFRON: Stitching Across the Frontier Network for Generating Colorectal Cancer Histology Images

이번에 리뷰하고자 하는 논문은 SAFRON: Stitching Across the Frontier Network for Generating Colorectal Cancer Histology Images 입니다. 해당 논문은 GAN을 통해서 Histology image

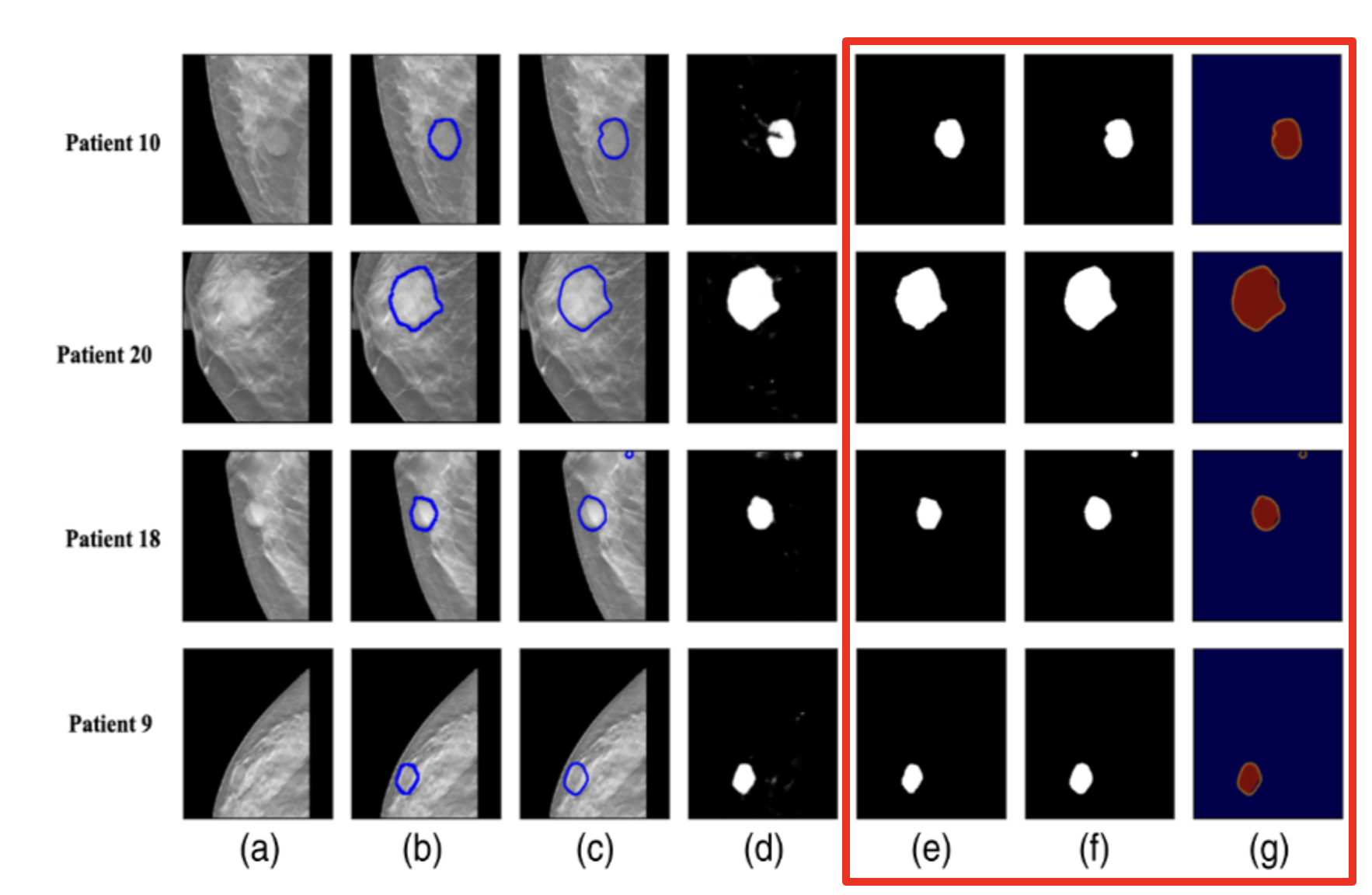

6. AMS-U-Net: automatic mass segmentation in digital breast tomosynthesis via U-Net

이번에 리뷰하고자 하는 논문은 바로 ' AMS-U-Net: automatic mass segmentation in digital breast tomosynthesis via U-Net'이라는 논문입니다. 해당 논문은 U-Net을 통해서 유방암 진단에 활용한 논문입니다.

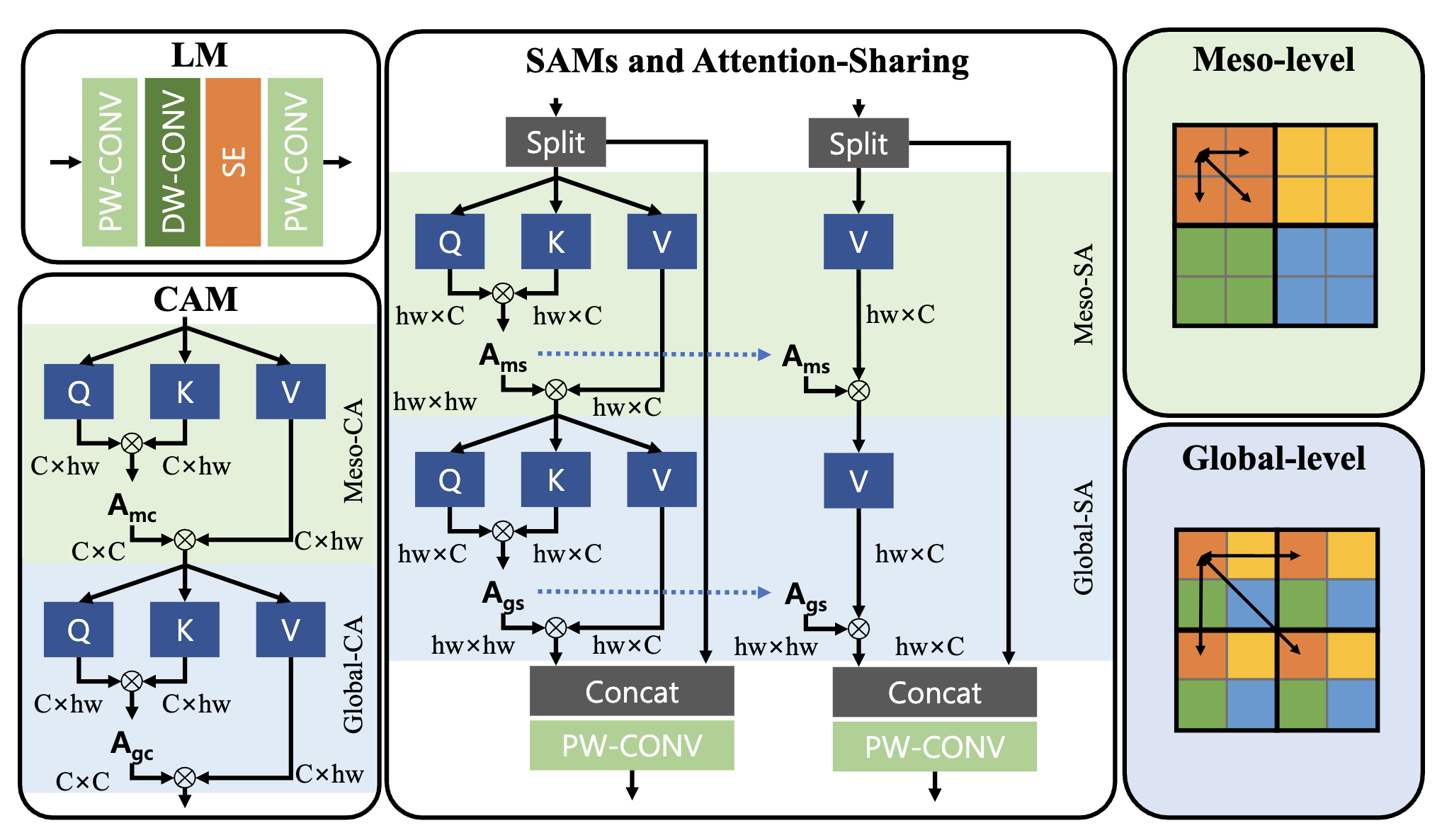

7.Efficient Attention-Sharing Information Distillation Transformer for Lightweight Single Image Super-Resolution

이번에 읽은 논문은 "Efficient Attention-Sharing Information Distillation Transformer for Lightweight Single Image Super-Resolution" 입니다. 3D Image 및 SR Image를

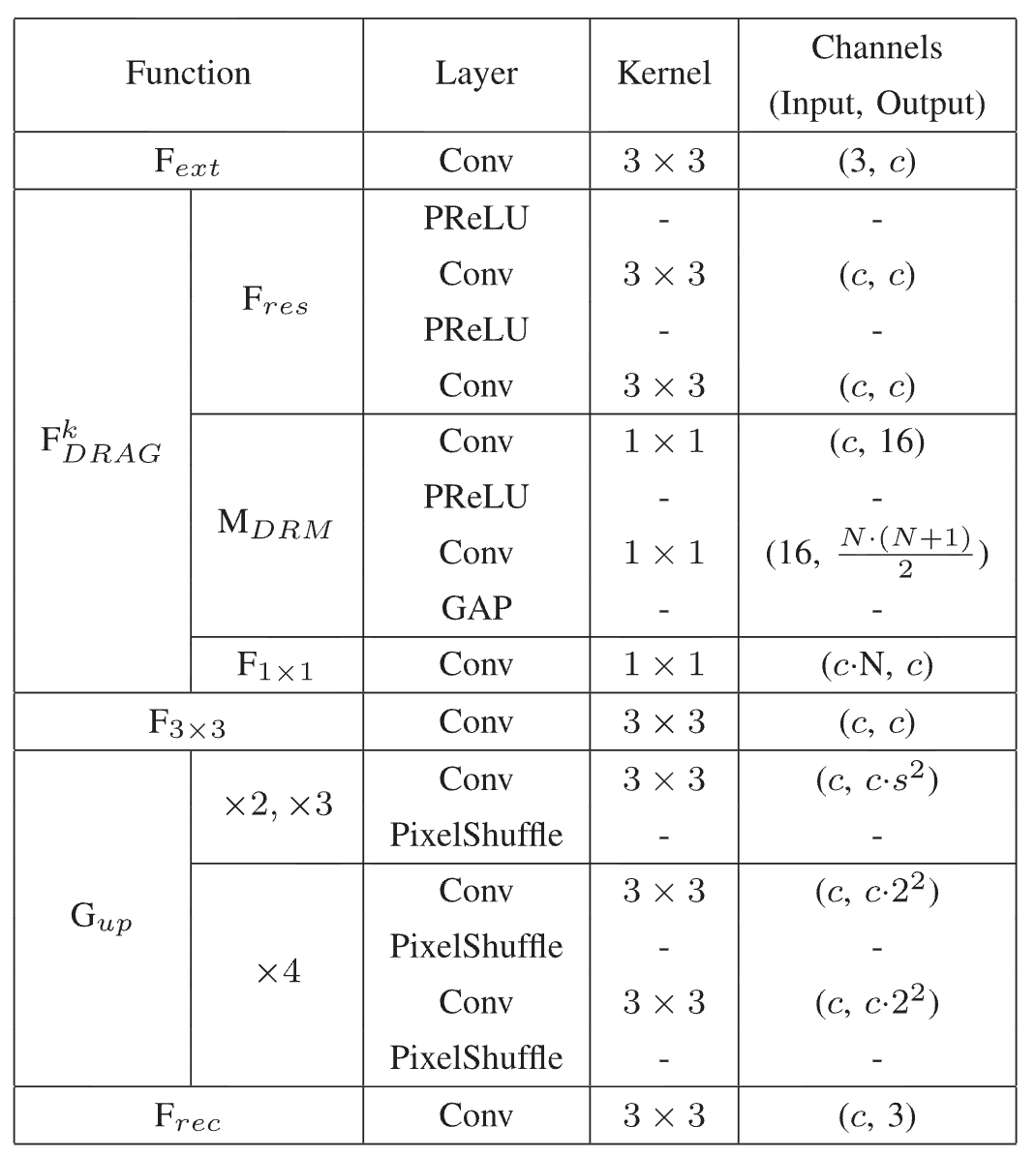

8.A Dynamic Residual Self-Attention Network for Lightweight Single Image Super-Resolution

이번에 리뷰할 논문은 바로 "A Dynamic Residual Self-Attention Network for Lightweight Single Image Super-Resolution" 입니다. 해당 논문을 읽기 이전에 몇 가지 초점을 세워두고 논문을 찾게 되었습니다