GIST에서의 첫 세미나 이후의 피드백과 이야기를 나눈 것을 급하게 적은 내용들입니다...

SSL Image Denosing with downsampling -> 전반적으로 비지도 학습으로 할 때 성능이 좋음

-

옛날 선행 연구로 noise2void

노이즈 - 불규칙, 랜덤성

시그널 - 픽셀간 관계성이 높음

노이즈를 가우시안 노이즈로 두고 했는데 가우시안이 아님 -

선행 연구로 ap-bsn -> 격자 이미지로 패치로 나눠서 서로 Correlation 없도록 해서 노이즈를 없애겠다

-

옛날 선행 연구로

-

Smartphone image denoising

-

Darmstadat noise

SSL Image Denosing with desampling Invariance loss ans Conditional Blind -> 추천!!!!!

- 로우 필터(blur kernel)로 이미지를 블러처리함 Convolution -> 시그널, 렌즈

- Interpolation 문제 있음

- 비지도로 패턴을 학습해서 생성해냄

- bicubic Downsample -> 3차 함수로 (3차원)

- bilienar -> 1차 함수

- C-BSN, PSNR

y = k*x + n

diffusion model

최근 연구 동향을 보고 싶으면 이와 같은 곳에서 참고하기 - ntire, aim 2025

rastomer, nafnet ->imgae restoration

위에서 이제 자기가 관심있는 분야 하나 정해서 주 2회 세미나를 진행하자고 하시네여..🥲(저눈 아무것도 모르는데여..) 당장 논문부터 선정하고 논문도 읽고 정리하고 구현도 하고.. 하ㅏ하하하하... 이게 GIST..? 평민은 웁니다.. 저는 그래도 SSL 분야에 대해서 관심이 있었기 때문에 해당 SSL을 활용한 분야들을 선정하였습니다..

(이게 맞는 선택일지는..)

Vision journal

CVPR

ICCV

ECCV

AI journal

neurIPS

ICML

ICCR

AAAI - 1.5티어

WACV - 1.5티어

ICASSP - 음성 1티, 비전 2티어

ICPR- 2티어

NLP journal

ACL

EMNLP

Image Restoration 및 Denoising에 활용되는 SSL 기법

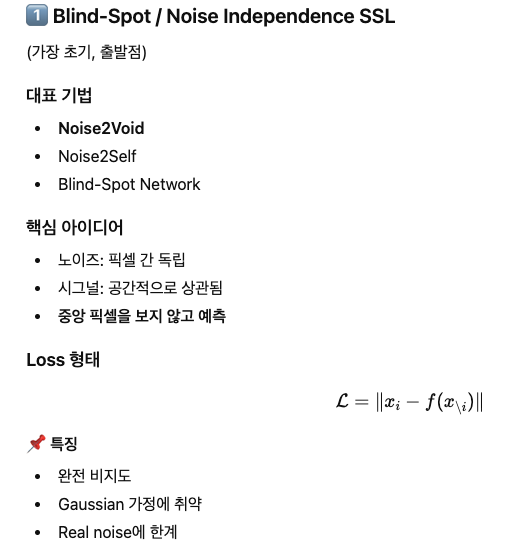

✔ Blind-Spot SSL (초기) - 가장 초기, 출발점

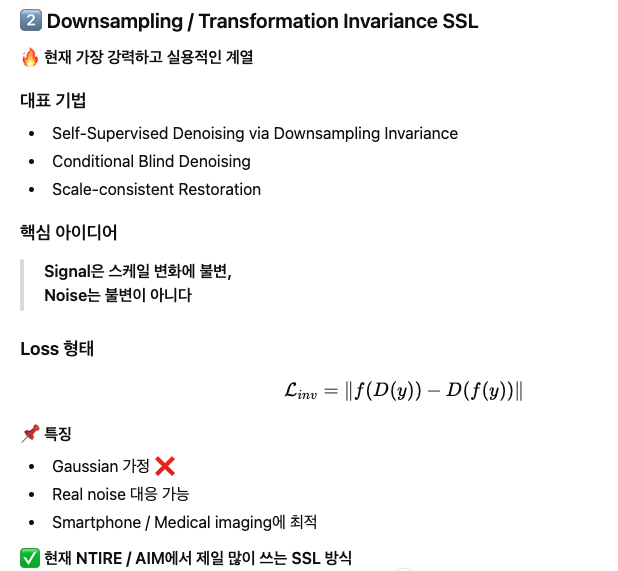

✔ Downsampling Invariance SSL (현재 주력) - 현재 가장 강력하고 실용적인 계열

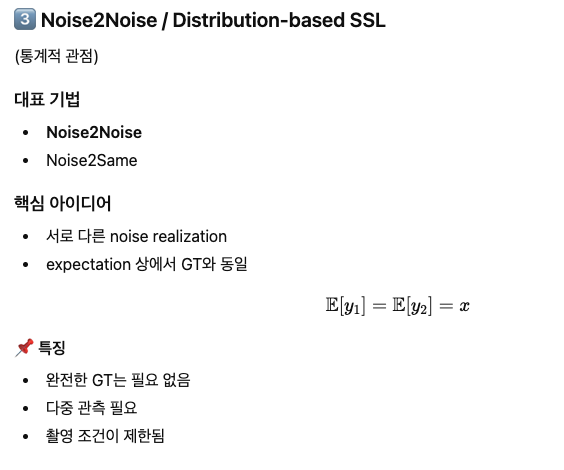

✔ Noise2Noise (조건부) - 통계적 관점

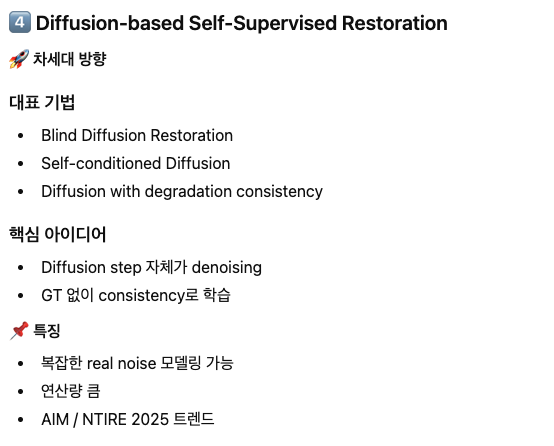

✔ Diffusion SSL (미래) - 앞으로의 트렌드

✔ Blind-Spot SSL (초기) - 가장 초기, 출발점

-

Noise2Void

-

Noise2Self

-

Blind-Spot Network

✔ Downsampling Invariance SSL (현재 주력) - 현재 가장 강력하고 실용적인 계열

-

Self-Supervised Denoising via Downsampling Invariance

-

Conditional Blind Denoising

-

Scale-consistent Restoration

✔ Noise2Noise (조건부) - 통계적 관점

-

Noise2Noise

-

Noise2Same

✔ Diffusion SSL (미래) - 앞으로의 트렌드

-

Blind Diffusion Restoration

-

Self-conditioned Diffusion

-

Diffusion with degradation consistency

SSL을 통한 Image Restoration, Denoising 로드맵

| 단계 | 논문 | 핵심 아이디어 | SSL 4대 분류 중 어디? |

|---|---|---|---|

| 1단계 (기초) | Noise2Void (CVPR 2019) | 중앙 픽셀을 가리고 주변으로 예측 (Blind-Spot 개념 창시) | ✔ Blind-Spot SSL (초기) |

| 2단계 (실전) | AP-BSN (CVPR 2022) | Pixel-shuffle로 노이즈 상관을 분산, 패치 단위 Blind-Spot | ✔ Blind-Spot SSL (확장) |

| 3단계 | Neighbor2Neighbor (CVPR 2021) | 인접 패치 간 통계적 일관성으로 SSL 디노이징 | ✔ Downsampling Invariance SSL (초기형) |

| 4단계 | Self-supervised Image Denoising with Downsampled Invariance Loss and Conditional Blind-Spot Network (ICCV 2023) | Global Invariance + Local Blind-Spot 결합 | ✔ Downsampling Invariance SSL (주력) |

| 4단계 보조 | C-BSN (ICCV 2023) | Conditional Blind-Spot으로 trivial solution 방지 | ✔ Downsampling Invariance SSL (주력) |

| 5단계 | LG-BPN (CVPR 2023) | Local + Global을 동시에 보는 Self-supervised Restoration | ✔ Downsampling Invariance SSL (확장) |

Noise2Void (Blind-Spot SSL)

Noise2Void는 self-supervised image denoising 연구의 출발점에 해당하는 논문으로, Blind-Spot SSL이라는 개념을 처음으로 명확히 제시하였다. 이 방법의 핵심은 입력 이미지에서 중앙 픽셀을 의도적으로 제거한 뒤, 주변 픽셀 정보만을 사용하여 해당 중앙 픽셀을 예측하도록 네트워크를 학습시키는 것이다. 이때 예측해야 할 정답은 외부에서 제공되는 ground truth가 아니라, 동일 이미지에 존재하는 원래의 중앙 픽셀 값이다. 즉, 하나의 이미지 내부에서 입력과 정답이 동시에 생성되는 구조를 갖는다.

Self-supervised learning 관점에서 보면, Noise2Void는 “가려진 픽셀을 맞추는 문제”를 Pretext Task로 정의한 사례라고 할 수 있다. 이 Pretext Task를 수행하는 과정에서 모델은 자연스럽게 이미지의 구조적 패턴을 학습하게 되며, 별도의 라벨 없이도 디노이징이라는 다운스트림 작업을 수행할 수 있다. 여기서 중요한 금지 규칙은 모델이 정답 픽셀을 입력으로 직접 보지 못하도록 강제하는 것이며, 이 제약 덕분에 네트워크는 노이즈를 그대로 복사하는 대신 주변 픽셀 간의 상관관계를 활용해 신호(signal)를 추정하게 된다. 다만 Noise2Void는 노이즈가 픽셀 간 독립적이라는 가정을 전제로 하기 때문에, 현실 세계의 복잡한 노이즈 환경에서는 한계를 드러낸다.

AP-BSN (Patch-level Blind-Spot SSL)

Noise2Void의 한계를 극복하기 위해 등장한 대표적인 후속 연구가 AP-BSN (Asymmetric Patch Blind-Spot Network)이다. 이 논문은 기존 Blind-Spot 방식이 현실 스마트폰 이미지에서 기대만큼 동작하지 않는 이유를 노이즈의 공간적 상관성에서 찾는다. 실제 스마트폰 이미지는 센서 노이즈뿐 아니라 demosaicing, ISP 후처리 등의 영향으로 인해 노이즈가 픽셀 단위가 아니라 공간적으로 뭉쳐서(correlated) 나타난다. 따라서 중앙 픽셀만 가리는 기존 Blind-Spot 방식으로는 주변 픽셀에 남아 있는 노이즈 정보를 완전히 차단할 수 없다.

AP-BSN은 이 문제를 해결하기 위해 Pixel-shuffle 기반의 패치 분할 전략을 도입한다. 인접한 픽셀들을 격자 형태로 재배열함으로써, 원래 공간적으로 가까웠던 픽셀들을 서로 떨어뜨려 배치하고, 이를 통해 노이즈의 공간적 상관관계를 인위적으로 약화시킨다. 또한 예측 대상과 입력 패치를 비대칭적으로(asymmetric) 분리함으로써, 입력 패치가 예측 대상 패치의 노이즈 정보를 직접적으로 공유하지 않도록 설계한다. 이로써 Blind-Spot 개념을 픽셀 단위에서 패치 단위로 확장하게 된다.

Self-supervised learning 관점에서 보면, AP-BSN 역시 여전히 Blind-Spot SSL 계열에 속하지만, 단순히 “보지 않는 것”에 머무르지 않고 노이즈 독립성 가정을 구조적으로 강화한 방식이라 할 수 있다. 이 접근은 real-world noise에 대해 Noise2Void보다 훨씬 안정적인 성능을 보이지만, 여전히 로컬 패치 기반 정보에 의존한다는 점에서 전역적인(global) 구조를 충분히 활용하지 못하는 한계를 갖는다.

Neighbor2Neighbor (CVPR 2021)

(Subsample Consistency 기반 Self-Supervised Denoising)

Neighbor2Neighbor는 Noise2Void나 AP-BSN처럼 특정 픽셀을 가리거나(blind-spot) 입력을 강제로 제한하는 방식이 아니라, 하나의 noisy 이미지 내부에서 서로 다른 “이웃 관측(neighboring observations)”을 만들어 self-supervision을 구성하는 접근법을 제안한다. 이 논문의 핵심 아이디어는 단순하지만 중요하다. 단일 noisy 이미지라도, 적절히 서브샘플링하면 서로 다른 노이즈를 가진 여러 관측(view)으로 해석할 수 있으며, 이들 관측 사이에는 동일한 신호(signal)가 공유된다는 점이다.

구체적으로 Neighbor2Neighbor는 입력 이미지를 여러 개의 서브샘플 이미지(subsampled images)로 분해한다. 이 서브샘플들은 서로 다른 픽셀 집합을 포함하므로, 각 서브샘플에 포함된 노이즈는 통계적으로 서로 독립에 가깝게 된다. 반면, 이들이 표현하는 underlying signal은 동일하다. 논문은 이러한 서브샘플 이미지들을 서로의 pseudo ground truth로 사용하여, 한 서브샘플로부터 다른 서브샘플을 예측하도록 학습시킨다. 이 과정에서 외부 GT는 전혀 사용되지 않으며, self-supervision은 이미지 내부의 통계적 구조로부터 생성된다.

Self-supervised learning 관점에서 보면, Neighbor2Neighbor는 Blind-Spot SSL과 Noise2Noise SSL의 중간 지점에 위치한다. Blind-Spot처럼 특정 픽셀을 “보지 말라”고 강제하지는 않지만, Noise2Noise처럼 서로 다른 노이즈 관측 쌍을 외부에서 수집하지도 않는다. 대신, 하나의 이미지로부터 다수의 noisy view를 만들어 이웃 관측 간 일관성(consistency)을 학습 신호로 사용한다. 즉, 이 논문의 Pretext Task는 “서로 다른 서브샘플 관측에서 복원된 결과는 서로 일관되어야 한다”는 조건으로 정의된다.

중요한 점은 Neighbor2Neighbor가 local statistical consistency에 기반한 SSL이라는 것이다. 이 방법은 Downsampling Invariance처럼 명시적인 스케일 불변성을 사용하지 않으며, Conditional Blind-Spot처럼 입력 정보 누수를 강하게 차단하지도 않는다. 대신, 국소적인 패치 수준에서 생성된 서로 다른 관측들이 동일한 신호를 공유한다는 가정에 의존한다. 이러한 특성 때문에 Neighbor2Neighbor는 이후 등장하는 Downsampling Invariance SSL로 넘어가기 직전 단계, 즉 local consistency 기반 SSL에서 global consistency 기반 SSL로 전환되는 과정의 중요한 연결 고리 역할을 한다.

요약하면, Neighbor2Neighbor는 “보지 마라(Blind-Spot)”라는 규칙을 직접적으로 사용하지 않고도 self-supervised denoising이 가능함을 보여주었으며, 단일 이미지 내부에서 생성된 서로 다른 noisy view들 간의 통계적 일관성을 학습 신호로 활용한 대표적인 subsample consistency 기반 SSL 방법이다. 이 논문은 이후 Downsampling Invariance, Scale-Consistent Restoration 계열 연구들이 등장하는 데 있어 개념적 발판을 제공했다.

Conditional Blind-Spot Network

AP-BSN 이후 등장한 연구들은 “어디를 가릴 것인가”라는 질문에서 벗어나, “무엇이 변하지 않아야 하는가”라는 관점으로 문제를 재정의하기 시작한다. 이 흐름을 대표하는 것이 Downsampling Invariance 기반 self-supervised denoising이다. 이 계열의 핵심 통찰은 매우 직관적이다. 신호(signal)는 스케일이 바뀌어도 유지되는 반면, 노이즈(noise)는 스케일 변화에 민감하게 달라진다는 것이다.

이를 학습 신호로 활용하기 위해, 동일한 입력 이미지에 대해 원본 경로와 다운샘플 경로를 동시에 고려하고, 두 경로를 통해 얻은 복원 결과가 서로 일관되도록 강제한다. 즉, 모델의 출력이 다운샘플링 연산 전후에 관계없이 동일한 구조를 유지해야 한다는 Invariance 제약을 학습 목표로 삼는다. 이 접근에서는 더 이상 특정 픽셀을 “보지 말라”고 강제하지 않는다. 대신, 서로 다른 변환 경로를 거친 결과들이 같아야 한다는 조건을 통해 self-supervision을 제공한다.

이 단계에서 self-supervised denoising은 더 이상 순수한 local blind-spot 문제로 취급되지 않으며, 이미지 전체 구조를 활용하는 global consistency 문제로 확장된다. 이 관점 전환은 이후 등장하는 거의 모든 최신 self-supervised restoration 기법의 핵심 토대가 된다.

Downsampling Invariance만을 사용할 경우, 모델이 trivial solution에 빠질 위험이 존재한다. 예를 들어, 입력을 그대로 복사하거나 과도하게 평활화된 결과를 출력하더라도 invariance 조건을 만족시킬 수 있기 때문이다. 이를 방지하기 위해 등장한 것이 Self-supervised Image Denoising with Downsampled Invariance Loss and Conditional Blind-Spot Network와 C-BSN 계열의 연구들이다.

이 단계의 핵심은 Global Invariance를 주된 학습 신호로 사용하되, Local Blind-Spot을 보조 제약으로 결합하는 것이다. Downsampling invariance는 전체 구조의 일관성을 책임지고, Conditional Blind-Spot은 로컬 영역에서 발생할 수 있는 노이즈 누수와 정보 복사를 차단하는 역할을 한다. 이로써 Blind-Spot은 더 이상 주연이 아니라, 학습을 안정화하기 위한 안전벨트로 기능하게 된다.

Self-supervised learning 관점에서 보면, 이 단계는 단일 SSL 기법이 아니라 Hybrid SSL에 해당한다. Invariance 기반 consistency learning과 Blind-Spot 기반 masking이 결합되며, 실제 환경에서의 안정성과 성능을 동시에 확보한다. 현재 실전에서 가장 많이 활용되는 SSL 디노이징 구조가 바로 이 형태이다.

LG-BPN, Scale-Consistent Restoration (Denoising → Image Restoration)

마지막 단계에서는 self-supervised denoising이 Image Restoration 전반으로 확장된다. 대표적으로 LG-BPN이나 Scale-Consistent Restoration 계열 연구들은 스케일 불변성 개념을 디노이징에 국한하지 않고, 디블러링, 초해상도(super-resolution) 등 다양한 복원 문제로 일반화한다. 이들 방법은 여러 스케일에서 복원된 결과들이 서로 일관성을 유지해야 한다는 조건을 통해, 특정 노이즈 모델이나 열화 모델에 의존하지 않는 self-supervised 학습을 가능하게 한다.

이 단계에서 Blind-Spot은 국소적 안정성을 보장하는 보조 장치로 남아 있고, Invariance는 전체 시스템을 구동하는 핵심 엔진이 된다. 이러한 접근은 스마트폰 이미지나 의료 영상처럼 복잡한 real-world degradation 환경에서 특히 강력한 성능을 보이며, 현재 self-supervised image restoration 분야의 사실상 표준적인 방향으로 자리 잡고 있다.

죽이 되는 뭐가 되든 시간이 지나 이 모든 것들을 헤치우고 자유로울 수 있는 날이 오겠죠..?