Visual Instruction Tuning

Abstract

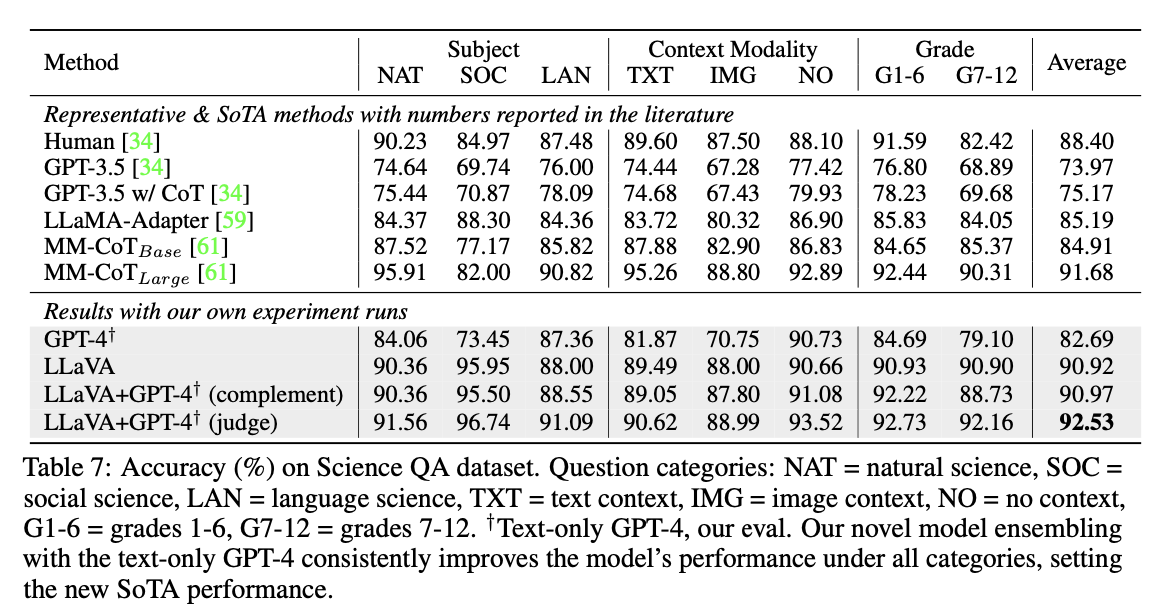

지시 학습 LLM은 새로운 테스크에 대한 zero-shot 능력이 입증되고 있으나 멀티모달에서는 덜 탐구되었다. 해당 페이퍼에서는 처음으로 GPT-4모델을 이용해 멀티모달 introduction-follwing 생성을 이용한다. 지시 학습에 의해 생성된 데이터에 따라 end-to-end로 학습된 비젼 인코더부터 LLM까지 LLaVA를 제시한다. 시각적 지시 연구에 용이성을 위해 다양성과 특정 목적을 목표로 하는 두 개의 벤치마크를 구성한다. LLAVA는 멀티모달 능력에 대해 입증하며 때로 본 적 없는 이미지와 지시에 대해서도 잘 수행한다. 그리고 합성 멀티모달 데이터 셋에 대하여 85.1%의 relative score를 보인다. QA에 대해 튜닝할 경우 LLAVA와 GPT-4의 시너지는 92.53%까지 도달한다.

Introduction

사람은 시각적 언어적 등 다양한 정보를 통해 살아가며, 각각의 정보는 어떠한 것을 이해할 때 유리하게 작용합니다. 그리고 이를 통해 더 많은 이해를 기반할 수 있습니다. 인공지능의 핵심 목표 중 하나는 멀티모달 지시를 훌륭히 수행할 수 있는 보조를 개발하는 것입니다. 이를 위해 언어와 비젼 모델의 결합 연구가 수행되어지고 있습니다. 이전 비젼 모델에서는 모델 구조에 따라 각각의 테스크만을 수행할 수 있었습니다. 또한 이전 언어 모델은 이미지를 설명하는데만 이용되어졌고, 지시 학습에 적응하지 못하는 제한된 기능만을 지녔습니다.

반면, LLM은 더 넓은 역할을 수행합니다. 풀고자 하는 목표에 따라 아웃풋을 다르게 변경할 수 있으며 다양한 테스크 지시 또한 받아들입니다. 예시로, ChatGPT와 GPT-4는 인간의 지시에 따르는 LLM의 성공을 보여주었습니다. LLM중 LLaMA는 GPT-3와 연결되었으며 Alpaca, Vicuna, GPT-4-LLM은 다양한 높은 퀄리티의 지시 학습 샘플을 생성하기 위해 활용되어졌습니다.

해당 연구에서가 visual instruction-tuning을 언어 이미지 영역으로 확장시키기 위한 첫 시도이다.

Multimodal instruction-following data

시각-언어 지시 학습 데이터의 부족이 첫 번째 문제점이다. 데이터 재구성에 대한 것과 image-text 쌍을 지시 학습 형식으로 chatgpt&gpt4를 이용해서 바꾸는 파이프라인을 보인다.

Large multimodal models

LMM을 CLIP과 Vicuna를 연결하고 생성한 지시학습 데이터로 end-to-end 학습을 하여 제시한다. 주된 실험은 LLM에 성능에 생성된 데이터의 효과를 입증하는 것과 지시에 따르는 visual agent를 만드는 실용적인 팁이다.

Multimodal instruction-following benchmark

지시 학습과 관련된 디테일한 어노테이션이 있는 두 개의 벤치마크 LLaVA-Bench를 제시한다.

Related Work

기존의 컴퓨터 비전 기반 멀티모달 에이전트는 크게 두 가지로 나뉘는데, 첫째는 특정 작업에 대해 별도로 학습된 end-to-end 방식의 모델이며, 예를 들어 Vision-Language Navigation이나 이미지 편집에서 InstructPix2Pix와 같은 모델이 해당된다. 둘째는 LangChain이나 대형 언어 모델을 통해 다양한 모델을 연결해 사용하는 방식이며, Visual ChatGPT, X-GPT, MM-REACT, VisProg, ViperGPT 등이 있다. 이 논문은 다양한 태스크에 대해 end-to-end 방식으로 학습된 시각-언어 멀티모달 모델 개발에 초점을 맞췄다.

한편, NLP 분야에서는 LLM이 인간의 자연어 지시를 잘 따를 수 있도록 Instruction Tuning이 활발히 이루어져 왔다. GPT-3, T5, PaLM 등의 모델은 Instruction Tuning을 통해 InstructGPT, FLAN-T5, FLAN-PaLM 등으로 발전하면서 제로샷 및 퓨샷 일반화 성능이 크게 향상되었다. 이러한 성공을 바탕으로, 컴퓨터 비전에서도 이 개념을 도입하려는 시도가 이어지고 있다. Flamingo는 멀티모달 분야에서 GPT-3와 같은 전환점으로 평가되며, BLIP-2, FROMAGe, KOSMOS-1 등 다양한 LMM이 이미지-텍스트 페어를 기반으로 학습되어 왔다. 또한, PaLM-E는 embodied AI를 위한 멀티모달 모델이며, LLaMA 기반의 OpenFlamingo와 LLaMA-Adapter는 이미지 입력이 가능한 오픈소스 모델로 주목받고 있다.

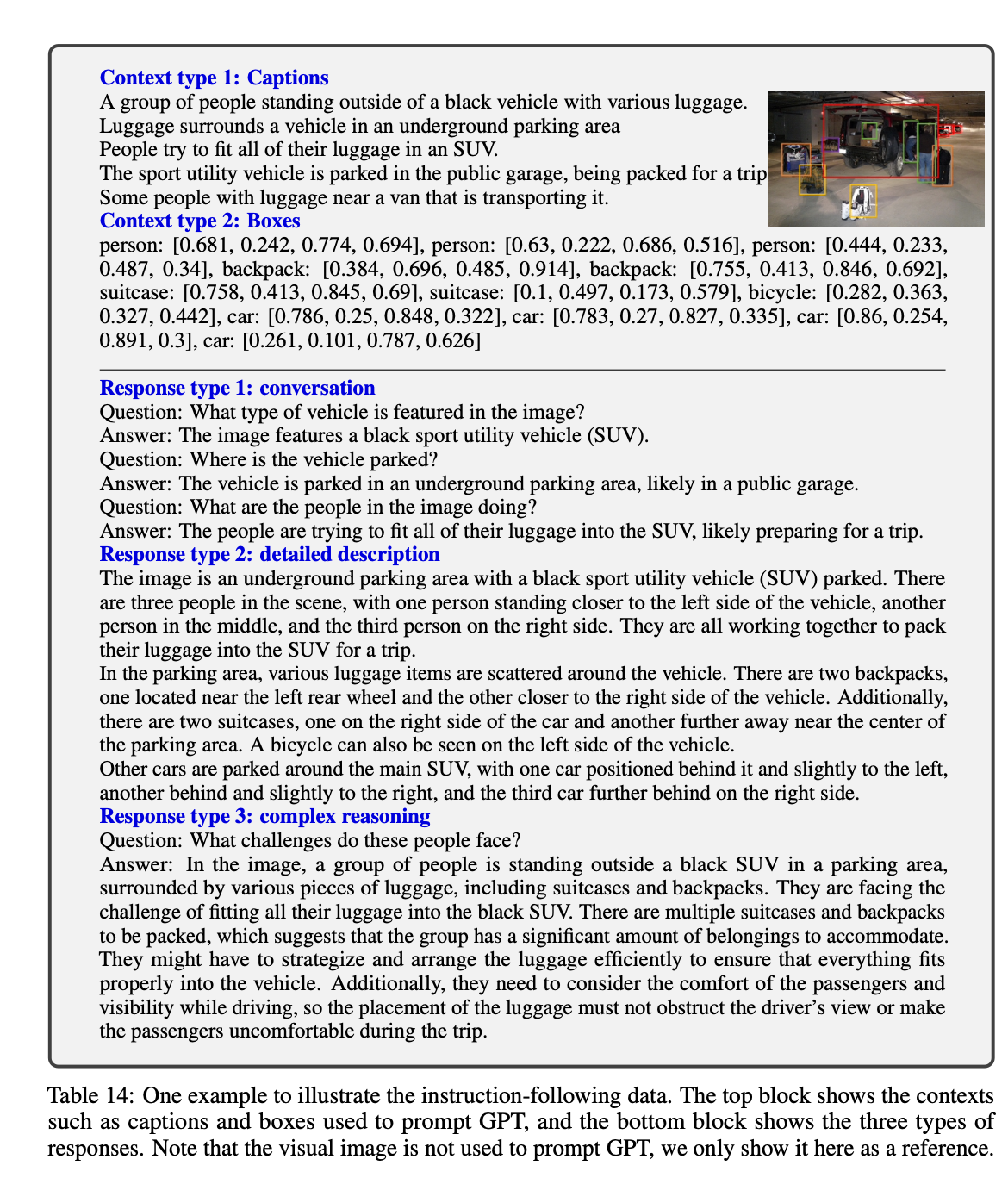

GPT-assisted Visual Instruction Data Generation

연구자들은 이미지 텍스트 쌍에 대하여 공공 멀티 모달 데이터셋들을 많이 찾았다. 그러나, 멀티모달 지시 수행 데이터는 비용이 더욱 들기 때문에 양이 제한적이다. 텍스트 어노테이션 테스크에서 GPT의 성공으로 인해 이를 멀티모달 지시 수행 데이터수집으로 이용하고자 한다. 이미지 V와 관련된 캡션 C에 대하여 질문 Q를 생성하는 것은 자연스럽다. GPT-4에 질문 리스트를 만들도록 요청한다. Human : Q V Assistant : C의 방식을 사용하는 것은 간단하다. 해당 구조의 비용 저렴하지만 다양성과 깊이에 대한 결여가 존재한다.

해당 이슈를 완화하기 위해서 language-only GPT-4 | ChatGPT를 시각 정보를 포함한 지시-수행 데이터를 만들기 위해 교사로 사용한다. 특히, 이미지를 인코딩하여 GPT에 주입하고 두개의 표현 방식을 사용한다. Caption은 일반적으로 다양한 측면에서 시각 정보를 설명하고 Bounding Boxes는 장면에서 물체의 위치를 정의하고 각각의 박스는 물체에 대한 클래스와 위치 정보를 표기한다.

심볼 표현은 이미지를 인식가능한 LLM sequence로 인코딩하게 한다. COCO이미지를 사용했으며 3가지의 지시-학습 데이터를 생성했다. 초기에는 메뉴얼로 몇가지 예시를 제작했다. 거기에는 사람의 어노테이션만 있고 GPT-4의 문맥 학습을 위한 초기 예시로 사용되었다.

Conversation

사진에 대한 질문으로 사람과 조수가 질문하고 응답하는 형식으로 구성한다. 답변은 AI가 이미지를 보고 질문에 응단하는 톤이다. 오브젝트 타입, 갯수, 위치 등과 같은 정보에 대해 질문하는 다양한 셋이 존재한다.

Detailed Description

이미지에 대한 많은 이해와 정보를 담기 위해, 질문 목록을 만든다. GPT-4에 주입하고 선택하는 과정을 거친다. 각각의 이미지는 랜덤적으로 질문을 고르고 설명을 생성한다.

Complex reasoning

위 방법은 시각 정보에 집중을 하며 깊이 있는 추론을 생성한다. 각각의 답변은 단계별 추론 과정을 요한다.

우리는 총 15,8000개의 유니크한 지시-수행 데이터를 만들었고 5,8000개가 대화, 2,3000개가 자세한 설명 그리고 7,7000개가 복잡한 추론이다. 우린 ChatGPT와 GPT-4를 이용하였고 GPT-4는 계속해서 높은 품질의 데이터를 제공하는 것으로 보인다.

Visual Instruction Tuning

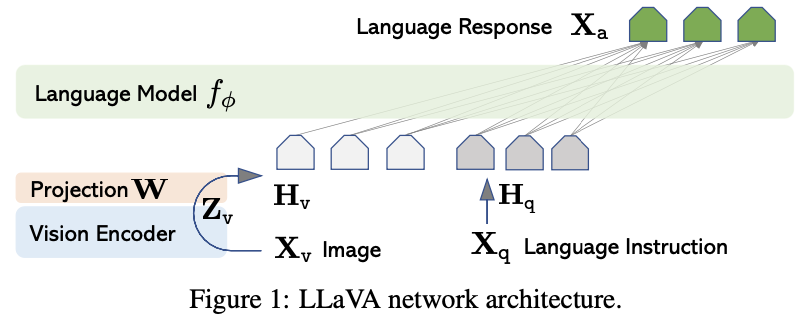

Architecture

사전 학습된 LLM과 비젼 모델을 효과적으로 이용하는 것이 주된 목표이다. Vicuna를 LLM으로 사용하였고 이는 공개된 체크포인트 중 가장 훌륭한 지시-수행 능력을 지녔다.

이미지가 주어지면 CLIP을 기반으로 인코딩을 하고 마지막 트랜스포머 레이어가 중요한 피쳐만을 선택하게 된다. 간단한 학습 가능한 하나의 선형 레이어가 이미지 피쳐를 언어 임베딩 공간으로 변환한다. 플라밍고의 크로스 어텐션이나 BLIP-2의 Q-Former와 같이 더욱 정교한 연결고리가 있을 수 있으나 이는 나중 작업으로 미뤄둔다.

Training

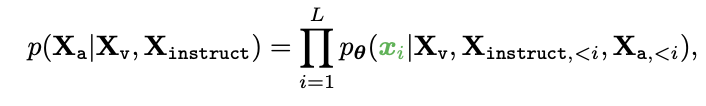

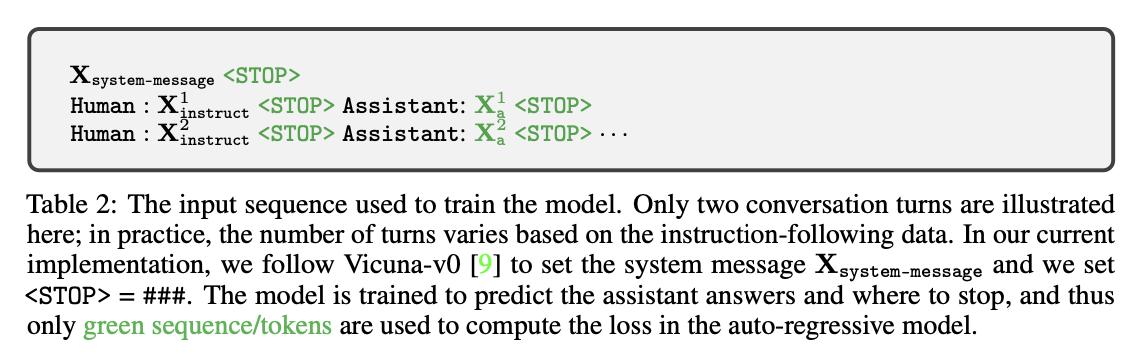

각각의 이미지는 여러개의 대화 query, anwer를 생성하게 된다. 여러개의 턴으로 구성되어지며 답변은 전부 AI의 응답으로 생각한다. 첫 번째 턴에는 질문에서 이미지가 앞에 올지 뒤에 올지를 랜덤으로 고른다. 그 다음은 앞 과정에 따라 정해진 질문을 수행한다. 이러한 구조는 멀티모달 지시-수행 시퀀스를 보여준다. LLM의 지시수행 튜닝은 다음 토큰을 생성하는 것으로 수행되며 auto-regressive하게 목적함수를 사용한다. 특히, 시퀀스의 길이에 따라 타겟 응답의 확률을 계산한다.

LLaVA 모델은 시스템 프롬프트를 사용하며 이는 Vicuna-v0을 따른다. 그리고 stop token을 "###"로 사용한다. 모델은 어디서 멈출지와 초록색으로 표시된 부분에 대하여 auto-regressive model에서의 로스를 계산하며 학습한다.

수식 3에서 해당 다음 토큰 예측을 위해서 이미지 피쳐가 기반으로 사용되고 있음을 강조한다. 모든 응답은 이미지를 기반으로 진행됨을 확인할 수 있고 수식에서는 시스템 프롬프트와 stop을 토큰을 가독성을 위해 생략했다. LLaVA모델의 학습은 두 단계의 지시-수행 과정으로 나눠진다.

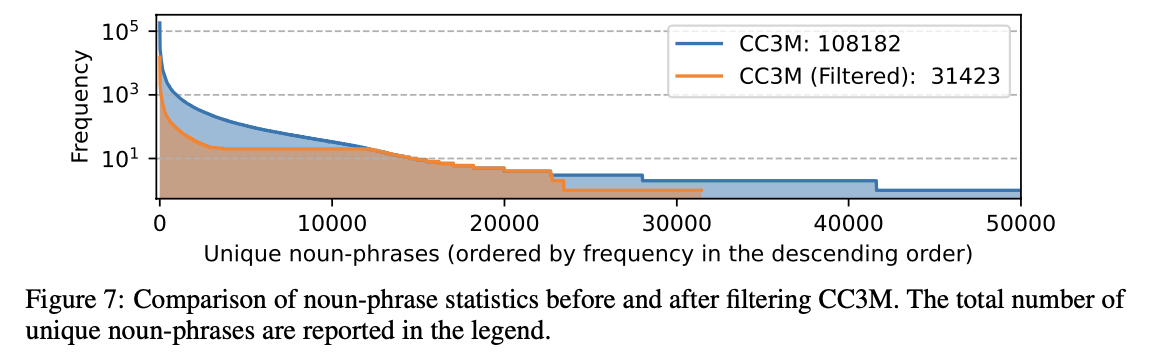

Stage-1

개념에 대한 이해와 학습 효율성 밸런스를 위해 CC3M을 필터링 하여 59,5000개 이미지 텍스트 쌍으로 만들었다. CC3M 데이터 셋에서 각각의 캡션에 대하여 명사를 추출했고 각각의 명사에 대한 빈도수를 측정했다. 3번보다 더 적은 명사의 경우 스킵했는데 이는 드문 케이스이며 이미 다른 캡션에서 커버링 되었을 것으로 본다. 그리고 적게 나온 명사 구를 포함하는 캡션부터 후보 풀에 추가한다. 명사가 100번 이상인 경우에는 캡션 중 100개만을 랜덤으로 선택한다. 이 결과가 59,5000개 가량에 해당한다.

해당 데이터는 지시-수행 데이터를 만들게 되며 이미지에 대하여 랜덤으로 질문이 선택되어지고 이미지에 대해 간략히 설명하도록 요구되어진다. 정답 예측은 질문에 대한 답변이고 원본 캡션이 된다. 학습에서 이미지 인코더와 LLM 가중치는 얼려지고 우도함수를 최대화하기 위해서 파라미터가 학습되어진다.(projection matrix) 이렇게하며 이미지 피쳐는 LLM에 대하여 잘 얼라인 될 수 있다. 따라서 해당 스테이지는 이미지 피쳐가 고정된 LLM에 잘 녹아들 수 있도록 이용되어진다.

Stage-2

이미지 인코더는 항상 고정되며 projection layer와 LLM이 학습되어진다. 두 가지 경우에 따라 경우가 다른데 Multimodal Chatbot의 경우에는 지시 준수 데이터의 15,8000개를 이용하여 튜닝한다. 3개의 응답 중 한 개는 multi-turn이며 두 개는 single-turn으로 수행된다. 이들은 균일하게 학습에서 샘플링된다. Science QA는 각각의 질문은 이미지 또는 언어 형식에서 문맥으로 제공된다. AI는 추론 과정을 언어로 내보내며 여러 choice중 하나를 고른다. 데이터는 single-turn으로 구성된다.

Experiments

LLaVA 모델의 성능은 크게 두 가지 실험 설정을 통해 평가하였다. 첫째는 멀티모달 챗봇 환경에서의 지시 수행 능력, 둘째는 ScienceQA 데이터셋을 활용한 시각적 추론 능력이다. 모든 모델은 8개의 A100 GPU를 사용하여 학습하였으며, Vicuna의 하이퍼파라미터 설정을 따랐다. 사전학습은 필터링된 CC-595K 서브셋을 사용해 1 에폭 동안 수행되었으며, 학습률은 2e-3, 배치 사이즈는 128로 설정하였다. 이후 제안한 LLaVA-Instruct-158K 데이터셋을 이용해 3 에폭 동안 파인튜닝을 진행하였고, 이때는 학습률을 2e-5, 배치 사이즈를 32로 조정하였다.

-> 사실상 튜닝의 튜닝이 맞는 표현일 것으로 보임.

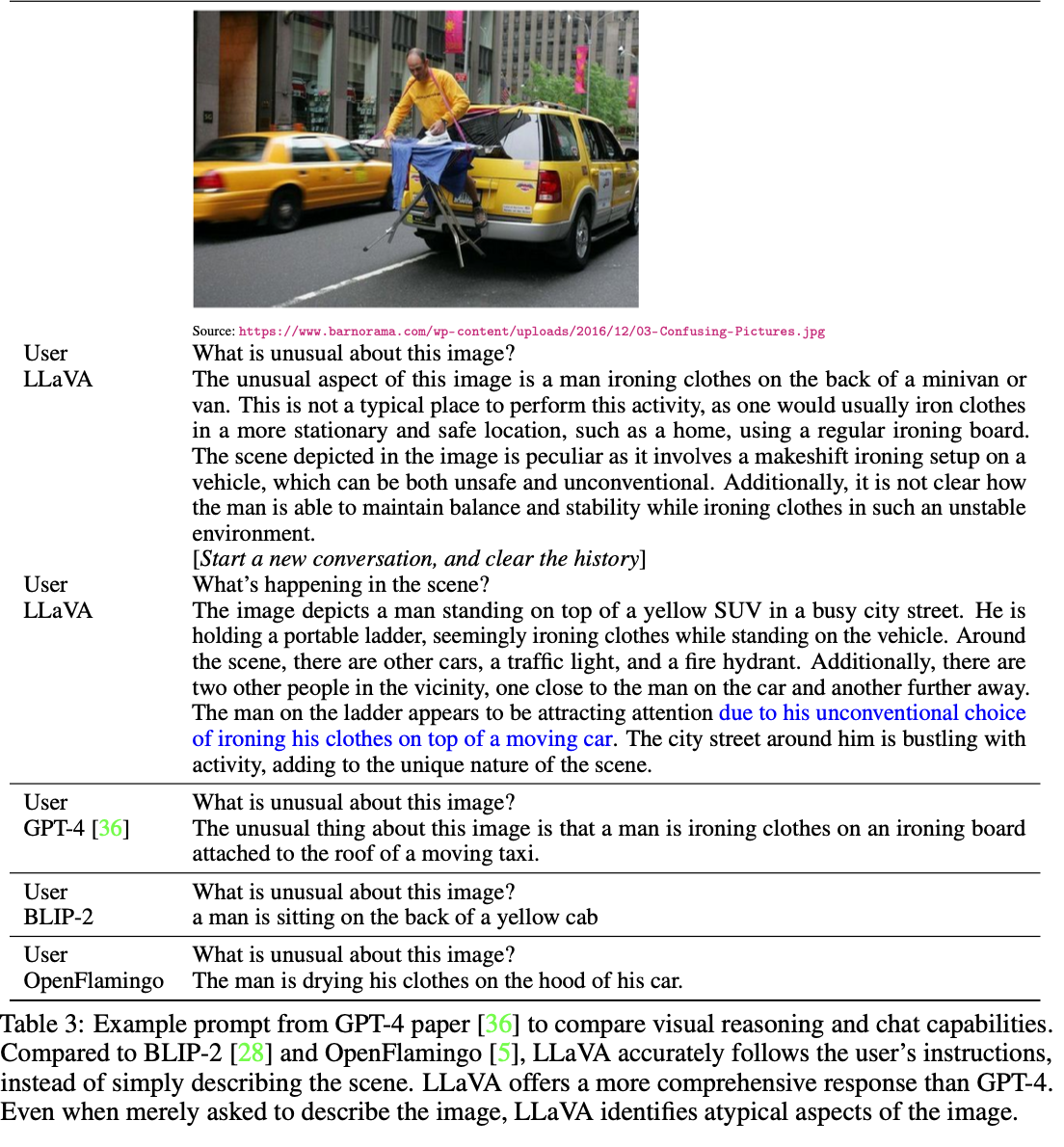

Multimodal Chatbot

LLaVA의 이미지 이해 및 대화 능력을 시연하고, 시각적 입력을 얼마나 잘 해석하며 지시를 따를 수 있는지를 분석하기 위해 챗봇 데모를 개발하였다. 이를 위해 GPT-4 원논문에 수록된 예제들을 활용하였으며, 해당 예제들은 깊이 있는 이미지 이해를 요구하는 과제로 구성되어 있다. 비교를 위해 논문에 제시된 GPT-4 멀티모달 모델의 프롬프트와 응답을 인용하고, BLIP-2 및 OpenFlamingo 모델 체크포인트에도 동일한 질의를 주어 응답을 수집하였다.

놀랍게도, LLaVA는 약 8만 장의 고유 이미지로 구성된 비교적 작은 멀티모달 지시 수행 데이터셋으로 학습되었음에도 불구하고, 해당 예제들에서 멀티모달 GPT-4와 유사한 수준의 추론 결과를 보여주었다. 특히 이 이미지들은 LLaVA에게 도메인 외(out-of-domain) 이미지임에도 불구하고, 장면을 이해하고 질문의 지시에 따라 적절한 응답을 생성하는 능력을 나타냈다. 반면, BLIP-2와 OpenFlamingo는 사용자의 지시를 따라 응답하기보다는 이미지 자체를 단순히 설명하는 데에 집중하는 경향을 보였다.

Quantitative Evaluation.

LLaVA의 성능을 체계적으로 분석하기 위해, 멀티모달 데이터 상에서 모델의 지시 수행 능력을 정량적으로 평가할 수 있는 지표를 제안하였다. [9]의 아이디어에서 영감을 받아, GPT-4를 평가자(judge)로 활용하여 생성된 응답의 품질을 측정하였다. 구체적으로는 이미지, 정답 텍스트 설명, 질문으로 구성된 트리플렛을 생성하고, 후보 모델들(LLaVA 등)은 이미지와 질문을 기반으로 답변을 생성한다. 이와 동시에, 텍스트 전용 GPT-4를 이용해 정답 텍스트 설명과 질문으로부터 이론적 상한선에 가까운 참조 응답(reference prediction)을 생성하였다.

이후 질문, 텍스트 형태로 변환된 시각 정보, 두 모델(LLaVA 및 텍스트 전용 GPT-4)의 응답을 평가자(GPT-4)에 입력하여, 응답의 유용성, 적절성, 정확성, 세부 정보 수준을 기준으로 1~10점 사이의 종합 점수를 매기게 하였다. 점수와 함께 평가에 대한 포괄적인 설명도 함께 요청하여, 각 모델의 특성을 보다 명확히 이해할 수 있도록 하였다. 최종적으로는 텍스트 전용 GPT-4 모델을 기준으로 상대적인 점수를 보고하였으며, 모델의 성능을 평가하기 위해 두 개의 벤치마크를 추가로 제작하였다.

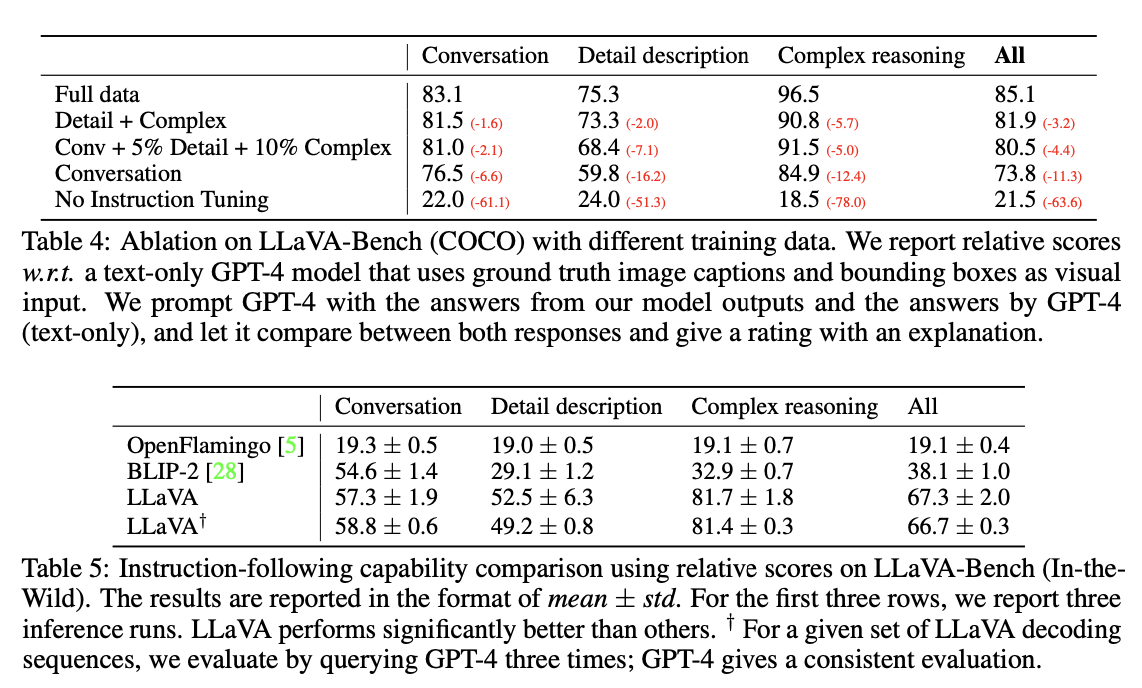

COCO-Val-2014에서 랜덤으로 30개를 선택하였고 세가지 타입의 질문을 생성하여 총 90개의 질문을 만든다. 해당 벤치마크는 모델의 행동과 능력에 대한 시각 정보 얼라인 능력을 확인한다. 다양한 학습 데이터 셋을 통해 성능을 테이블4에서 확인한다.

모델의 능력을 더 어렵고 제네럴한 도메인에서 평가하기 위해 다양한 셋의 24개 이미지와 60개의 질문을 수집하였다. LLaVA, BLIP, OpenFlamingo의 성능을 비교하였고 visual instruction tunning을 통해 LLaVA가 월등한 성능을 보였다. 정답 라벨에 접근 가능한 GPT-4와 비교해도 미치지는 못했으나 LLaVA는 훌륭한 성능을 보였다.

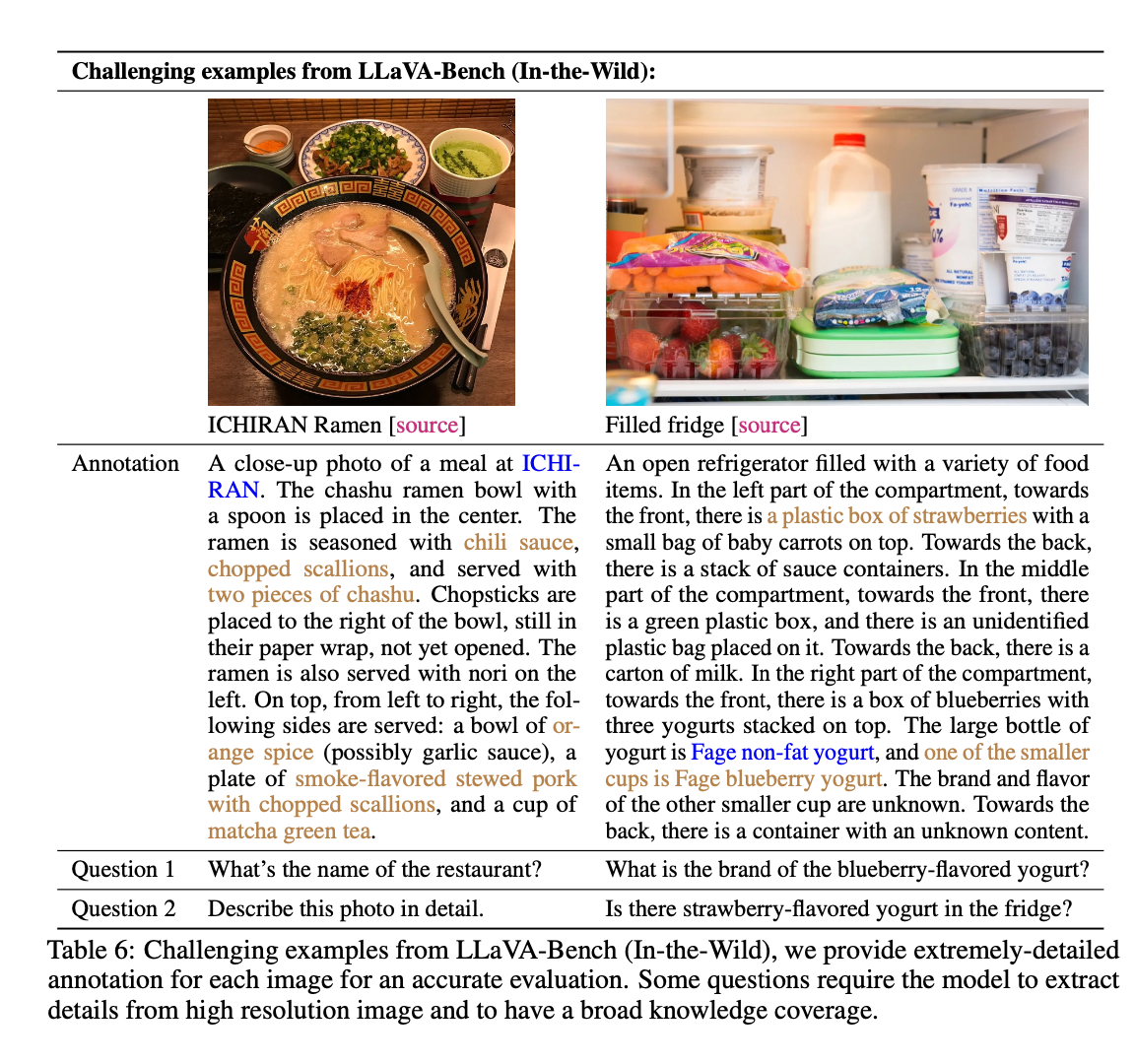

LLaVA-Bench (In-the-Wild)는 모델의 약점을 드러내고 성능을 심층적으로 분석하기 위해 설계된 도전적인 벤치마크이다. Table 6에는 해당 벤치마크의 예시로 라멘 사진과 냉장고 사진이 제시되어 있으며, 각각에 대한 캡션과 질문이 함께 제공된다. 라멘 예시에서는 식당 이름을 맞히기 위해 광범위한 지식과 다국어 이해 능력이 요구되며, 반찬을 정확히 묘사하려면 인터넷에서 관련된 멀티모달 정보를 검색하고 연관 짓는 능력이 필요하다. 냉장고 예시에서는 요구르트 브랜드를 인식하기 위해 고해상도 이미지 처리 능력과 폭넓은 지식 범위가 필요하다.

이 과정에서 흥미로운 오류 사례도 관찰되었는데, 냉장고에 딸기와 요구르트만 들어 있음에도 불구하고, 딸기 맛 요구르트가 있는지 묻는 질문에 LLaVA는 "예"라고 응답하였다. 이는 LLaVA가 이미지를 의미 단위로 종합적으로 인식하지 못하고, 패치(patch)의 집합처럼 분절적으로 해석하는 경향이 있음을 보여준다. 이러한 한계에도 불구하고, LLaVA는 본 벤치마크에서 강력한 베이스라인으로 기능하며, 본 연구의 결과가 향후 더 뛰어난 멀티모달 모델(LMMs) 개발에 영감을 주기를 기대한다.

ScienceQA

ScienceQA는 과학, 지리, 생물 등 다양한 주제를 포괄하는 멀티모달 4지선다형 질문 21,000개로 구성된 벤치마크 데이터셋으로, 3개 과목, 26개 주제, 127개 범주, 379개 스킬에 걸친 풍부한 도메인 다양성을 가진다. 데이터셋은 학습/검증/테스트 세트로 나뉘며 각각 12,726개, 4,241개, 4,241개의 예시를 포함하고 있다. 본 논문에서는 대표적인 기존 방법으로 GPT-3.5 (text-davinci-002)의 체인 오브 쏘트(CoT) 적용 유무, LLaMA-Adapter, 그리고 해당 데이터셋의 기존 최고 성능 방법인 MM-CoT을 비교 대상으로 삼았다.

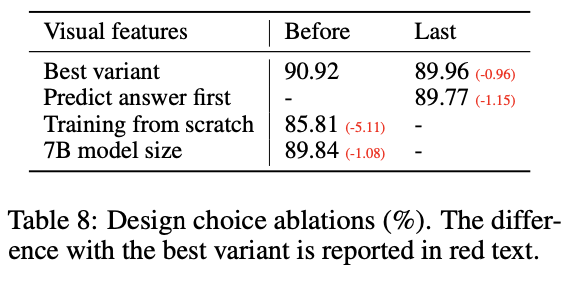

LLaVA 모델은 마지막 레이어 직전의 비주얼 피처를 사용하고, 먼저 질문에 대한 이유를 설명한 뒤 정답을 예측하도록 학습하며, 총 12 에폭 동안 훈련되었다. 그 결과 정확도는 90.92%로, SoTA인 MM-CoT의 91.68%에 매우 근접하는 성능을 보였다. 참고로 GPT-4에 대해 2-shot in-context learning을 적용한 경우 82.69%의 정확도를 얻었는데, 이는 GPT-3.5의 75.17%에 비해 7.52%p 향상된 수치이다. 그러나 많은 질문에서 GPT-4는 이미지나 도표와 같은 시각 정보가 부족하다는 이유로 정답 도출에 실패하였다.

이를 보완하기 위해 두 가지 앙상블 방식을 제안하였다. 첫 번째는 GPT-4 보완 방식으로, GPT-4가 정답을 주지 못할 경우 LLaVA의 출력을 사용하는 것이다. 이 방식은 정확도 90.97%를 기록하며 LLaVA 단독과 유사한 성능을 보였다. 두 번째는 GPT-4 심판 방식으로, GPT-4와 LLaVA가 서로 다른 답을 낼 경우, 두 출력과 질문을 함께 제공하고 GPT-4에게 최종 답을 재질문하는 방법이다. 이는 CoT와 유사하지만 다른 모델의 외부 지식을 활용한다는 점에서 차별된다. 이 방식은 모든 질문 유형에서 일관된 성능 향상을 보이며, 최종적으로 새로운 SoTA인 92.53%의 정확도를 달성하였다.

흥미롭게도 GPT-4는 이미지 입력을 처리할 수 없음에도 불구하고 이미지가 포함된 질문에서 전체 성능을 향상시켰다. 이는 일부 질문들이 실제로는 이미지 없이도 정답을 유추할 수 있기 때문이며, GPT-4가 이러한 경우를 판별하고 LLaVA의 실수를 보완한 것으로 보인다. 이는 GPT-4를 모델 앙상블에 활용한 첫 사례로, 향후 LLM을 활용한 새로운 앙상블 기법 연구에 영감을 주기를 기대한다.

ScienceQA에서 모델 디자인 선택에 따른 성능을 확인한다. CLIP에서 라스트 레이어를 제외했을 때 성능이 가장 좋았다. 아마 마지막 단의 피쳐는 이미지의 글로벌한 부분과 추상적인 정보를 더 많이 집중했을 것으로 보인다. 그 전의 피쳐는 더욱 더 지역적인 정보와 디테일한 부분을 집중했을 것으로 보인다. COT의 경우 모델 예측에서 답변과 추론과정의 순서를 결정하기 위해 응답과 추론의 순서를 바꿔가며 실험했다. 응답을 먼저 할 경우 12epoch 때 89.77%를 달성했고, 추론을 먼저할 때는 6epoch 빠르게 동일 성능에 도달했으나 이후로 24epoch까지 학습해도 성능 향상은 없었다. COT의 경우 빠르게 능력을 흡수하는데 도움이 될 수 있으나 최종 성능에는 그닥 도움이 되지 않는 것으로 결론을 내렸다. 사전 학습의 경우 scrath 부터 시작할시 성능이 5%p 가량이 떨어졌으며 모델 사이즈를 13B->7B로 줄였을 때 성능이 1%p 떨어졌다.

Conclusion

이 논문은 시각적 지시 학습(visual instruction tuning)의 효과를 실험적으로 입증하며, 이를 통해 인간의 의도를 따르는 멀티모달 모델 LLaVA를 제안한다. LLaVA는 언어-이미지 기반의 지시를 따르는 학습 데이터를 자동으로 생성하는 파이프라인을 통해 학습되었으며, 이를 바탕으로 다양한 시각적 과제를 수행할 수 있는 능력을 갖추게 되었다.

모델의 성능은 두 가지 측면에서 입증되었다. 첫째, 과학 문제 해결 벤치마크인 ScienceQA에 fine-tuning한 결과, 기존 최고 성능(State-of-the-Art, SoTA)에 근접하거나 이를 초과하는 정확도를 달성하였다. 둘째, 멀티모달 대화 데이터에 fine-tuning을 적용했을 때는 사용자의 시각적 질문에 대해 자연스럽고 논리적인 대화를 수행하는 능력을 보여주었다. 이를 통해 LLaVA는 단순히 이미지를 설명하는 것을 넘어, 질문에 맞는 적절한 응답을 생성할 수 있는 수준의 이해력과 추론 능력을 갖춘 모델임을 확인할 수 있다.

또한 본 논문은 LLaVA의 멀티모달 지시 따르기 능력을 평가하기 위해 처음으로 체계적인 벤치마크 평가 방법을 제안하였다. 이는 GPT-4를 판별자로 활용하여 모델의 응답을 정량적으로 평가하는 방식으로, 향후 다양한 멀티모달 모델의 성능을 비교하고 개선하는 데 활용될 수 있다.

이 연구는 실제 생활에서 발생할 수 있는 다양한 시각적 상황을 다룬다는 점에서 초기 단계의 연구로 평가되며, 향후 더 폭넓은 학문적 벤치마크를 포함한 후속 연구의 필요성을 강조한다. 또한, 본 연구는 멀티모달 모델의 향후 발전을 위한 기반을 마련했다는 점에서 중요한 의미를 가지며, 보다 강력한 시각-언어 모델 개발을 위한 출발점이 될 것으로 기대된다.

마지막으로, 이 연구는 LLaMA 팀 및 다양한 오픈소스 프로젝트(Alpaca, Vicuna)의 기여를 바탕으로 진행되었으며, 미국 NSF와 한국 정부(IITP, 과기정통부)의 연구비 지원을 받아 수행되었다.

🔗 관련 글