영상처리

1.영상처리 - Visual Perception

Retina(망막)빛을 Lens(수정체)에 굴절시켜 망막에 빛이 모이게 되는데, 망막의 시신경들이 빛을 받는다Fovea(중심와)빛을 제일 감지를 잘하는 곳으로, 시각세포가 많이 위치해있음Blind spot(맹점)신경다발들이 지나가는 곳이라 세포가 위치할 공간이 없어 빛

2.영상처리 - Ditial Image Reprensentation

Digital Image Representation 이미지를 어떻게 표현하는지에 대해 알아보자. Image Sensing & Acquisition 이미지는 빛감지 센서로 빛을 감지해서 이 정도(Intensity)를 신호로 나타낸다. ISP(Image Signal Pr

3.영상처리 - Intensity Transformations

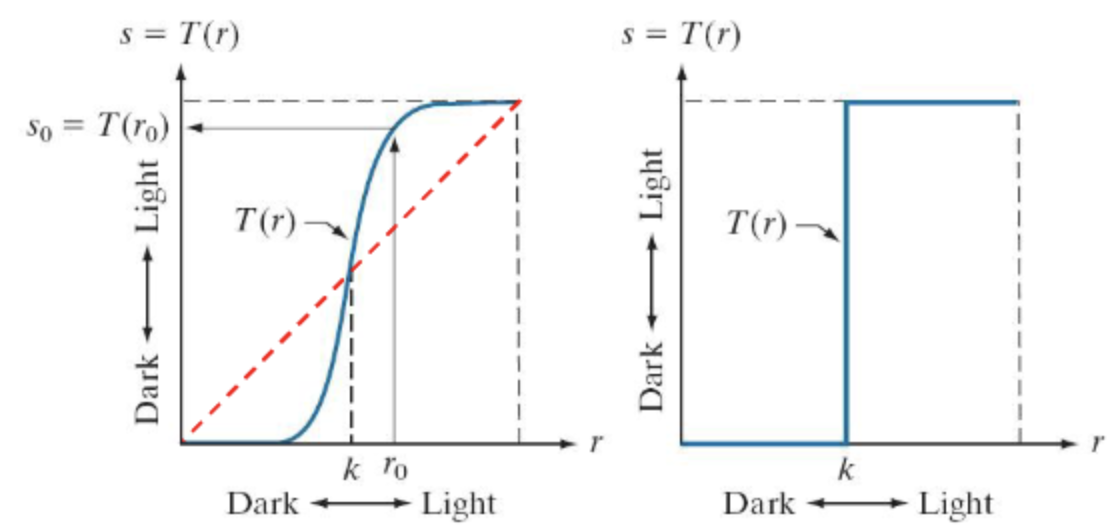

Transformation하면 컴퓨터그래픽스에서 배운 정사영, 평행이동, 회전 이런게 생각날 것이다.영상처리에서는 밝기를 변화를 많이 시킨다.애초에 이미지를 \[세로]\[가로]\[채널]의 값을 Intensity로 저장하니까 말이다.이러한 밝기를 조절하면 어둡게 밝게 할

4.영상처리 - Spatial Filtering

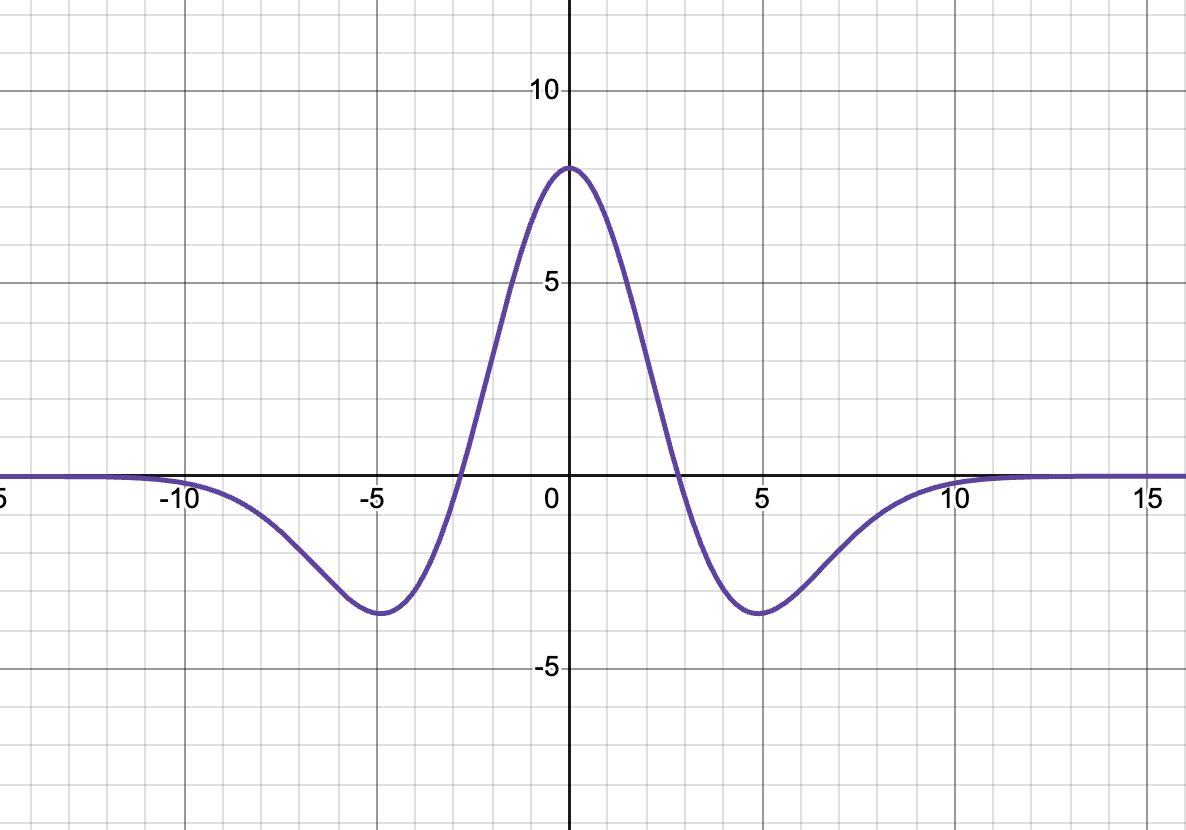

Spatial Filtering 이번장은 Intensity를 다르게 변환해서 이미지를 흐리게 혹은 날카롭게 만드는 법을 배울 것이다. 그전에 신호와 시스템에 대한 기본적인 지식을 알아야한다. Signal & Systems Term Signal: 정보나 데이터의 연속

5.영상처리 - Point, Line, Edge Detection

Point, Line, Edge Detection 이미지에서 점이나 선, 그리고 색과 색깔의 그 경계선을 구분할 때 사용하는 원리를 알아보자. Digital Derivatives Laplacian(라플라스 연산자) $\nabla^2f=\frac{\partial^2f}

6.영상처리 - Segmentation

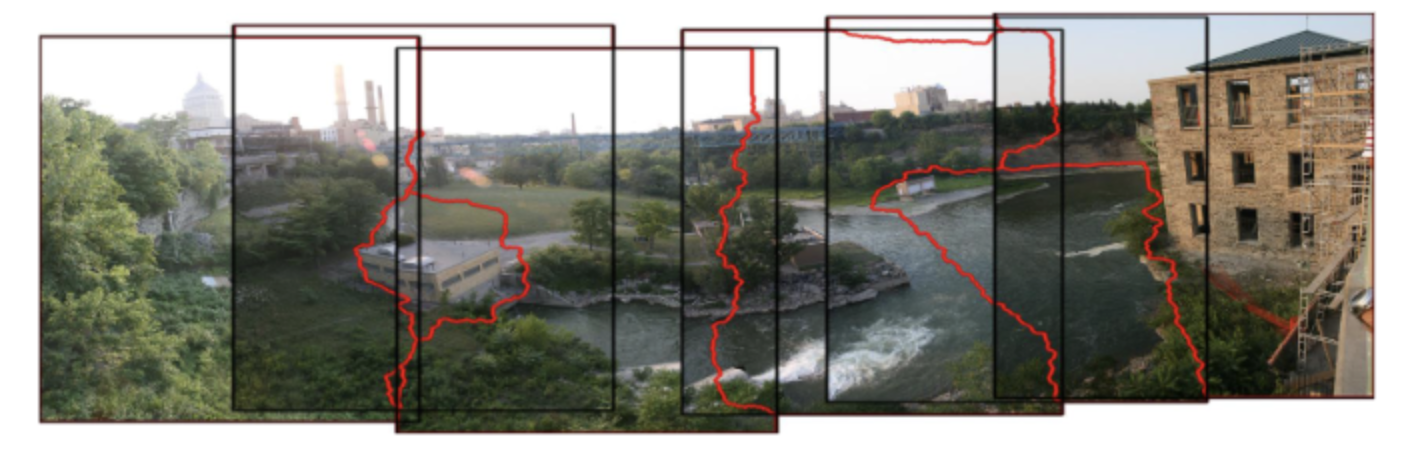

Segmentation 화면에 특정 부분을 분리하는 것을 컴퓨터비전에서 많이 봤을 것이다. 자율주행 자동차들은 사람과 도로, 나무, 벽 등을 구분해서 지나다닌다. 여기서 제일 중요한 것이 Segmentation 기술이다. 이미지 안에서 구역을 나눠 구분을 하는 것

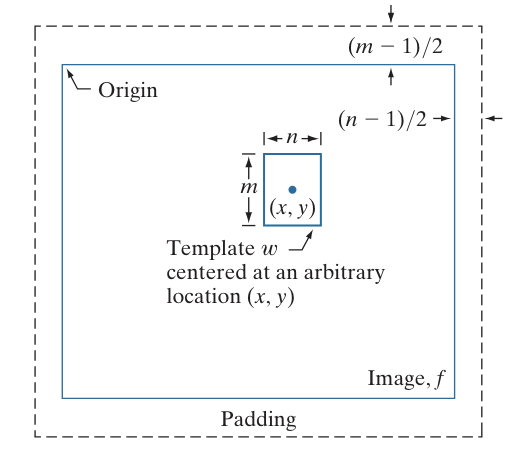

7.영상처리 - Template Matching

입력 영상에서 일부분의 영상 위치를 찾아낼 때 사용하는 기술이다.Template은 일부분의 영상을 의미한다.이미지에서 template의 절반크기만큼 padding을 주어서 index out of range가 없도록 한다.그리고 위에서부터 탐색해서 유사한지 유사하지 않은

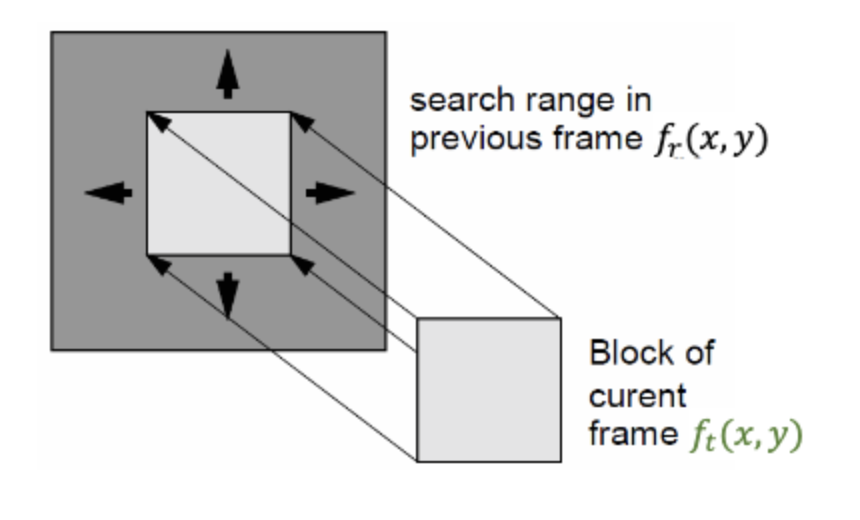

8.영상처리 - Motion Estimation

현재 이미지는 과거이미지에서 얼마나 움직였는지 구할 때 사용하는 기술이다.움직임 차이를 구하려면 어떤 알고리즘이 나올지 배우기전에 생각해보자.단순히 픽셀별로 서로 차를 빼서 이미지를 만들면 되지않을까?어떤 방법들이 있는지 알아보자.전체 이미지를 탐색하며 차를 빼는 건

9.영상처리 - Image Resizing

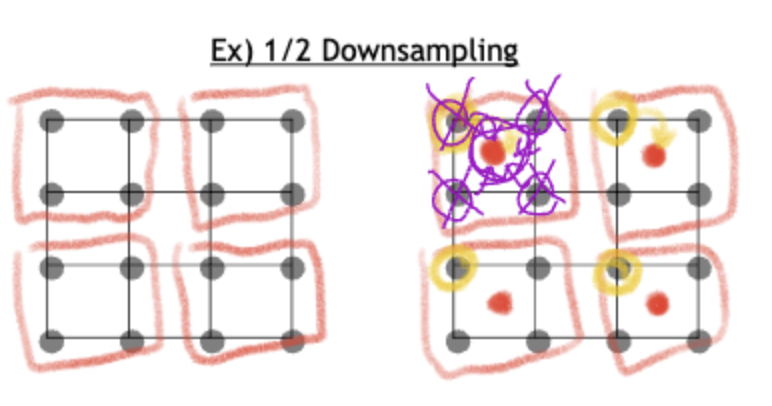

이미지의 해상도를 축소시키거나 늘릴 때 사용하는 기술이다.확대와 축소는 단순하게 N배와 1/N배로 하는 로직을 떠올릴 수 있을 것이다.근처의 이웃과 비교하면 된다.위 방식은 1/2 Downsampling 과정에서 2 x 2의 픽셀의 평균값을 대표 픽셀로 지정하는 방식이

10.영상처리 - Geometric Transformations

Geometric Transformations CG에서도 다루었지만, 영상처리 기말범위에도 있기에 한 번 더 정리해보려고 한다. Transformation은 변환으로 이미지를 축소, 확대 하거나 y축으로 이동하거나, 원점을 중심으로 회전을 하거나하는 등의 변환을 의미

11.영상처리 - Frequency Domain Filtering

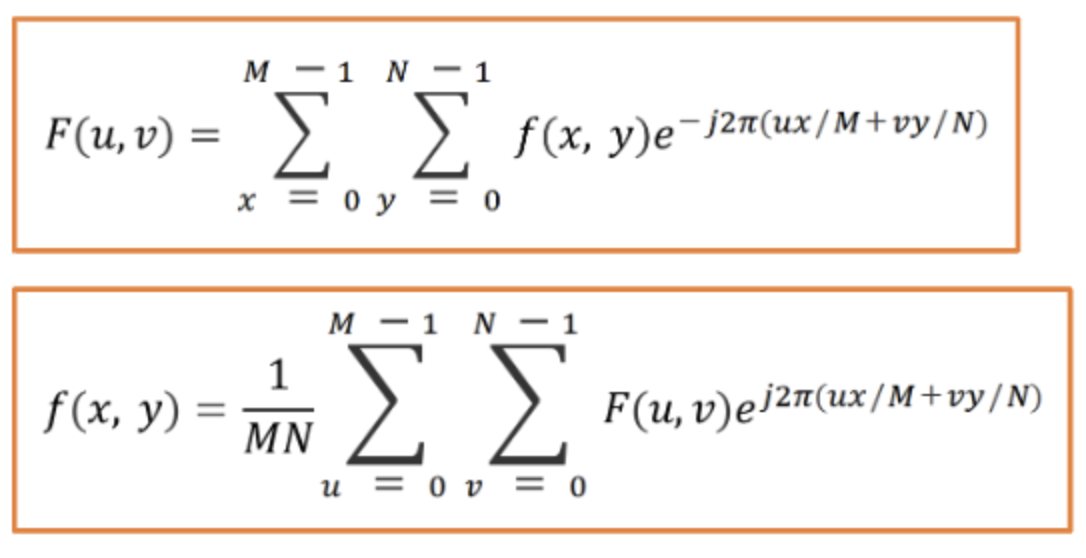

푸리에 급수와 푸리에 변환에 대한 내용을 공부하고 난 후 들으면 이해가 쉬울 것이다.이미지도 하나의 신호로 볼 수 있다. x축과 y축 2-D의 신호인 것이다.이미지의 크기를 M X N 라고 두면 DFT는 위의 식이, IDFT는 아래의 식이 된다.기존의 신호는 Frequ

12.영상처리 - Denoise, Restoration

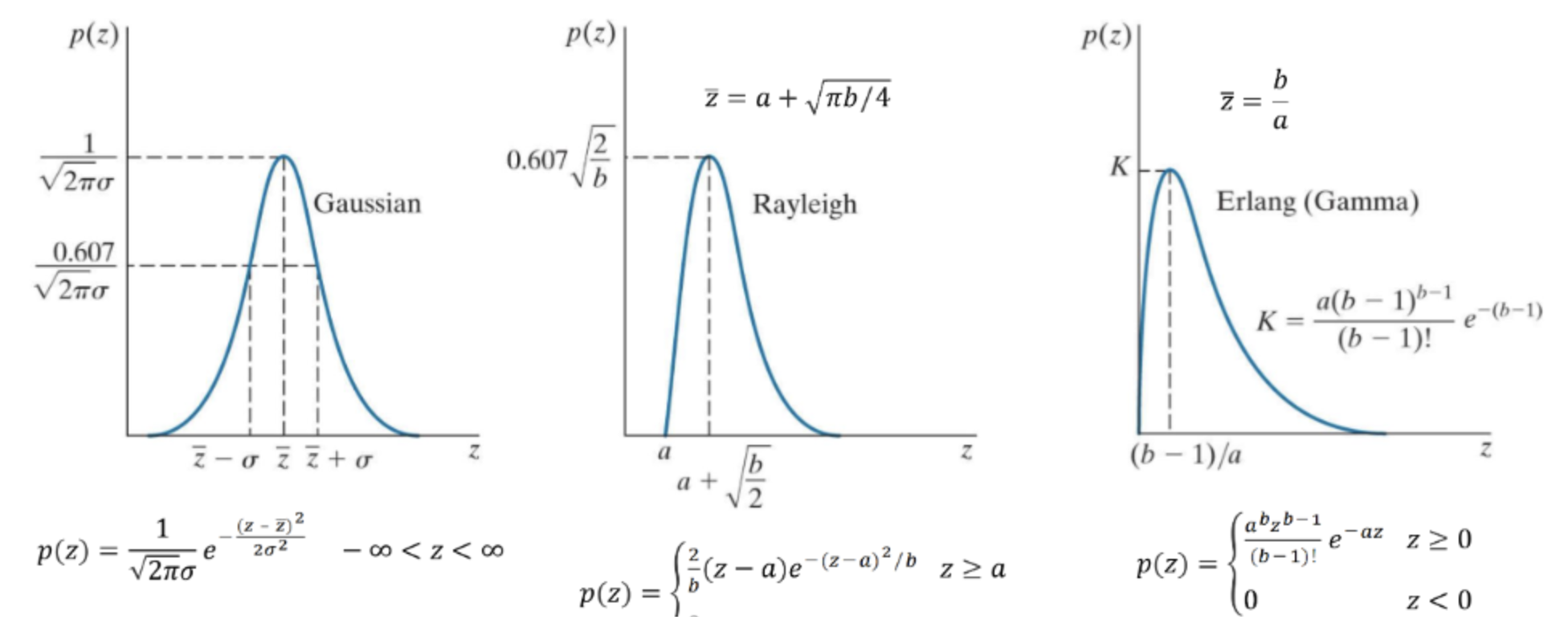

이미지는 노이즈가 생기고 모종의 이유로 화질이 저하될 수 있다.$g(x,y)=\\Etaf(x,y)+\\eta(x,y)$로 $\\Eta$만큼 Degrade가 되고, $\\eta$ 만큼 Noise가 추가된 이미지다.이를 없애기 위해서는 Denoise로 $\\eta$를 제거