Paper

1.ELECTRA

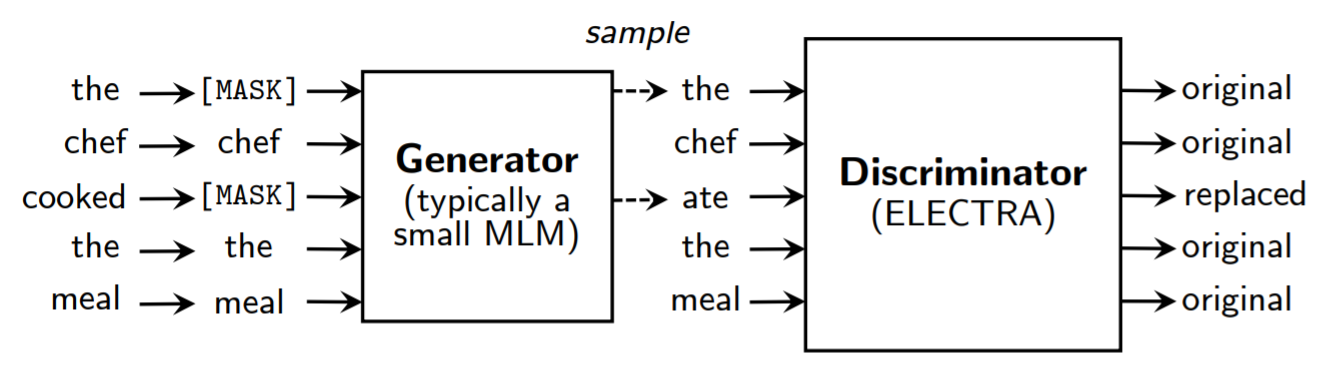

버트와 같은 MLM pretraining 방법은 입력을 기존의 것과 다르게 하는데(=corrupt) 입력의 몇개의 토큰을 MASK로 바꾸고 모델이 MASK 토큰을 원래의 단어로 재구성하도록 학습하게 한다. MLM이 적용된 모델(=they)들은 downstream NLP

2021년 10월 13일

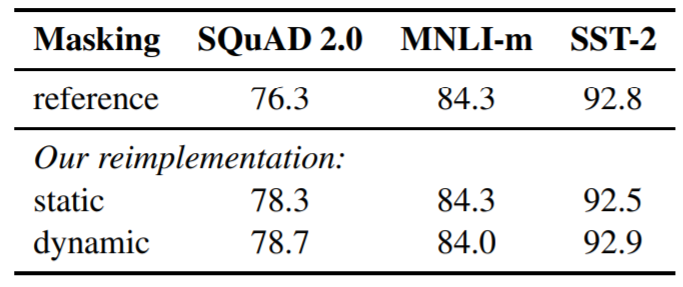

2.RoBERTa

RoBERTa 논문의 모든 문장 의역 및 작은 해석

2021년 10월 13일

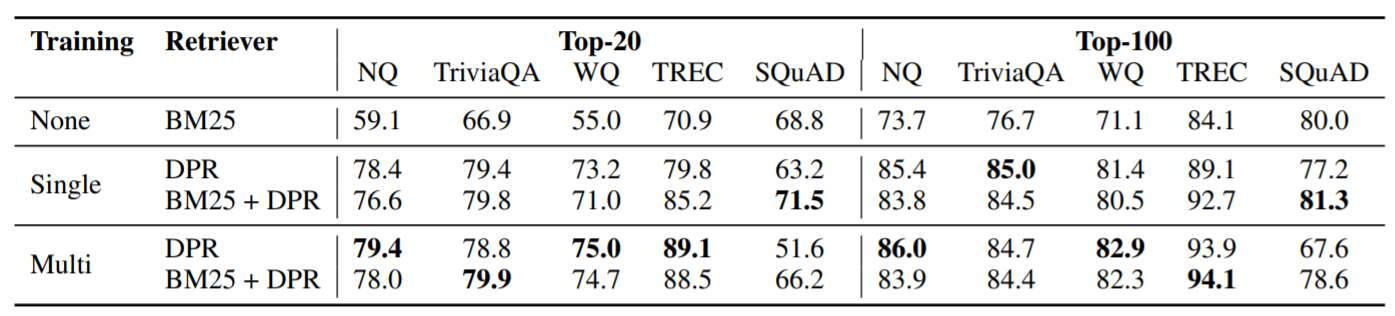

3.Dense Passage Retrieval

Dense Passage Retrieval for Open-Domain Question Answering Abstract Open-domain question answering(자유 주제 질의 응답, 이하 OPQA)은 TF-IDF나 BM25같은 sparse vecto

2021년 10월 19일

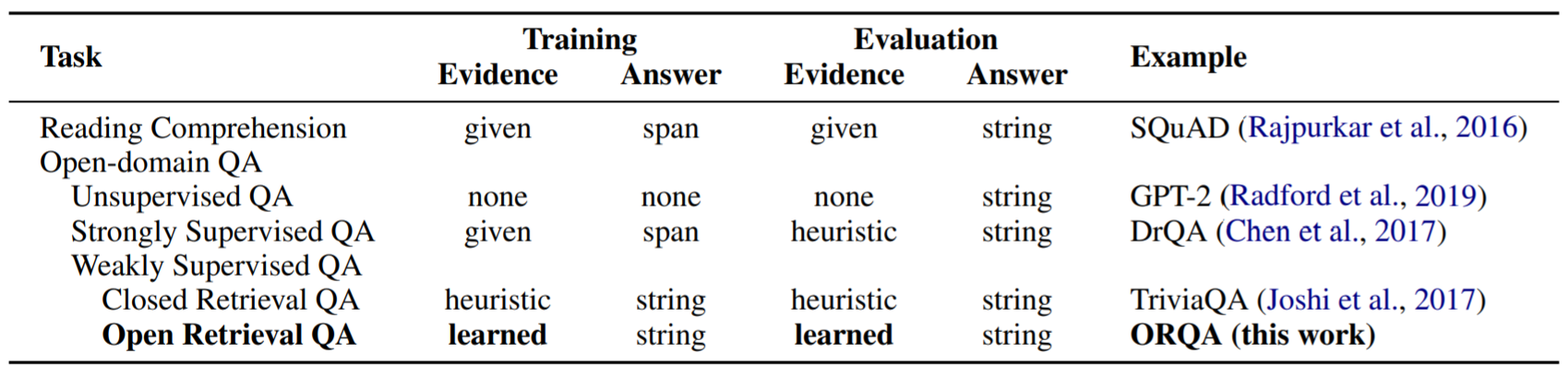

4.Latent Retrieval for Weakly Supervised Open Domain Question Answering

ODQA의 최근 연구들은 유용한 데이터를 가지고 이루어지는 강력한 지도 학습이나 유용한 데이터를 찾아오는 black-box 정보 검색 시스템으로 수행되고 있다. 이들은 최선책이 아닌데, 정답을 항상 찾을 수 있는 방법이 아니기 때문이다. 그리고 QA이라는 것은 원초적

2021년 10월 27일

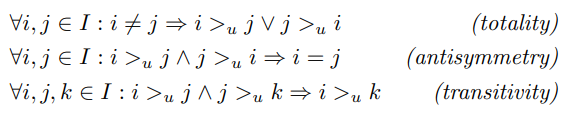

5.BPR : Bayesian Personalized Ranking from Implicit Feedback

아이템 추천은 여러 아이템을 개인에 맞춰 순위를 매겨주는 문제이다. 여기서는 클릭이나 구매기록 같은 간접 피드백을 이용하는 일반적인 시나리오로 설명하겠다. 아이템 추천에는 MF나 kNN같은 많은 방법이 있다. 이런 방법들은 유저별로 순위는 잘 구축하지만 순위 자체를 최

2022년 2월 15일