Abstract

visual과 textual에 대한 joint 표현에 대한 발전이 있어 여러 멀티모달 테스크에서 좋은 성능이 있었다. 그러나 이미지 캡션과 디텍션에 대한 라벨은 규모에 대한 접근에 한계를 만들었다. 그래서 우리는 Simple Visual Language Model(simvlm) 간단한 사전 학습 프레임워크를 제시한다.

이전 연구들과는 다르게 weak supervision의 대규모 학습으로 학습의 복잡성을 줄이고 end-to-end로 single prefix language modeling 방식을 사용한다. Simvlm은 강력한 general 능력과 전이 학습 능력을 보인다.

Introduction

언어 표현 사전 학습 방식에 성공에 따라 multi-modal model을 만드려는 연구가 많이 존재했다. 두 이미지와 언어의 모달리티를 학습하기 위해서 많은 human labeled(이전의 crowded labeling)을 사용했다.

object detecion 데이터셋의 경우 object detector를 학습시켜이미지에서 ROI 특징을 추출하기 위해 사용되었고, image-text pairs 데이터는 해당 ROI과 알맞는 텍스트로 MLM을 사전학습한다. 이러한 human-annotated의 한정된 양의 데이터를 극복하기 위해 다양한 auxiliary loss가 사용된다. 그러나 이런 방식은 VLP의 사전 학습 프로토콜을 복잡하게 만든다. 그리고 이런 pretraining-finetuning 방식은 zero-shot의 능력이 부족하다. 반대로 웹에서 대용량의 데이터를 수집하여 만든 clip의 경우는 이미지 분류와 검색의 zero-shot에서 뛰어난 성능을 보여주었다. 그럼에도 이 방식은 특정 task에 초점을 맞추어 일반적인 pretraining-finetunning에는 적합하지 않을 수 있다.

따라서, 해당 논문은 아래와 같은 내용들을 제시한다.

(1) pretraining-finetunnning 방식과 VL venchmark에서 뛰어난 성능

(2) 복잡하지 않은 사전 학습 프로토콜

(3) cross modal에서 text guided로 인한 zero-shot

모델 개요

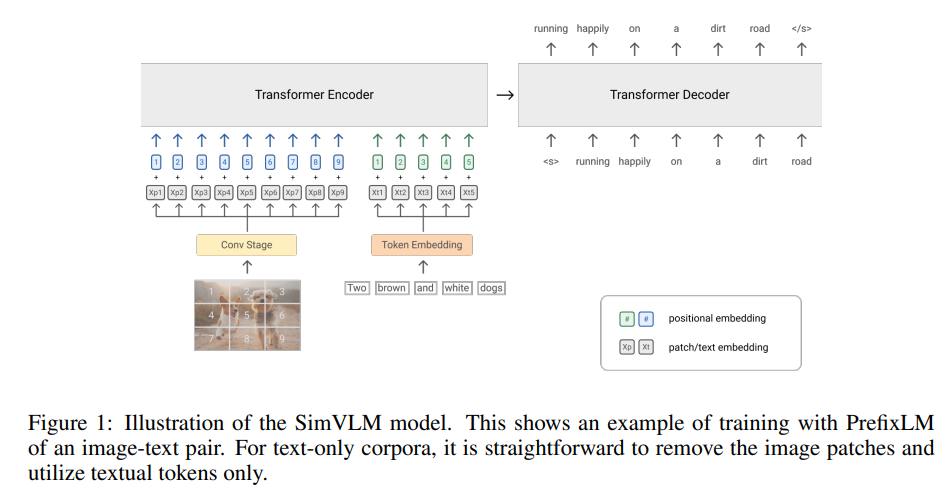

본 연구에서는 Prefix Language Modeling (PrefixLM)을 단일 학습 목표로 설정하여 엔드 투 엔드(end-to-end) 학습이 가능하도록 설계되었다. 이 접근 방식은 GPT-3처럼 자연스럽게 텍스트를 생성할 수 있을 뿐만 아니라, BERT처럼 양방향(context-aware) 문맥을 처리할 수 있는 장점을 갖는다.

모델 구조 (Architecture)

모델의 백본(backbone)으로는 ViT(Vision Transformer) 및 CoAtNet이 사용되며, 이는 원본 이미지(raw image)를 직접 입력으로 받는다. 이러한 아키텍처는 대규모 데이터 학습에 적합하며, PrefixLM 목적과도 높은 호환성을 가진다.

데이터 (Data)

이 모델은 객체 검출(Object Detection) 과정이 필요하지 않으며, 대신 대규모의 약한(supervised) 레이블링된 데이터셋을 활용할 수 있다. 이를 통해 제로샷(Zero-shot) 일반화 성능을 향상시키는 잠재력을 갖는다.

SimVLM은 object detection pretraining 이나 보조 로스가 필요하지 않을 뿐더러, 좋은 성능을 보인다. 그리고 6개의 VL venchmark에서 sota를 달성한다.

Related work

근래 VLP 연구에서는 object detection이 많은 요소를 차지하였다. 이러한 방식은 human labeled 데이터를 많이 요구하였다. 또, detection module이 없는 방식이 있었으나 작은 규모의 완전한 사전 데이터를 사용하여 zero-shot 능력에 한계가 존재했다.

그리고 multiple cross-modality loss function들이 있었고 이들은 섞여서 로스를 이루었다. 이는 다양한 loss와 데이터 셋간 균형을 맞추는데 어려움을 보였고 최적화를 복잡하게 만들었다.

SimVLM

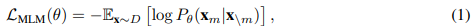

양방향성 Masked Language Modeling은 자기지도학습에서 가장 인기있는 방식이다. Bert에 따르면, 손상된 토큰을 복구하는 방식으로 denoising autoender를 사용한다. 문장이 주어지면 랜덤으로 일부를 마스킹 처리하고 마스킹된 토큰을 복구하는 방식으로 학습이 진행된다.

세타는 학습가능한 모델의 파라미터이고 D는 사전학습 데이터이다. 이러한 방식은 downstream task를 위한 문맥 표현을 학습한다. MLM방식의 학습은 VLP에서 많이 사용되어졌다. input은 image-text 쌍으로 주어지고, 모델은 roi features를 이용하여 마스킹된 토큰을 예측한다.

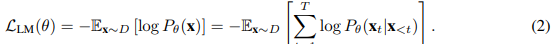

그리고, 단방향성 Language Modeling으로 다음 시퀀스를 예측하는 방식을 사용한다.

Proposed Objective : Prefix Language Modeling

LM Loss로 zero-shot의 능력을 얻게 된 것을 바탕으로 Prefix Language Modeling을 제시한다. 이는 앞 문장에서의 양방향성 어텐션을 가능하게 한다는 점에서 LM과 다르다. 그리고 이후 토큰에서만 LM의 방식을 수행한다.

=> 이미지와 주어진 텍스트 토큰에서는 양방향성 어텐션을 수행하고 이후 추론할 텍스트에 대해서 LM 방식을 사용. 이미지 자체가 prefix 토큰으로 사용된다. 이러한 방식은 문맥에 대한 이해와 더불어 생성 능력도 뛰어나게 만든다.

Architecture

모델의 기본 구조는 Transformer를 사용하며, 일반적인 언어 모델(Standard LM)과 다르게, PrefixLM은 Prefix(접두사) 부분에서 양방향 Attention을 허용한다.

따라서, Decoder-only 모델과 Encoder-Decoder 모델 모두에서 사용 가능하게 한다. 이러한 생성에서 분리한 encoder의 inductive-bias가 downstream task에서 성능에 도움이 됨을 확인했다.

이미지의 경우는 1D 패치 시퀀스로 변환하여 T_i x D로 변환한다. T_i는 이미지 토큰의 수를 의미하게 된다. ConvNet 기반 ResNet 블록을 사용하여 이미지 패치를 문맥화 (첫 3개 블록 활용).한다.

입력 문장은 서브워드 단위로 토큰화하여 정해진 어휘 집합(vocabulary)에서 임베딩(Embedding)을 학습하고 텍스트 토큰 역시 Transformer에 입력된다. 이미지와 텍스트 input에 대해 위치 1D 위치 임베딩을 추가한다. 그리고 transformer 레이어 내에서 이미지의 상대적 2D attention을 추가한다.

Datasets

object detection module에 의존성이 존재하지 않는다. 모든 모델의 파라미터를 noisy image-text data에서 스크래치 부터 학습을 진행했고 이는 zero-shot 에서 더 뛰어난 성능을 보인다.

최소환의 처리를 거친 웹에서 크롤링한 alt-text 쌍 데이터 셋을 사용한다.

Scaling Up Visual and Vision-Language Representation Learning

With Noisy Text Supervision 에서 소개된 데이터를 사용함.

Clip 보다 약 4배 이상 큰 18옥 데이터 쌍을 사용하였으며 CLIP 보다 높은 성능을 보임. 데이터 정제 과정은 정말 최소한을 사용함. 중복 데이터 제거, 비속어 필터링 등.

PrefixLM 방식은 modality agnostic하기 때문에 text corpora를 추가로 텍스트 데이터의 노이즈를 개선시키기 위해 사용할 수 있으며 이는 성능 향상으로 이어졌다.

Experiments

Visual Question Answering, Image Captioning, Visual Reasoning, Visual Entailment, Multimodal Translation 등 다양한 Visual-Linguistic (VL) benchmark를 대상으로 체계적인 실험을 수행함을 보인다.

특히, pretraining-finetuning 패러다임에서 범용적인 VL 표현 학습(general-purpose VL representation learning)이 어떻게 이루어지는지를 분석하고, 이를 통해 특정 task나 데이터셋에 국한되지 않고 다양한 VL task에 적용 가능한 모델을 검토한다.

또한, 모델이 open-ended VL 이해에서 zero-shot 일반화를 얼마나 효과적으로 수행할 수 있는지도 연구할 예정이다.

실험 환경 (Setup)

모델 구조는 ViT(Vision Transformer)의 설정을 따르는 "Base", "Large", "Huge" 세 가지 SimVLM 변형으로 구성되며, 각 변형은 해당 ViT 변형과 동일한 설정을 따른다.

사전학습 과정에서는 ALIGN 훈련 세트와 Colossal Clean Crawled Corpus (C4) 데이터셋을 사용하여 총 100만 스텝 동안 처음부터 학습이 진행된다.

배치 구성: 각 배치에는 4,096개의 이미지-텍스트 쌍(ALIGN)과 512개의 텍스트 전용 문서(C4)가 포함.

사전학습이 완료된 후, 모델은 총 여섯 가지 Vision-Language 벤치마크에서 파인튜닝 및 평가된다.

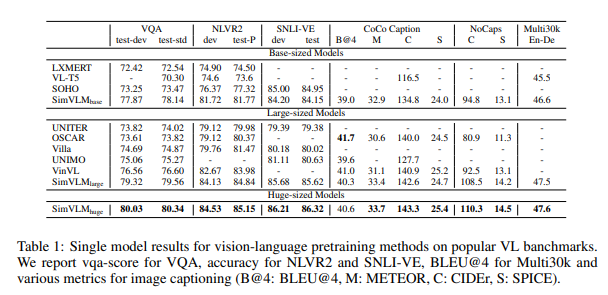

Comparison With Existing Approaches

SimVLM의 Vision-Language 사전학습 품질을 평가하기 위해, 기존 SOTA (State-of-the-Art) VLP(Vision-Language Pretraining) 모델과 비교 실험을 수행했다.

비교 대상 모델은 다음과 같다.

LXMERT, VL-T5, UNITER, OSCAR, Villa, SOHO, UNIMO, VinVL 등

Table 1의 결과에 따르면, SimVLM은 모든 기존 모델을 능가하며 실험에 포함된 모든 벤치마크에서 새로운 SOTA 성능을 달성했다.

이는 생성 중심의 사전학습 접근 방식이 기존 MLM(Masked Language Modeling) 기반 모델들과 충분히 경쟁할 수 있음을 보여주며,

Weak Supervision만으로도 고품질의 멀티모달 표현을 학습할 수 있음을 보인다.

Zero-shot Generalization

Weak Supervision 기반 생성 모델링의 가장 큰 장점 중 하나는 Zero-shot 일반화의 가능성이다.

기존 연구들은 사전학습된 모델이 별도 학습 없이(few-shot/zero-shot) down stream task로 transfer될 수 있음을 보여주었다.

이번 연구에서는 기존 VLP 연구에서 덜 탐구된 세 가지 Zero-shot 응용 설정을 다룬다. (본 적 없는 task, modality, test instances)

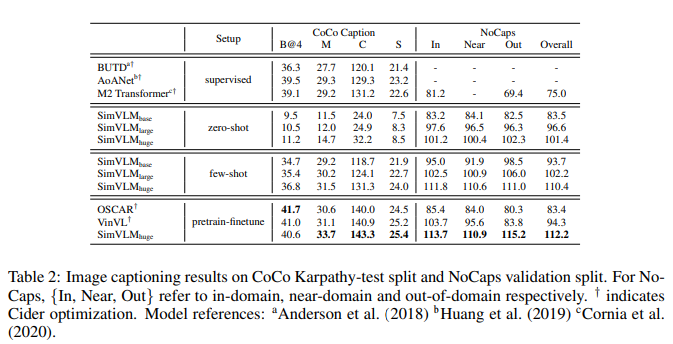

Zero-shot / Few-shot Image Captioning

SimVLM의 사전학습 과정은 웹 데이터를 활용한 노이즈가 있는 Image Captioning 목표와 유사하게 설계되었다. 따라서, 이 Captioning 능력이 zero-shot/few-shot 방식에서 얼마나 잘 일반화되는지 검토하는 것이 중요하다.

Zero-shot 설정: 사전학습된 SimVLM을 직접 활용해 Image Captioning benchmark에서 디코딩 수행

Few-shot 설정: 훈련 데이터의 1%만 사용해 5 epoch 동안 파인튜닝

추가로 "A picture of"라는 접두사를 추가하면 생성된 캡션 품질이 향상됨을 발견했다. CLIP에서와의 유사한 발견.

Table 2에 따르면, SimVLM의 zero-shot/few-shot 성능은 fully-supervised 모델과 경쟁 가능한 수준이며,

사전학습된 다른 모델들보다 높은 성능을 달성하여 NoCaps 벤치마크에서도 강력한 일반화 성능을 보여줌.

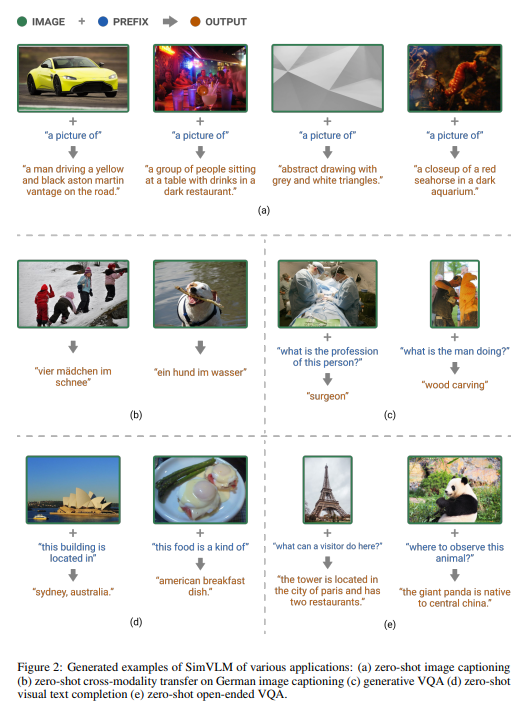

Figure 2 (a)에서는 SimVLM이 생성한 샘플 캡션을 확인할 수 있으며,

실제 세계 개념을 포착하고

"people", "table with drinks", "dark restaurant" 등 복잡한 다수 객체의 장면과 "Aston Martin", "Vantage"와 같은 특정 자동차 브랜드 및 모델도 정확히 인식하였다.

또한, 추상적이거나 조명이 어두운 이미지와 같은 어려운 상황에서도 견고한 성능을 보였다.

이는 SimVLM이 zero-shot 환경에서도 실제 세계 개념을 효과적으로 일반화할 수 있는 능력을 갖추었음을 의미한다.

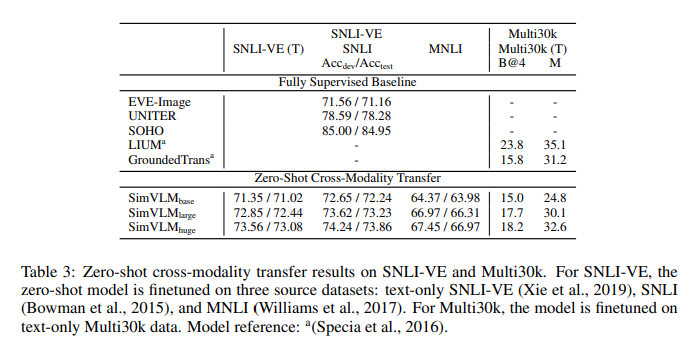

Zero-shot Cross-modality Transfer

기존 사전학습 기법들은 zero-shot cross-modality transfe가 가능함을 입증했다.

이러한 개념을 확장하여, 본 연구에서는 VLP 모델을 활용한 새로운 zero-shot cross-modality transfer 패러다임을 탐구하고,

SimVLM이 모달리티(텍스트 ↔ 이미지) 간에 얼마나 잘 일반화되는지 평가한다.

SimVLM을 텍스트 전용 downstream 데이터로 파인튜닝한 후, Joint Vision-Language (VL) Task에서 zero-shot transfer 성능을 직접 평가한다. 본 연구에서는 SNLI-VE와 Multi30k를 활용하여 zero-shot 전이 성능을 분석하였다.

1) SNLI-VE (Vision-Language Natural Language Inference, VL-NLI)

NLI(자연어 추론) 데이터셋 3개를 활용해 텍스트 전용 데이터로 사전학습을 진행.

전제(Premise)를 인코더에 입력하고, 가설(Hypothesis)을 디코더에 입력하여 모델을 파인튜닝. 디코더 마지막 토큰의 임베딩을 활용해 Classifier Head를 학습.

추론 시, 훈련된 모델에 전제(이미지)를 인코더 입력으로 제공하고, 가설(텍스트)을 디코더에 입력하여 평가한다.

2) 검증 실험 (Ablation Study)

이미지 특징을 마스킹하고 가설(텍스트)만으로 예측한 경우, 모델의 결과는 랜덤 추측 수준(average score 34.31 / 34.62)에 가까움. 즉, SimVLM이 이미지 정보를 적극적으로 활용하여 의미 있는 추론을 수행했음을 입증.

Table 3에서 확인할 수 있듯이, SimVLM은 zero-shot 환경에서도 UNITER를 포함한 fully-supervised 모델들과 경쟁력 있는 성능을 달성했다. 특히, 모델이 실제 이미지 특징을 활용하지 않으면 무작위 추측 수준의 결과가 나오는 점을 고려할 때, SimVLM의 cross-modality transfer 능력이 유효함을 강력히 입증한다.

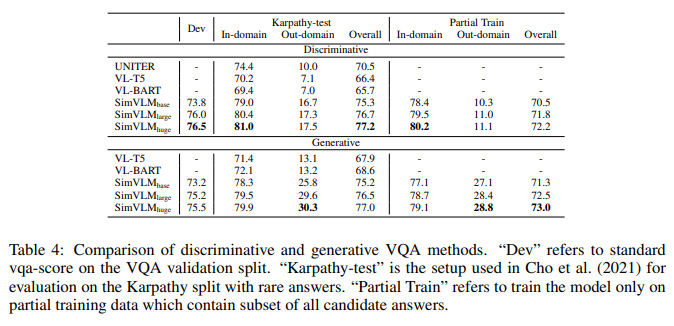

Open-ended VQA

기존 Visual Question Answering (VQA) 모델들은 대부분 3,129개의 사전 정의된 정답 후보에 대한 다중 라벨 분류 문제로 공식화되었다.

이러한 접근 방식은 짧고 사실적인 정답을 잘 예측할 수 있지만, 실제 환경에서는 모든 시나리오를 포함하는 closed 정답 후보 집합을 정의하는 것이 어렵다.

따라서, 진정한 open-ended VQA는 더욱 도전적인 문제 설정이 된다.

추가 실험: 생성된 답변의 질적 분석

위 실험에서는 생성된 답변과 인간 레이블 간의 정확한 일치(Exact Match, EM)로 점수를 계산했지만,

모델이 다른 표현이나 동의어로도 적절한 답변을 생성할 가능성이 있다.

이를 보완하기 위해, Figure 2 (c)에서 질적 생성 결과를 추가로 분석했다.

SimVLM은 기존 3,129개 후보 정답에 없는 단어(예: "surgeon", "wood carving")를 생성할 수 있었다.

이는 SimVLM이 사전학습 과정에서 습득한 지식을 VQA로 전이할 수 있음을 의미한다.

Zero-shot VQA 가능성 평가

이러한 결과를 기반으로, SimVLM이 별도의 파인튜닝 없이 Zero-shot VQA가 가능한지 실험했다.

프롬프트 문장을 제공하면 SimVLM이 "answer"라는 단어를 포함한 응답을 생성할 수 있음을 확인했다 (Figure 2 (d)).

하지만, 실제 질문에 대해 의미 있는 답변을 생성하는 능력은 부족했다.

이러한 한계는 사전학습 데이터 품질이 낮기 때문으로 추정된다.

기존 사전학습 데이터는 짧고 노이즈가 많아, 의미 있는 답변을 학습하기 어려움.

이를 검증하기 위해, 더 깨끗한 WIT 데이터셋에서 추가 사전학습(50k step)을 수행했다.

Figure 2 (e)의 예시는 WIT 데이터셋으로 학습한 후, SimVLM이 더욱 관련성 높은 응답을 생성할 수 있음을 보여줌.

즉, 고품질의 텍스트 데이터가 SimVLM의 Open-ended VQA 능력을 향상시킬 수 있음을 시사한다.

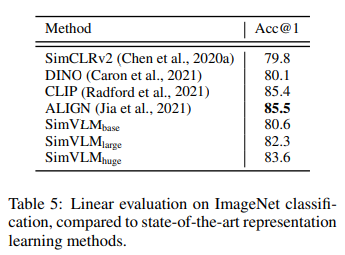

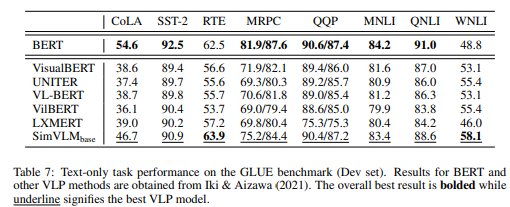

분석: 단일 모달리티(Task-Specific) 성능 평가

SimVLM은 vision-language task에서 좋은 성능을 보였으므로,

이 모델이 단일 모달리티(텍스트 또는 이미지) task에서도 잘 작동하는지 분석했다.

1) 텍스트 이해 능력 평가 (GLUE 벤치마크)

기존의 VLP (Vision-Language Pretrained) 모델들과 비교하여 GLUE 벤치마크 성능을 평가 (Appendix C, Table 7). SimVLM은 BERT와 비교할 만한 성능을 발휘하여, 우수한 언어 이해 능력을 보유하고 있음을 나타냄.

학습 과정에서는 T5의 텍스트 처리 방식을 참고하여, 토큰 타입 임베딩 없이 input을 완전히 형식화하여 분류하도록 학습. 결과적으로, 기존 VLP 모델들보다 더 나은 성능을 보임.

2) 이미지 표현 학습 능력 평가 (ImageNet Linear Evaluation Protocol)

ImageNet에서 linear evaluation protocol을 수행하여 Top-1 Accuracy를 계산 (Table 5).

SimVLM은 contrastive loss를 사용한 판별 학습 없이도, 인코더 출력의 평균 풀링을 이미지 특징으로 활용. 실험 결과, SimVLM이 고품질의 이미지 표현도 학습했음을 확인.

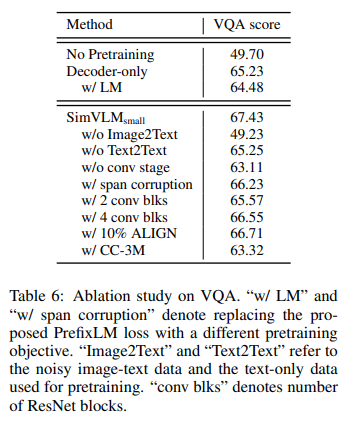

Ablation Study

SimVLM의 각 구성 요소가 모델 성능에 미치는 영향을 분석하기 위해,

임베딩 차원 512, 8개 레이어로 구성된 SimVLM Small 모델을 대상으로 Ablation Study를 수행했다. VQA 성능 비교 결과는 Table 6에 정리되어 있다.

1) 인코더-디코더 모델 vs. 디코더 전용 모델

비슷한 규모의 디코더 전용 모델과 비교했을 때, 인코더-디코더 모델이 VQA에서 훨씬 높은 성능을 기록.

이는 양방향 인코딩(Bidirectional Encoding)과 단방향 디코딩(Unidirectional Decoding)을 분리하는 귀납적 편향(inductive bias)이 joint VL 표현 학습에 유익함을 시사.

즉, 이미지와 텍스트 간의 깊은 상호작용을 위해 인코더-디코더 구조가 필수적임을 확인했다.

2) 사전학습 목표의 영향

SimVLM은 Prefix Language Modeling (PrefixLM) 기법을 사용하여 학습.

실험 결과, PrefixLM이 span corruption 및 단순 Language Modeling(LM)보다 우수한 성능을 보임.

이는 이미지-텍스트 데이터와 텍스트 전용 데이터 모두에 대해 통합된 목표 함수(Shared Training Objective)를 사용하는 것이 중요함을 의미.

3) 데이터셋의 기여도 분석

Weakly Aligned 이미지-텍스트 데이터가 시각적 및 텍스트적 표현 간의 격차를 줄이는 데 필요하다. 하지만, 텍스트 전용 코퍼스도 모델 성능을 향상시키는 것으로 나타남. 이는 Weakly Aligned 데이터는 노이즈가 많은 텍스트 정보를 포함 → 모델이 정확한 언어 이해를 학습하기 어려움. 텍스트 전용 데이터 추가 학습을 통해 모델의 언어 이해 능력을 보완할 수 있음.

추가로, ALIGN 및 CC-3M 데이터셋의 10%만 사용한 실험을 통해, 데이터 규모(Data Scaling)의 중요성이 확인됨. 데이터셋이 클수록 모델 성능이 증가하는 경향이 뚜렷하게 나타남.

4) 컨볼루션 단계(ResNet Conv 블록)의 역할

Dai et al. (2021)을 참고하여, ResNet Conv 블록의 첫 2개/3개/4개 블록을 사용하는 실험을 수행.

3개 Conv 블록을 사용할 때 최상의 성능을 기록. 이는 이미지와 텍스트가 서로 다른 수준의 표현 세분성(Granularity)을 가지며, 문맥화된 패치(Contextualized Patches)를 활용하는 것이 효과적임을 의미.

🔗 관련 글