딥러닝 입문

1.Neural Network

Week2 Review GD (Gradient Descent) Gradient vector: 함숫값이 증가하고 감소하는 방향을 알려줌 우리는 cost 함수를 가장 빠르게 감소시킬 수 있는 방향에 관심이 있음 Vectorize Computation graph z=w1x11+w2x12+w3x13+b a=sigmoid(z) forwa...

2.Activation function, Random initialization

Vanishing Gradient 값이 매우 크거나 작을 때, gradient가 0에 가까워서 backpropagation 하는 데에 어려움이 발생한다. gradient가 사라지는 이 상황을 Vanishing Gradient라고 한다. 현상 activation의 미분

3.Holdout Validation, Underfitting&Overfitting

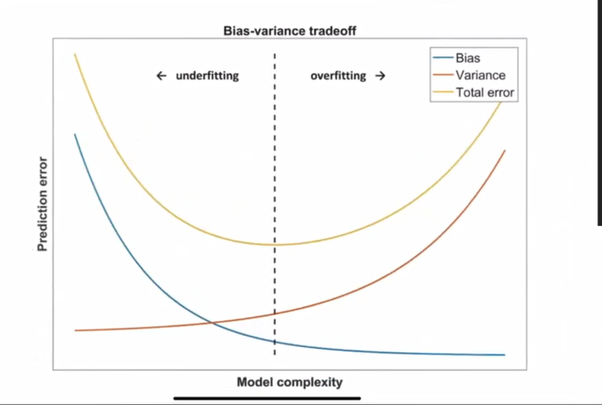

Holdout Validation Hyperparameter : 모델링할 때 사용자가 직접 세팅해주는 값 ex) learning rate, of layer, # of unit of each layer, activation, iteration Data split : t

4.Multi-class Classification, How to Solve Over&Underfit issue

Batch : Batch size는 전체 데이터 셋을 나누었을 때 하나의 그룹에 속하는 데이터 수 Epoch : 한 번의 Epoch이라는 것은 전체 데이터 셋에 대해 한 번 학습을 완료한 것 Iteration : 1번의 Epoch을 마치는 데 필요한 parameter 업데이트 횟수 (전체 데이터를 모델에 한번 학습시키는 데 필요한 배치의 수) Multi-...

5.Scaler, Initialization, Mini Batch, Optimizer

Scaler > 1. MinMaxScaler x-min(x)/max(x)-min(x) scale을 0과 1 사이로 만들어줌 StandardScaler x-평균/표준편차 보통 image의 경우에는 MinMaxScaler 사용. 그 외에는 보통 StandardScaler 사용 Initialization > #### 1. Zero Initialization...

6.Convolutional Neural Network

Convolutional Neural Network Fully-Connected Layer의 문제점 변형(이동)되면 인식 못하는 경우 이미지의 모든 pixel간의 feature 추출 Filter(Kernel): 이미지의 특징을 찾아내기 위한 파라미터 -> Filter 이용해서 convolution 연산 -> Filter를 어떻게 주느냐에 따라 얻어내는 결...

7.Metrics, RNN

Metrics 1. Regression 1) mean absolute error 2) root mean square error 2. Classification 1) Precision = TP/(TP+FP) positive 판정이 맞을 확률 2) Recall = TP/(TP+FN) positive 사건이 잘 맞았는지 3) Accuracy = (TP+TN...

8.Callback 함수

모델에 저장할 것 model의 구조 model의 parameter model 저장 model 전체 저장 model 불러오기 model 구조 저장 model 불러오기 model weight만 저장 Callback ModelCheckpoint 모델 저장할 때 사용되는 콜백함수 ModelCheckpoint callback 만들기 fit의 callba...

9.Normalization Layers, Transfer Learning

Normalization Layers Batch Normalization Covariant shift : a change in the distribution of functions domain 어떤 batch가 input으로 들어가도 항상 균일한 input이 될 수 있게끔 normalization 작업이 필요 weight update와 관계없이 일관된 i...