딥러닝

1.CH3 - Logistic Regression for Binary Classification

0,1 로 이루어진 2진법과 같이 딥러닝에서 말하는 Binary Classification 는 구분하고자 하는 결과 값이 2가지 인 경우를 말한다.input : 이미지Output : 고양이면(1) or 고양이가 아니면(0)64x64 픽셀의 Color 이미지를 사용하고

2.CH4 - Shallow NN (2 layer)

Shallow Neural Network 란 얕은 신경망이라는 뜻으로 input layer, hidden layer, output layer 이 세가지로만 구성되고 hidden layer(1개), output layer 가 fully connected layer 인 모

3.CH5 - DNN

DNN 은 히든 layer 가 여러개인 것을 의미fully connected layervectorized 한 backpropagation 이 쉽다.l-1 layer 에서의 이분과 l layer 의 미분을 비교하는 점화식$L$ : 네트워크 층의 개수$a^{l}$ : $l

4.CH6 - Optimization Algorithm

전체 $M\_{x}$ by M 의 행렬 X 를 batch 라고 했을 때, 전체 batch 를 입력으로 넣고 $\\hat{y}$ 이라는 출력값을 얻어서 $y$ 와 $hat{y}$ 을 가지고 J 라는 Loss 를 구하고 이것들을 가지고 backpropagation 을 통해

5.CH7 - Tuning Process

pytorch_Regularization_v4.ipynb$\\alpha = 10^{(r)}$ 요약하자면 알파는 0 에 붙어있을 확률이 높기 떄문에 r 을 uniform 하게 하지 말라는 의미$\\beta = {0.9,...,0.999}$ : 베타도 특정 구간의 비중이

6.CH9 - CNNs

컴퓨터 비전 문제이미지 분류객체 탐지Neural style transfer큰 이미지의 딥러닝입력 : 64 x 64 x 3 (=12,228) 히든레이어 : 1000개 weight : fully connected 이므로 전체 weight 는 1000 x 12228 = 개수

7.CH13 - Transfer Learning

여태 몇가지 모델을 배웠다. fully connected layer 를 사용한 Shallow Neural Network, 살짝 깊은 Deep Neural Network, Convolution layer 를 사용한 LeNet, ResNet 을 배웠다.우리가 봤던 것들이

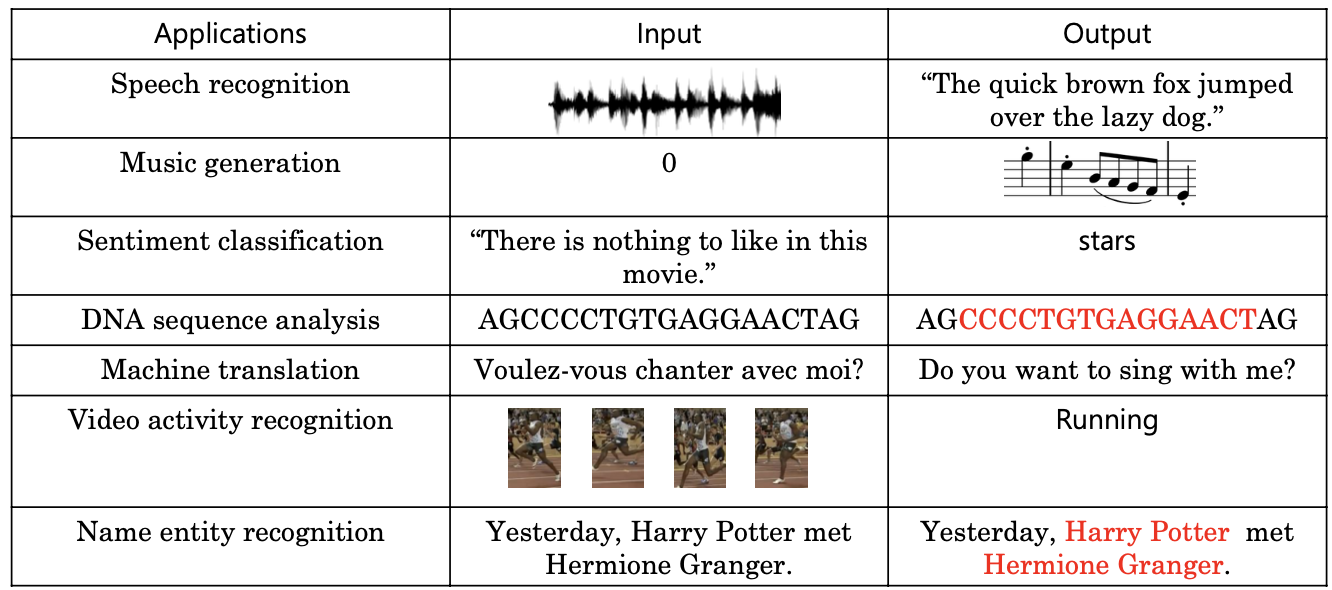

8.CH14 - RNNs

연속작이고 가변길이 데이터다른 모델 적용해야하지 않을까 라는 접근Harry Potter and Hermione Granger invented a new spell.고유명사 1, 고유명사 아닌 것 0입력 단어 -> 출력 binary과거 : 사전에 10000개의 단어 각각