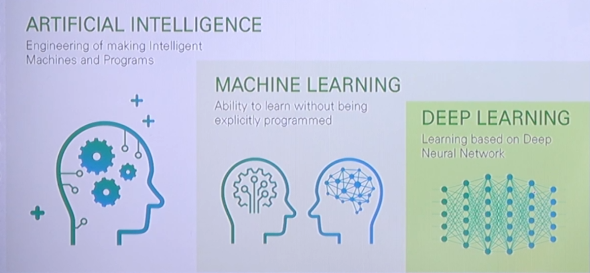

Machine Learning

1.1-1. What is machine learning

명시적으로 프로그래밍 없이 컴퓨터 스스로 학습할 수 있는 프로그램어떤 experience(=data)를 통해서 자동적으로 학습할 수 있는 프로그램기존의 전통적인 방식에서의 프로그래밍은 Input data과 Program이 들어왔을 때 Output data를 제공해준다.

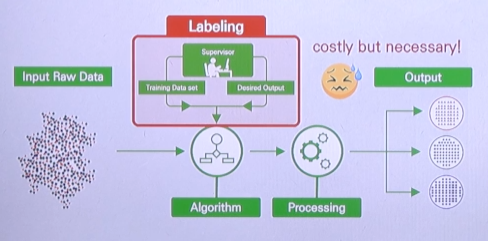

2.1-2 What is Supervised learning

Data들이 input, output으로 구성된 pair형태 이다.input에 맞는 ouput을 대응시키는, labeling이 필요하다.Regression vs Classification연속적인 labels들에 대해 정확한 값을 예측하는 모델이다.Linear regre

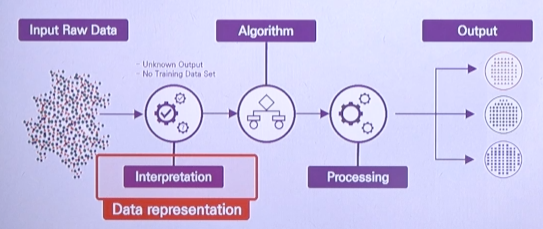

3.1-3. What is Unsupervised learning

Label이 제공되지 않는 dataset에서 의미 있는 정보(or pattern)을 찾는 것이 목적이다.업로드중..

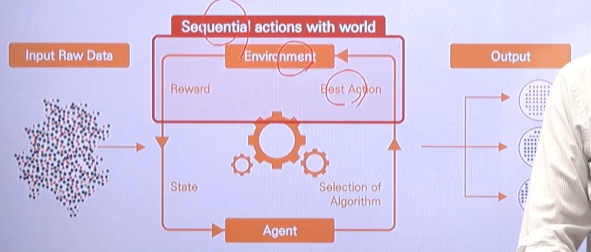

4.1-4. What is Reinforcement learning

어떠한 상황에서 어떠한 액션을 취할 때 reward가 지급이 되는데 누적되는 reward가 최대가 되는 즉, 최적의 action을 선택하도록 하는 agents를 학습을 하는 것이 주된 목적이다.interaction 기반연속된 최적의 결정들의 만들어내는 것이 목표ex)

5.2-1. Deep Learning

Data가 증가할수록 나은 성능을 보여준다.Fast hardware(GPU), Big Data, Algorithm 이렇게 3가지 요소들이 현대에 들어서 발전하면서 Deep Learning이 뜨고 있다.Machine Learning에서는 Feature extraction

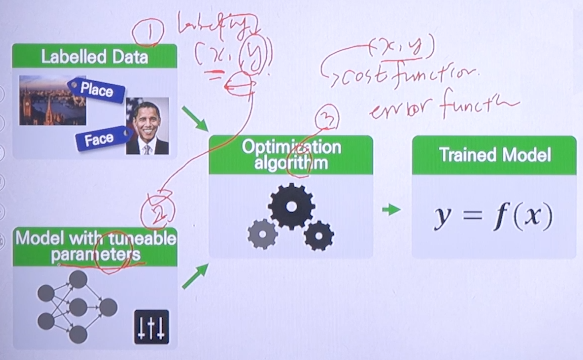

6.3-1. Steps of Supervised Learning

3 Steps in Supervised Learning

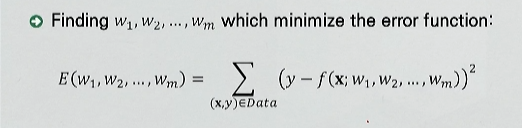

7.3-2. Simple Optimization Examples

주어진 y가 있고 w1,w2,...w(m)이 주어져있을 때 w값을 조절하면서 Error를 최소화해야 한다.쉽지 않은 과정이다.쉬운 예를 들어 문제를 해결해보자해당 경우에서는 쉽게 찾을 수 있다.\-> 미분값이 0인, 즉 기울기 값이 0인 지점

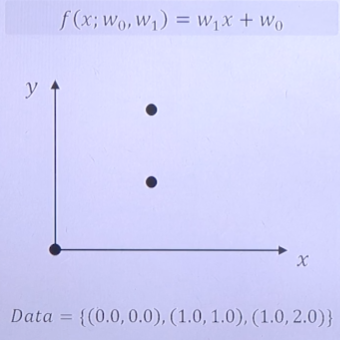

8.3-3. Simple Linear Regression

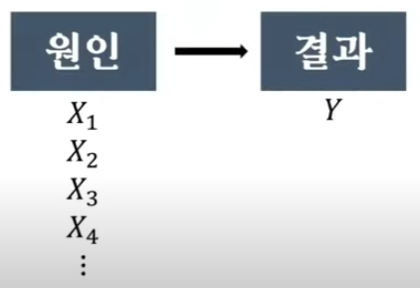

어떤 변수들이 한 변수의 원인이 되는지 분석하는 방법\-> 즉, 인과관계를 수학적으로 분석하는 것이다.(회귀 분석에 대해서는 따로 학습 필요)주어진 3개의 데이터들을 모두 잘 근접하는 선형 모델의 W0, W1을 구해보자3개의 점을 모두 지나는 선형을 찾는 것은 불가능하

9.4-1. Gradient Descent Method

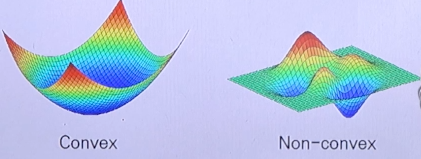

다음과 같은 경우는 최적의 해를 찾는 경우가 어렵거나 불가능할 수 있다.훨씬 많은 parameter를 가진 이차 방정식logistic regression 같은 모델Nonlinear functions (ex: neural networks)Gradient descent m

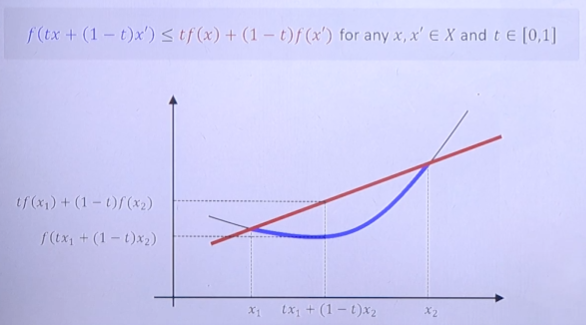

10.4-2. Convex Function

Convext Function(볼록 함수)임의의 두 점에 대해서 아래와 같은 식을 항상 만족하는 함수 Quadratic function : f(x) = x^2Exponential function : f(x) = 2^xNegative logarithm function :

11.4-3. Linear Regression using the Gradient Descent Method

주어진 데이터들에 맞는 적합한 데이터 Linear model을 찾아야 한다.주어진 Error function을 Gradient Descent 방법을 이용해보자(중간 과정 3-3 참고.)W0와 W1에 대해 Parallel하게 Gradient Descent 방법 반복Err

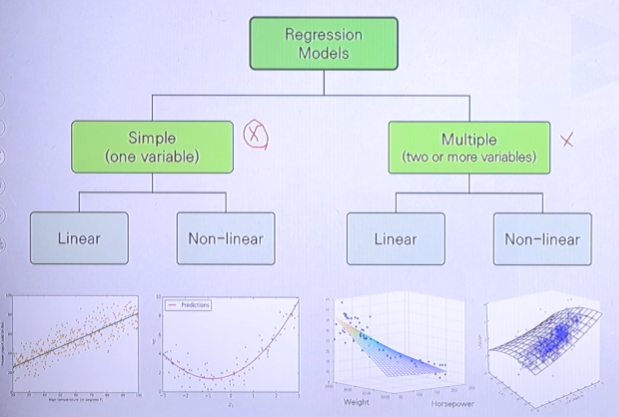

12.5-1. Linear of Regression Models

하나 이상의 x와 그 x에 따른 y 값의 관계를 추론하는 데이터 모델이다.이때 y는 continuous한 값이다.n개의 데이터가 주어져 있을때 이 데이터들을 최대한 잘 설명하는 선형 모델을 찾아야 한다.실제 값과 예측 값 사이에서 최소화된 RSS(residual sum