Ustage Week4 - NLP

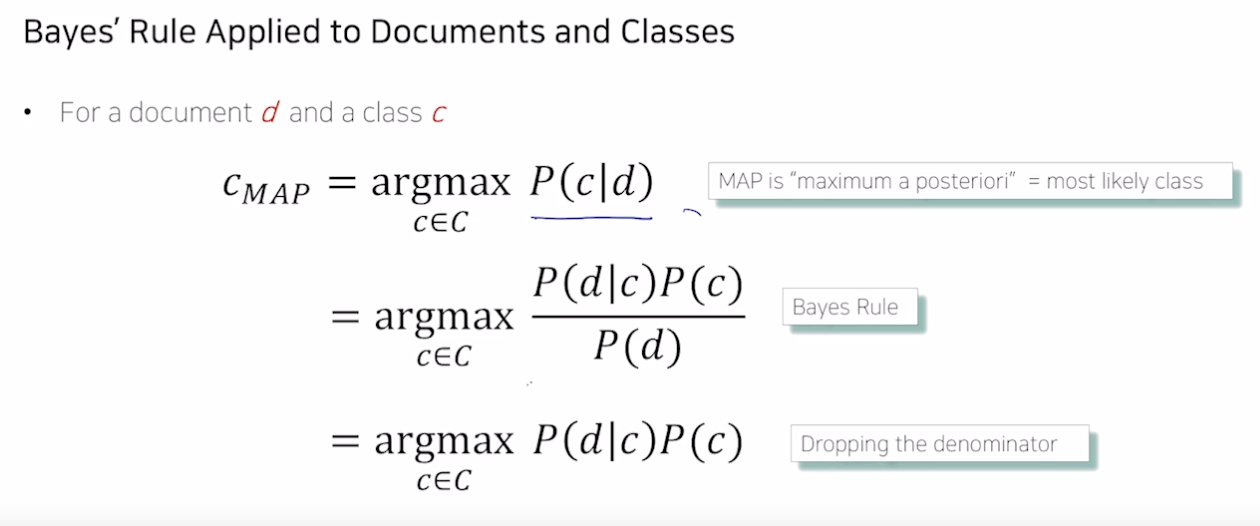

1.NLP 기본

Natural Language Processing

2021년 3월 7일

2.단어 분석 방법 (BOW, Word2Vec, GloVe)

Bag of Words, Word2Vec, GloVe

2021년 3월 7일

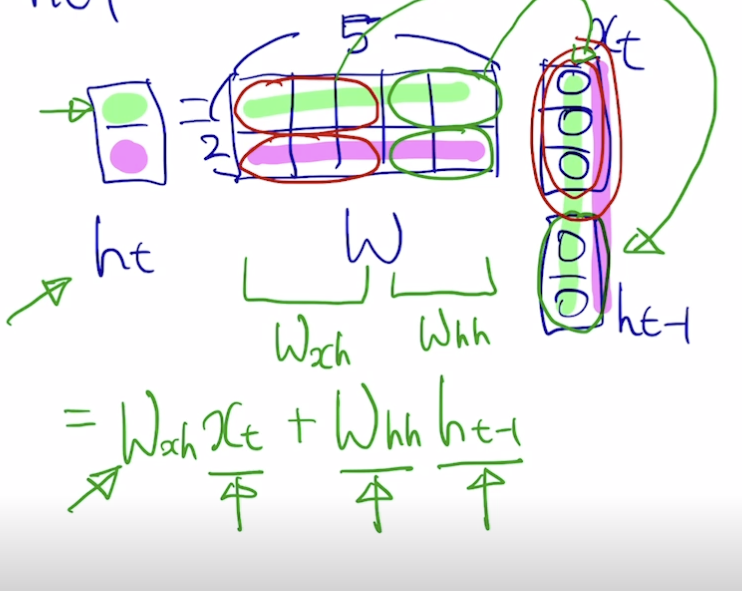

3.# RNN and Language Modeling

시퀀스 입력 데이터 학습 방법

2021년 3월 7일

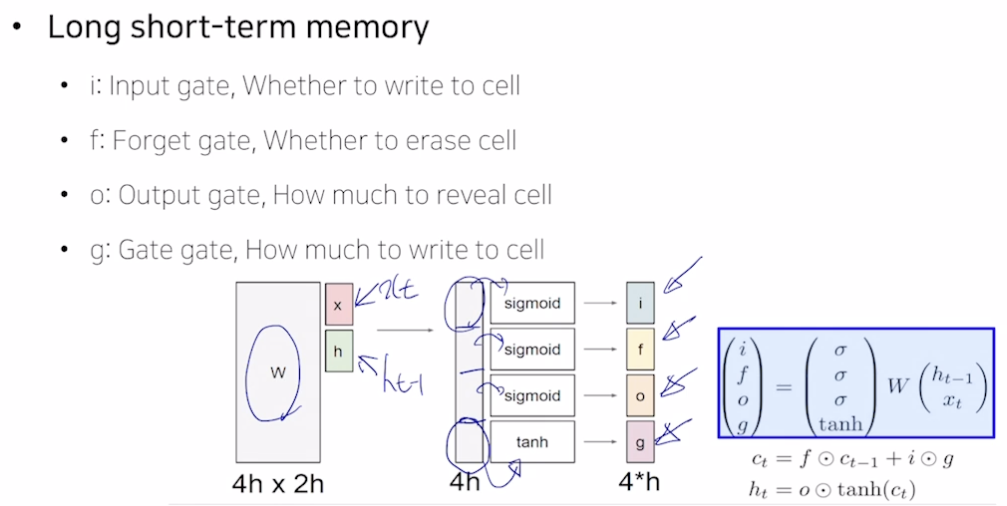

4.LSTM and GRU

단기 기억을 길게 보관할 수 있도록 만든 소자

2021년 3월 7일

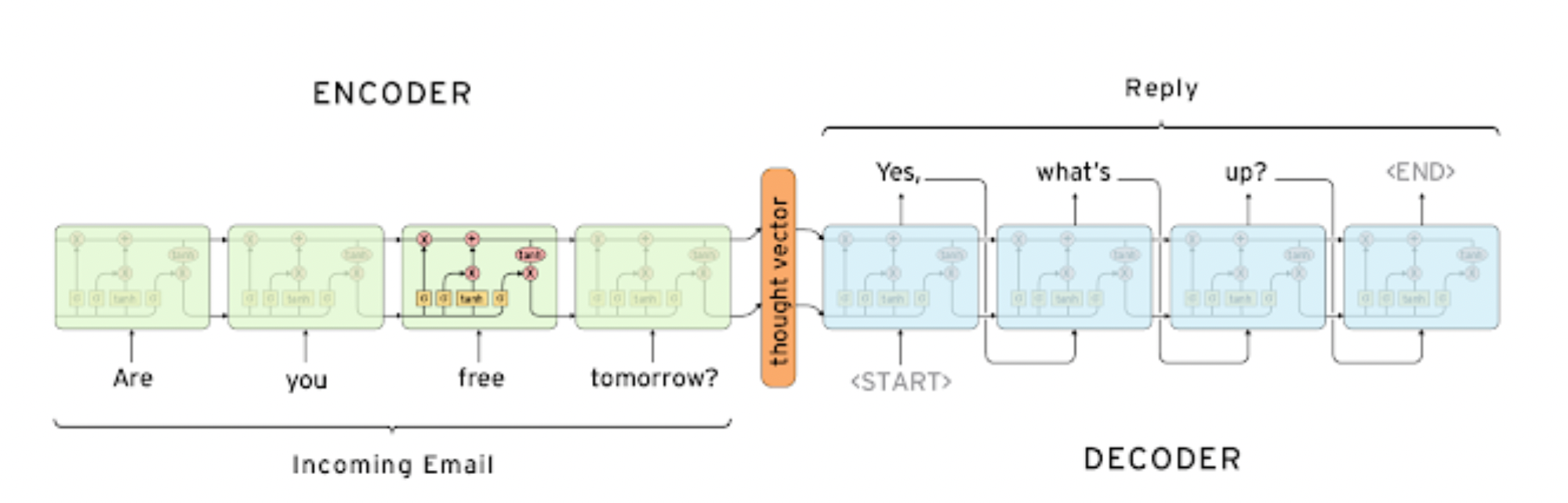

5.Sequence to Sequence with Attention

Sequence to Sequence with Attention, 어텐션의 등장

2021년 3월 7일

6.Beam Search and BLEU

번역 성능 향상 기법과 번역 성능 지표

2021년 3월 7일

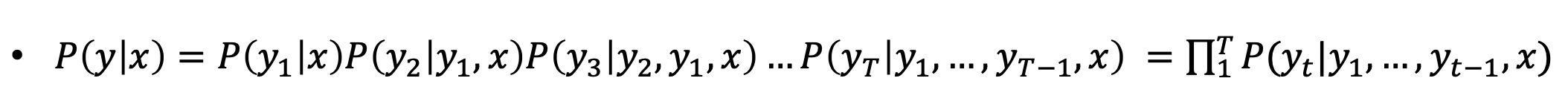

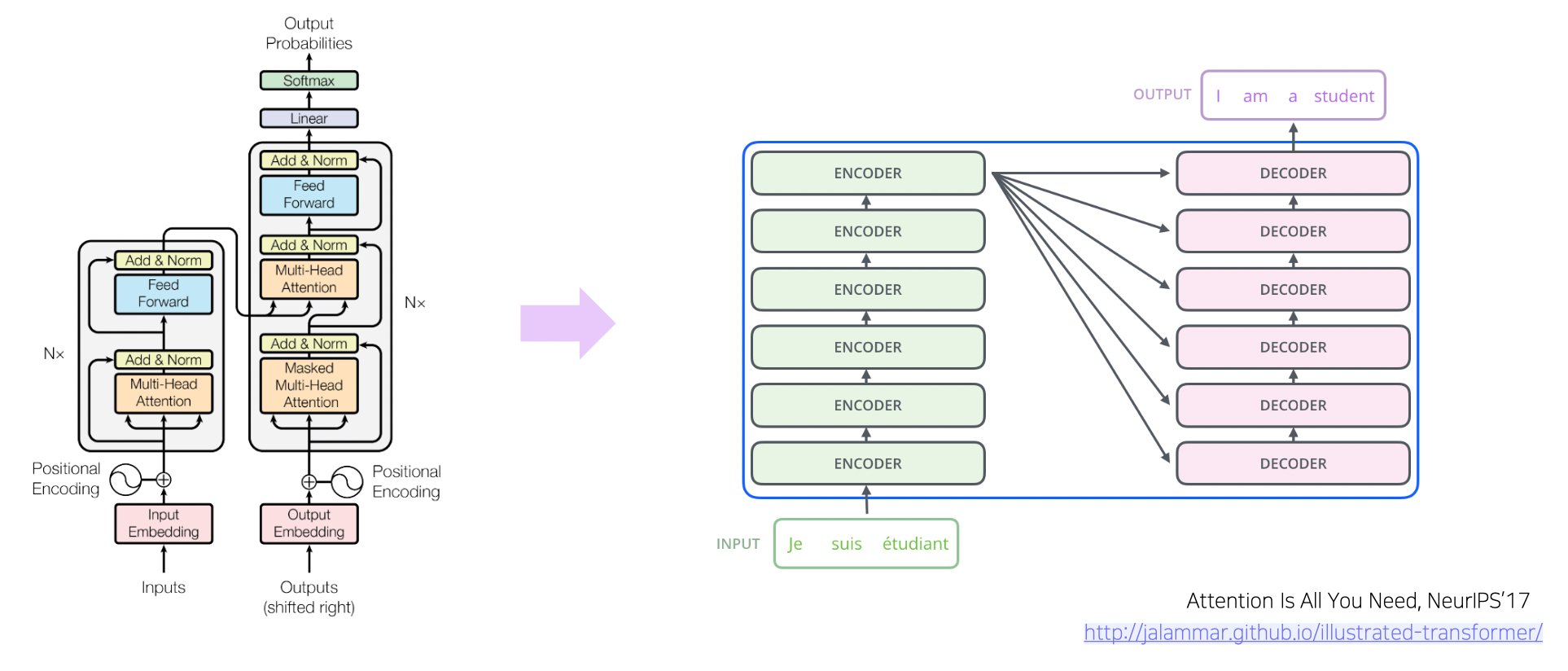

7.Transformer

Transformer

2021년 3월 7일

8.Byte Pair Encoding

Byte Pair Encoding

2021년 3월 7일

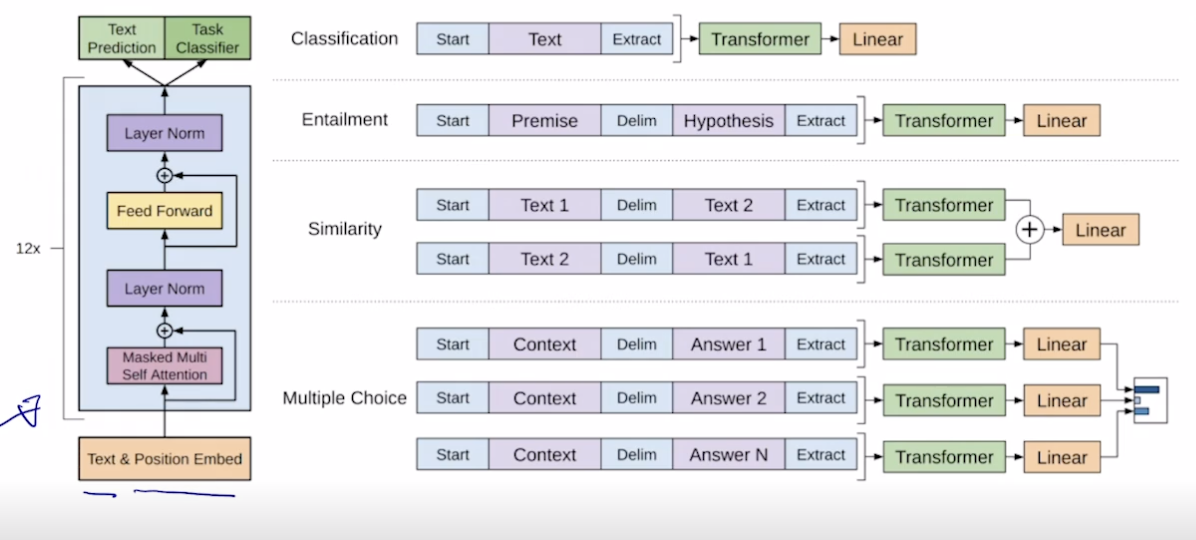

9.Self-Supervised Pre-training Models (GPT, BERT...)

트랜스포머의 Self-Attention으로 모델을 구성하는 방법은 NLP 의 트렌드가 됨

2021년 3월 7일