Deep Learning

1.[Deep Learning] Chapter 2 - Machine Learning Basics

초기 AI는 인간에게는 어렵지만 컴퓨터에게는 쉬운 문제를 주로 다루도록 설계되었다. 반면 현대 AI는 직관적이지만 표현하기 어려운 문제(Easy to Human, Hard to Computer)를 다루도록 설계되고 있다.Machine Learning(기계 학습)의 정의

2.[Deep Learning] Chapter 3 - Neural Networks

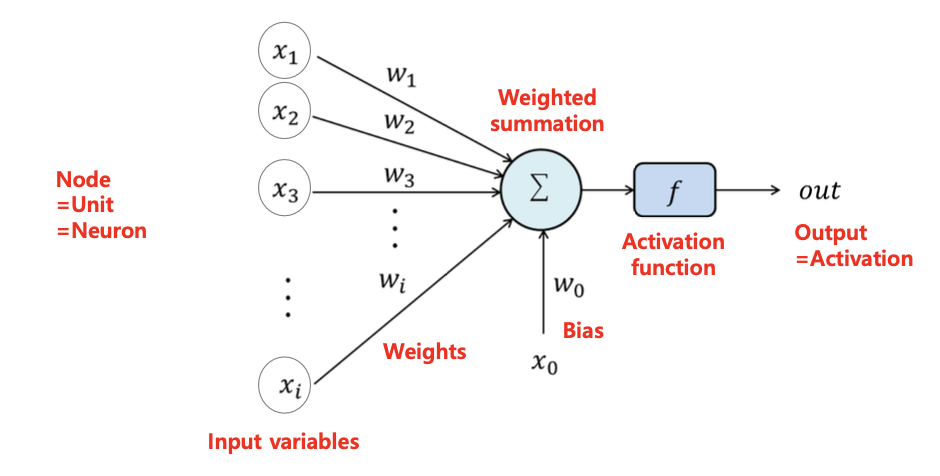

Neural Networks (뉴럴 네트워크) : 인간의 뇌 뉴런 구조를 수학적으로 모방한 모델로, 여러 개의 간단한 연산 단위(노드, 뉴런)이 연결되어 복잡한 함수를 근사한다.뉴럴 네트워크는 입력층 - 은닉층 - 출력층 구조를 갖는다.각 노드들은 서로 연결되며, 각

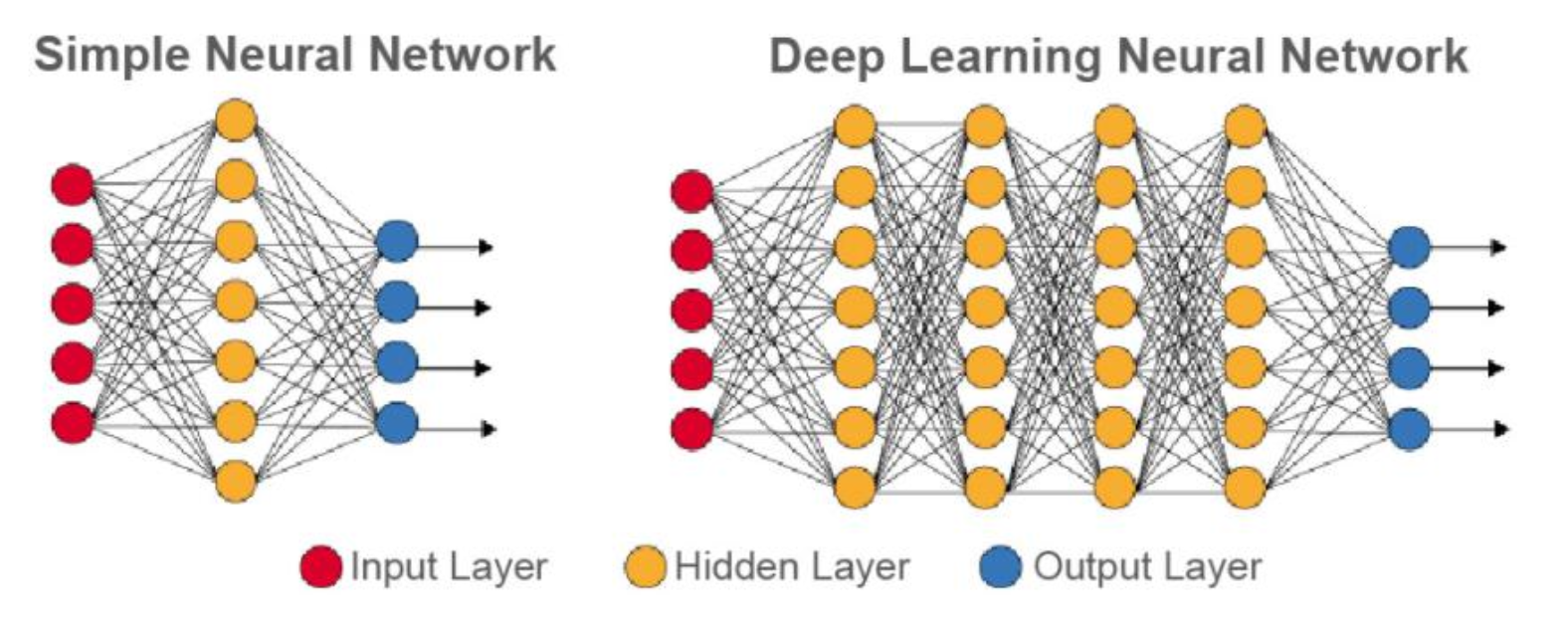

3.[Deep Learning] Chapter 4 - Deep Neural Networks

Deep Neural Networks(DNN)이란, 단순한 뉴럴 네트워크보다 많은 은닉층이 존재하는 뉴럴 네트워크이다.Model Capacity가 증가(More connections)할수록, 계산량이 증가하고 더욱 복잡한 함수를 근사할 수 있게 된다.이때, 단 1개의

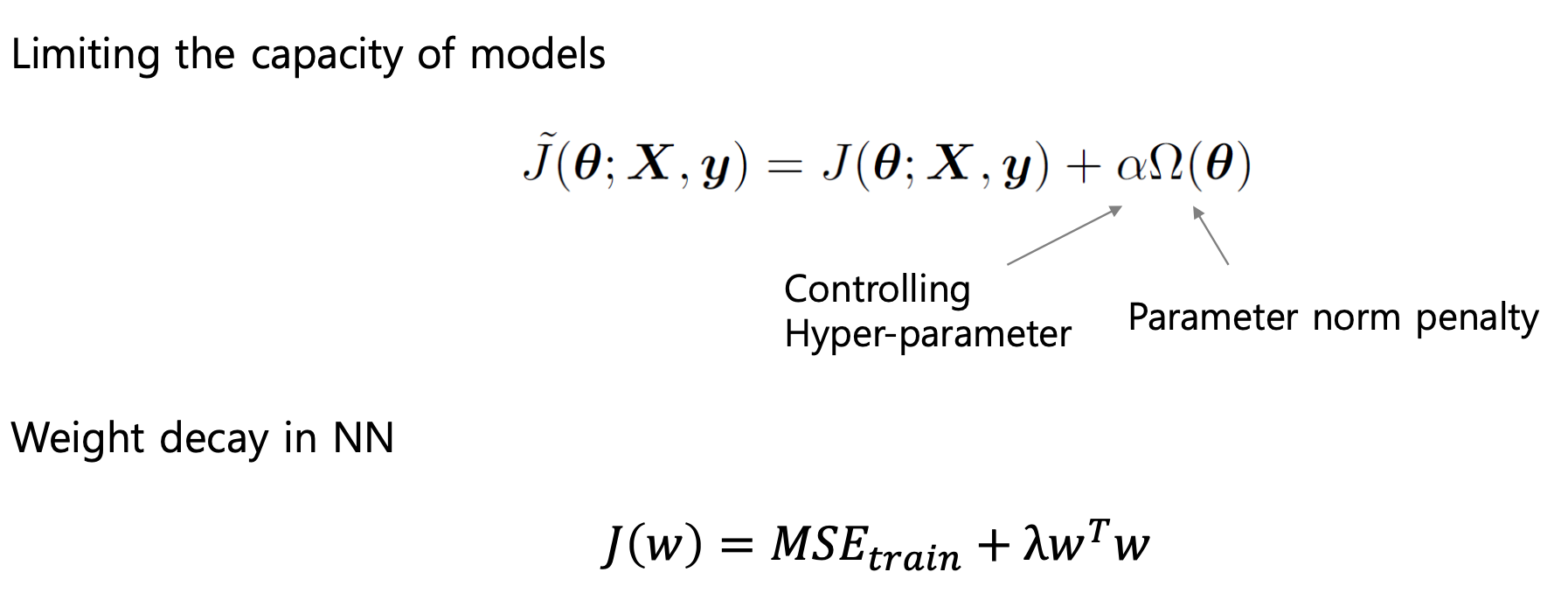

4.[Deep Learning] Chapter 5 - Regularization and Optimization

머신러닝은 학습 데이터과 새로운 데이터 모두에 대해 성능이 좋은(일반화 능력이 좋은) 모델을 만드는 것을 목표로 한다.Regularization(정규화)란, 일반화 성능을 높이기 위해 과적합을 방지하는 기법이다. 단순히 적절한 크기와 적절한 파라미터 수를 가진 모델을

5.[Deep Learning] Convolutional Neural Networks

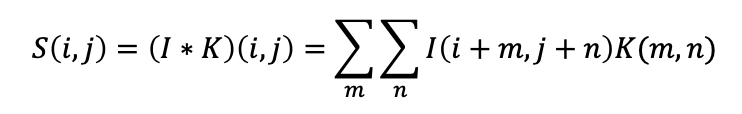

Convolutional Neural Networks Convolutional Neural Netwokrs(CNN, 합성곱 신경망)이란 이미지 처리, 음성 인식 등 공간적-시간적 규칙성이 있는 데이터를 효율적으로 처리하는 데 최적화된 딥러닝 아키텍처이다. CNN은

6.[Deep Learning] Sequence Model - RNN

Recurrent neural networks (RNN) 재귀 신경망(RNN)은 시계열 데이터나 자연어 처리처럼 순차적인 입력 데이터를 처리하기 위해 설계된 신경망이다. RNN은 입력 데이터의 길이가 길어져도 연속적으로 연결된 상태를 유지하며 처리할 수 있다. R

7.[Deep Learning] Sequence Model - Transformer

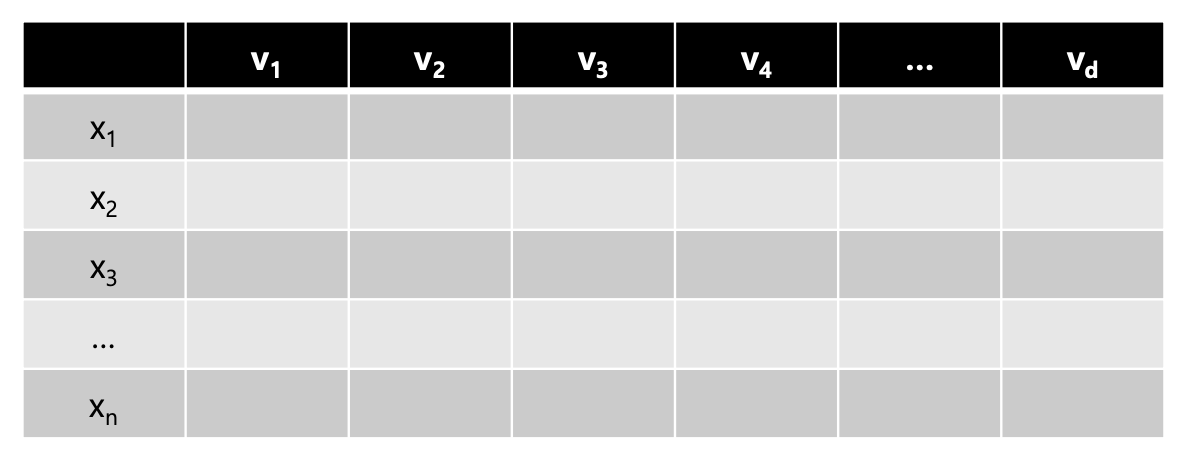

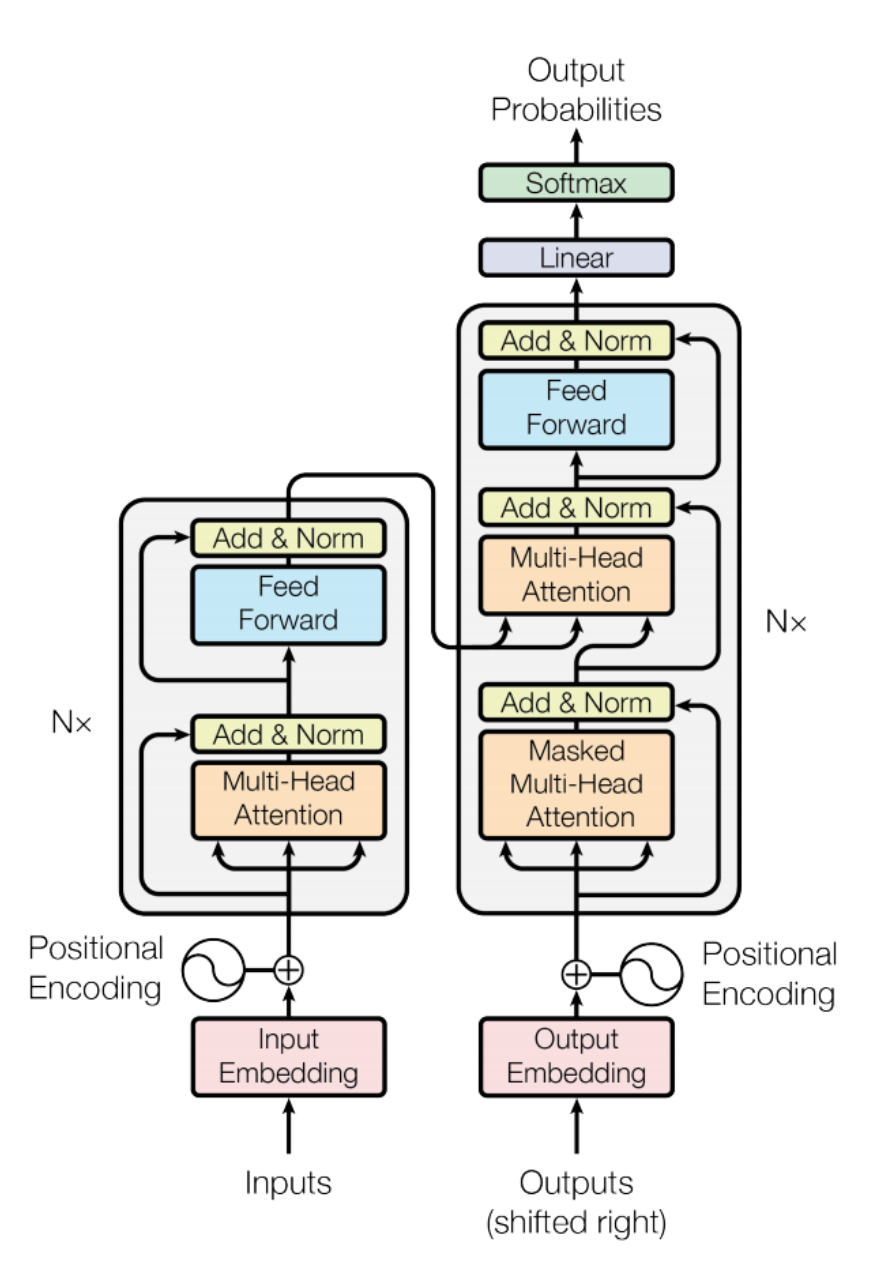

Transformer란, "Attention is All You Need"라는 논문에서 제안한 네트워크 구조로, 순수 어텐션 메커니즘만으로 구현된 인코더와 디코더를 사용한다는 특징이 있다.Self-attention은 입력의 각 단어가 다른 단어들과 어떤 관련이 있는지를

8.[Deep Learning] Generative Model - Autoencoder

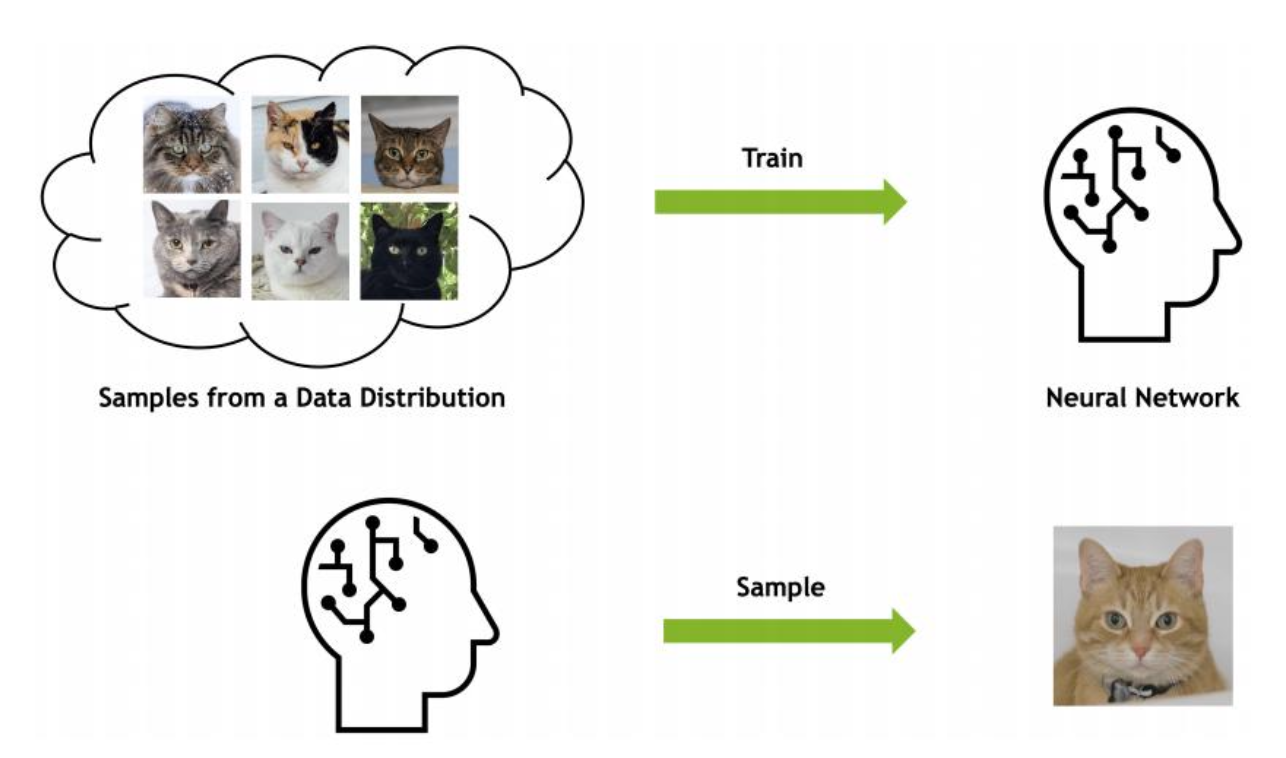

일반적인 분류 모델은 입력 데이터 $x$로부터 정답 $y$를 예측하는 데 집중한다. 즉, 클래스를 구분하는 경계를 찾는 것을 학습 목표로 한다.이와 달리 생성형 모델은 실제 데이터의 분포 자체를 학습하는 것을 목표로 하며, 정답 $y$에 대한 입력 분포 $x$를 추정하

9.[Deep Learning] Generative Model - GAN

GAN은 두 개의 신경망이 서로 경쟁하면서 학습하도록 설계된 네트워크이다.생성 모델 $G$는 데이터의 분포를 학습하여 진짜 데이터의 분포와 비슷한 가짜 데이터 분포를 생성한다.판별 모델 $D$는 이 데이터 분포가 진짜인지, 생성 모델이 생성한 가짜인지 판별한다.두 모델

10.[Deep Learning] Generative Model - Diffusion Model

Denoising diffusion probabilistic models(DDPM)은 다음 두 과정을 거치며 데이터의 분포를 학습하는 생성형 모델이다.노이즈를 추가하는 Forward process노이즈를 제거하며 원본으로 복원하는 Reverse Diffusion pro