Machine Learning

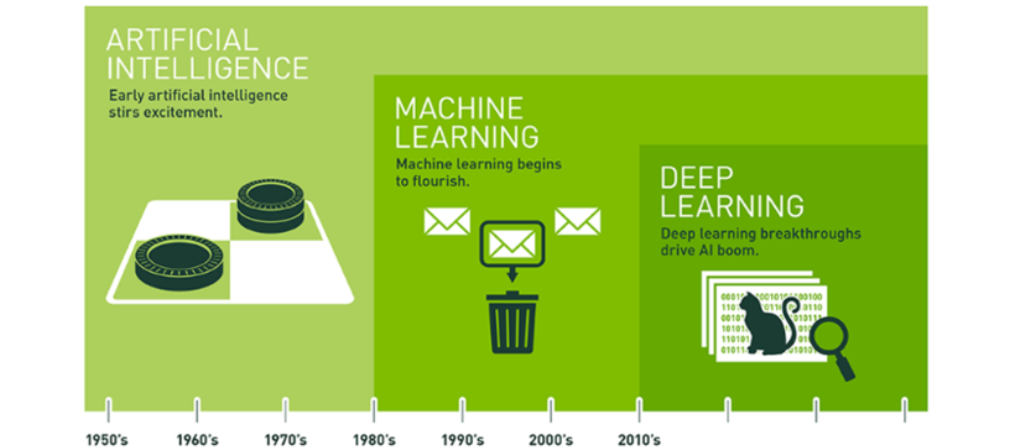

1.ML 1) What is Machine Learning?

안녕하세요! 올해들어 본격적으로 Data Science를 공부를 시작하면서, 항상 구글링을 하며 접하게 되는 블로그 글들을 보며, 막연하게 나도 저런 블로그를 가져보고 싶다라고 생각만 하다가, 여름방학을 맞이해 직접 계획에 옮기기로 결심했으나.. 계절학기로 인해 미루고

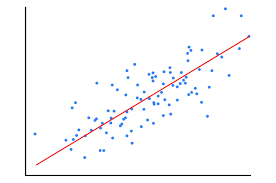

2.ML 2) Linear Regression, Gradient Descent

ML 포스팅은 한학기동안 머신러닝 스터디를 하며 공부한 내용을 바탕으로 하였으며, O’Reilly Hands-On Machine Learning with Scikit-Learn, Keras, and TensorFlow, 2nd Edition을 기반으로 하고 있습니다.1

3.ML 5) Decision tree

ML 포스팅은 한학기동안 머신러닝 스터디를 하며 공부한 내용을 바탕으로 하였으며, O’Reilly Hands-On Machine Learning with Scikit-Learn, Keras, and TensorFlow, 2nd Edition을 기반으로 하고 있습니다.1

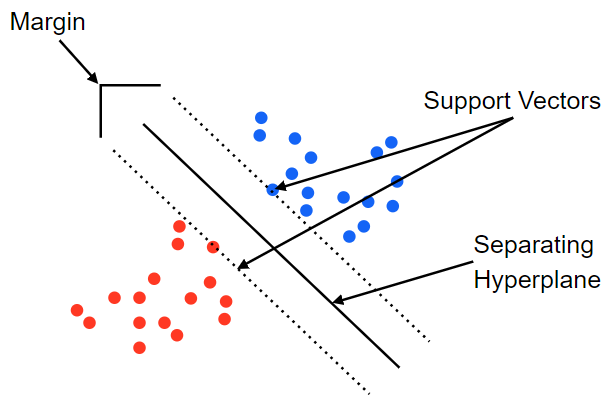

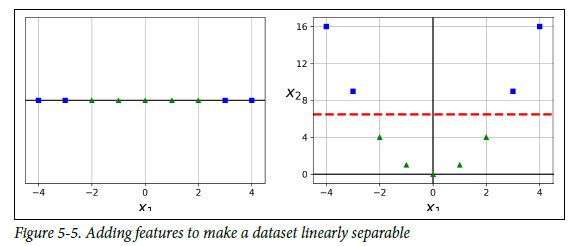

4.ML 4) Support Vector machine - 1

ML 포스팅은 한학기동안 머신러닝 스터디를 하며 공부한 내용을 바탕으로 하였으며, O’Reilly Hands-On Machine Learning with Scikit-Learn, Keras, and TensorFlow, 2nd Edition을 기반으로 하고 있습니다.1

5.ML 4) Support Vector machine - 2

ML 포스팅은 한학기동안 머신러닝 스터디를 하며 공부한 내용을 바탕으로 하였으며, O’Reilly Hands-On Machine Learning with Scikit-Learn, Keras, and TensorFlow, 2nd Edition을 기반으로 하고 있습니다.1

6.ML 6) Ensemble

ML 포스팅은 한학기동안 머신러닝 스터디를 하며 공부한 내용을 바탕으로 하였으며, O’Reilly Hands-On Machine Learning with Scikit-Learn, Keras, and TensorFlow, 2nd Edition을 기반으로 하고 있습니다.1

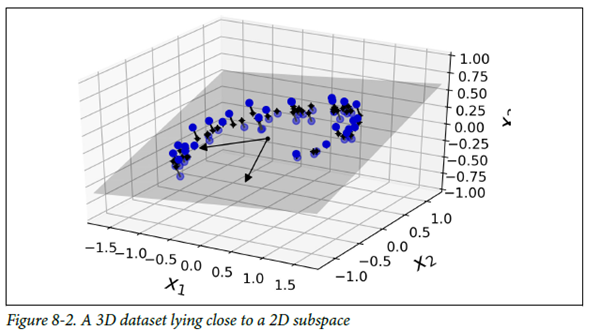

7.ML 7) Dimension Reduction

ML 포스팅은 한학기동안 머신러닝 스터디를 하며 공부한 내용을 바탕으로 하였으며, O’Reilly Hands-On Machine Learning with Scikit-Learn, Keras, and TensorFlow, 2nd Edition을 기반으로 하고 있습니다.1

8.LigthGBM

Lgbm의 등장배경 : XGBoost의 장점을 그대로 활용하면서, 학습시간을 단축시키자! 전통적인 Gradient Boosting Algorithm의 경우, 각 변수마다 가능한 모든 분할점에 대한 information gain을 평가하려면, feature 즉, d