Machine Learning Theory

1.머신러닝 기초

푸념: 6시간 동안 작성한 임시 글이 초기화되었다. 아마 PC 2개를 바꿔가며 작성하다가, 다른 PC에서 작업하던 중, 마지막에 작성한 글보다 한시점 앞선 내용으로 자동으로 백업된 것 같다. 임시저장 기능은, velog-backup을 가져와서 백업해둬야 할 것 같다.

2.목적함수(Objective Function)

KeywordsObjective FunctionMSEIndependent Variable, Dependent Variable Regression 신경망의 학습능력을 평가하는 지표이다. 출력층의 예측값 (가중치+편향)과 실제값의 차이를 수학적으로 접근하는 기법이다. Th

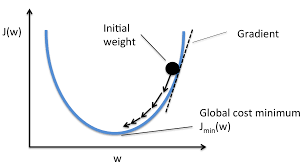

3.Gradient Descent (경사하강법)과 기초 수학

Keywords Gradient Descent (경사하강법)은 예측값과 타겟값의 차이를 최소 또는 0으로 만들기위해 사용되는 테크닉중 하나이다. (머신러닝의 기본은 최적값, Optimization을 하는 과정) 아래 키워드는 Gradient Descent를 이해하기위

4.Gradient Descent 모델 구현

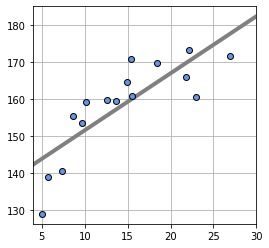

나이를 기준으로, 키를 예측하는 선형 예측 회귀 모델을 생성하자. 목표: 오차함수로, MSE를 사용하고 오차를 줄이기 위해 Gradient Descent를 사용하자. 모델 구현의 편의를 위해, Feature Vector(나이)의 차원은 1D로 사용한다. 사용될 데이터는

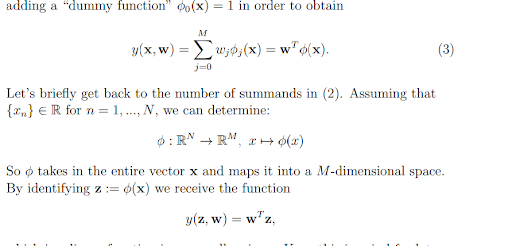

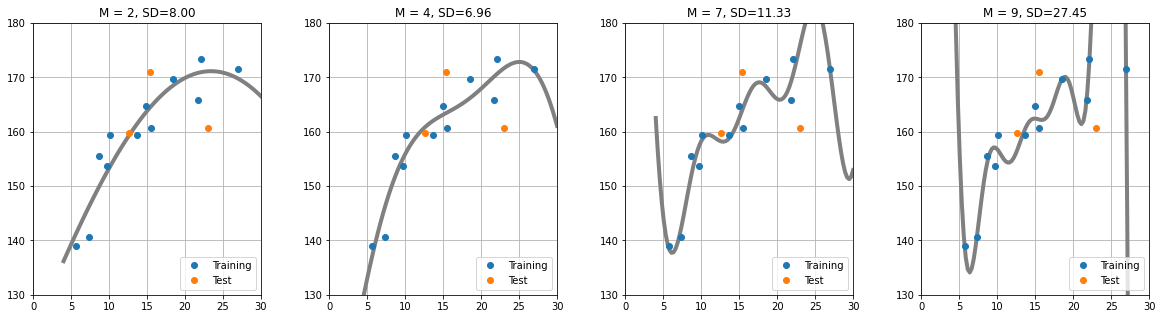

5.선형 회귀 모델: Basis Function

Keywords D-dimensional Linear Regression Model Linear Combination Basis Function Gaussian Basis Loss Function with Gaussian (Utilizing MSE) Analyti

6.선형 회귀 모델: Basis Function의 해석해

기저 함수 모델의 해석해를 구하는 증명을 해보자. Analytical Solution (해석해) - 정확한 해를 구함Numerical Solution (수치해) - 근사치를 구함.기저 함수의 MSE 해석해D차원 선형 회귀 모델의 평균 제곱 오차 J의 해석해$J(w) =

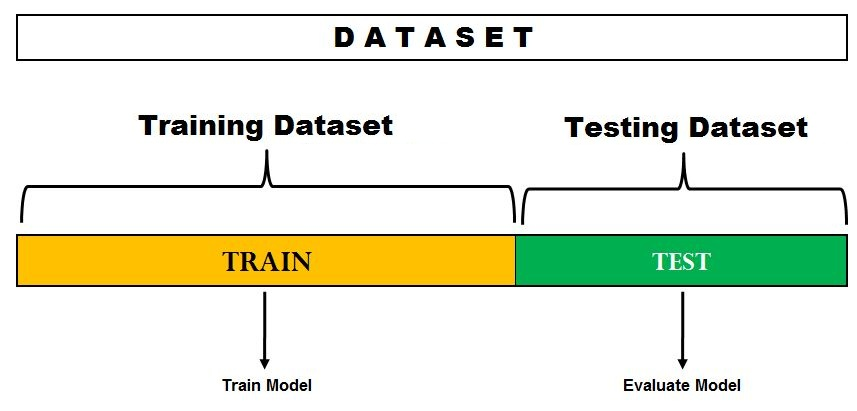

7.모델 성능 검증(Holdout, Cross Validation)

하나의 데이터셋에서 Training과 Test를 수행하게 되면, 그 모델은 오버피팅 이슈에 빠질 수 있다. 학습이 과도하게 진행 되었을 때, 학습 데이터에 대해서는 오차가 감소, 외부 데이터에 대해서는 오차가 커지는 이슈.아래는 Gaussian Linear Basis를

8.모델 성능 검증 실습

잡담너무 힘들다ㅠㅠ 지금까지처럼, 포기하지않고 열심히 하면 언젠가 보상받는 날이 오겠지? 비록 20대만큼의 액티브한 인생은 아니지만, 30대의 또 하나의 거대한 목표를 이루기위해 열심히 달리자. 아자아자 ! 영어로 말하기 (완료)많은 나라 돌아다니기 (완료)한 분야의

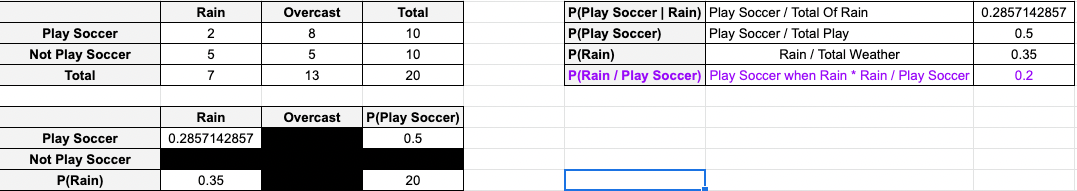

9.Classification: 분류와 알고리즘

Classification > Classification is a process of categorizing a given set of data into classes. It can be performed on both structured or unstructured

10.Classification: 2클래스 분류

문제 정의 임의의 곤충의 무게 $x$에 대해, 성별 $T$를 예측하는 모델 $T$ = {0: 암컷, 1: 수컷} 입력 데이터 생성하기 그래프로 독립변수 x(곤충의 무게)에 대한 종속변수 T (성별)을 출력해보면, 다음과 같이 0 또는 1의 함수값을 가지는 그래프

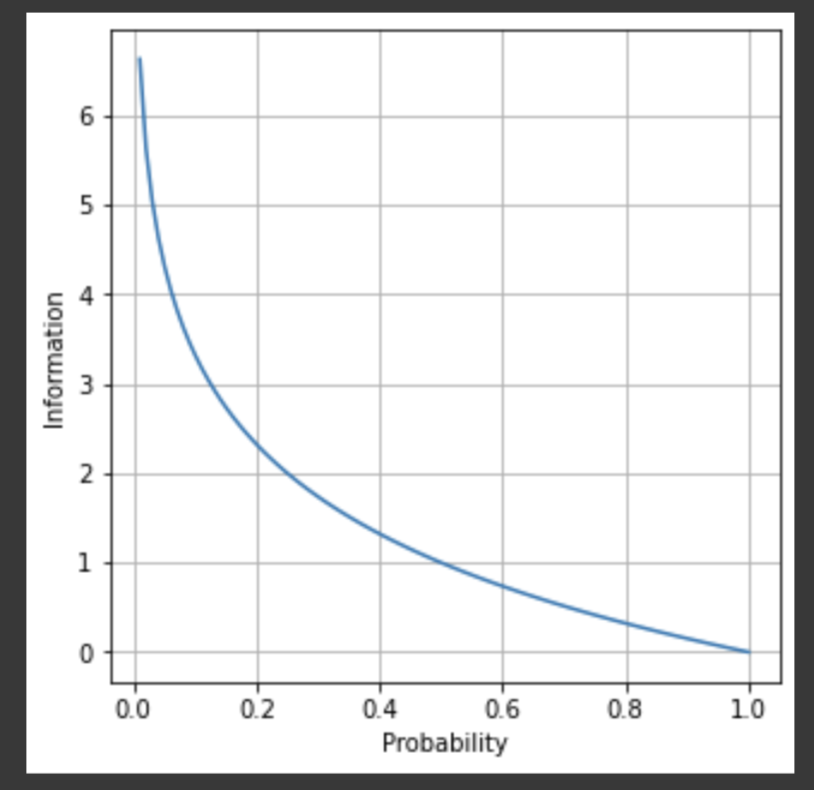

11.Classification: Cross Entropy (교차 엔트로피)

사건의 정보량이 크다는 의미, 그 사건 발생을 경험할 확률 및 빈도가 낮다라는 뜻이다. 아래 예시를 보고, 친구들과 가위바위보를 했을때 정보량을 비교해보자. Q. 사건 A와 B중, 어떤 것의 정보량이 더 높을까? A: 친구 1명과, 가위바위보를 했을때, 내가 이겼다 !

12.딥러닝과 인공신경망: 퍼셉트론과 활성화 함수

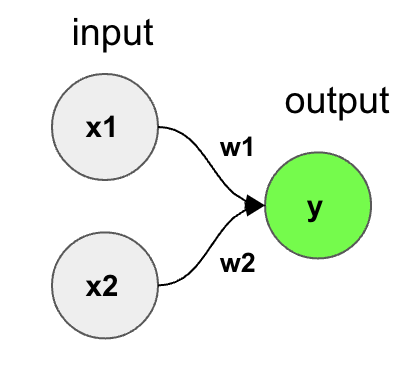

퍼셉트론은 신경망의 기원이 되는 알고리즘이다. $y= x_1w_1+x_2w_2 + b$ 이며, 가중합의 결과에 따라 y 출력이 1 또는 0으로 정해진다. x1, x2: 입력w1, w2: 가중치b: 편향아래의 논리게이트를 퍼셉트론으로 구현해보자.AND Logic Gat

13.딥러닝과 인공신경망: 신경망의 구조

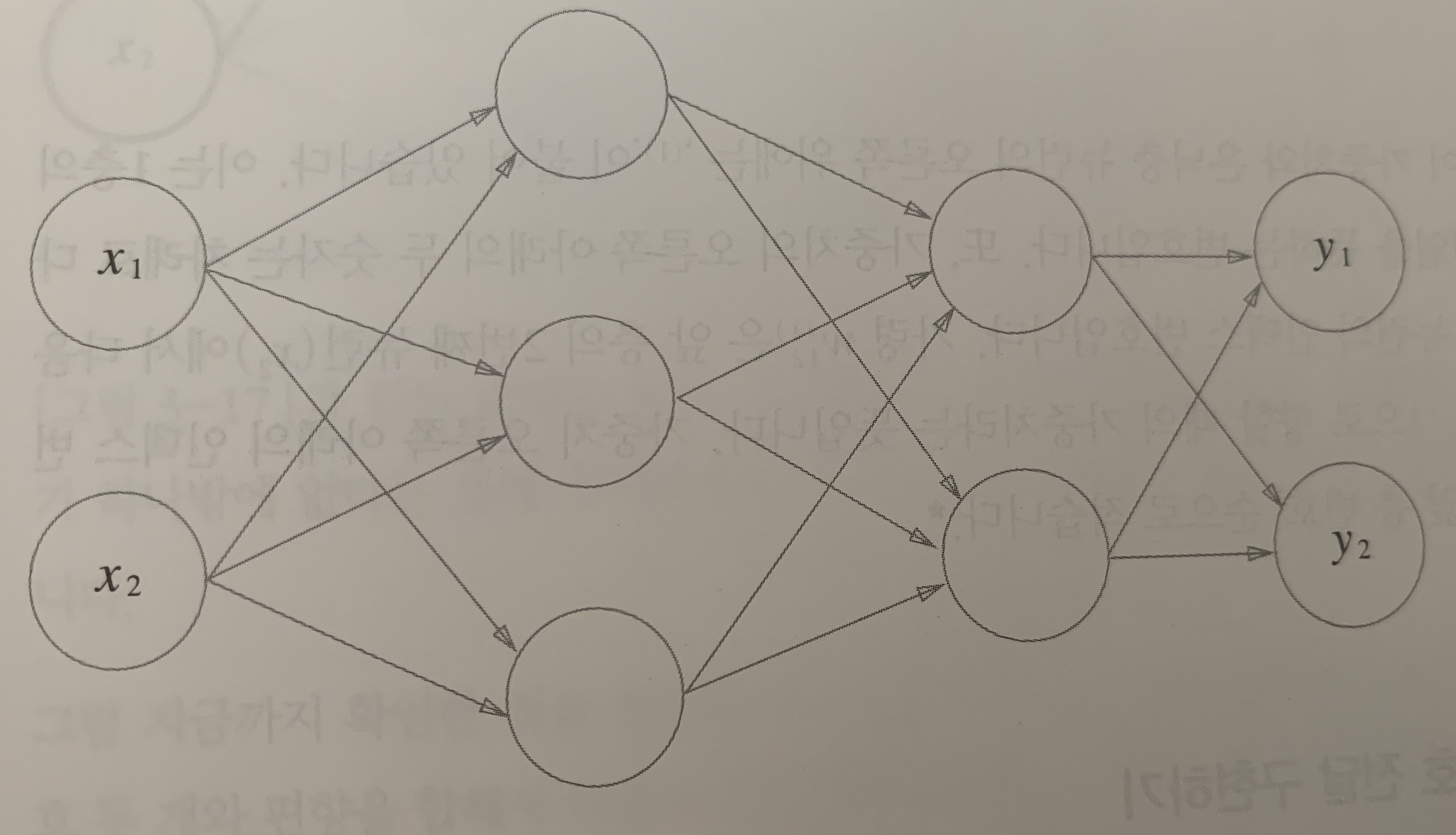

신경망은 다음과 같이, 입력층, 은닉층, 출력층으로 나눌 수 있다. 입력층에서 출력층까지 순방향(foward)으로 신호가 전달되는 구조이다. 최종적으로, 가중치 w를 학습하고 최적화된 w를 찾는것이 목적이다. 아래는, 입력층 $\\rightarrow$ 은닉층 $\\r

14.딥러닝과 인공신경망: 계산 그래프로 오차 역전파 이해하기

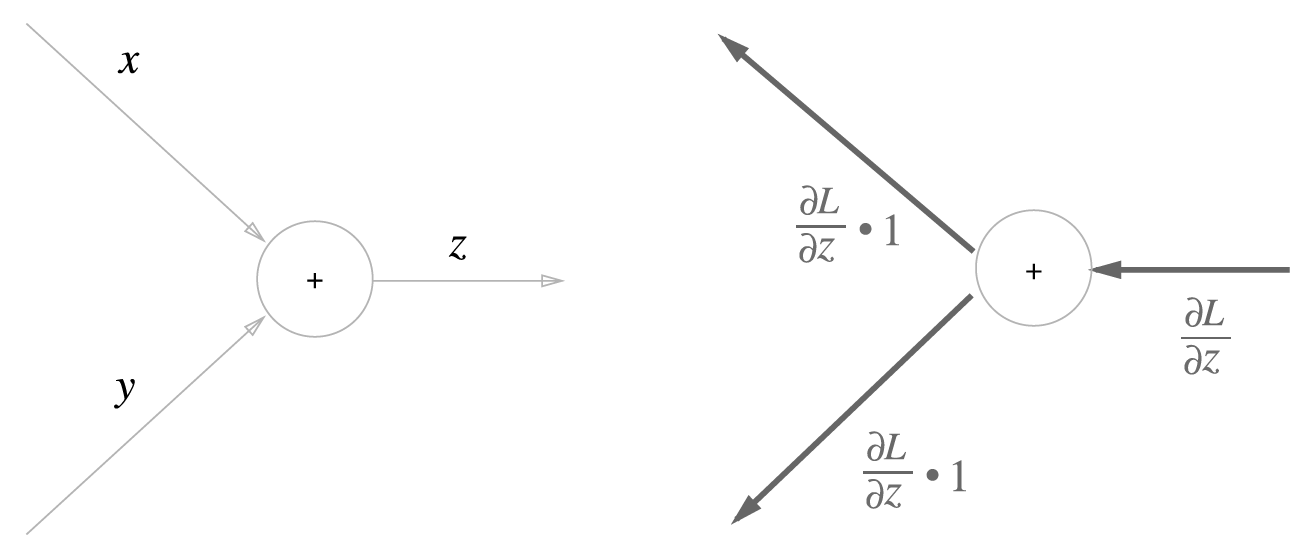

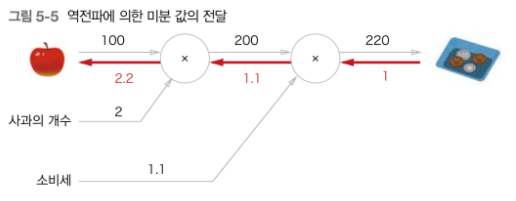

가중치 매개변수의 기울기를 계산하는 방법이다. "역으로 전파한다"라는 의미로 계산그래프를 통해 이해한다. 계산과정을, 노드와 화살표로 표시한다. $z$ = $x + y$일때, $x$와 $y$에 대한 미분값은 아래와 같다. $\\sigma z \\over \\sigma

15.딥러닝과 인공신경망: Forward 와 Backward를 활용한, 계산 그래프 구현하기

순전파(Foward)와 역전파(Backward) 코드로 구현해보자.

16.딥러닝과 인공신경망: 활성화 함수의 역전파 구현하기

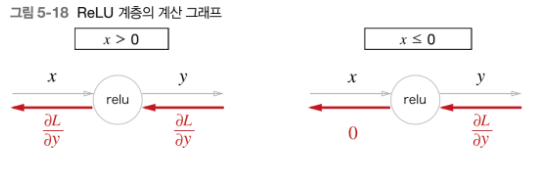

신호를 다음 뉴런으로 보내기 위해, 활성화 함수를 거친다. 즉 신호는, 활성화 함수를 거쳐서 순전파 되기때문에, 활성화 함수 또한 역전파를 거친다는 의미를 지닌다. 이번 포스팅은, 신호를 활성화 함수에 전달하여, 순전파와 역전파가 어떻게 작동하는지 알아보도록 한다. R

17.딥러닝과 인공신경망: Affine 계층과 Softmax and Loss 계층 구현

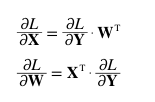

입력 신호가 행렬이고, 다음의 뉴런으로 순전파 될 때 행렬의 곱은 어떻게 처리되는지 그리고 주의해야할 점은 무엇인지 알아보도록 하자. Affine 계층 딥러닝에서 Affine 계층은 순전파시 행렬 곱을 수행하는 계층을 의미한다. 아래는 Affine 계층에서 행렬곱이

18.딥러닝과 인공신경망: 2층 신경망 구현하기

아래는 코드는, Affine Layer를 통해 추론과정을 하고 Softmax와 손실함수를 통해 정답 분포와 오차를 구한다음 역전파를 통해 가중치를 학습하는 과정을 간단하게 나타낸 코드이다. 활성화 함수 역전파 구현Affine 계층 구현하기mnist가 테스트 데이터셋으로