Machine-Learning

1.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 1-1 (K-MOOC)

머신 러닝에서 데이터는 정말 중요하다!

2.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 1-2 (K-MOOC)

머신러닝의 기초 지식에 대하여 작성하였습니다.

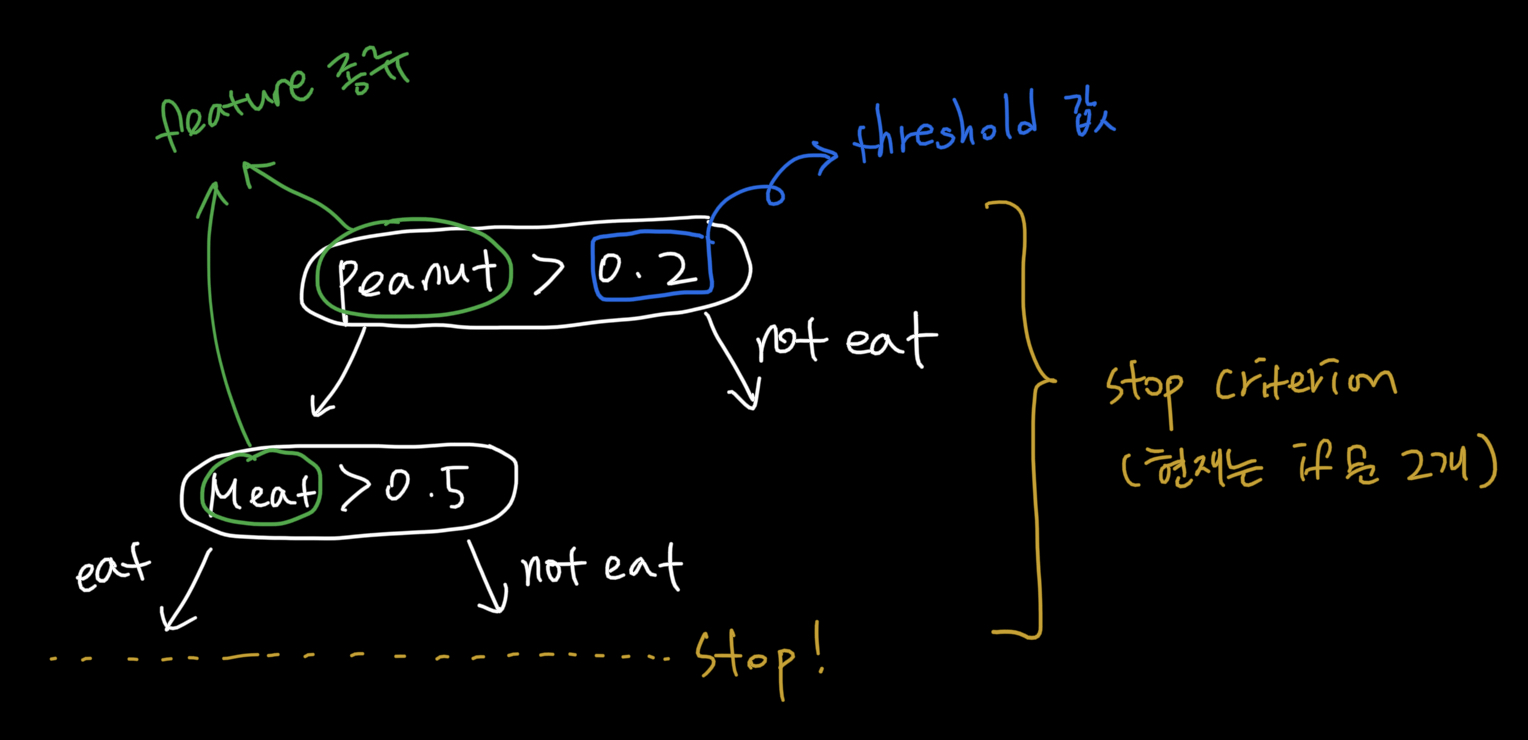

3.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 2-1 (K-MOOC)

Supervised Learning의 개념과 Decision Tree에 대한 내용을 작성하였습니다.

4.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 2-2 (K-MOOC)

지도 학습의 일반화에 대한 개념 및 모델의 일반화를 높이기 위한 방법에 대하여 작성하였습니다.

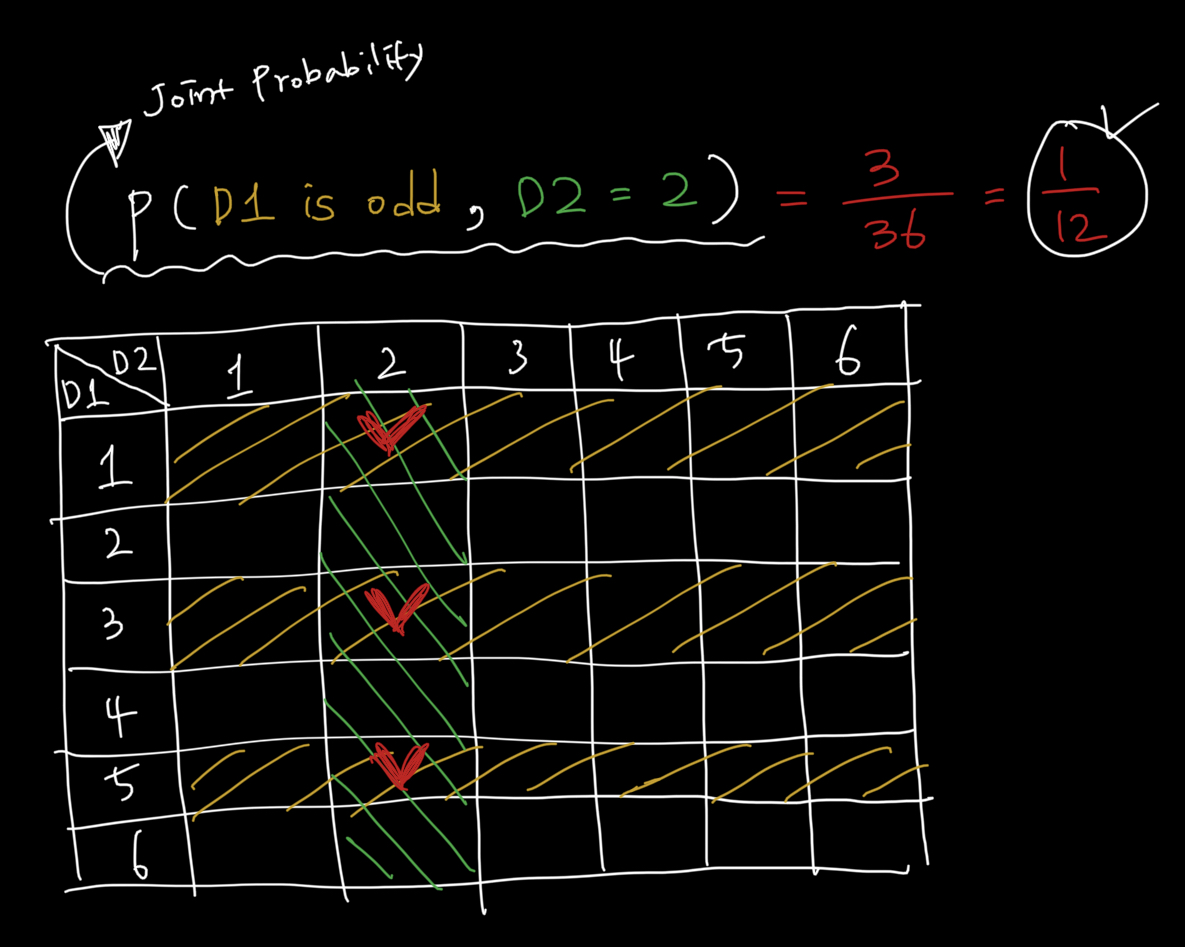

5.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 3-1 (K-MOOC)

머신러닝 모델의 성능을 확인하는 방법 & 머신러닝을 위한 기본적인 확률 개념 & 확률적 구분기의 기본 개념에 대하여 작성하였습니다.

6.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 3-2 (K-MOOC)

Bayes Rule & Naive Bayes에 대한 내용을 작성하였습니다.

7.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 4-1 (K-MOOC)

Decision Theory & Non-parametric Model & k-NN model 에 대하여 작성했습니다.

8.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 4-2 (K-MOOC)

Ensemble에 대한 내용을 작성하였습니다.

9.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 5-1 (K-MOOC)

Regression 에 대하여 작성하였습니다.

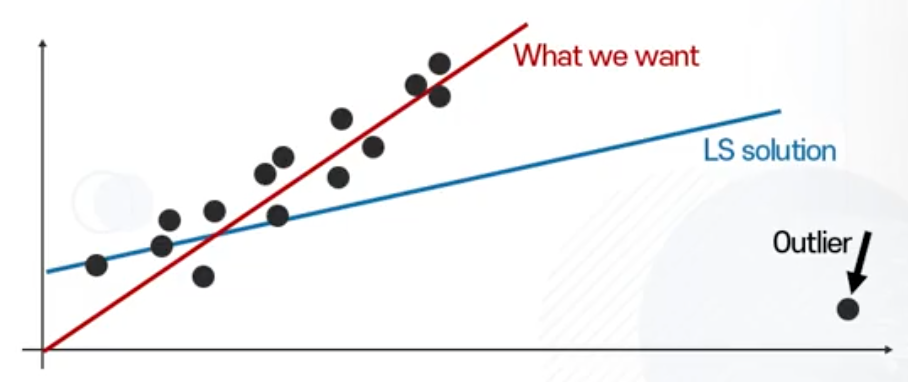

10.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 5-2 (K-MOOC)

Linear Regression Model Least Square

11.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 6-1 (K-MOOC)

linear classification에 대해서 알아봅시다!

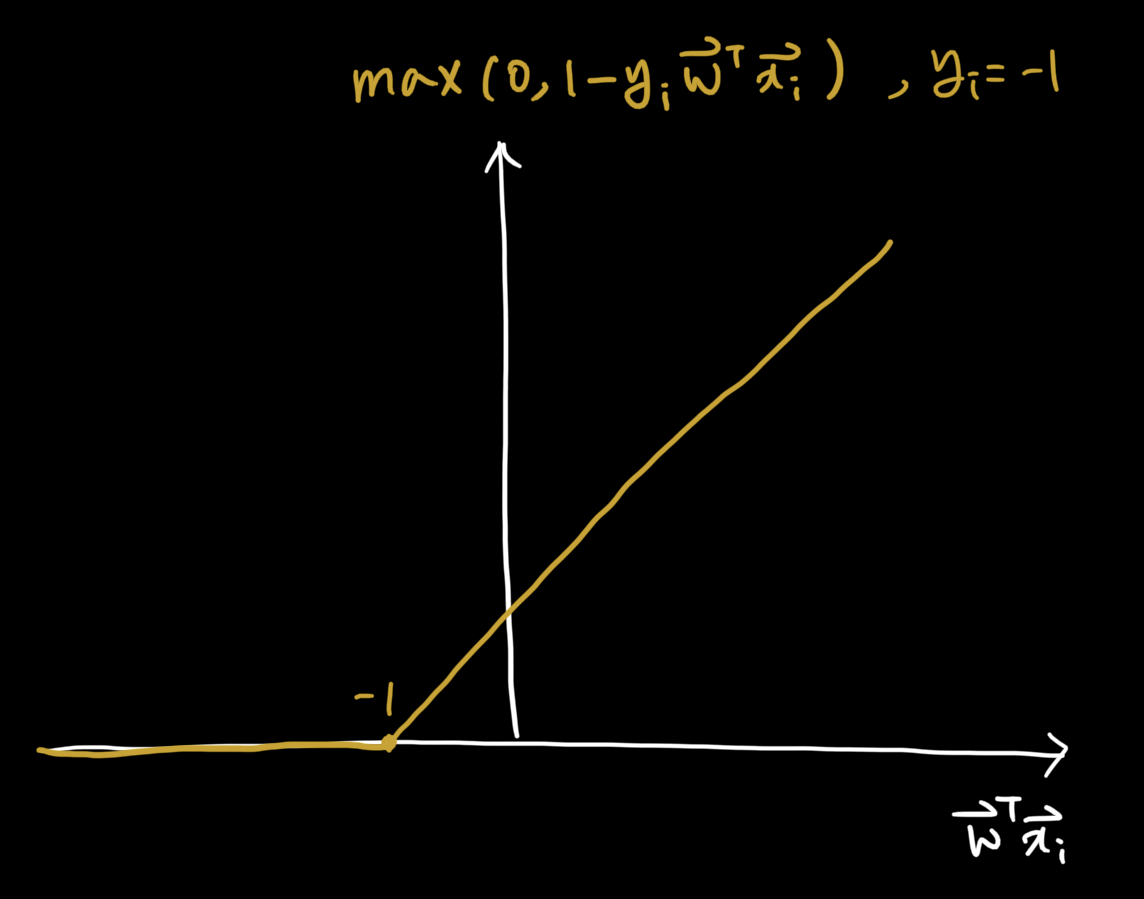

12.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 6-2 (K-MOOC)

Linear Classification에 사용되는 loss function들에 대해서 학습합니다.

13.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 7-1 (K-MOOC)

noise에 강인한 모델 설계 방법에 대해서 알아봅시다 !

14.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 7-2 (K-MOOC)

Multi-calss 문제 해결방법, p-norm, Regularization에 대하여 작성했습니다.

15.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 9-1 (K-MOOC)

Non-linear Data에 대하여 작성했습니다.

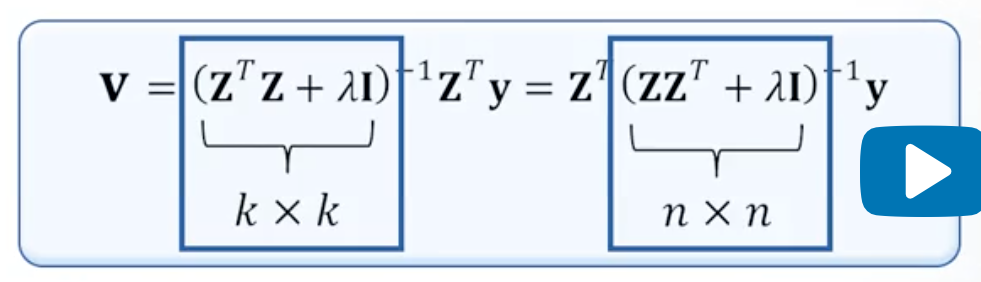

16.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 9-2 (K-MOOC)

Kernel Trick과 그 효과에 대하여 작성하였습니다.

17.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 10-1 (K-MOOC)

클러스터링에 대하여 작성했습니다.

18.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 10-2 (K-MOOC)

클러스터링에 대하여 작성하였습니다. (k-means clustering & k-means clustering++)

19.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 11-1 (K-MOOC)

Weak-supervision에 대하여 작성했습니다.

20.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 11-2 (K-MOOC)

Semi-supervision 에 대해서 작성했습니다.

21.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 12-1 (K-MOOC)

Gradient Descent 기본 내용을 작성하였습니다.

22.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 12-2 (K-MOOC)

SGD, Mini-batch Gradient Descent 에 대하여 작성하였습니다.

23.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 13-1 (K-MOOC)

DNN 에 대하여 작성하였습니다.

24.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 13-2 (K-MOOC)

DNN 에 대한 설명을 작성했습니다.

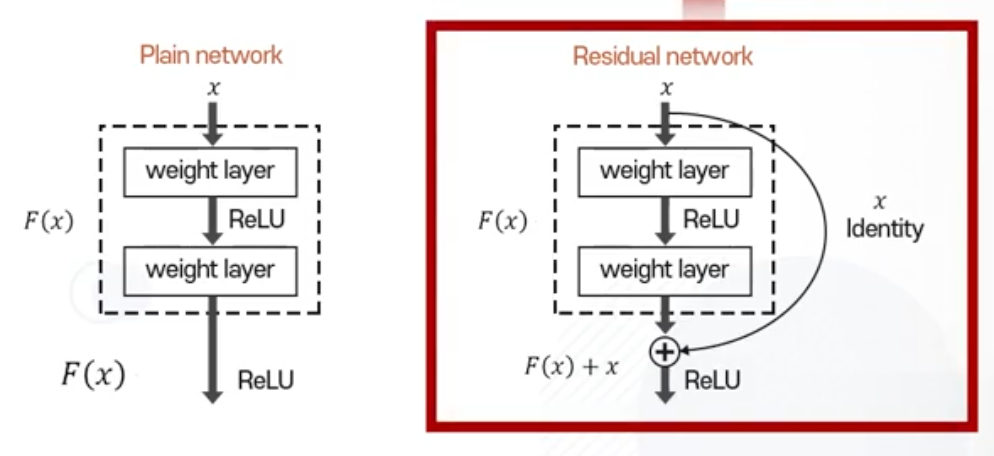

25.[ML] 딥러닝의 깊이 있는 이해를 위한 머신러닝 14-1 (K-MOOC)

DNN 을 활용한 향상된 Supervised LearningResidual 구조의 의미다양한 DNN 활용방법기존보다 향상된 형태의 Supervised Learning 을 위한 DNN 구조를 이해Residual 구조의 필요성 이해다양한 DNN 활용방법을 이해Kaiming